多模态大模型的视觉突破与局限

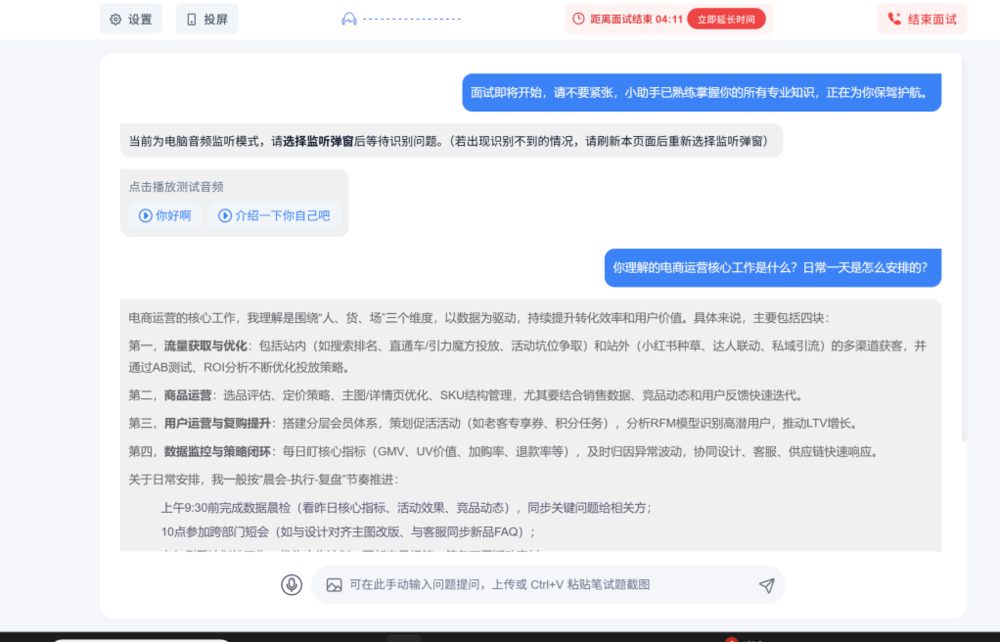

当 DeepSeek 发布其 V4 模型并引发全球关注后,多模态能力成为行业关注的焦点。近日,DeepSeek 内部研究员正式测试其识图功能,标志着国产大模型在视觉理解领域迈出了关键一步。此次测试并非简单的功能展示,而是一场精心设计的压力测试,旨在揭示当前 AI 模型在视觉理解方面的真实水平。

测试团队通过 12 张精心设计的图片,从基础描述、文化知识、逻辑推理等多个维度对 DeepSeek 的识图能力进行全面评估。这些图片涵盖了日常场景、专业领域、逻辑谜题等不同类型,力求全方位检验模型的视觉理解边界。

基础视觉理解:细节还原与文化解析

在基础画面描述测试中,DeepSeek 展现了令人印象深刻的细节捕捉能力。当面对 Cosplay 照片时,模型不仅能够完整描述人物、背景、光影等元素,还能准确识别出图片中的角色身份。这种能力对于文生图应用场景具有直接价值,意味着生成的文字描述足以支撑高质量图像再生成。

在博物馆展品识别测试中,模型的表现同样可圈可点。虽然基础模式下的回答仅停留在表面描述,但开启思考模式后,模型能够精准识别出清代痕都斯坦风格的玉器,并准确追溯其历史背景至莫卧儿王国。这种从视觉特征到文化背景的跨模态推理,体现了模型在专业知识领域的积累深度。

活动场景识别测试进一步验证了模型的综合理解能力。面对信息量复杂的展会现场图片,DeepSeek 不仅能够提取关键文字信息,还能准确判断活动性质和地点。这种能力在商业场景、社交媒体分析等领域具有广泛应用价值。

然而,知识库的时效性问题开始显现。当面对最新游戏或产品图片时,模型虽然能够通过特征分析进行合理推测,但无法准确提供最新信息。这表明当前模型的知识库更新机制仍需优化,以适应快速变化的信息环境。

逻辑推理挑战:视觉理解的深层考验

元素识别测试揭示了模型在复杂视觉场景下的处理能力。在老虎数量统计测试中,模型经历了多次自我修正,最终给出错误答案。这种反复思考却无法得出正确结论的现象,暴露了模型在处理复杂计数任务时的逻辑局限性。

隐藏数字识别测试更是将模型推向了极限。面对经过特殊处理的反色、碎块化图片,模型完全无法识别隐藏信息。这类测试在视觉对抗样本研究中具有重要意义,反映了当前 AI 模型在面对精心设计的视觉干扰时的脆弱性。

图形逻辑题测试则展现了模型在推理方面的潜力与不足。前两道题模型均未能正确解答,第三道题在经过长时间深度思考后得出正确答案。这种"零的突破"虽然令人振奋,但也凸显了模型在处理复杂逻辑任务时的不稳定性和低效率。

测试数据显示,模型在处理逻辑推理任务时,往往需要经历漫长的思考过程,且成功率存在较大波动。这表明当前的视觉理解模型更多是依赖模式匹配而非真正的逻辑推理,距离人类水平的视觉推理能力仍有显著差距。

技术演进路径:从外挂模块到原生多模态

从技术架构角度分析,当前的识图功能更像是外挂的视觉理解模块,而非原生多模态能力的体现。这种架构设计虽然能够快速实现基础视觉功能,但在复杂推理和跨模态理解方面存在天然局限。

外挂模块的优势在于部署灵活、迭代快速,能够在短期内满足基础应用需求。然而,这种架构在处理复杂任务时,往往需要额外的推理步骤和信息整合,导致响应时间较长且准确率不稳定。

原生多模态模型则通过统一的训练框架,将视觉和语言信息在更深层次上进行融合。这种架构不仅能够提高推理效率,还能在跨模态理解上实现质的飞跃。当前 DeepSeek 团队的技术布局显示,他们已经意识到这一发展方向,正在为下一代原生多模态模型做准备。

技术演进的路径选择不仅影响产品性能,更关系到整个行业的竞争格局。掌握原生多模态技术的厂商,将在未来 AI 应用中占据更加主动的地位。这也解释了为什么各大科技巨头都在加大多模态技术的研发投入。

行业应用展望与改进方向

从应用场景来看,DeepSeek 的识图能力在内容创作、教育辅助、商业分析等领域具有广阔应用前景。基础描述和文化解析能力可以用于智能相册管理、在线展览导览等场景;逻辑推理能力经过优化后,可应用于自动化质检、复杂文档分析等专业领域。

然而,要实现真正的商业化应用,模型仍需在以下方面进行优化:知识库的实时更新机制、复杂场景的鲁棒性提升、逻辑推理的准确性改进、以及响应速度的优化。这些技术突破需要模型架构、训练数据、推理算法等多方面的协同改进。

行业专家建议,企业用户在引入此类技术时应建立合理的预期,既要看到技术潜力,也要认识到当前的局限性。最佳实践是在明确应用场景的前提下,将 AI 识图能力与传统技术相结合,形成互补优势。

从竞争格局来看,随着多模态技术的逐步成熟,市场竞争焦点将从单一功能竞争转向综合生态竞争。能够提供更完整解决方案、更好用户体验的厂商,将在未来市场格局中占据更有利位置。

技术边界探索:AI 视觉理解的现实挑战

当前 AI 视觉理解技术面临着多重挑战:数据质量与时效性、复杂场景理解、跨模态推理、以及伦理隐私问题。这些挑战的解决需要跨学科的合作创新,包括计算机视觉、自然语言处理、认知科学等多个领域的知识融合。

在数据层面,高质量标注数据的获取仍是制约因素。特别是在专业领域,如医学影像、工业检测等,缺乏足够的高质量训练数据限制了模型的泛化能力。同时,数据的实时更新机制也亟待完善,以应对快速变化的现实环境。

在技术层面,如何让 AI 真正理解视觉信息背后的语义,而非仅仅进行模式匹配,是下一步突破的关键。这需要从认知科学角度理解人类视觉推理的机制,并将其转化为可计算的算法模型。

伦理和隐私问题也不容忽视。随着图像识别技术的普及,如何保护个人隐私、防止技术滥用,成为行业发展的重要课题。这需要技术、法律、伦理等多方面的协同治理。

未来发展方向:构建真正的智能视觉系统

展望未来,AI 视觉理解技术将朝着更智能、更鲁棒、更实用的方向发展。原生多模态架构将成为主流,支持更复杂的跨模态推理任务。实时知识库更新机制将确保模型能够及时掌握最新信息。

技术突破点可能出现在以下几个方面:基于Transformer 架构的视觉 - 语言统一模型、动态知识图谱与推理结合、对抗样本鲁棒性提升、以及端侧轻量级部署优化。这些技术突破将推动 AI 视觉能力从实验室走向大规模应用。

应用场景也将更加多元化,从简单的图像分类扩展至复杂场景理解、跨模态内容创作、智能决策支持等高级应用。在教育、医疗、制造、娱乐等领域,AI 视觉技术将发挥越来越重要的作用。

最终,AI 视觉系统的发展目标是实现真正的"视觉智能",即能够像人类一样理解、推理、创造,而不仅仅是识别和匹配。这需要我们持续探索技术边界,同时也需要建立合理的社会伦理框架,确保技术发展造福人类社会。