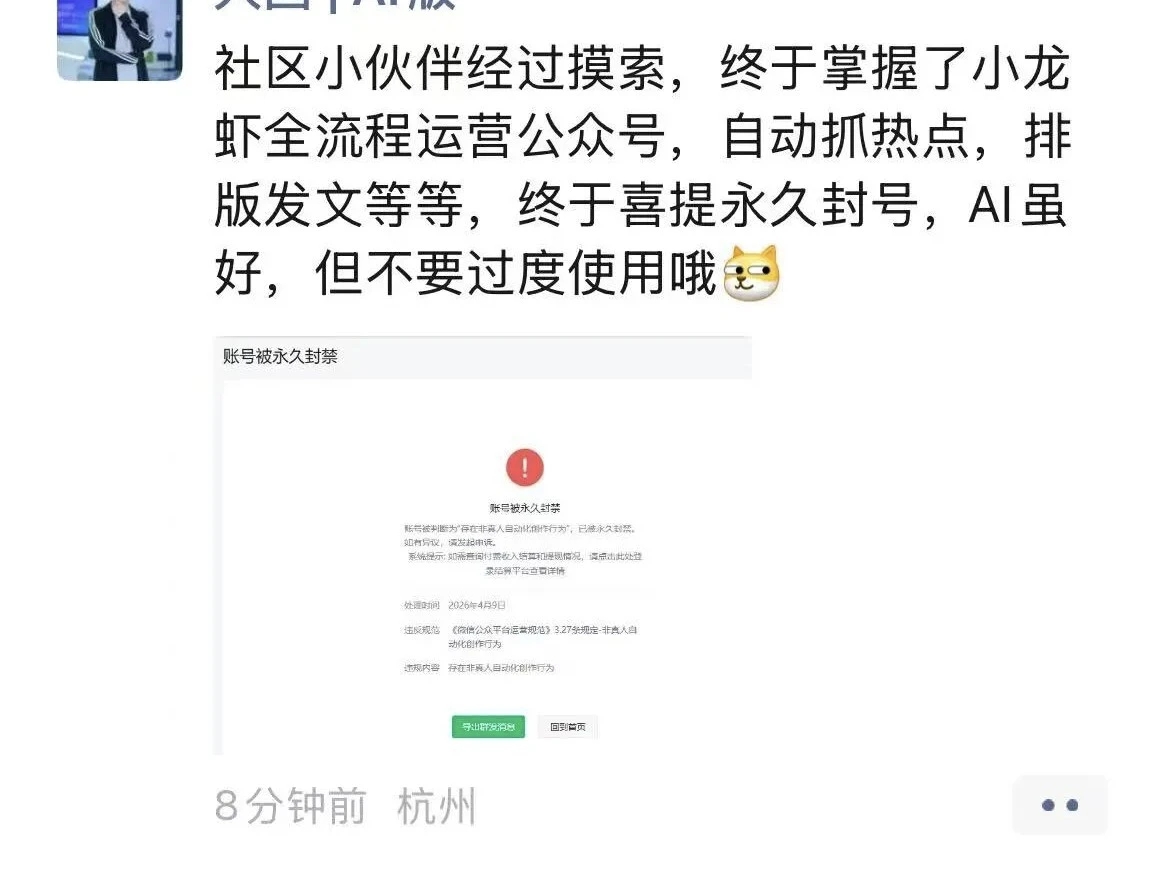

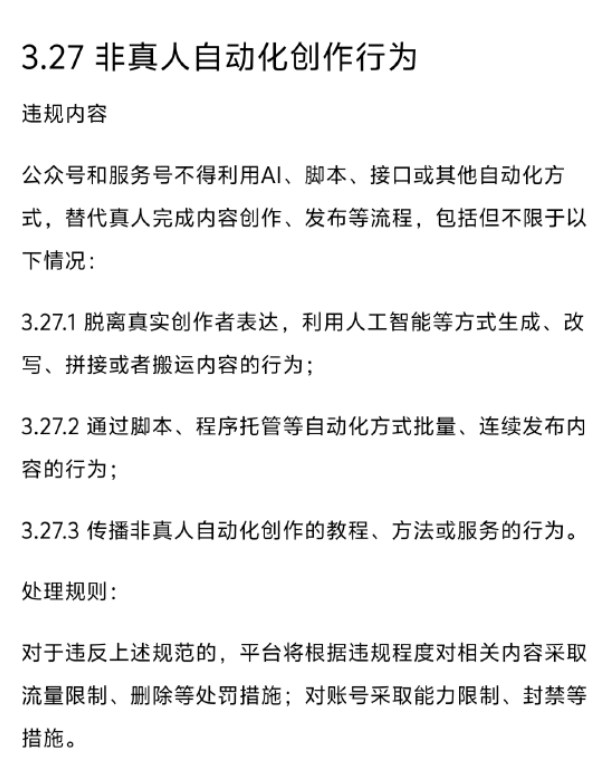

近期,微信公众号平台对AI创作行为采取严格管控措施,这一政策变化在内容创作领域引发了广泛讨论。平台明确将'非真人自动化创作行为'列为违规内容,包括使用AI、脚本、接口等自动化方式替代真人完成内容创作或发布流程。

平台政策的具体要求

根据微信公众号更新的平台规范,以下行为将被视为违规:

- 使用AI工具完全替代真人完成文章创作

- 通过脚本或接口自动化发布内容

- 传播非真人自动化创作的教程、方法或服务

- 其他形式的自动化内容生产行为

平台提示信息显示,相关处理是基于用户投诉并经平台审核后作出的判定。违规内容将被限制或删除,相关账号也将面临能力限制乃至封禁处理。

政策实施的现实影响

在实际操作中,这一政策的执行呈现出一定的复杂性。有运营者反映,即使是纯手写的关于AI辅助撰写公众号内容的教程文章,也接连被平台删除。这种情况反映出平台在识别'AI创作'与'真人创作'时可能存在技术难度。

从行业数据来看,目前微信公众号平台拥有超过2000万个公众号,日活跃用户数亿。如此庞大的内容生态,如何有效识别和管理AI创作内容,对平台的技术能力和管理智慧都提出了严峻挑战。

技术发展与内容质量的平衡

AI辅助创作技术的发展为内容生产带来了革命性变化。根据相关统计,目前市场上已有超过50种AI写作工具,能够帮助创作者提高效率、优化内容结构。然而,过度依赖AI可能导致内容同质化、缺乏个性化和深度思考。

从技术角度分析,当前AI写作工具主要基于大型语言模型,能够生成语法正确、结构完整的文本,但在创造性思维、情感表达和深度分析方面仍存在局限。平台此次政策的出台,某种程度上反映了对内容质量下降的担忧。

行业各方的反应与应对

内容创作者群体对这一政策反应不一。部分依赖AI工具的创作者表示担忧,认为这将大幅增加创作成本;而坚持原创的创作者则对此表示支持,认为有助于维护内容生态的健康。

从商业角度考虑,平台此举可能出于多重考量:一方面要维护内容质量,保障用户体验;另一方面也要防范可能的法律风险,特别是在版权和内容真实性方面。

技术识别能力的挑战

目前,准确识别AI生成内容仍存在技术难点。虽然有一些检测工具能够通过分析文本特征来判断是否由AI生成,但这些工具的准确率仍有待提高。误判情况时有发生,这也是导致部分真人创作内容被误删的原因。

从技术发展轨迹来看,随着AI生成内容的质量不断提升,区分AI创作与真人创作的难度将进一步加大。这要求平台需要持续升级技术识别能力,同时也要建立更完善的人工审核机制。

国际对比与趋势分析

对比国际主流内容平台,对AI创作的态度存在差异。一些平台采取相对开放的态度,允许标明AI辅助创作;而另一些平台则持更为谨慎的立场。这种差异反映了不同市场对技术接受度和内容标准的理解差异。

从长期趋势看,AI辅助创作将成为不可逆转的技术潮流。关键在于如何建立合理的规则体系,既保障内容质量,又不阻碍技术创新。这需要平台、创作者、技术提供商等多方共同参与规则制定。

创作者应对策略建议

面对这一政策变化,创作者可以采取以下策略:

- 明确标注AI辅助创作内容,保持透明度

- 将AI作为创作工具而非替代品,保持人的主导地位

- 注重内容质量和原创性,避免简单的内容搬运

- 关注平台政策变化,及时调整创作方式

技术伦理与行业规范

这一事件也引发了关于技术伦理的思考。AI技术的发展应当服务于人类,而不是取代人类。在内容创作领域,保持人的创造性思维和情感表达至关重要。行业需要建立更完善的技术伦理规范,确保技术发展与人本价值相协调。

从监管角度看,需要平衡技术创新与风险防控。过于严格的管控可能抑制创新,而过于宽松则可能导致内容质量下降。这需要建立分层分类的管理机制,针对不同类型的内容采取差异化管理策略。

未来展望

随着AI技术的持续发展,内容创作方式将发生深刻变革。平台治理政策也需要与时俱进,既要防范风险,又要促进创新。未来可能会出现更细化的管理标准,区分不同类型的AI辅助创作行为。

从创作者角度,需要适应技术变革,提升自身创作能力,将AI作为提升效率的工具,而不是完全依赖。只有保持人的创造性和思考深度,才能在技术变革中保持竞争力。

这一政策变化标志着内容创作领域进入新的发展阶段。如何在技术创新与内容质量之间找到平衡点,将是未来行业发展的关键课题。