谷歌最新发布的Gemma 4开源大模型系列标志着AI技术发展的一个重要里程碑。这一系列模型不仅在参数规模上实现突破,更重要的是在单位参数智能效率方面达到了新的高度。

模型架构设计的创新突破

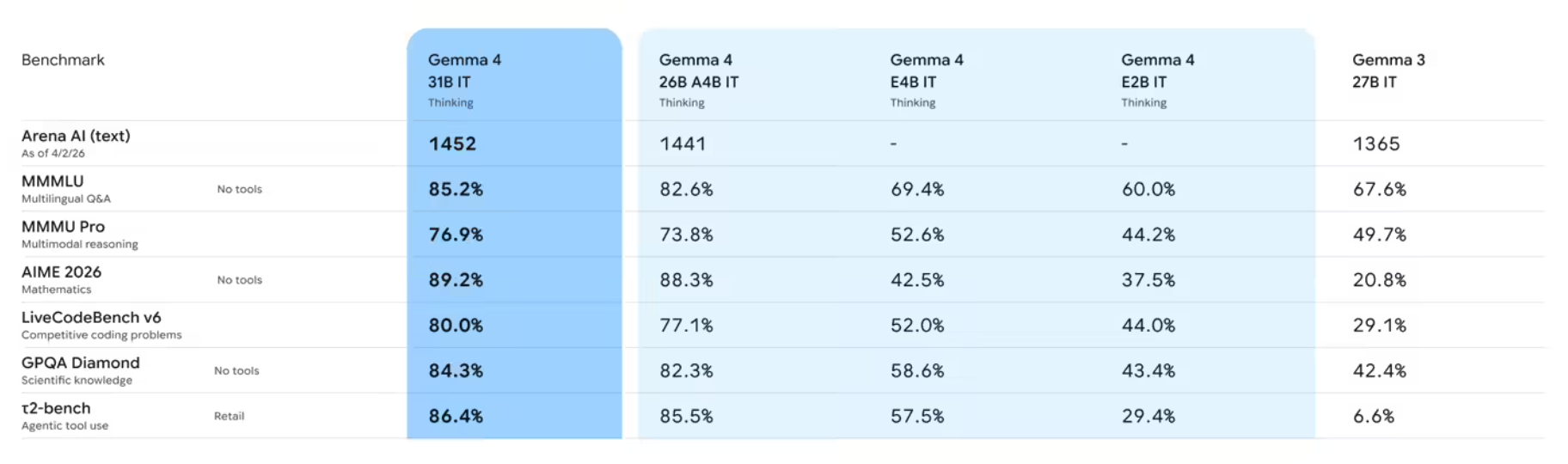

Gemma 4系列包含四个不同规格的模型,每种都针对特定应用场景进行了优化设计。20亿参数版本和40亿参数版本专为端侧设备优化,在保持高性能的同时大幅降低硬件需求。260亿参数的混合专家模型采用先进的MoE架构,在推理时仅激活部分参数,实现了效率与性能的平衡。而310亿参数的稠密模型则代表了当前开源模型的顶尖水平。

这种分层设计思路体现了谷歌对AI普及化的深入思考。不同规模的模型可以满足从移动设备到数据中心的各种需求,让AI能力真正实现普惠。

性能表现的突破性进展

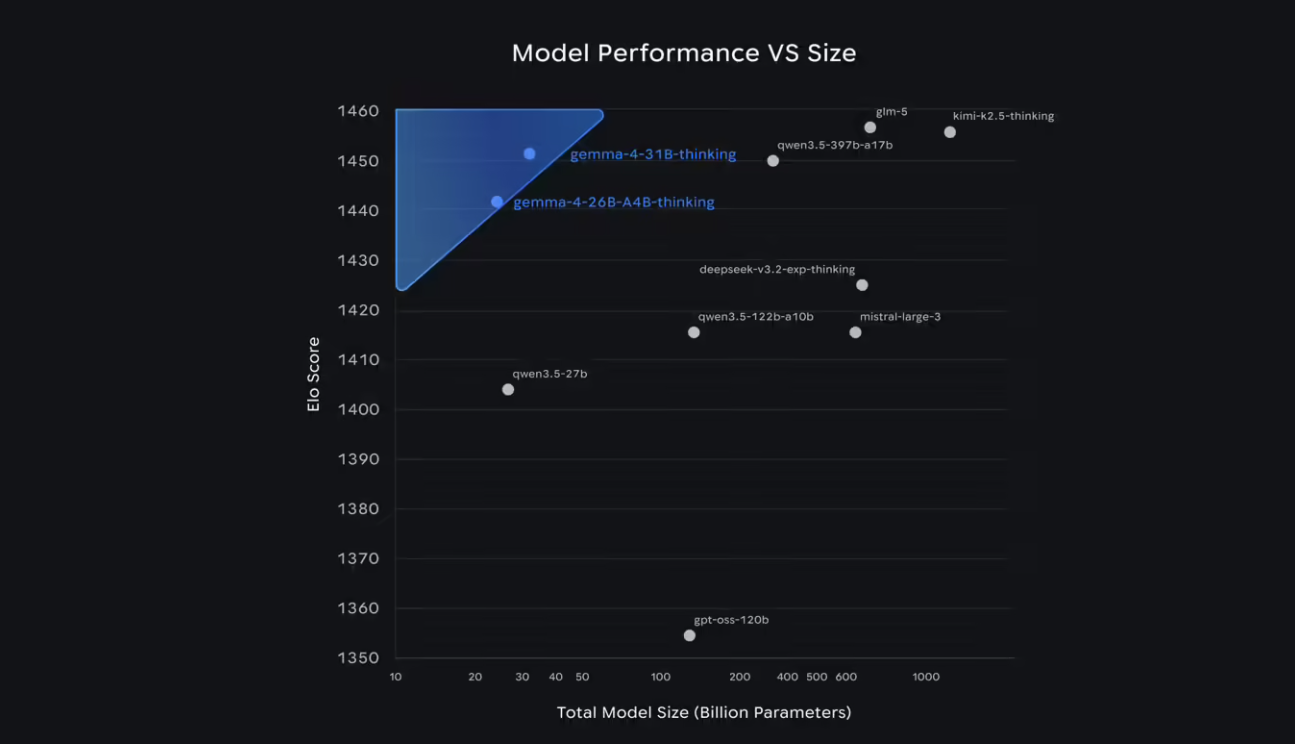

在行业标准的Arena AI文本榜单测试中,Gemma 4 31B模型位列全球开源模型第三名,这一成绩的含金量不容小觑。更令人印象深刻的是,该模型在某些测试中甚至超越了参数规模大20倍的竞争对手,这充分证明了其单位参数智能水平的优越性。

这种性能突破主要得益于以下几个方面的技术创新:

高级推理能力的显著提升 模型在数学推理、逻辑推理等需要多步思考的任务上表现出色。这得益于改进的训练方法和更高质量的数据集,使得模型能够进行更深层次的逻辑推理。

智能体工作流的原生支持 Gemma 4在设计之初就考虑到了实际应用需求,原生支持函数调用、结构化JSON输出等功能。这使得开发者能够更容易地构建复杂的AI应用系统。

多模态能力的全面进化

Gemma 4在视觉和音频处理能力上的进步同样令人瞩目。全系模型都支持视频和图像处理,兼容可变分辨率输入,在OCR、图表理解等视觉任务上表现出专业水准。端侧模型更是集成了原生音频处理能力,为语音识别和理解应用打开了新的可能性。

这种多模态能力的整合不仅仅是功能的堆砌,而是真正实现了不同模态信息的深度融合处理。模型能够理解图像中的文字内容,同时结合上下文进行智能分析,这种能力在实际应用中具有重要价值。

硬件效率的优化设计

Gemma 4在硬件效率方面的优化值得特别关注。31B模型的非量化版本可以高效运行在单张80GB H100 GPU上,而量化版本甚至可以在消费级GPU上流畅运行。这种设计大大降低了AI应用的门槛,使得更多开发者和中小企业能够享受到顶尖AI技术带来的红利。

对于移动设备而言,E2B和E4B模型通过与硬件厂商的深度合作,实现了在手机等端侧设备上的离线运行能力。这种近零延迟的体验为移动AI应用开辟了新的发展空间。

开发工具生态的完善

谷歌为Gemma 4提供了完整的开发工具链支持。AICore开发者预览版已经支持智能体流程的搭建,并且与Gemini Nano 4保持向前兼容。这意味着开发者可以基于统一的开发框架,快速构建和部署AI应用。

这种生态建设的重要性不容忽视。一个成熟的工具生态能够显著降低开发门槛,加速AI技术的实际应用落地。谷歌在这方面展现出了长远的战略眼光。

实际应用场景的拓展

Gemma 4的强大能力为多个行业带来了新的机遇。在编程辅助领域,其高质量的代码生成能力可以将普通工作站转变为智能编程助手。在内容创作方面,长文本处理能力使得模型能够处理完整的代码库或长篇文档。多语言支持则为全球化应用提供了坚实基础。

特别值得一提的是模型在智能体工作流方面的能力。企业可以利用这一特性构建自动化业务流程,从简单的数据处理到复杂的决策支持系统,Gemma 4都能提供可靠的技术支撑。

技术发展的深远影响

Gemma 4的发布不仅仅是一个产品更新,更代表了开源AI模型发展的新方向。其在单位参数效率上的突破表明,单纯追求参数规模的时代正在过去,智能效率将成为新的竞争焦点。

这种转变对整个AI行业都具有重要意义。它意味着AI技术将更加注重实际应用价值,而非单纯的性能指标。开发者可以基于更小的模型实现更强的功能,这无疑将推动AI技术的快速普及。

未来发展趋势展望

从Gemma 4的技术特点可以看出,未来AI模型的发展将更加注重以下几个方面:首先是多模态能力的深度融合,不同模态信息之间的理解与交互将更加自然流畅;其次是硬件效率的持续优化,让AI能力在更多设备上实现本地化部署;最后是开发工具的不断完善,降低技术门槛,推动创新应用的出现。

谷歌通过Gemma 4展现了其在AI领域的战略布局。开源策略与商业产品的协同发展,硬件优化与软件生态的齐头并进,这些都体现了公司在AI技术普及化方面的坚定决心。

随着Gemma 4的广泛应用,我们有理由相信,AI技术将更快地融入日常生活和工作中,为社会发展带来新的动力。这一进程不仅需要技术突破,更需要开发者社区的积极参与和创造性应用。