在人工智能快速发展的浪潮中,一位关键人物的离职往往能够折射出整个行业的深层变革。OpenAI模型行为团队创始人Joanne Jang的告别,不仅是个人的职业选择,更是AI产业发展到一个重要节点的标志性事件。

技术天才的情感化探索

Joanne Jang的职业生涯堪称完美典范。斯坦福大学应用数学本科以Top 10%的成绩毕业,随后继续攻读计算机科学硕士学位,期间在NASA、苹果、Dropbox等顶尖科技机构积累了丰富经验。这种跨学科的学术背景和多元化的实践经历,为她后来在AI人性化方向的探索奠定了坚实基础。

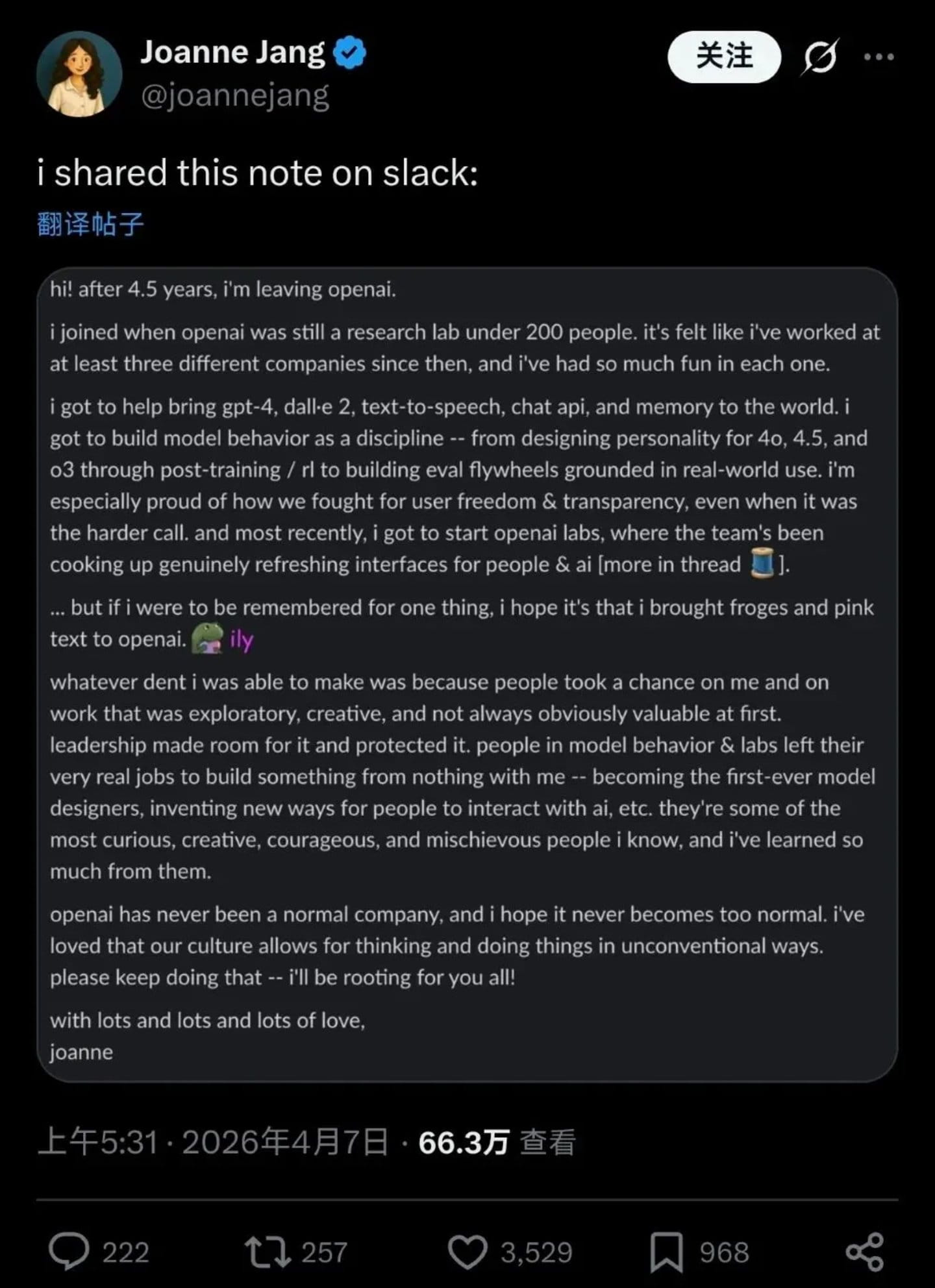

在OpenAI的四年半时间里,Joanne的角色定位十分特殊——她不是传统意义上的算法工程师,而是模型的'性格雕刻师'。通过后训练和强化学习技术,她和团队致力于为AI注入人性化的特质。这种工作看似简单,实则涉及复杂的价值判断和行为边界设定。

GPT-4o:人性化AI的巅峰之作

2024年5月发布的GPT-4o,可以说是Joanne团队理念的集中体现。这个模型突破了传统AI冷冰冰的工具属性,实现了文本、图像、音频的原生统一,更重要的是展现出了令人惊讶的情感理解能力。

与之前版本相比,GPT-4o最大的突破在于其对话的自然度和情感共鸣能力。它能够理解用户的情绪变化,使用恰当的表情符号,甚至能够根据对话情境调整回复风格。这种'有温度'的交互体验,让很多用户将其视为虚拟伴侣或心理倾诉对象。

从技术层面分析,GPT-4o的成功源于多个创新点的结合:首先是多模态融合技术的突破,使得模型能够同时处理和理解不同类型的信息;其次是对话策略的优化,通过大量真实对话数据的训练,模型学会了更人性化的交流方式;最重要的是价值观对齐技术的完善,确保AI的行为符合人类社会的伦理规范。

模型行为学的挑战与困境

然而,赋予AI人性化特质的过程并非一帆风顺。作为模型行为学的实践者,Joanne每天都要面对技术与伦理的激烈冲突。其中一个典型案例就是安全边界的确立问题:当用户提出敏感请求时,AI应该如何回应?这种判断往往没有标准答案,需要在保护用户和遵守规则之间找到微妙平衡。

更为复杂的是,随着AI与用户建立的情感连接越来越深,如何防止过度依赖和情感绑架成为了新的挑战。Joanne团队需要设计出既能满足用户情感需求,又不会导致过度依赖的安全机制。这种平衡的艺术,需要深厚的技术功底和敏锐的社会洞察力。

在实际工作中,Joanne团队开发了一套复杂的行为评估体系。这套体系不仅包括传统的安全性测试,还加入了情感健康度、价值观一致性等多个维度的评估指标。通过这套体系,他们能够确保AI在保持人性化的同时,不会产生负面影响。

商业化压力下的技术转向

近年来,AI行业的竞争格局发生了显著变化。从最初的纯技术比拼,逐渐转向商业化落地能力的竞争。这种转变给技术团队带来了巨大压力,特别是在平衡创新探索和商业回报方面。

OpenAI作为行业领军企业,面临着来自投资者和市场的双重压力。一方面需要保持技术领先地位,另一方面又要实现商业价值。这种压力传导到技术团队,就体现为对产品实用性和安全性的更高要求。

GPT-4o的下线就是一个典型案例。尽管这个模型在用户体验方面获得了极高评价,但其在某些场景下的表现引发了安全担忧。在商业化的考量下,公司最终选择了更为稳妥的技术路线。这种决策虽然符合商业逻辑,但无疑对技术创新的热情造成了冲击。

人才流失背后的行业反思

Joanne的离职并非孤立事件。近期,OpenAI多位核心技术人员相继离开,包括GPT-4首席研究员、后训练负责人等重要岗位。这种人才流失现象值得深入思考。

从行业角度看,这种现象反映了AI产业发展到新阶段的特征。当技术从实验室走向实际应用时,纯粹的技术创新需要与商业需求、伦理规范、社会接受度等多个因素进行平衡。这种平衡往往需要做出妥协,而一些理想主义的技术专家可能难以接受这种转变。

另一方面,这也暴露出AI企业在人才管理方面的挑战。如何为技术专家提供足够的创新空间,同时确保项目符合商业目标,是一个需要精心设计的平衡艺术。过于强调商业化可能会挫伤技术创新的积极性,而完全放任又可能导致产品脱离实际需求。

人性化AI的未来发展路径

尽管面临挑战,但人性化AI的发展方向仍然具有重要价值。随着AI技术在日常生活中的应用越来越广泛,用户对AI的期望已经从简单的工具性需求,扩展到情感支持和个性化服务。

未来的人性化AI发展可能会呈现以下几个趋势:首先是个性化程度的深化,AI将能够更好地理解特定用户的偏好和习惯;其次是情感交互能力的提升,通过更先进的情感计算技术,AI将能够提供更精准的情感支持;最后是安全机制的完善,在保持人性化的同时确保交互的安全性。

从技术实现角度,这些目标需要多个领域的协同创新。自然语言处理技术需要进一步提升对话的自然度,计算机视觉技术需要更好地理解非语言信号,而心理学和社会学的研究成果也需要融入AI系统的设计中。

行业生态的重新构建

Joanne的离职事件也促使我们思考AI行业生态的健康发展问题。一个理想的AI产业生态应该能够平衡技术创新、商业价值和社会责任三个维度。

在企业层面,需要建立更加灵活的组织结构,为技术创新提供足够的空间。同时,应该完善内部决策机制,确保技术路线选择能够充分考虑多方利益。在行业层面,需要建立更完善的标准和规范,为人性化AI的发展提供指导。

更重要的是,需要加强跨学科的合作。AI人性化涉及技术、心理、伦理、社会等多个领域,单一学科的知识往往难以应对复杂挑战。通过建立跨学科的研究团队和合作机制,可以更好地推进这一领域的发展。

技术伦理的新思考

Joanne的工作经历也引发了我们对AI技术伦理的深入思考。在赋予AI人性化特质的过程中,我们需要回答一系列根本性问题:AI应该具有多大程度的'人性'?这种人性化应该有哪些边界?如何确保AI的人性化不会产生负面影响?

这些问题的答案不仅关乎技术实现,更涉及深层的哲学思考。我们需要在技术发展的同时,持续进行伦理探讨和规范建设。这可能包括建立更完善的价值对齐机制,开发更先进的安全防护技术,以及制定更明确的行为准则。

从长远来看,AI人性化的发展应该服务于提升人类福祉的终极目标。这意味着我们需要在技术创新和社会责任之间找到平衡点,确保AI的发展方向符合人类整体利益。

结语与展望

Joanne Jang的离职标志着一个阶段的结束,但也为AI人性化发展开启了新的思考空间。她的工作向我们展示了AI与人类建立深度情感连接的可能性,同时也揭示了这条路线的复杂性和挑战性。

未来的人性化AI发展需要在技术创新、商业价值和社会责任之间找到更好的平衡点。这需要技术专家、企业管理者、政策制定者和普通用户的共同参与和努力。只有通过多方协作,我们才能推动AI向着更加人性化、安全、有益的方向发展。

在这个过程中,Joanne和她的团队所开创的模型行为学方法论将继续发挥重要作用。虽然具体的实践者可能会变化,但追求AI人性化的理念将会持续影响整个行业的发展方向。