技术架构解析

OmniWeaving框架的核心技术架构由三个关键组件构成:多模态大语言模型(MLLM)、多模态扩散Transformer(MMDiT)和变分自编码器(VAE)。这种架构设计使得框架能够处理复杂的多模态输入,并生成高质量的视频内容。

MLLM组件负责语义理解,能够解析用户提供的文本、图像和视频输入,将其映射到高级语义空间。这一过程不仅仅是简单的特征提取,而是深度理解输入内容之间的时空关系和语义关联。

MMDiT作为生成核心,采用扩散Transformer架构,能够基于MLLM提供的语义指导生成精细的视频内容。与传统扩散模型相比,MMDiT在处理多模态输入时具有更好的时序一致性和内容连贯性。

VAE编码器则负责视觉信号的压缩和重建,确保生成视频的质量和效率。通过这三个组件的协同工作,OmniWeaving实现了从概念理解到视频输出的端到端生成流程。

功能特性深度分析

统一多模态生成能力

OmniWeaving最显著的特点是打破了传统视频生成模型的单一任务限制。传统模型通常只能处理特定类型的输入,如纯文本或单张图像,而OmniWeaving支持文本、多图像(1-4张)和视频片段的自由组合输入。

这种能力使得创作者能够更加灵活地表达创意意图。例如,用户可以同时提供角色设计图、场景参考图和动作描述文本,系统会自动理解这些元素之间的关系,生成符合预期的视频内容。

时序绑定生成技术

时序绑定是OmniWeaving的另一项核心技术突破。传统视频生成模型在处理多模态输入时往往采用简单的拼接方式,导致生成内容缺乏连贯性。OmniWeaving通过先进的时序绑定算法,能够理解不同模态内容之间的时空关系,生成自然流畅的动态视频。

推理增强创作模式

框架独有的"思考模式"是其区别于其他视频生成工具的关键特性。当激活该模式时,MLLM会先对用户输入进行深度推理,自动补全缺失的镜头语言和叙事逻辑,然后才进行视频生成。

这种能力显著降低了复杂创意描述的提示词工程门槛。用户无需提供极其详细的指令,系统就能理解创作意图并生成符合预期的内容。

实际应用场景

影视广告创意生产

在影视广告制作领域,OmniWeaving能够大幅提升创意验证效率。制作团队可以通过文本描述直接生成概念预演视频,快速验证分镜设计的可行性。更重要的是,系统支持将角色、场景、道具参考图自由组合生成完整广告片,大大缩短了前期制作周期。

电商产品动态展示

电商行业可以利用OmniWeaving生成产品使用场景视频。商家只需上传产品白底图和场景参考图,系统就能自动生成展示产品在不同场景下使用效果的视频内容。结合用户照片与商品视频,还能生成个性化虚拟试穿效果,提升购物体验。

社交媒体内容创作

对于社交媒体内容创作者而言,OmniWeaving提供了强大的内容创作工具。用户可以将静态照片转化为带自然表情动作的动态视频,让老照片"活"起来。基于首尾帧插值功能,创作者能够快速生成循环动画或趣味表情包,满足社交媒体平台的传播需求。

游戏动画资产制作

游戏开发领域是OmniWeaving的重要应用场景。开发者可以上传角色设计图与动作描述,直接生成角色动画片段,加速过场动画制作。系统还支持基于关键帧自动补全中间动画,用于场景切换和特效制作。

技术优势对比分析

与其他主流视频生成框架相比,OmniWeaving在多个维度展现出明显优势。在任务统一性方面,单一框架支持六大类任务,避免了传统方案需要多个专用模型的碎片化问题。

在多模态输入处理能力上,OmniWeaving支持1-4张图像与视频片段的自由组合,而同类产品往往只能处理固定格式的输入。这种灵活性使得创作者能够表达更加复杂的创意意图。

推理增强功能是OmniWeaving的独特优势。通过MLLM的主动推理能力,系统能够理解模糊的用户意图,自动补全创作细节,这在其他开源框架中较为罕见。

部署与使用指南

环境配置要求

OmniWeaving对硬件环境有一定要求,建议在多GPU环境下运行以获得最佳性能。官方示例使用8卡配置,但框架也提供了显存优化选项,支持Flash Attention或SageAttention加速库,用户可以根据实际硬件条件进行选择。

软件环境方面,需要Python和PyTorch基础环境,并安装HunyuanVideo-1.5相关依赖。项目提供了详细的安装指南和依赖管理方案。

模型获取与配置

用户可以从HuggingFace平台下载腾讯混元发布的HY-OmniWeaving模型权重文件。项目提供了完整的模型配置说明,包括不同任务类型对应的参数设置建议。

工作流程优化

针对不同的使用场景,OmniWeaving提供了多种工作流程优化方案。对于批量生成任务,建议启用缓存机制提升效率;对于交互式创作,可以配置实时预览功能便于调整参数。

性能评估与基准测试

在IntelligentVBench评估基准中,OmniWeaving在多个关键指标上达到开源统一模型的SoTA水平。特别是在语义一致性、时序连贯性和视觉质量方面表现突出。

评估结果显示,OmniWeaving在复杂场景生成任务中的表现接近商业系统水平,但在极端细节处理和超长视频生成方面仍有提升空间。框架团队表示将持续优化模型性能。

未来发展展望

OmniWeaving的开源标志着视频生成技术进入新的发展阶段。未来,框架团队计划在以下几个方面进行重点优化:提升生成视频的时长限制,增强复杂物理场景的模拟能力,以及改善多主体交互的自然度。

同时,社区生态建设也是重要发展方向。项目团队鼓励开发者基于OmniWeaving开发插件和扩展功能,共同推动开源视频生成技术的发展。

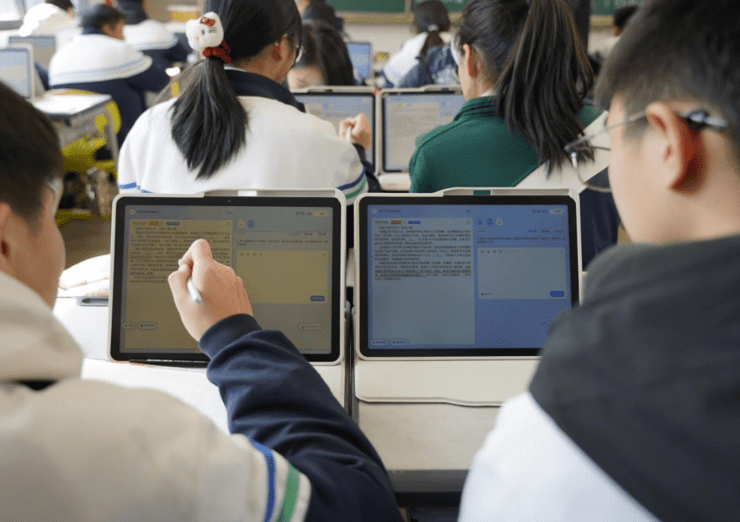

随着技术的不断成熟,OmniWeaving有望在更多领域发挥价值,包括教育、医疗、工业设计等专业场景,为AI视频生成技术的普及应用奠定坚实基础。