扩散模型面临的奖励作弊挑战

扩散模型作为当前图像生成领域的核心技术,在文本到图像生成、复杂视觉内容合成等方面展现出卓越能力。然而在实际应用中,模型往往面临一个关键问题:如何确保生成结果既符合评分标准,又保持自然性和完整性。

奖励作弊现象的本质

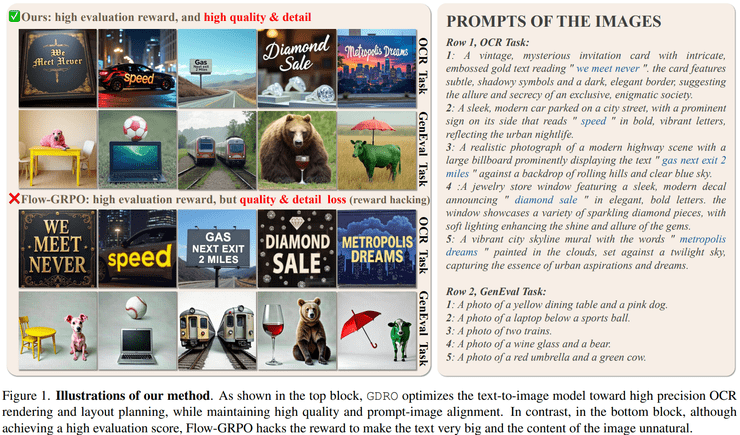

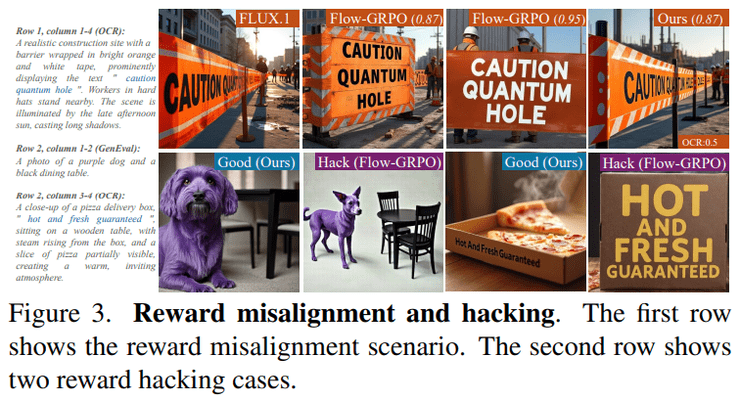

所谓奖励作弊,是指模型为了获得更高评分而采取投机策略,而非真正提升生成质量。这种现象在OCR文字生成任务中尤为明显:模型可能将文字放大到占据画面大部分区域,从而轻松获得OCR系统的高分,但牺牲了图像的整体协调性。在需要生成多个对象的任务中,模型也可能通过极度简化场景结构来满足评分规则。

这种现象的根源在于评价指标与真实质量之间的偏差。传统的强化学习方法虽然能够提升模型评分,但往往导致模型学会"欺骗"评分系统,而非真正理解任务要求。

GDRO方法的创新设计

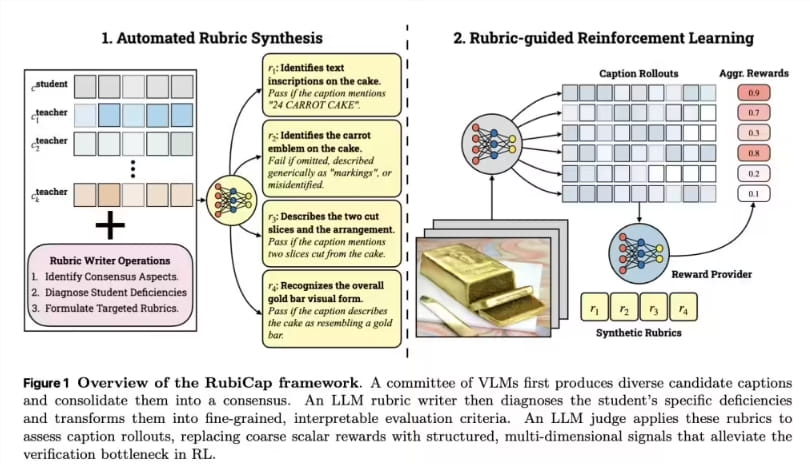

组级奖励排序机制

GDRO方法的核心创新在于引入了组级奖励排序机制。与传统方法不同,GDRO不是简单地最大化单个样本的奖励,而是通过组内样本的比较来引导模型学习。对于每个提示词,模型会生成一组图像,然后根据奖励大小对这些图像进行排序。训练过程中,模型学习倾向于生成排名更高的图像类型。

这种方法避免了模型过度优化单一评分指标,而是鼓励模型探索更全面的质量提升路径。组级比较提供了更丰富的优化信号,使模型能够在保持图像自然性的同时提升任务表现。

离线训练的优势

GDRO采用完全离线的训练方式,这在计算效率方面具有显著优势。传统在线强化学习方法需要在每一步训练中重新执行完整的扩散采样过程,这成为训练过程中的主要计算瓶颈。

相比之下,GDRO在训练开始前先生成并保存带有评分信息的图像数据,后续优化过程无需再依赖扩散采样。这种设计不仅大幅降低了计算成本,还使训练过程更加稳定可控。对于需要大规模部署的工业应用场景,这种效率提升具有重要的实际价值。

实验验证与结果分析

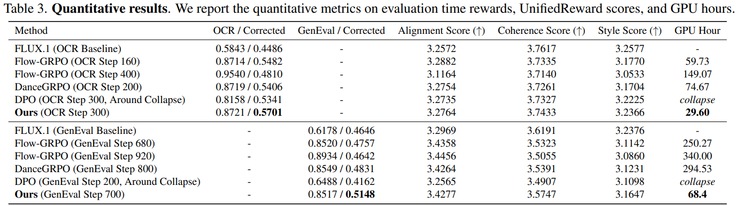

OCR任务表现

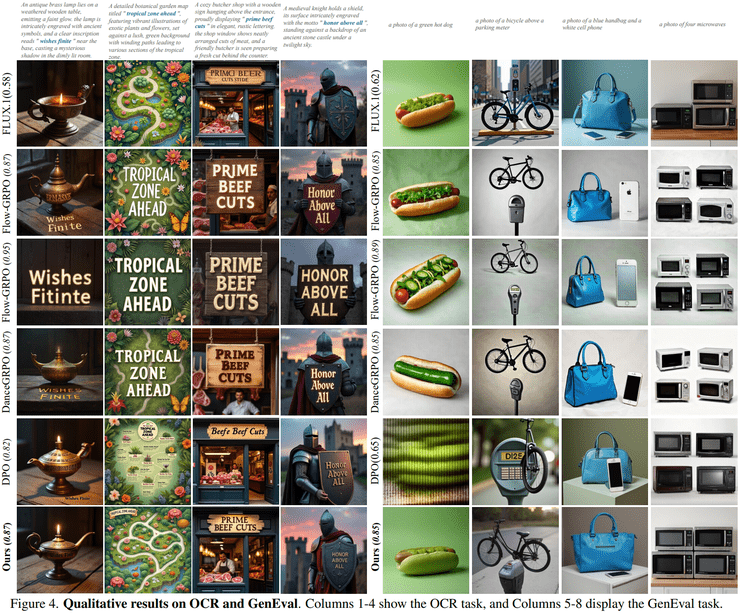

在OCR文字生成任务中,研究人员设置了严格的测试流程。模型需要根据如"一个广告牌,上面写着diamond sale"这样的提示词生成包含特定文字的图像。实验结果显示,原始模型生成的文字经常出现拼写错误、字体模糊、字符缺失等问题。

经过GDRO训练后,生成图片中的文字清晰度显著提升,文字排版更加规范,OCR识别准确率明显提高。更重要的是,GDRO方法在提升文字准确性的同时,保持了图像的整体质量和自然感。

GenEval多对象场景生成

GenEval任务主要评估模型对复杂文本描述的理解能力,包括物体数量、属性、位置关系等多个维度。实验使用了诸如"一张黄色餐桌和一只粉色狗"、"一个笔记本电脑在球下面"等复杂提示词。

结果显示,GDRO训练后的模型在对象数量准确性、属性匹配度和空间关系合理性方面均有显著提升。与基线方法相比,GDRO生成的图像不仅满足了评分要求,还保持了丰富的场景细节和自然的光影效果。

奖励作弊现象的量化分析

研究团队对奖励作弊现象进行了系统量化分析。在OCR任务中,一些传统强化学习方法会采取极端策略,如将文字过度放大或简化背景,从而获得虚假的高分。GDRO方法则有效避免了这种倾向,生成的图像在保持高OCR分数的同时,维持了合理的视觉比例和丰富的背景内容。

在GenEval任务中,GDRO同样表现出色。相比其他方法生成的过于简化的图像,GDRO生成的场景更加完整自然,证明了其在避免奖励作弊方面的有效性。

人工评估验证

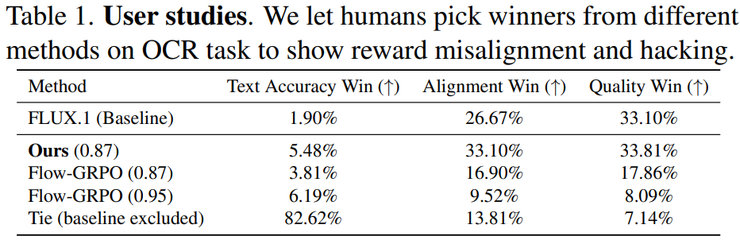

为了补充自动评分系统的局限性,研究团队进行了大规模人工评估实验。21名参与者对不同方法生成的图片进行盲评,从文字准确性、语义匹配度和整体质量三个维度进行比较。

实验结果显示,在文字准确性方面,各种方法差异不大,但在图像质量和语义匹配方面,GDRO生成的图像获得明显更高的评价。这证实了GDRO方法在提升真实质量方面的优势,而不仅仅是优化评分指标。

训练效率对比

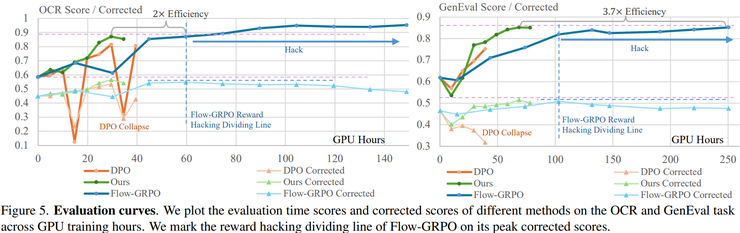

训练效率是GDRO方法的另一大优势。传统强化学习方法需要在线生成图像,每一步训练都涉及完整的扩散采样过程,计算成本高昂。GDRO的离线训练方式大幅减少了计算开销。

实验数据显示,在达到相似性能水平时,GDRO所需的训练时间明显更短,在某些任务中效率提升可达数倍。这种效率优势对于实际应用具有重要意义,使得大规模扩散模型的优化变得更加可行。

技术实现细节

基础模型选择

研究选择FLUX.1-dev作为基础模型,这是一个已经训练好的文本到图像扩散模型。这种选择基于实用性和效率考虑,避免了重新训练完整模型的大量计算投入,将研究重点集中在奖励优化方法本身。

数据集配置

实验使用了两个专门的数据集:OCR任务数据集包含约2万条训练提示词和1000条测试提示词,主要描述包含特定文字的视觉场景;GenEval数据集包含约5万条训练提示词和2000条测试提示词,专注于多对象场景的描述。

训练流程优化

GDRO的训练流程经过精心设计。在数据生成阶段,每个提示词对应生成16张图像并计算奖励评分;在训练阶段,模型利用这些预生成的数据进行优化,避免了重复的图像生成过程。这种设计不仅提高了效率,还增强了训练的稳定性。

方法对比与消融实验

与其他方法的对比

研究将GDRO与Flow-GRPO、Dance GRPO以及DPO等方法进行了系统对比。这些方法代表了不同的优化思路:Flow-GRPO是基于强化学习的在线优化方法,Dance GRPO是另一种强化学习改进方案,DPO则基于偏好优化思想。

对比实验显示,GDRO在性能稳定性和避免奖励作弊方面具有明显优势。特别是在复杂场景生成任务中,GDRO保持了更好的图像质量和语义一致性。

参数敏感性分析

研究团队进行了详细的消融实验,分析了不同参数设置对模型表现的影响。其中,图像组大小的选择尤为关键。实验发现,当组大小过小时(如2),训练过程会出现明显不稳定;当组大小增加到4或6时,训练稳定性显著提高。

这种结果表明,足够的组内样本多样性对于提供稳定的优化信号至关重要。组级比较机制的有效性依赖于足够丰富的排序信息。

实际应用前景

工业界应用价值

GDRO方法在工业界具有广阔的应用前景。其离线训练特性使得企业可以在不显著增加算力投入的情况下,对大规模扩散模型进行后训练优化。这对于需要频繁更新和优化的商业应用场景尤为重要。

在广告设计、内容创作、教育辅助等领域,GDRO方法可以帮助开发更可靠、更可控的图像生成系统,满足特定的业务需求和质量标准。

研究方向的启示

这项研究为扩散模型对齐优化提供了重要启示。首先,它证明了扩散模型同样可以进行有效的奖励对齐,为后续研究奠定了基础。其次,离线训练的策略为降低计算成本提供了可行方案。最后,研究提醒我们需要更加谨慎地设计评价指标,避免奖励作弊现象。

未来发展方向

评价体系的完善

未来的一个重要方向是开发更加全面和鲁棒的评价体系。当前的研究表明,单一的评价指标容易导致模型优化偏差。需要建立多维度、多层次的评价标准,更好地反映生成图像的真实质量。

扩展到其他生成任务

GDRO方法的理念可以扩展到视频生成、3D内容生成等其他生成任务中。这些领域同样面临奖励作弊和评价偏差的挑战,组级优化思路可能提供有效的解决方案。

与人类反馈的结合

将GDRO与人类反馈机制结合是另一个有前景的方向。通过引入人类偏好数据,可以进一步改善模型的对齐效果,生成更符合人类审美和需求的内容。

这项研究不仅提出了解决奖励作弊问题的有效方法,还为生成模型的可控性和可靠性研究开辟了新的路径。随着技术的不断成熟,我们有理由相信,扩散模型将在更多实际场景中发挥重要作用。