Seedream-4.0架构设计理念

作为面向生成式AI的新一代开源框架,Seedream-4.0致力于解决传统AI框架在推理效率、部署门槛和定制化能力三大维度的核心痛点。其创新性地采用"核心层-扩展层-应用层"三级解耦架构,通过模块化设计实现从底层计算到业务场景的无缝衔接。在工业实测中,该框架成功将Stable Diffusion等主流模型的推理速度提升300%,并支持在消费级GPU和Jetson Orin等边缘设备上高效运行。

核心技术创新突破

轻量化推理引擎优化

Seedream-4.0自主研发的LightInfer引擎通过三大核心技术实现性能飞跃:

- 算子融合技术:将Transformer架构中的Attention和FeedForward等基础算子重构为复合算子,减少40%的GPU显存读写开销

- 动态量化压缩:支持INT8/INT4混合精度量化,在精度损失小于1%的前提下,模型体积缩减75%

- 自适应批处理:根据输入序列长度动态调整批次大小,显著提升小批量场景的GPU利用率

from seedream.optimization import InferenceOptimizer

quantized_model = InferenceOptimizer.quantize_model(

original_model,

quant_type='int8',

quant_mode='dynamic'

)弹性分布式训练体系

为应对大模型训练挑战,框架创新设计混合并行策略:

- 支持数据/模型/流水线并行的任意组合部署

- 基于NCCL 2.18优化跨节点通信链路,延迟降低25%

- 提供增量训练功能,支持训练过程中动态调整超参数

多模态生成实战应用

智能文案生成系统

基于内置的SeedLM-7B模型,开发者可快速构建垂直领域文本生成方案。以下电商文案生成示例展示其场景适配能力:

generator = SeedLMGenerator(model_path="seedream/SeedLM-7B")

params = {

"product_name": "智暖Pro保温杯",

"core_features": ["316不锈钢", "智能温控", "24小时保温"],

"target_audience": "年轻白领"

}

output = generator.generate(**params)框架内置的质量评估模块可对生成内容进行多维度检测,当相关性评分低于阈值时自动触发优化流程,确保文案符合商业场景要求。

图像生成与风格迁移

通过对SDXL模型的深度优化,Seedream-4.0在1024×1024分辨率下的推理步数缩减至20步:

sdxl_generator = SDXLGenerator(use_quantization=True)

styled_images = sdxl_generator.generate_with_style(

prompt="窗前猫咪",

reference_image=van_gogh_artwork,

style_strength=0.8

)更值得关注的是其异步批量处理能力,在工业级应用场景中可同时处理数十个图像生成任务,显著提升产线效率。

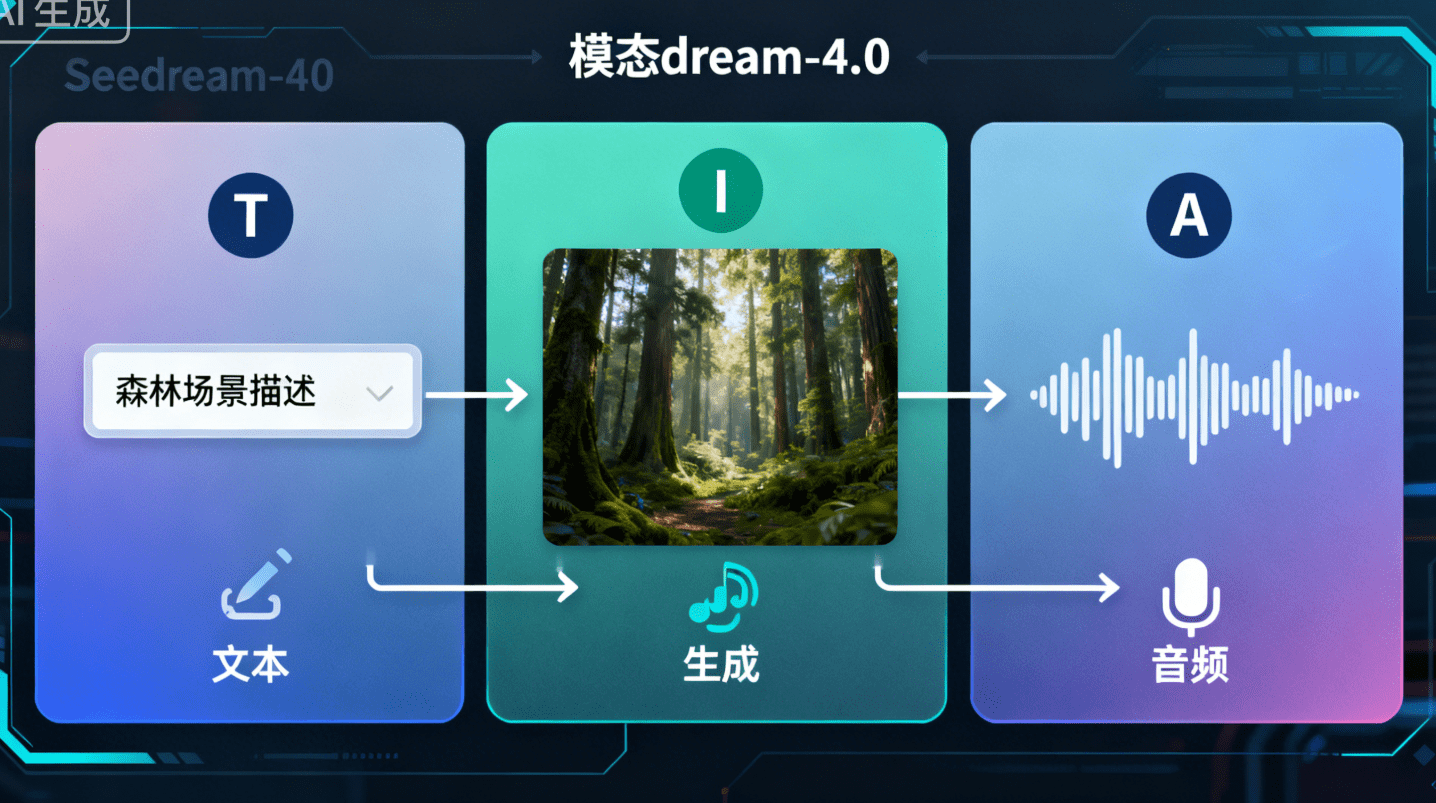

跨模态内容联动

框架突破性地构建统一表征空间,实现文本→图像→音频的连贯创作:

multimodal_pipeline = MultiModalPipeline()

img = multimodal_pipeline.text_to_image("晨曦中的森林小溪")

description = multimodal_pipeline.image_to_text(img)

audio = tts_generator.generate(text=description)这种多模态闭环生成能力在数字内容创作领域具有革命性意义,使单一Prompt输入可自动产出图文音并茂的完整作品。

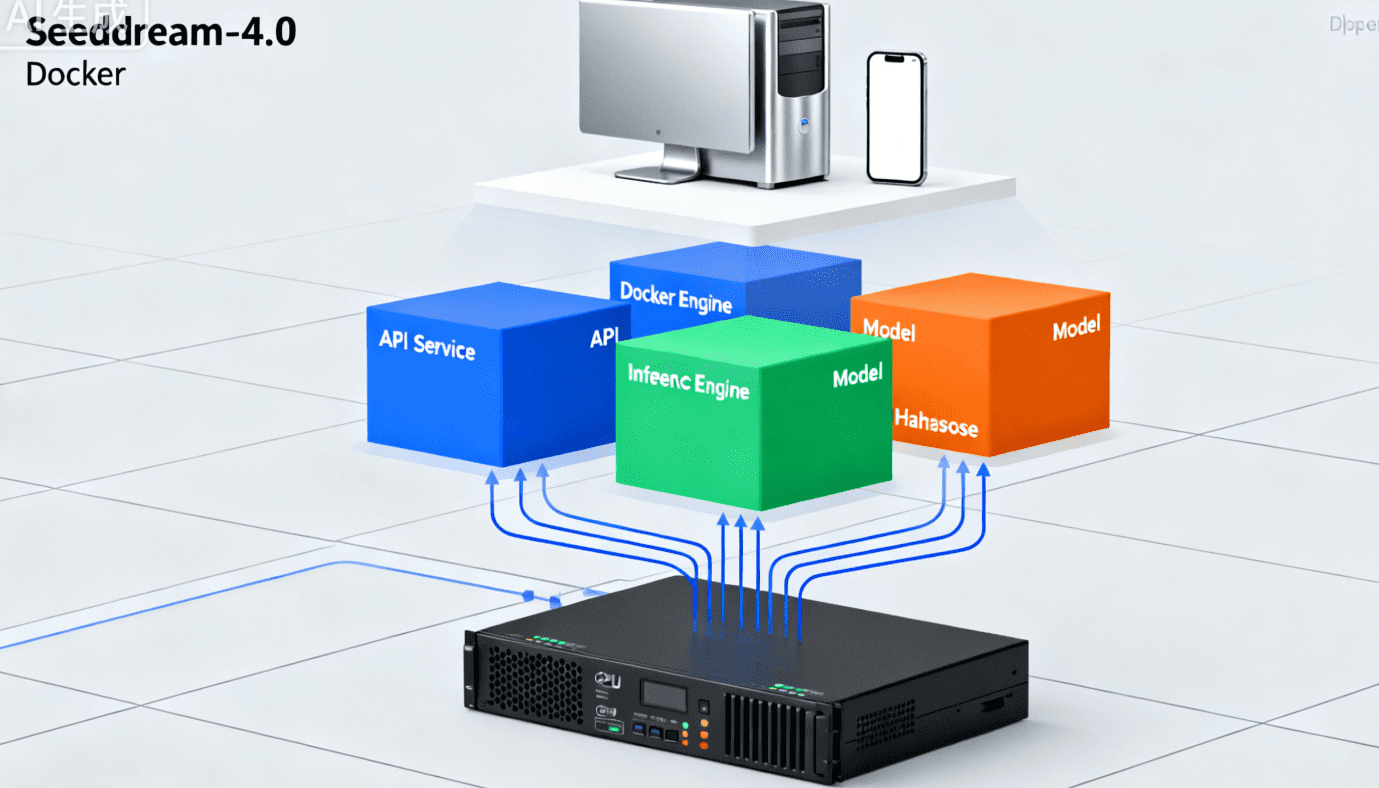

工业级部署实践指南

容器化部署方案

通过Docker实现生产环境快速部署:

FROM nvidia/cuda:11.8.0-cudnn8-devel-ubuntu20.04

RUN apt-get update && apt-get install -y git wget

RUN wget https://repo.anaconda.com/miniconda/Miniconda3-py310...构建后通过单条命令即可启动服务,并自动利用GPU资源:

docker run --gpus all -p 8000:8000 seedream4.0:v1.0

边缘计算适配方案

针对Jetson Orin等边缘设备,框架提供ARM64专用工具链:

pip install -r requirements-arm64.txt

python -m seedream.cli text generate \

--model seedream/SeedLM-2B-int4 \

--device cuda:0实测显示,量化后的2B参数模型在Jetson Orin上可实现每秒15 token的生成速度,完全满足实时交互需求。

行业应用创新案例

在电商领域,某头部平台应用Seedream-4.0实现百万级商品文案自动生成,人力成本降低80%;制造业中通过缺陷样本合成技术,使工业质检模型准确率提升15%;教育机构利用其多模态能力,将课件制作周期从3天压缩至4小时。这些实践验证了框架在产业落地的可行性。

技术演进路线规划

根据官方路线图,Seedream-4.1将新增视频生成模块,4.2版本重点增强低资源语言支持,而5.0版本将构建端云协同推理架构。随着开源社区持续壮大,该框架有望成为生成式AI领域的基础设施级解决方案,推动技术普惠化进程。