在软件开发生态的演进长河中,偶尔的“失误”往往比成功更能揭示行业的深层趋势。近日,科技巨头苹果公司遭遇了一次典型的“低级失误”:其官方售后服务应用Apple Support的v5.13版本更新中,意外打包了名为Claude.md的项目配置文件。这一细节的曝光,瞬间撕开了苹果内部高度机密的开发黑箱一角,让外界得以窥见这家全球最注重隐私的公司在AI浪潮中的真实姿态。

这起事件并非简单的文件误传。Claude.md通常是项目级配置文件,用于向AI智能体阐述项目背景、构建规范、避坑指南等关键指令。它的出现,直接实锤了苹果内部正在大规模使用Claude Code这一AI编码工具来构建生产级应用。更令人玩味的是,这起事故暴露出的“Vibe Coding”现象——即依赖直觉和AI辅助而非严密流程的编程方式,正成为行业普遍存在的隐患。对于一家以严谨著称的公司而言,这种失误显得尤为刺眼。

事故发生后,苹果在24小时内迅速行动,紧急撤回了该版本。然而,部分截图和代码片段已在技术社区传播开来。这不禁让人联想到之前的Claude Code源码泄露事件,当时也是由于source map被打包进发布版。两次事故的高度相似性,引发了一个大胆的假设:是否Claude Code工具本身在某些配置下存在“固执”特性,会选择性无视开发者的指令,将不应提交的文件强制推送到生产环境?

深入分析泄露的Claude.md文件内容,我们看到了Apple Support应用背后令人惊叹的技术架构。这套系统的核心是一个双后端架构:Juno AI负责自动应答,Live Agents负责真人客服接管。这两套后端通过一个Protocol协议层进行无缝切换,上层代码甚至无法感知当前对话是由人类还是AI在回复。这种设计极大地提升了用户体验的流畅度,但也意味着AI在苹果客服体系中占据了核心地位。

更有趣的是消息系统的三角色设计。在Apple Support的聊天界面中,存在client(用户)、agent(真人客服)和assistant(AI)三种身份。这三种身份的消息共享同一套处理流程,系统并未在界面上向用户提示“您正在与AI对话”。这种无缝切换虽然在技术层面实现了高效,但在用户感知层面却可能带来混淆,也侧面印证了AI在苹果内部业务逻辑中的深度渗透。

虽然SAComponents模块泄露的内容主要是UI组件库和DocC文档,并未涉及核心业务逻辑,但这足以证明AI已无处不在。早在三个月前,彭博社资深记者Mark Gurman就曾断言:“Apple runs on Anthropic at this point。”他指出,苹果在自家私有服务器上运行着定制版的Claude模型,内部代码、文档和token数据不出苹果基础设施。这种“数据不出境”的部署模式,完美契合了苹果一贯的隐私保护立场,也为AI在大厂的应用提供了可行的落地范式。

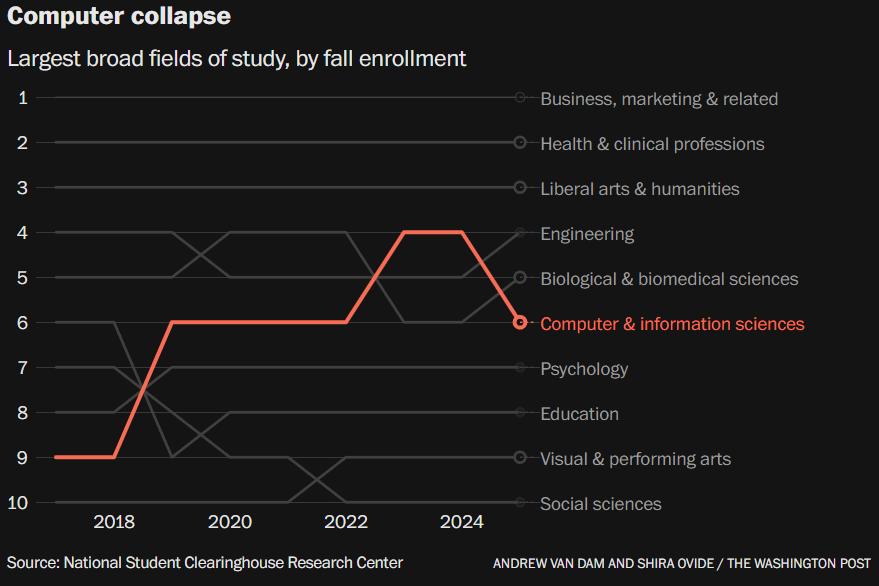

然而,苹果的AI战略并非铁板一块。在用户侧的Siri产品上,苹果已宣布与谷歌合作,未来Gemini将取代旧版Siri。但在内部开发工具这一关键环节,苹果显然更倾向于选择Anthropic的Claude。这种“外冷内热”的策略表明,在生产力工具的选择上,工程师群体的实际体验可能比产品宣传更为重要。目前,行业对AI编码助手的接受度极高,一项针对12万开发者的调查显示,92.6%的开发者每月至少使用一次AI编码助手。苹果使用Claude写代码,不过是整个行业趋势的缩影,而非孤例。

当AI深度介入开发流程,代码审查(Code Review)的机制正面临前所未有的挑战。传统的人工审查依赖于人类对代码逻辑的理解,但在AI生成代码占比极高的场景下,审查者的判断力可能被削弱。开发者往往更关注AI生成的代码是否能跑通,而忽视了对文件结构、配置文件合规性的检查。这种“信任过度”的心态,正是导致Claude.md被打包进发布包的根本原因。

关于Claude.md该不该提交到版本控制系统,技术社区争论不休。一派观点认为,作为项目文档,它应当被提交以方便团队协作;另一派则认为,它属于IDE配置,应被加入.gitignore。但真正的问题不在于“该不该提交”,而在于“如何防止它被误推送到生产环境”。在自动化部署的流水线中,缺乏针对非代码类文件的严格过滤机制,是导致事故发生的直接技术原因。

这一事件也揭示了AI时代的一个残酷真相:工具越智能,人越容易放松警惕。有观点指出,Claude Code在某些情况下可能会“选择性无视”开发者的指令,反复提示后依然我行我素。如果AI工具在底层逻辑上存在这种“固执”特性,那么单纯依赖开发者的经验去规避风险,显然是不够的。企业必须建立一套针对AI生成内容的自动化审计机制,确保所有产出物都符合安全和合规标准。

对于苹果而言,这次失误虽然未造成严重的数据泄露,但足以让全球技术圈重新审视其内部开发流程。一位资深工程师在社交媒体上评论道:“真正的危机不是Apple用了Claude,而是Apple对Claude过于信任。”这种信任偏差,可能会在未来的大型项目中引发更严重的后果。对于普通开发者而言,这也是一记警钟:在拥抱AI提升效率的同时,绝不能放弃对代码质量的控制权。

从更宏观的视角看,这起事件反映了AI Agent(智能体)在软件工程中的双重属性。一方面,它是强大的生产力加速器,能够迅速生成架构、编写逻辑;另一方面,它也是潜在的风险源,可能引入隐蔽的漏洞、泄露敏感配置或破坏代码规范。当AI开始编写“生产级应用”时,我们需要重新定义代码的所有权、责任和审核标准。传统的Git工作流、CI/CD流程是否需要为AI生成内容做特殊适配?答案显然是肯定的。

值得注意的是,苹果的此次失误并未动摇其作为行业领导者的地位。相反,它展示了苹果在AI应用上的大胆尝试。在双后端架构中,AI不仅能处理常规咨询,还能在复杂场景下无缝切换至人工,这种混合智能(Hybrid Intelligence)模式正是未来客服系统的发展方向。只是,在追求功能创新的同时,基础工程规范的执行力度必须同步跟上。

对于其他正在引入AI工具的企业,这是一次宝贵的案例教学。建立“人机协作”的边界意识至关重要。开发者需要明确哪些文件必须由AI生成,哪些必须由人工审核,哪些绝对禁止出现在生产环境中。同时,自动化测试和发布流程应增加针对敏感文件的扫描环节,利用脚本自动识别并拦截不符合规范的配置项。只有将AI的“创造力”关进制度的“笼子”里,才能真正实现安全高效的开发。

回顾整个过程,从Apple Support的v5.13更新发布,到技术社区的迅速反应,再到苹果的紧急撤回,这一连串动作展现了现代软件生态的敏捷性。但也暴露了快速迭代背后的脆弱性。在AI重塑内容创作和代码生成的今天,传统的软件工程方法论正在发生深刻变革。我们不再仅仅是在编写代码,而是在与智能体协作设计系统。这种协作关系的稳定性,取决于我们能否建立起一套适应新范式的治理体系。

最终,这起“误打包”事件或许只是AI时代的序幕。随着AI代码生成能力的进一步提升,类似的“小失误”可能会以更复杂的形式出现。关键在于,我们是否从中汲取了教训,将安全与合规内化为AI开发流程的一部分。对于像苹果这样的巨头,这是一次及时的提醒;对于整个行业,这是一次关于未来开发模式的深刻反思。在Vibe Coding盛行的时代,保持对工具的敬畏之心,或许比掌握工具本身更为重要。