互联网 PM2.5:一场被量化的信息污染

如果将互联网上的信息污染比作空气质量,那么当下的 PM2.5 指数恐怕早已突破天际。这并非危言耸听,而是一种可以被量化、被观测到的现实危机。早在 2011 年,这种苗头就已初现端倪。当时,一家名为 Demand Media 的内容公司在纽交所敲钟上市,其市值甚至一度超越了包括纽约时报在内的众多传统媒体巨头。

这家公司的核心业务极其简单粗暴:针对搜索引擎的算法偏好,批量生产毫无营养的“信息罐头”。它们并不关心内容的深度、准确性或社会价值,唯一的目标是博取庞大的搜索流量,再通过页面内的展示广告将流量变现。在其巅峰时期,Demand Media 雇佣了上万名众包写手,平均每天能够产出超过 5000 篇文章。这些文章如同工业流水线上的标准件,唯一的区别可能就是关键词的排列组合。

当年有媒体曾称赞这种模式符合现代人“短平快”的消费习惯,但 Demand Media 内部的一名作者却道出了真相:“我 15 分钟就能给你写出一坨文章,大多数时候不用修改就能发布。我为助长这种低劣内容污染互联网而感到愧疚。”这种工业化生产的低质内容,迅速引发了搜索引擎的警惕,各大平台开始迭代算法,试图从搜索结果中剔除这些垃圾信息。

然而,当人类还在为如何清理上一代内容农场的残骸而疲于奔命时,2026 年的新晋内容农场已经给出了令旧模式相形见绌的“进化”答案。

荒诞的工业化:从文本到视频的全面降维

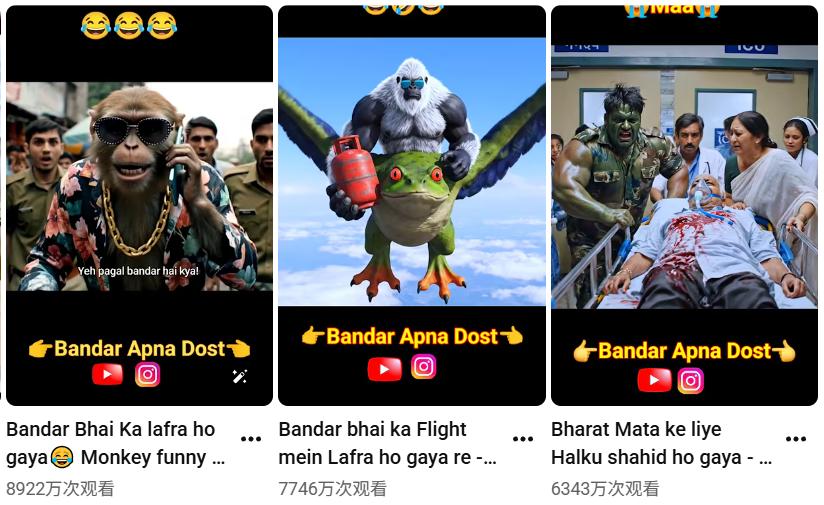

现在的 AI 内容农场,已经不再局限于文字领域,而是全面向视频内容渗透,且效率呈指数级增长。在 YouTube 平台上,一个名为"Bandar Apna Dost"的频道成为了这一现象的典型代表。

该频道的视频每期时长仅在一分钟左右,内容完全由 AI 生成,质量堪称“灾难级”。例如,有一期视频讲述了一只穿着西装的猴子站在飞机上,因空姐禁止其登机而愤怒飞出,随后一只猩猩带着青蛙鸟将飞机炸毁。剧情逻辑断裂,画面粗糙,配音敷衍,字幕混乱,但如此空洞无物的内容,却收获了千万级别的播放量。

另一期视频则描绘了一只穿黄西装的猴子因违停被警察警告,紧接着另一群“骑兵猴子”冲过来救场的荒诞场景。这些视频没有剧本的连贯性,没有剧情的起承转合,甚至没有基本的物理常识,但它们却拥有惊人的商业价值。该频道凭借此类内容,积累了超过 300 万粉丝,其流量表现甚至吊打绝大多数传统自媒体人。

这种模式在 YouTube 上并非孤例。AI Nusrat 频道用 AI 生成“坏人受罚、好人捡金”的无脑故事;面向儿童的"Pouty Frenchie"频道则用 AI 制作小狗去超市买拖鞋的动画——剧情仅仅是小狗挑中两双拖鞋带回家与主人穿着跳舞。这些内容毫无信息增量,纯粹是为了迎合算法的推荐机制和用户的碎片化娱乐需求。

根据 Kapwing 的报告,2025 年 YouTube 上超过 20% 的推荐内容均为低质 AI 生成。全球范围内,至少存在 278 个类似的频道,累计播放量超过 630 亿次。其中,西班牙和韩国的热门 AI 恶搞频道更是位居全球订阅量和播放量的榜首。这背后隐藏的是一个庞大的黑色产业链,以及被算法和贪婪共同编织的暴利逻辑。

暴利驱动:数据背后的流量收割逻辑

海量的信息垃圾,之所以能够源源不断地生产,其根本动力在于背后巨大的经济利益。Kapwing 评估显示,前述的"Bandar Apna Dost"频道,每年仅靠广告收益就能达到 425.15 万美元。这一数字对于许多依靠高质量内容生存的创作者来说,是不可想象的。

很多人对此感到困惑:这些内容到底是谁在看?答案其实藏在我们的日常生活场景中。在国内的视频平台上,这类内容的受众同样庞大且精准。

老年群体偏爱 AI 生成的“萌娃”视频,从中获得情感慰藉;中年群体沉迷于 AI 制作的“情感短剧”,填补内心的空虚;年轻群体则对 AI 猫狗短剧和“山海经”猎奇内容趋之若鹜。这些需求本身并无过错,但当内容农场发现这些朴素的情绪可以被 AI 量产、被算法精准推流、被流水线反复收割时,它们就变成了一座可以被工业化开采的金矿。

这种模式下,内容生产的成本被压缩到极低,几行提示词、几分钟的渲染时间,就能生成成千上万条视频。而一旦某条视频被算法选中,其带来的流量收益将远超成本。于是,为了追求更高的利润,部分内容农场开始转向更具煽动性、更吸睛的领域。

恶意竞争与谣言工厂:内容农场的极端进化

当低质娱乐内容被认为“来钱慢”时,内容农场的进化方向便转向了更具破坏性的领域——恶意制造谣言和负面信息。

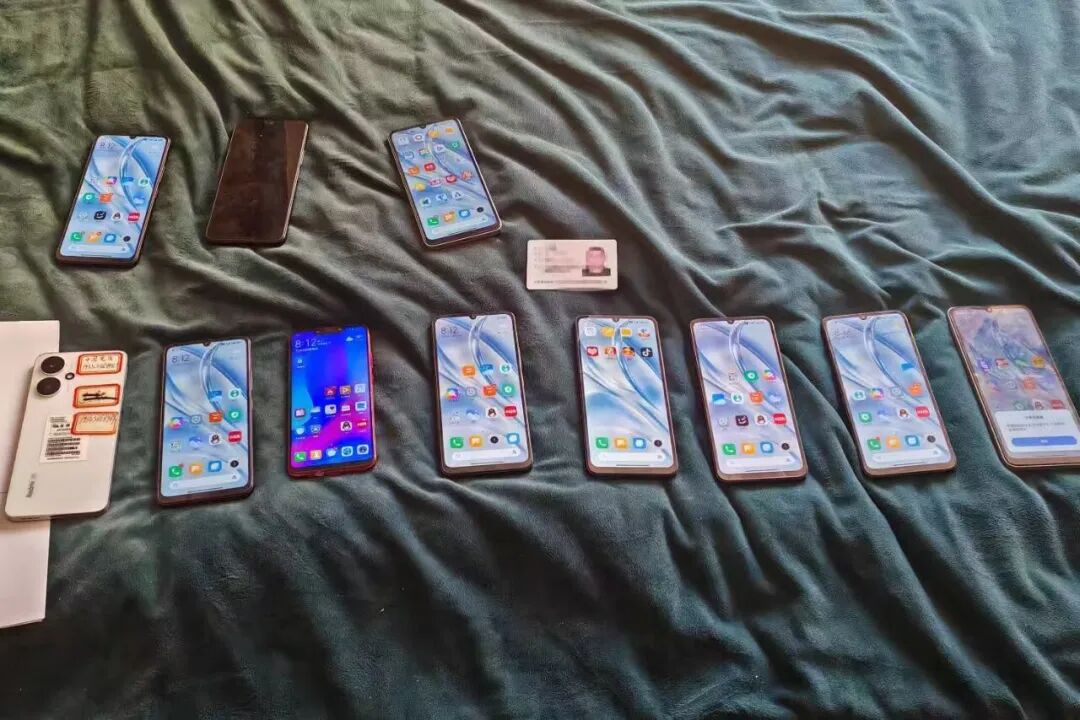

近年来,新能源汽车行业成为了重灾区。山东警方曾破获一起特大网络水军案件,犯罪团伙在极短时间内集中发布大量针对车企的负面信息,如“M9 交付遥遥无期”、“雷军摊上大事了”等。这些文章最初被车企误认为是同行恶意竞争或敲诈勒索,但警方调查后却发现,幕后推手依然是内容农场。

其中一个犯罪团伙仅有 12 人,却通过 30 多个 MCN 账号控制了下层 8000 多个个人账号。他们每天在互联网上发布大量未经核实的负面消息,短短时间内获利一百多万。另一组被嘉定警方抓获的团伙,虽然发布了 70 多万篇次不实文章,但因操作不精,仅获利 8 万元,甚至不如去工厂打螺丝赚得多。

这种模式不仅限于国内。在日本,有人专门利用 AI 批量生产恶意丑化中国人的视频,捏造“破坏樱花”、“抢老人拐杖”等虚假故事。制作人在接受采访时直言,捏造中国人坏话的千次播放广告收益是正常内容的三倍以上。这种为了流量不惜歪曲事实、制造对立的行径,实质上将互联网变成了充满恶意的角斗场。

当成千上万个“人”在网络上重复同一个谎言时,理性的判断便变得异常困难。这些有害信息不仅浪费了公众的时间,更在潜移默化中扭曲了大众的认知,污染了社会的信任基石。

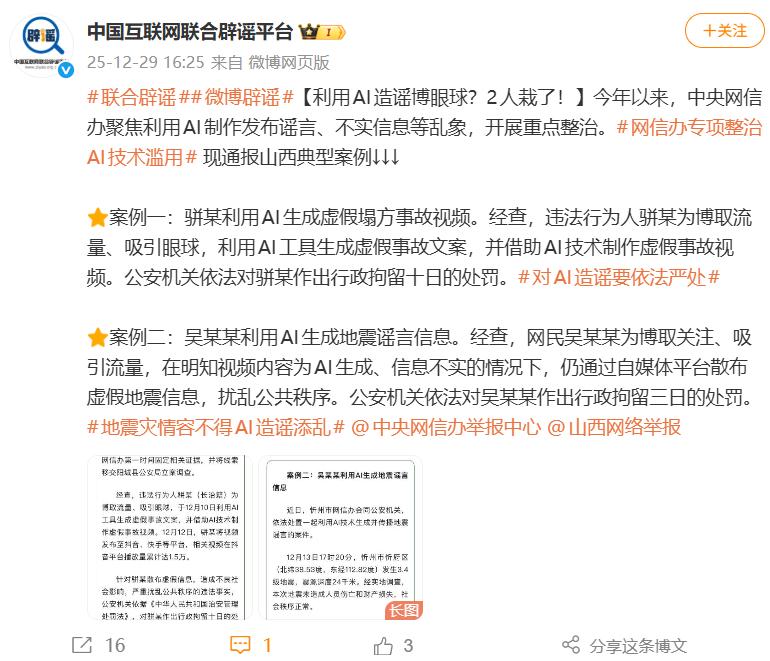

类似的新闻每天都在上演:“山西晋城隧道塌了”、“重庆南岸立交桥塌了”、“国际巨星猝了”、“女星私房照流出”。每段谣言背后,都有 AI 生成的“真凭实据”视频,往往只有短短 10 秒。因为目前免费生成 5-10 秒的 AI 视频非常容易,这种低成本、高传播的特性,使得谣言的制造成本几乎为零。

治理困境:人类效率无法对抗算法洪流

面对信息垃圾的泛滥,各大平台并非坐视不管。从微信、抖音到小红书,主流平台近年来陆续出台了多项关于 AI 生成内容的治理公告,试图从技术和管理层面进行干预。

然而,这场治理之战注定艰难。生产一篇高质量的内容,需要人类进行信息检索、交叉验证、观点提炼、反复打磨,最终确认,整个过程耗时耗力。而生产一吨信息垃圾,只需要几行提示词和几分钟的自动渲染。人类在产出效率上,根本无法与 AI 相比。

互联网原本是人类知识的仓库,如今却像一座 24 小时不停倾倒垃圾的新型废品站。普通用户被迫在“屎里淘金”,在海量真假难辨的信息中艰难寻找真相。这种环境不仅降低了信息的获取效率,更在长期侵蚀着社会的认知能力。

更令人担忧的是,信息垃圾正在从虚拟空间渗出现实生活。GPT-Image 2 等生成式 AI 面世后,伪造的图片和视频愈发逼真。网友出于恶搞目的制作的“库克入职小米”、“余承东与雷军互殴”等梗图,虽未造成严重后果,但西山居“解散”的伪造快讯截图,却曾一度引起金山软件股价的波动。

虎扑的 AI 翻译翻车、地铁电梯广告中人物出现“六指”、“180 度旋转”等诡异细节,都暗示着 AI 生成内容正在以不可控的速度渗透进我们的物理世界。这种粗糙、不真实、充满错误细节的视觉冲击,正在悄悄改变我们对现实的感知。

结语:在数字垃圾中重建认知防线

单看每一件低质内容或谣言,或许都算不上什么大麻烦。但当它们以工业化的规模堆叠在一起,形成一种持续的、低烈度的精神污染时,其危害便不容小觑。这不仅是对用户注意力的掠夺,更是对社会信任体系和认知逻辑的长期侵蚀。

未来的数字鸿沟,或许不再表现为“谁能上网”或“谁拥有设备”,而在于“谁能保持好奇、探索与思辨的能力”。在信息垃圾山遍地开花的时代,真正的核心竞争力,是能够从混乱的算法推荐和虚假的信息洪流中,精准地剥离出真实、有价值的内容。

面对 AI 内容农场的野蛮生长,单纯的技术治理或法律惩戒或许难以根治。我们需要构建一种全新的信息素养,一种能够识别 AI 生成内容、质疑算法推荐、坚持独立判断的思维能力。唯有如此,我们才能在算法编织的迷宫中,找回人类作为信息主体的尊严与自由,让互联网重新成为人类智慧的结晶,而非垃圾的堆场。

这场关于“真”与“伪”的较量,才刚刚开始。