深度学习技术在计算机视觉领域的快速发展,使得神经网络模型在自动驾驶、智能安防、医疗影像分析等关键场景中得到广泛应用。然而,这些高性能模型在安全性方面存在明显隐患,其中对抗样本问题被认为是深度学习系统面临的重要安全挑战。

对抗样本的安全威胁

在实际应用中,对抗样本可能带来严重的安全风险。例如,在自动驾驶系统中,通过在交通标志图像上加入微小扰动,系统可能将"限速标志"误判为"停止标志";在人脸识别系统中,细微噪声就可能导致模型将一个人误识别为另一个人。这些微小的输入变化却能导致模型产生完全错误的预测,揭示了深度神经网络在决策边界上的脆弱性。

迁移攻击作为对抗攻击的重要分支,在现实场景中更具威胁性。这类攻击不需要访问目标模型的结构、参数或梯度信息,而是通过可访问的代理模型生成对抗样本,再利用这些样本攻击其他未知模型。由于实际部署的模型通常处于黑盒环境,迁移攻击的研究具有重要意义。

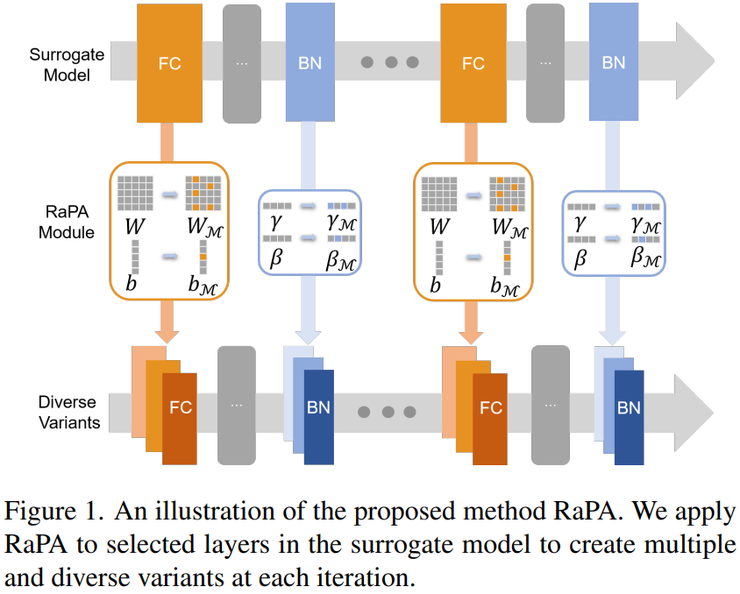

RaPA方法的核心创新

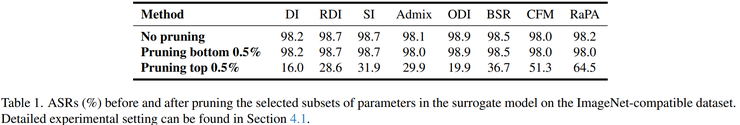

RaPA方法的核心创新在于引入了随机参数剪枝策略。研究发现,现有迁移攻击方法生成的对抗样本往往过度依赖代理模型中的少量关键参数,从而限制了攻击在不同模型之间的泛化能力。

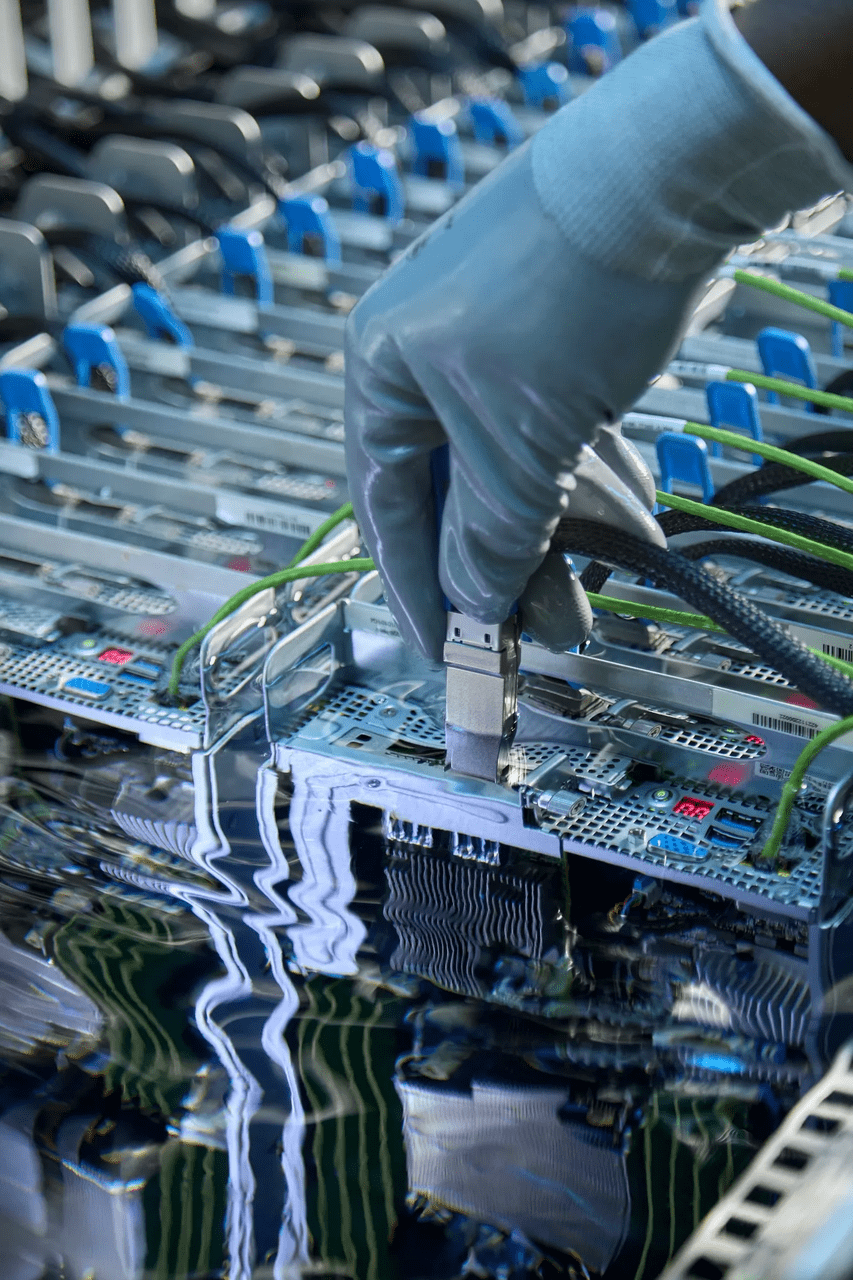

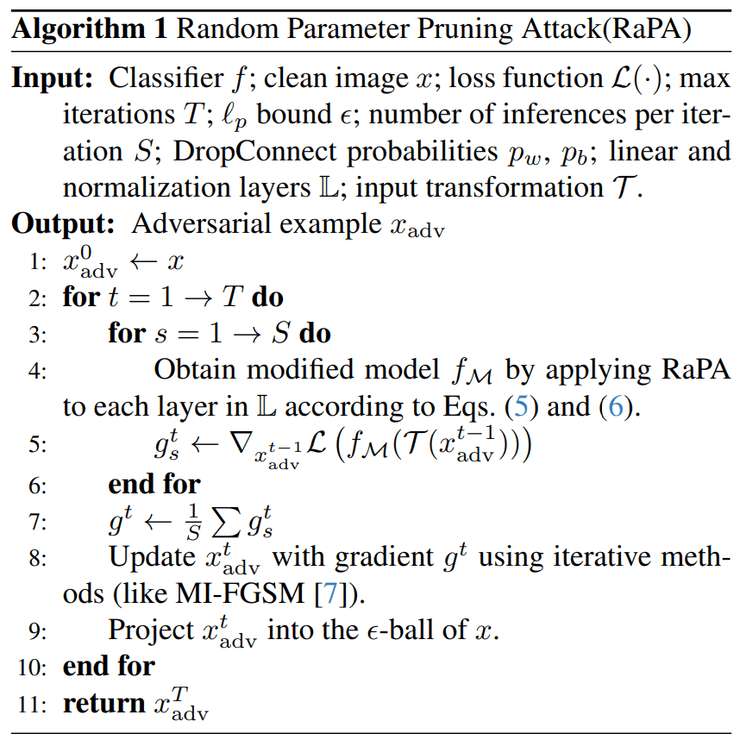

具体实现上,RaPA在攻击过程中随机选择一部分模型参数并将其暂时关闭,主要包括全连接层参数以及归一化层参数。通过这种方式,原始模型在每一次迭代中都会产生新的模型版本。在同一次迭代中生成多个不同的随机剪枝模型,利用这些不同模型分别计算攻击所需的梯度信息,然后将所有模型得到的梯度进行平均处理,最终根据平均梯度对图像进行更新。

实验验证与性能分析

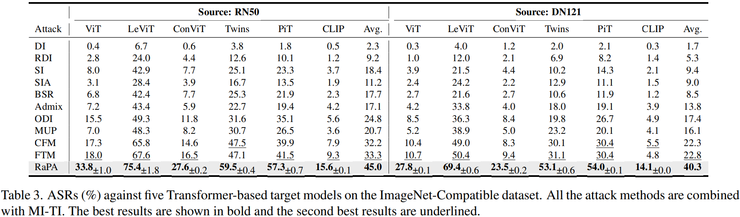

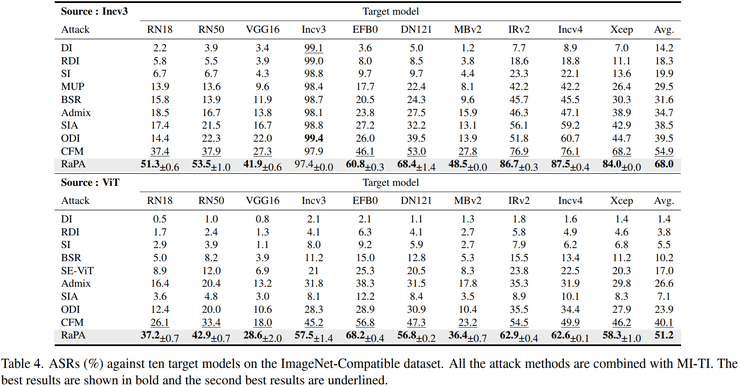

在ImageNet兼容数据集上的实验表明,RaPA在多数模型组合中的攻击成功率均达到最高或接近最高。特别是在跨模型结构攻击任务中,RaPA的优势更加明显。

当使用ResNet50作为攻击模型时,平均攻击成功率提升约11.7%;使用DenseNet121作为攻击模型时,平均攻击成功率提升约17.5%。在Transformer模型生成攻击样本并攻击卷积神经网络模型的场景中,RaPA的平均攻击成功率达到约51%,明显高于所有对比方法。

防御机制下的表现

研究人员在多种防御机制存在的情况下测试了RaPA的攻击效果,包括对抗训练模型、JPEG压缩防御、随机化防御、图像降噪防御以及扩散模型防御。实验结果表明,在所有防御条件下RaPA的攻击成功率仍然最高。

在对抗训练模型上,RaPA的攻击成功率约为88%,明显高于其他攻击方法。这表明随机剪枝策略生成的对抗样本具有更强的鲁棒性,能够突破多种防御机制的防护。

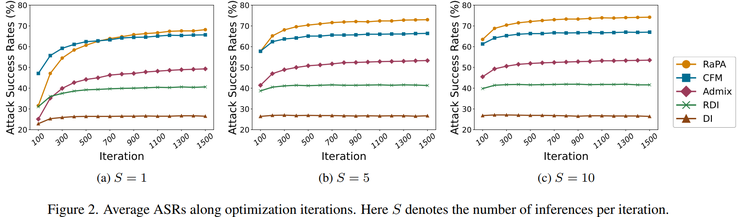

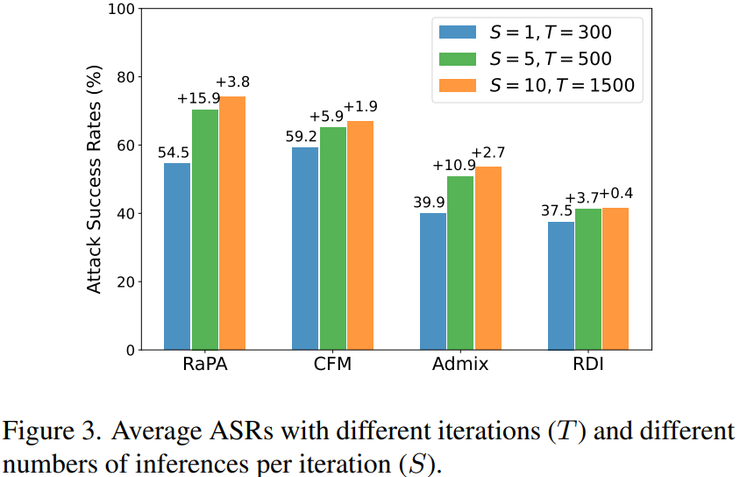

计算资源与性能关系

研究还探讨了计算资源变化对攻击效果的影响。通过增加攻击迭代次数以及增加每轮计算次数进行实验,结果显示当计算量增加时,其他攻击方法的性能提升幅度较小,而RaPA的性能提升最为明显。

在使用ResNet50的情况下,攻击成功率可以额外提升约15.9%。这些结果表明,在更多计算资源支持下,RaPA的攻击效果能够得到进一步增强,这为实际应用中的资源分配提供了参考。

方法的技术优势

RaPA方法的一个重要优势在于其实现相对简单。整个方法不需要重新训练模型,也不需要额外的数据,只需要在攻击过程中随机屏蔽一部分模型参数即可完成。这种简洁性使得方法易于在实际场景中部署和应用。

此外,RaPA能够与多种已有攻击技术进行结合使用,例如Admix、CFM以及各种输入变换方法。在这些方法的基础上引入随机参数剪枝策略,可以进一步增强攻击样本的迁移能力,从而获得更好的攻击效果。

实际应用意义

这项研究对深度学习的实际应用具有重要指导意义。首先,它揭示了当前深度学习模型在安全性方面的脆弱性,提醒开发者在部署模型时需要充分考虑对抗攻击的风险。其次,RaPA方法为模型安全性评估提供了新的工具,可以帮助开发者更好地测试和加固模型。

在自动驾驶、医疗诊断等安全关键领域,对抗样本攻击可能带来严重后果。因此,开发有效的防御方法和评估工具至关重要。RaPA不仅作为一种攻击方法,更重要的是它提供了一种评估模型鲁棒性的新视角。

未来研究方向

基于RaPA的研究成果,未来可以在以下几个方向继续深入探索。首先,可以研究如何将随机剪枝策略与其他攻击技术更有效地结合,进一步提升攻击效率。其次,需要开发针对这类攻击的有效防御方法,确保模型在实际应用中的安全性。

此外,随着大模型时代的到来,研究对抗样本在大规模模型上的表现也具有重要意义。大模型通常具有更多的参数和更复杂的结构,这可能为对抗攻击带来新的挑战和机遇。

方法的技术细节

在具体实现层面,RaPA方法涉及多个关键技术点。参数剪枝的比例需要仔细调整,过高的剪枝比例可能导致模型性能严重下降,而过低的剪枝比例则无法达到预期的泛化效果。研究人员通过实验确定了最优的剪枝比例范围。

梯度计算过程中的平均策略也值得关注。不同模型产生的梯度可能存在较大差异,如何合理地平均这些梯度对最终效果有重要影响。研究采用了加权平均策略,根据模型在剪枝后的性能表现调整权重。

与其他方法的对比

与传统的迁移攻击方法相比,RaPA在多个方面表现出独特优势。输入变换类方法主要通过改变输入图像的形式来增强攻击效果,但可能无法有效应对模型结构差异。梯度优化类方法改进了梯度计算过程,但仍然依赖于固定的模型参数。

特征混合类方法通过混合不同图像或特征来增强攻击样本的迁移能力,但需要额外的数据处理步骤。模型集成类方法通过构造多个模型并进行集成来提升攻击效果,但计算成本较高。RaPA在保持较低计算成本的同时,实现了更好的攻击效果。

对AI安全领域的启示

这项研究对AI安全领域的发展具有重要启示。首先,它表明模型的结构特性对对抗样本的迁移能力有显著影响,这为理解模型决策机制提供了新视角。其次,随机化策略在提升方法泛化能力方面显示出巨大潜力,这可能启发其他安全研究方向。

随着AI技术在各个领域的深入应用,安全性问题将变得越来越重要。RaPA研究不仅提供了新的攻击方法,更重要的是推动了整个领域对模型安全性的重视和认识。

这项研究展示了在深度学习安全领域持续创新的重要性。随着技术的不断发展,安全威胁也在不断演变,需要研究者不断开发新的方法和工具来应对这些挑战。RaPA作为一个创新的攻击策略,为未来更安全的AI系统设计提供了有价值的参考。