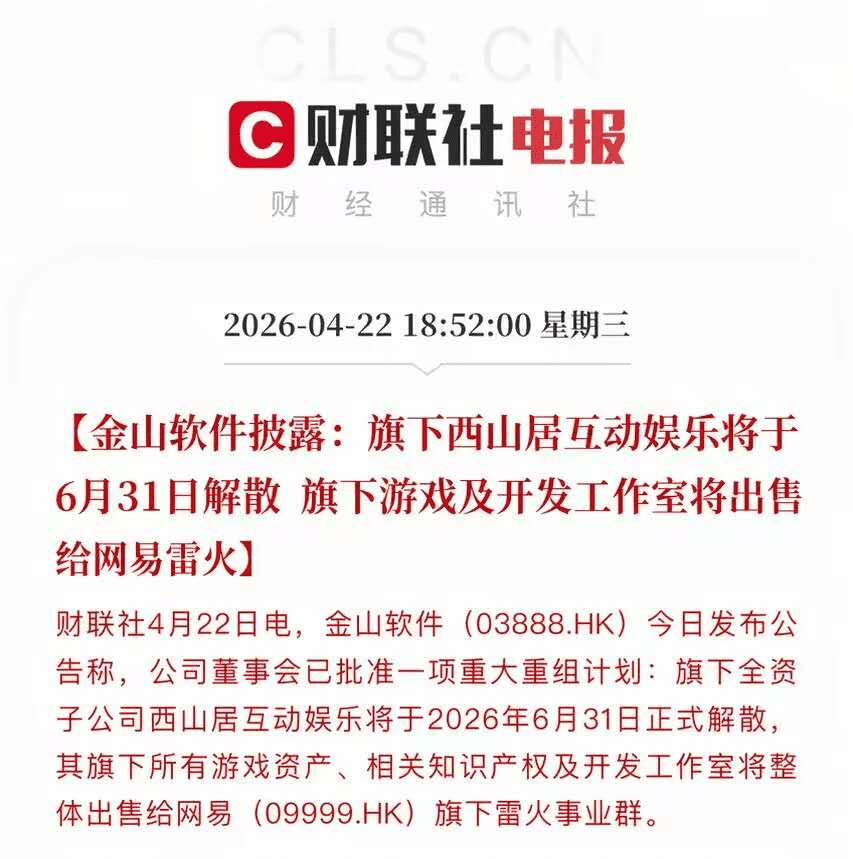

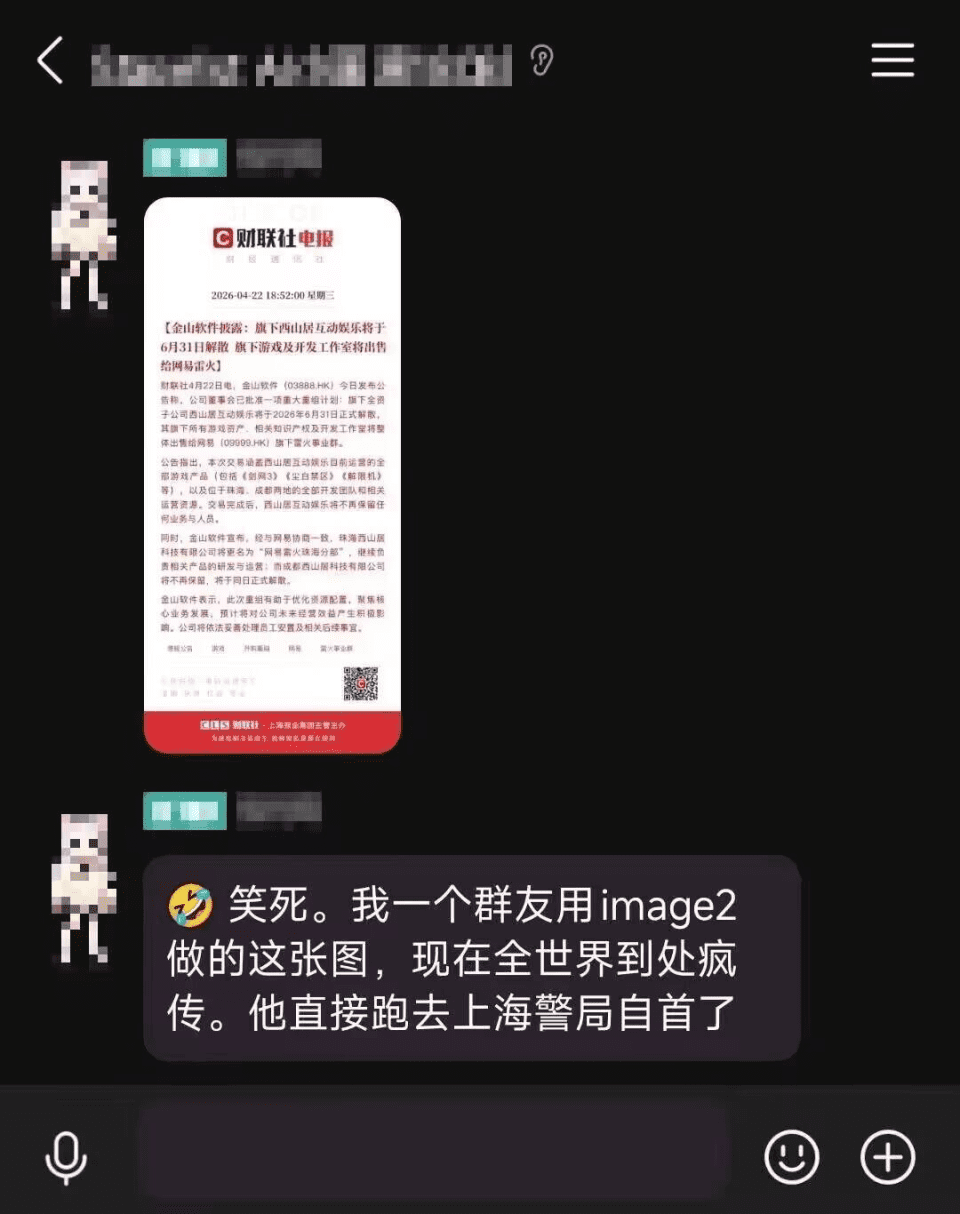

一张关于“知名游戏公司西山居解散”的新闻截图在各大社交群组疯传,引发行业震动。然而,这则消息很快被证实为彻头彻尾的假新闻——整张截图,从新闻标题、正文排版到媒体LOGO水印,全部由人工智能生成。制造这张足以乱真的假图需要多久?答案令人不安:从打开ChatGPT到最终出图,整个过程不超过一分钟。这标志着AI生成内容(AIGC)技术,特别是图像生成领域,已经跨越了一个关键的技术与伦理门槛。

长久以来,AI生图技术存在一个显著的“阿喀琉斯之踵”:文字生成,尤其是复杂象形文字如汉字的处理。无论画面多么精美,AI生成的文字往往呈现“鬼画符”状态,字符排列混乱、语义不通,成为辨别真伪最直观的破绽。然而,以GPT-image-2为代表的新一代多模态模型,彻底改写了这一规则。它不仅能准确生成符合语法和排版规范的中英文文字,更能理解上下文逻辑,自动补全符合场景的细节。

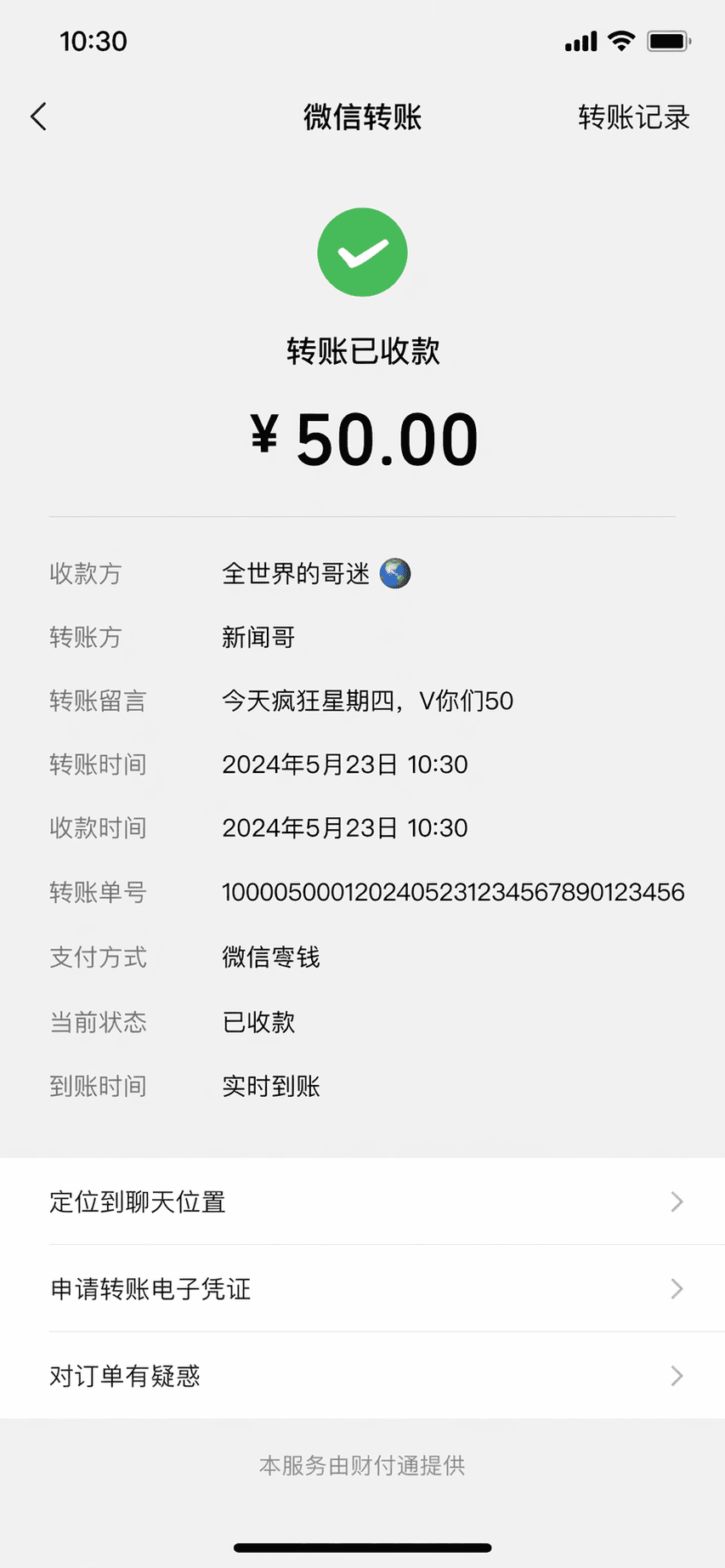

例如,当用户仅输入“生成一张微信转账成功的截图”这样简单的指令时,GPT-image-2能够自主构建出完整的交互界面:正确的用户头像、昵称、转账金额、时间戳、备注信息,甚至模拟出手机状态栏的电量和信号图标。其光影效果、界面质感和字体渲染都达到了以假乱真的程度。这种“一句话生成复杂场景”的能力,将造假的技术门槛和成本压缩到了近乎为零。

技术的普及性加剧了风险。目前,普通ChatGPT用户每日已可生成数张高质量图片,而付费升级后,生成数量可达上百张。这意味着,一个具备基础技术知识的个体,仅需投入少量资金,便能日产上千张难以肉眼甄别的假图。造假从“技术活”变成了“流水线作业”,其规模化和扩散速度是指数级增长的。

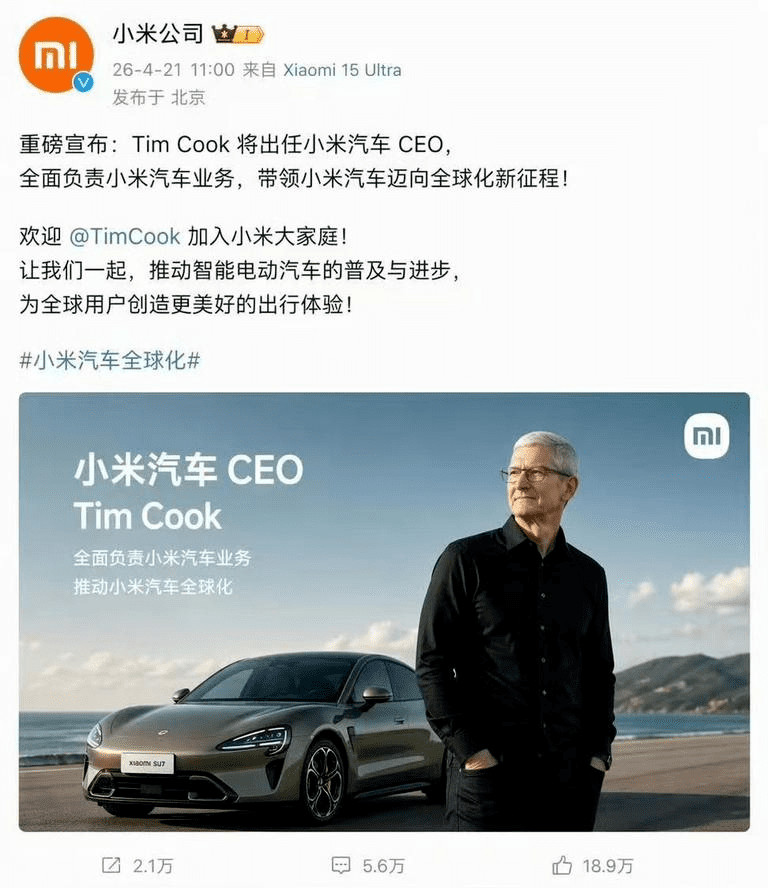

企业界已成为AI假图泛滥的重灾区。互联网公司高管的公开形象资料丰富,面部特征、神态举止均有大量公开影像记录,这反而为AI模型提供了完美的训练数据。伪造高管发言、内部邮件、战略会议截图乃至“朋友圈动态”变得轻而易举。此前,一张显示某科技巨头CEO“宣布加入竞争对手公司”的伪造截图,就曾迫使企业公关部门紧急出面辟谣,消耗了大量的公众信任资本和社会资源。

更令人担忧的是,AI假图的攻击面正从公众人物向普通社会场景蔓延。伪造的政府公告、银行通知、学术论文图表、医疗诊断报告、法律文书等,都可能成为新型诈骗和社会工程学攻击的工具。当虚假信息披上“官方截图”的外衣,其欺骗性和危害性将远超纯文本谣言。

从技术演进轨迹看,AI图像生成的突破速度远超预期。回顾2022年底ChatGPT刚推出时,AI生图作品还因“六指琴魔”、“汉字乱码”等问题被广泛调侃。短短三年半时间,技术已迭代至能够生成光影自然、逻辑自洽、细节饱满的复杂场景。按照当前的发展曲线,未来三到六年,AI生成动态视频、实时交互场景的能力很可能趋于成熟,届时对信息真实性的挑战将更为严峻。

面对这场“信任危机”,被动辟谣已显乏力,构建系统性的防御体系势在必行。这需要多维度协同:

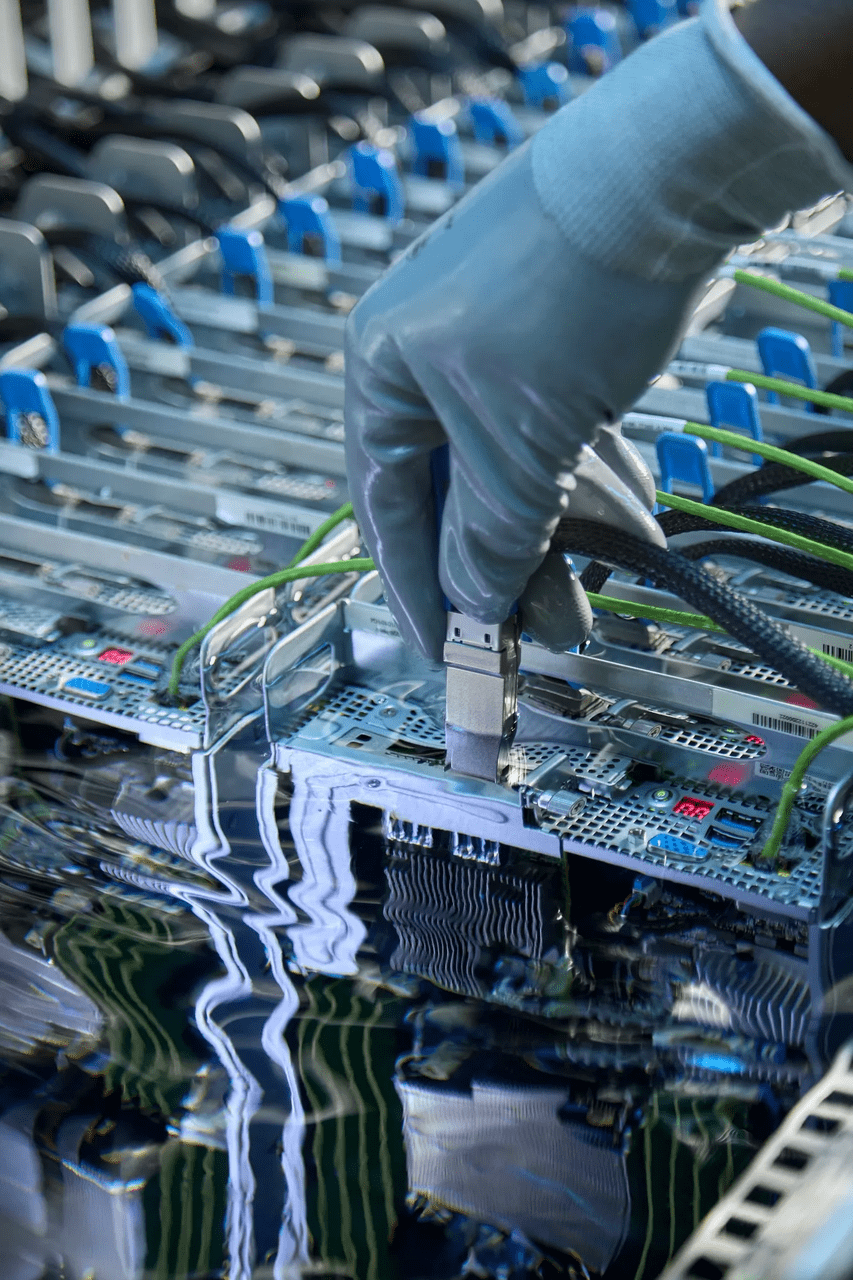

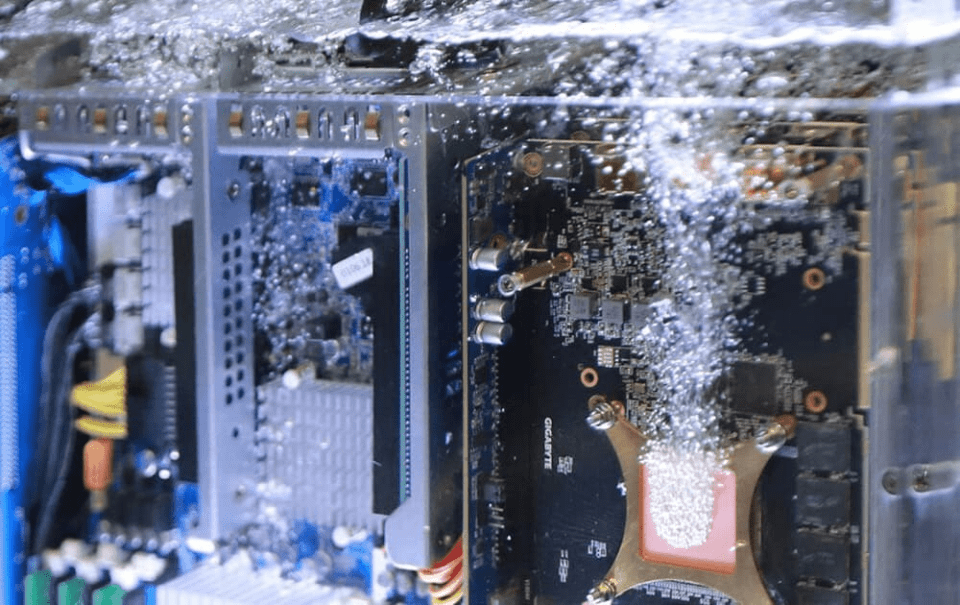

技术层面,发展“反AI造假”的检测技术至关重要。包括基于数字水印的源头追溯、利用AI模型本身在生成过程中留下的微观特征(如纹理一致性、光线物理规律悖反)进行鉴真,以及区块链等技术用于重要信息的存证与验证。

平台与监管层面,社交媒体和内容平台需承担起更重要的责任。应建立快速响应的假图识别与标注机制,对AI生成内容进行强制性标识(如元数据标记),并优化算法推荐逻辑,避免虚假信息获得病毒式传播的流量加持。立法机构也需加快步伐,明确AI生成内容的制作、传播和用于欺诈的法律边界与责任。

公众认知层面,提升全民的“数字媒介素养”是根本。教育公众养成“先验证,后转发”的信息消费习惯,了解基本的图片验证技巧(如检查EXIF信息、使用反向图片搜索),并对过于完美、情绪煽动性强或来源单一的信息保持审慎态度。

此外,一个值得探讨的方向是建立“可信信息供应链”。对于新闻媒体、金融机构、政府机关等权威信源,可以探索采用加密签名、官方验证通道等方式,为其发布的图片、文件赋予可验证的数字身份。公众通过简单的工具即可验证接收到的信息是否来自真实源头且未被篡改。

这场由AI掀起的“假图风暴”,本质上是一场关于信任的技术博弈。它迫使人类社会重新审视“眼见为实”这一古老信条在数字时代的适用性。技术的双刃剑效应在此显现无遗:一方面,它极大地提升了内容创作的效率和想象力;另一方面,它也可能侵蚀社会信任的基石。

未来的信息环境,或将进入一个“默认怀疑,验证取信”的新常态。这并非意味着我们要陷入技术恐慌,而是要求我们发展出与之匹配的认知能力和技术工具。正如密码学的进步催生了更复杂的加密算法,AI造假能力的提升,也必将倒逼验证技术与信任机制的革命。在这场没有终点的猫鼠游戏中,保持技术警觉、伦理思考和制度创新,是维系数字社会健康运行的唯一途径。最终,我们或许会找到与超级智能共处的新平衡:既享受其带来的创造力红利,又能守护真实与信任的价值底线。