电影《流浪地球2》中服务器浸没于海水中的场景,曾让许多观众感到不可思议。然而,这种看似科幻的散热方式,如今已成为数据中心应对算力爆炸式增长的关键现实技术。将价值不菲的服务器芯片浸泡在特殊液体中,并非天方夜谭,而是全球工程师为突破散热极限所做出的必然选择。

风冷技术的物理天花板

要理解液冷技术的紧迫性,必须首先审视芯片功耗的爆炸式增长曲线。十年前,单颗CPU功耗维持在几十瓦水平,依靠铝制散热片和风扇便能有效控温。然而,人工智能时代的到来彻底改变了这一格局。当前用于训练大模型的GPU,单卡功耗已普遍达到700瓦以上,部分型号甚至突破1000瓦大关。当数十张这样的高功耗芯片密集部署于单个机柜时,整机柜功率轻松跨越30千瓦门槛,并向50千瓦、100千瓦乃至更高水平迈进。

这种功率密度意味着什么?以家用空调作为参照,一台3匹空调的制冷量约为7千瓦。也就是说,一个满载AI芯片的机柜所产生的热量,相当于十几台家用空调同时全力运行。在大型数据中心中,这样的高功率机柜往往数以千计,传统散热系统面临前所未有的压力。

空气作为冷却介质存在先天不足:其比热容低,导热能力差。当单机柜功率超过30千瓦时,即使将风扇转速提升至极限,空气也无法及时带走积聚的热量。这直接导致芯片因过热而触发降频保护,计算性能大幅下降,严重时甚至引发系统宕机,造成不可估量的经济损失。

能耗问题同样严峻。衡量数据中心能源效率的核心指标PUE(电源使用效率),理想值为1.0,表示所有电力均用于计算本身。然而,采用传统风冷方案的数据中心,需要将大量电力消耗在空调制冷和风扇运转上,PUE值普遍处于1.4至1.6区间,即便经过优化也难以突破1.2。国际能源署数据显示,全球数据中心耗电量已占人类总用电量的约2%,且预计到2030年将翻倍。如果继续依赖风冷技术支撑未来的AI算力增长,我们很可能陷入“用整个电网为空调供电”的荒诞局面。

液冷技术的三重演进路径

面对风冷技术的极限,液冷技术体系应运而生。值得注意的是,液冷并非单一技术,而是一个包含多种实现方式的技术谱系,主要可分为冷板式、喷淋式和浸没式三大类。

冷板式液冷是目前最成熟的过渡方案。其原理是在CPU、GPU等高发热元件表面贴合金属冷板,冷却液在内部微通道中流动,通过金属导热将热量带走。这种方案因冷却液不直接接触电子元件,安全性较高,改造成本相对可控,成为许多传统数据中心向液冷转型的首选。

然而,冷板式液冷存在固有局限:热量传递需经过金属介质,存在热阻;且机柜内内存、硬盘等部件仍需依赖风冷辅助散热,形成“冷热不均”的混合散热模式,整体效率存在天花板。

喷淋式液冷采用更激进的直接接触方案,通过精密喷头将冷却液喷洒至发热元件表面,利用液体蒸发高效带走热量。与冷板式相比,喷淋式的散热效率显著提升,但系统复杂度也大幅增加。喷头堵塞风险、液体分布均匀性控制、蒸发损耗管理等问题,对工程设计提出了极高要求,目前该技术仍处于特定场景的试点应用阶段。

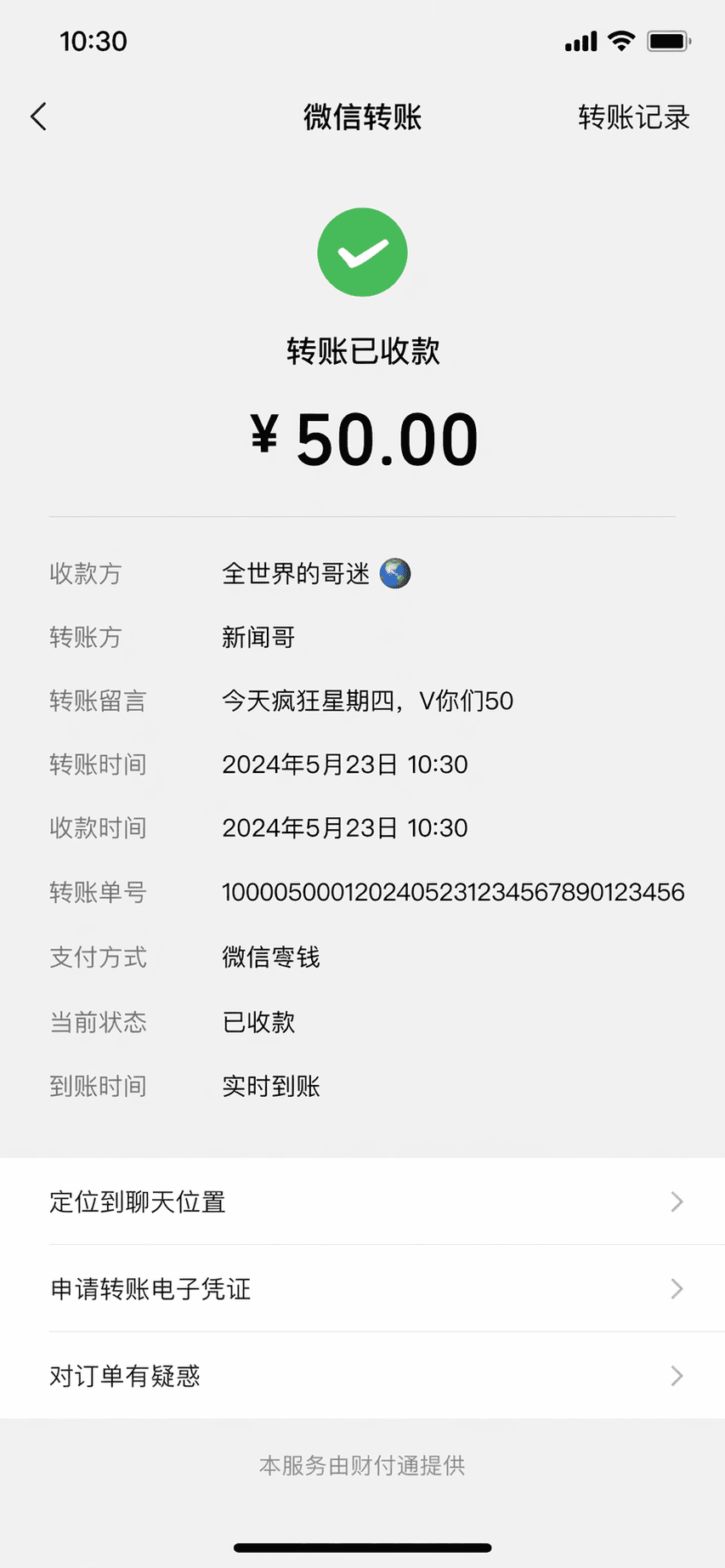

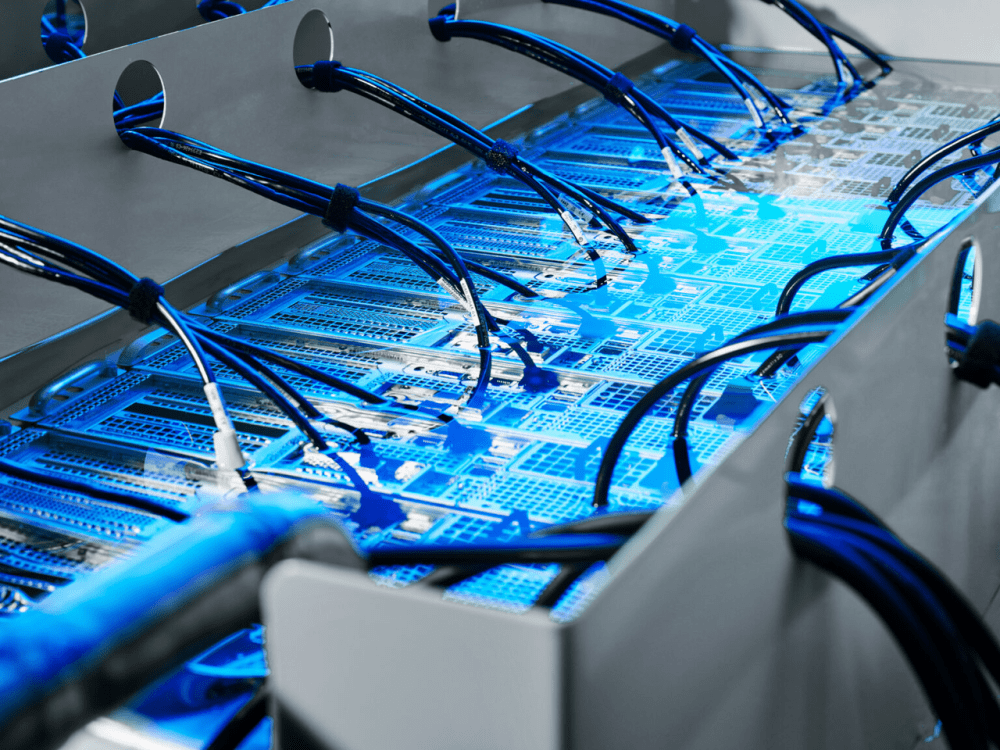

浸没式液冷代表了当前散热技术的最高形态。该方案将整台服务器或机柜完全浸没于特殊冷却液中,实现液体与每个电子元件的直接接触,通过热传导和对流最大化散热效率。液体的导热能力约为空气的25倍,单位体积携热能力更是空气的近千倍,这使得浸没式液冷的单机柜散热能力达到风冷方案的数倍乃至十几倍。

浸没式方案的优势不仅在于高效散热:均匀的液体接触消除了散热死角;取消风扇后系统近乎静音运行;完全密封环境彻底杜绝灰尘污染。根据实际部署经验,30千瓦以下功率密度风冷仍具性价比;30-50千瓦区间冷板式是理想选择;而当功率突破50千瓦迈向100千瓦级时,浸没式液冷将成为不可替代的刚需技术。

电子氟化液的技术突破

实现浸没式液冷的核心挑战在于寻找既高效导热又能与电子设备安全共存的液体介质。早期尝试的矿物油、变压器油等“油冷”方案,虽具备绝缘性,但黏度高、散热效率有限,且长期使用易氧化变质,维护成本高昂。后续出现的硅油性能有所改善,但仍未达到理想状态。

当前行业主流解决方案聚焦于电子氟化液——一种人工合成的特殊有机化合物。这种无色无味的液体在三个关键维度表现出卓越特性:

绝缘安全性:氟化液具有极高的电阻率,即使服务器在通电状态下完全浸泡,也不会引发短路事故。实际测试中,将智能手机浸入氟化液长达十年,取出后各项功能依然完好。

材料兼容性:服务器内部包含铜电路、金触点、银焊点、铝散热片、多种塑料与橡胶等复杂材料。氟化液需对所有材料保持化学惰性。经过多代配方迭代,当前产品已通过长期浸泡测试,证实其对各类元器件无腐蚀、无溶胀影响,相关性能已通过工信部验收。

热稳定性:氟化液沸点通常在110摄氏度以上,远高于服务器正常工作温度(70-80摄氏度)。这意味着在常规运行条件下,液体蒸发损耗极低,无需频繁补充,大幅降低了运维复杂度。

尽管如此,工程化落地仍面临多重挑战:

密封可靠性:整个液冷槽体必须实现完全密闭,所有管道、线缆穿舱位置都需要特殊密封处理。任何微小的泄漏都可能造成昂贵设备损坏和业务中断。

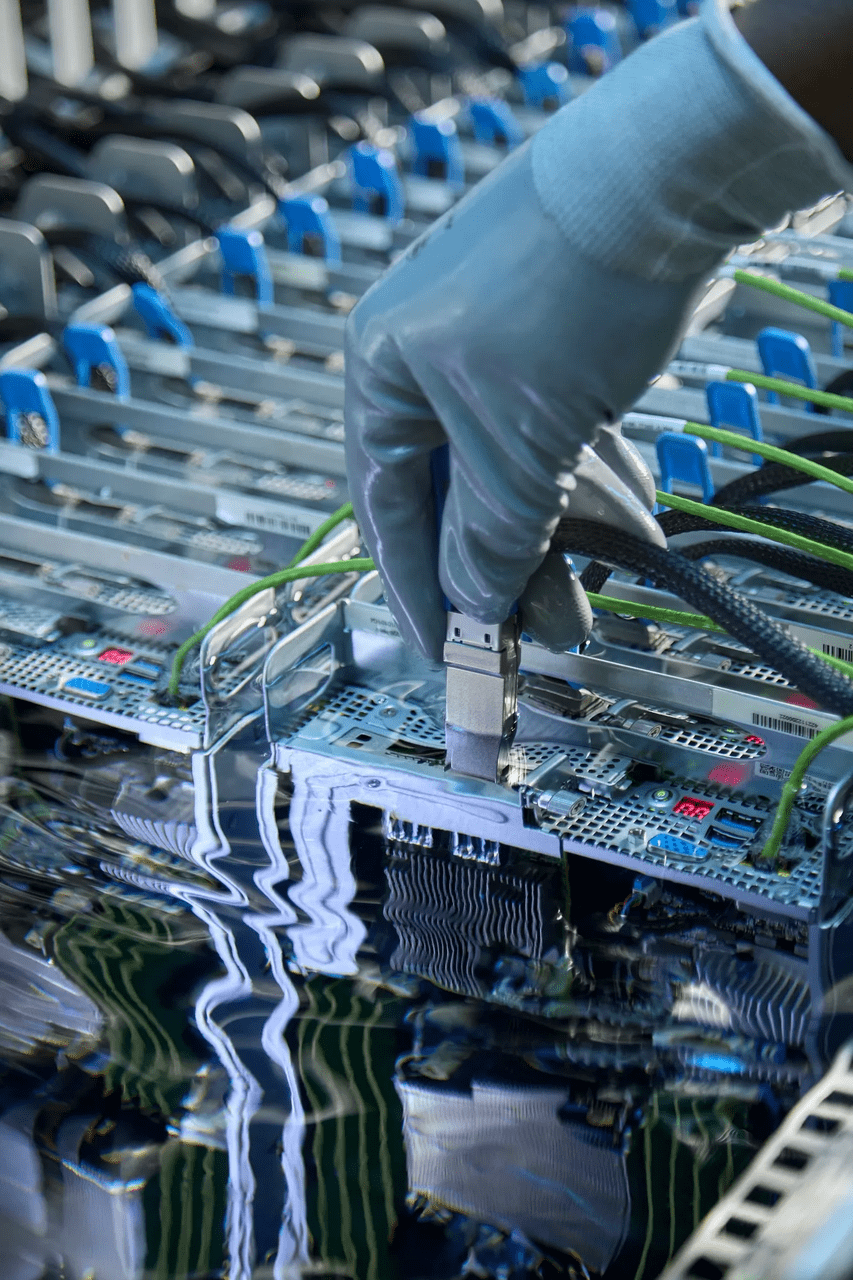

维护便捷性:传统服务器维护可直接开柜操作,而浸没式系统需要先排空液体,流程复杂且耗时。此外,并非所有硬件都适应液体环境,部分硬盘和光模块需要重新设计。

成本经济性:电子氟化液本身价格昂贵,加上专用槽体、循环泵、热交换器等配套设备,初期投资比风冷系统高出约20%。不过,从全生命周期成本分析,凭借显著的节电效益,投资回收期可控制在4年左右。中国移动庆阳数据中心的实际测算验证了这一经济模型。

规模化落地的时代契机

浸没式液冷概念已存在十余年,为何直到近年才迎来规模化应用拐点?多重因素共同促成了这一转变。

算力密度的刚性需求:英伟达最新AI芯片单卡功耗突破1000瓦,64卡或128卡配置的机柜功率轻松跨越50千瓦门槛,并向100-130千瓦区间迈进。国产AI芯片也在快速迭代中逼近类似功耗水平。在这种功率密度下,风冷完全失效,冷板式液冷也渐显吃力,浸没式方案从“可选”变为“必选”。

应用场景的精准分化:AI算力可分为训练和推理两大场景。训练大模型需要GPU持续满负荷运行数周甚至数月,热量输出稳定且巨大,浸没式液冷的稳定散热和节能优势得以充分发挥。而推理任务负载呈现脉冲特征,风冷或冷板式在应对波动负载时更具灵活性和经济性。因此,未来数据中心将呈现混合架构:训练集群采用浸没式液冷,推理集群根据负载特性选择冷板式或风冷,实现资源的最优配置。

国产算力的生态适配:传统液冷技术主要围绕英伟达GPU生态构建。随着华为昇腾、海光、寒武纪、燧原等国产芯片大规模部署,其功耗特性和封装形式呈现差异化特征。浸没式液冷凭借“液体包裹一切”的通用性优势,成为适配多元芯片架构的最优解。这也是为何庆阳等国产算力枢纽会率先布局浸没式液冷技术。

算力与能源的深层博弈

技术演进背后,隐藏着更为深刻的战略考量。人工智能时代的竞争,表层是算法、模型与芯片的比拼,底层实则是能源体系的较量。训练一次GPT-4级别的大模型,耗电量相当于3万个家庭一年的用电总量。全球数据中心耗电量正以每年超过10%的速度增长,若不从根本上提升散热效率,未来很可能面临“算力可得,电力难供”的困境。

浸没式液冷将PUE值从1.2降至1.07,这0.13的改进看似微小,但放大到百万千瓦级算力集群,意味着每年节省的电量相当于一座小型水电站的全年发电量。在“双碳”目标和全球能源紧张的宏观背景下,散热效率直接关联能源效率,PUE优化就是碳排放削减。

中国移动庆阳智算中心的实践提供了有价值的参考样本:当地全年较低的气温提供了天然冷却优势;每度0.38元的绿色电力降低了运营成本;正在建设的规模化液冷集群展示了技术落地的可行性。这种“气候+能源+技术”的组合优势,正在重塑中国算力基础设施的地理分布格局。

然而,技术进化永无止境。当单机柜功率向200千瓦、300千瓦继续攀升,今天的氟化液也会面临新的挑战。下一代散热技术可能转向相变材料、超导热管,甚至探索将数据中心部署于深海、极地等特殊环境。物理定律从不妥协,工程师只能在极限边缘持续寻找那0.1%的优化空间。

浸没式液冷的规模化应用,标志着算力基础设施进入新的发展阶段。这不仅是散热方式的技术变革,更是应对全球算力竞赛、保障能源安全、实现可持续发展的战略举措。当芯片“泡”进特殊液体的景象从科幻走向常态,我们看到的不仅是一项技术的成熟,更是一个国家在算力时代构建核心竞争力的坚定步伐。