合作公告时机的战略失误

OpenAI首席执行官萨姆·阿尔特曼在社交媒体平台X上的公开道歉,揭示了科技公司在政府合作中面临的时间敏感性挑战。其承认的"机会主义"质疑,实际上反映了科技巨头在竞争激烈的市场中寻求先发优势的常见策略。然而,选择在竞争对手与美国国防部合作破裂后立即宣布类似合作,这种时机选择不仅引发了道德质疑,更暴露了商业决策与公共利益之间的潜在冲突。

从市场反应来看,这一决策的代价显而易见。Sensor Tower数据显示,在合作宣布当天,美国用户卸载ChatGPT移动应用的数量环比暴增295%。这种用户反弹不仅体现在数字上,更反映了公众对AI技术军事化应用的深度担忧。值得注意的是,这一数据仅代表移动端用户,尚未计入桌面端的使用变化,实际影响可能更为深远。

竞争对手的市场机遇

更具象征意义的是,在OpenAI陷入争议的同时,其竞争对手Anthropic旗下的AI聊天机器人Claude在美国的下载量首次超越ChatGPT。这一转折点不仅标志着市场竞争格局的变化,更体现了用户用脚投票的力量。Anthropic一直以来强调的" constitutional AI"理念——即通过宪法原则约束AI行为——在此次事件中获得了更大的市场认同。

Claude的反超并非偶然。该产品在设计中强调安全性和可控性,与OpenAI近期商业化步伐加速形成鲜明对比。这种差异化定位在AI军事化合作争议的背景下显得尤为突出,显示出市场对负责任AI开发的明确偏好。

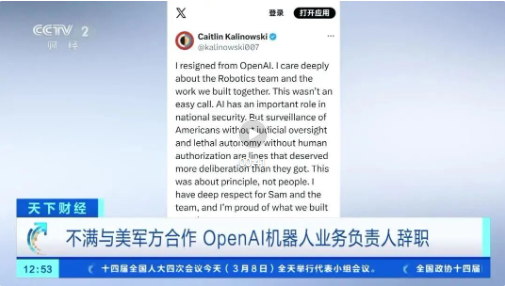

内部伦理分歧的表面化

OpenAI机器人与消费硬件业务负责人卡利诺夫斯基的辞职,将公司内部的伦理分歧公之于众。她在辞职声明中强调的三个关键点值得深入思考:AI在国家安全领域的作用边界、缺乏司法监督的民众监控问题,以及自主致命攻击系统的人类授权机制。

这些担忧并非空穴来风。当前全球范围内对AI军事应用的监管仍处于相对空白状态。联合国《特定常规武器公约》框架下关于致命性自主武器系统的讨论已持续多年,但实质性进展有限。卡利诺夫斯基的辞职实际上反映了科技行业内部对这一问题日益加深的分歧。

AI军事合作的全球图景

OpenAI与美国国防部的合作并非个案。从谷歌的Project Maven到亚马逊与Palantir的政府合作,科技公司与军事机构的协作已成为行业常态。然而,这种合作模式面临着三重挑战:技术边界的模糊性、监管框架的缺失以及公众信任的脆弱性。

在技术层面,AI系统的"双重用途"特性使得民用技术与军事应用的界限日益模糊。自然语言处理技术既可用于改善客户服务,也可用于军事心理作战;计算机视觉技术既可用于医疗诊断,也可用于目标识别。这种技术特性使得纯粹的"非军事"AI研发几乎不可能实现。

商业利益与伦理责任的平衡

OpenAI此次事件的核心矛盾在于商业扩张需求与伦理承诺之间的张力。从公司发展轨迹来看,OpenAI已从最初的非营利组织转型为有限营利性机构,这种组织结构变化必然带来商业压力的增加。与国防部的合作可能带来可观的政府合同收入,但也可能损害其品牌形象和用户信任。

值得注意的是,阿尔特曼在道歉后迅速宣布对合作协议追加新条款,这一举动既是对批评的回应,也可能是一种风险控制策略。然而,具体条款内容尚未公开,其实际约束力仍有待观察。

行业监管的迫切需求

此次争议凸显了AI行业监管框架建设的滞后性。当前,各国对AI军事应用的监管仍处于碎片化状态,缺乏统一的国际标准和监督机制。欧盟人工智能法案虽然对高风险AI系统设置了严格规定,但军事应用往往获得豁免。

科技公司需要在以下方面加强自我规制:建立透明的伦理审查流程、确保利益相关方参与决策、制定明确的技术使用边界。同时,政府监管机构也需要加快立法进程,为AI军事应用划定清晰的法律红线。

用户选择与市场导向

用户对ChatGPT的卸载潮表明,消费者正在成为AI伦理的重要监督力量。在缺乏有效监管的情况下,市场机制可能成为约束企业行为的重要工具。Anthropic等竞争对手的崛起也证明,伦理考量正在成为产品差异化的重要维度。

这种市场导向的变化可能推动整个行业向更加负责任的方向发展。企业将不得不更加重视技术的社会影响,而不仅仅是商业利益。从长远来看,这种趋势有利于AI技术的可持续发展。

未来展望与行业影响

OpenAI此次风波可能成为AI行业发展的重要转折点。它促使行业重新审视技术与价值观的关系,思考如何在创新与责任之间找到平衡点。对于其他科技公司而言,这一案例提供了宝贵的经验教训:政府合作需要更加谨慎的时机选择和透明的沟通策略。

同时,这一事件也可能加速行业分化。一些公司可能选择完全避开军事合作,专注于民用市场;另一些公司则可能继续深化与政府部门的协作,但需要建立更完善的伦理保障机制。无论选择哪条路径,清晰的价值观定位和透明的决策过程都变得愈发重要。

在技术快速发展的背景下,AI伦理不再是可以事后考虑的问题,而是必须融入技术设计和商业决策的核心要素。OpenAI的经历表明,忽视这一点的代价可能是用户信任的丧失和市场地位的动摇。