谷歌最新推出的Gemma 4开源大模型系列标志着人工智能技术在参数效率方面的重要进步。这一系列模型不仅在规模上有所突破,更重要的是在单位参数智能水平上实现了显著提升。

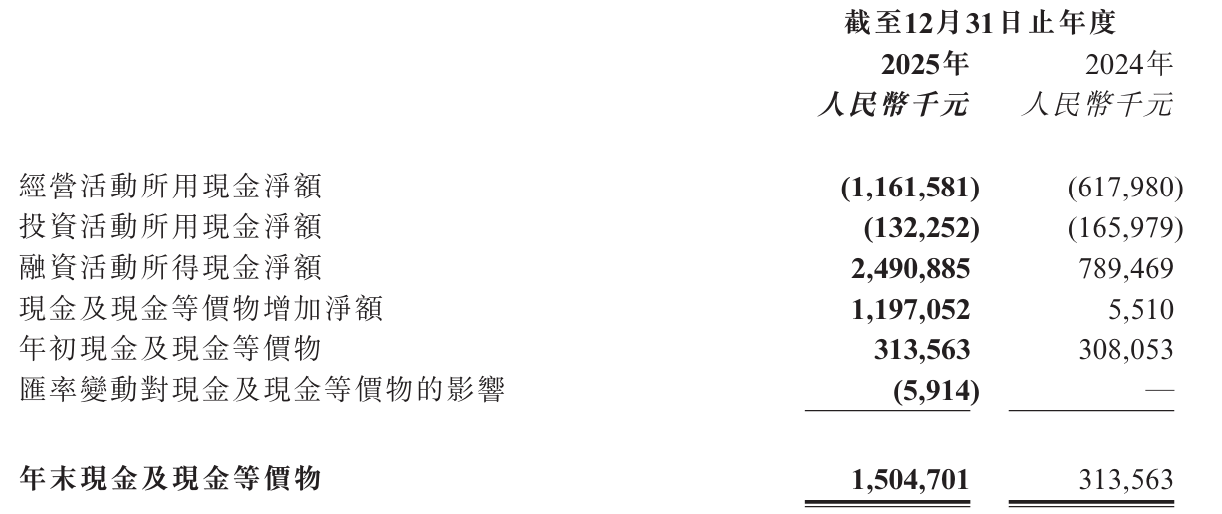

模型规格与性能表现

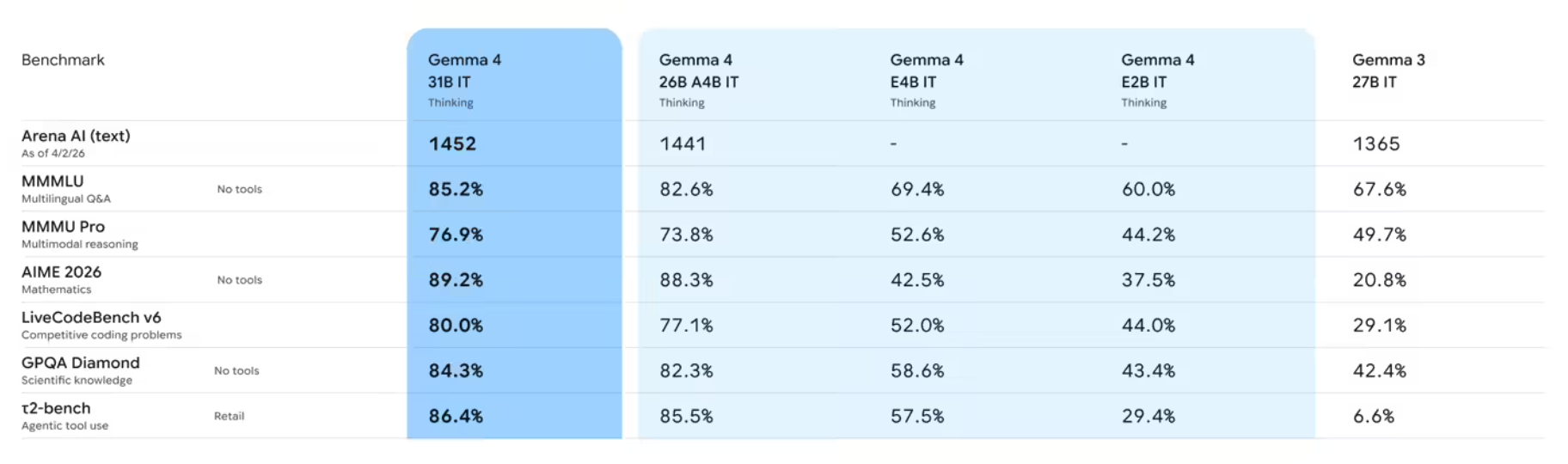

Gemma 4系列包含四个不同规格的模型,每个模型都针对特定的使用场景进行了优化:

- E2B模型(20亿参数):专为移动设备和边缘计算场景设计,在保持高性能的同时最大限度地降低资源消耗

- E4B模型(40亿参数):在E2B基础上进一步提升能力,适合需要更强推理能力的端侧应用

- 26B混合专家模型(MoE):采用混合专家架构,推理时仅激活38亿参数,实现高效的令牌生成速度

- 31B稠密模型:作为性能标杆,在同等参数规模下达到行业领先水平

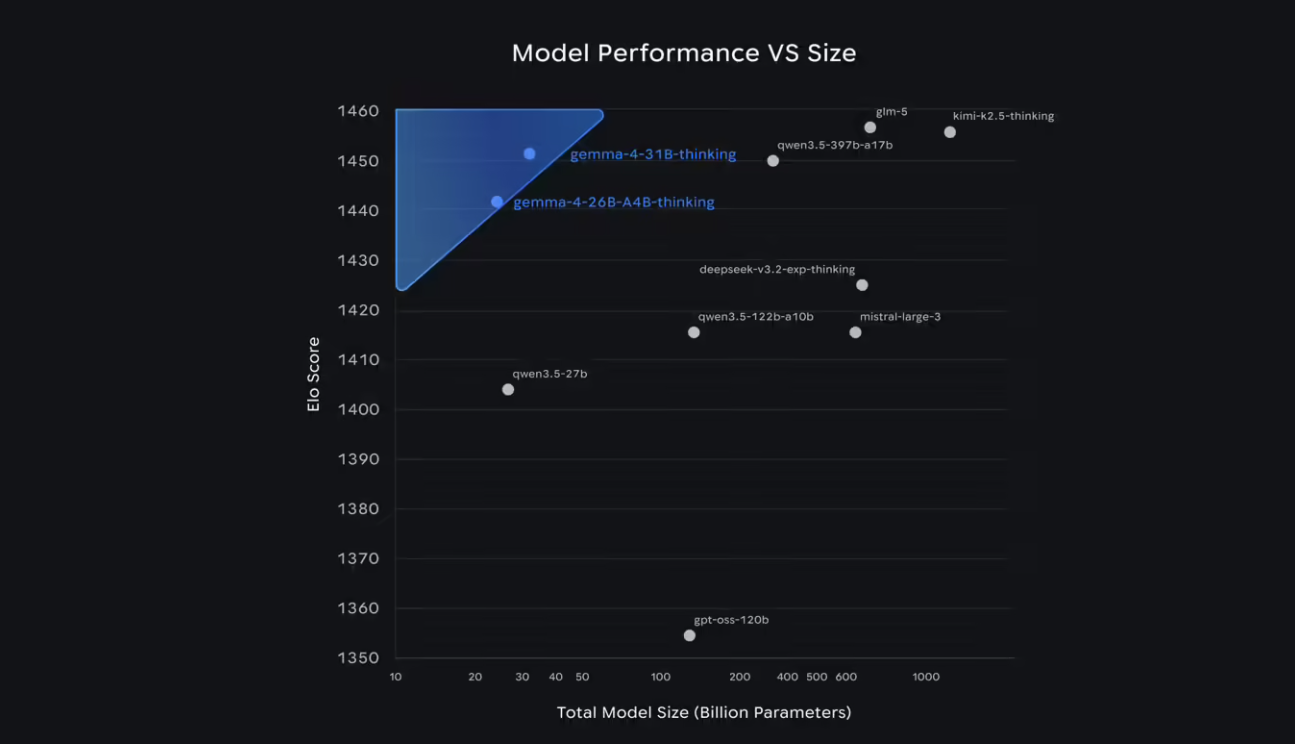

在权威的Arena AI文本榜单中,31B模型位列全球开源模型第三名,26B模型排名第六。特别值得注意的是,这些模型的性能表现甚至超过了参数规模大20倍的竞争对手,这充分证明了参数效率优化的重要性。

核心技术优势

高级推理能力

Gemma 4在复杂逻辑处理和多步规划方面表现出色。模型在数学推理、指令执行等需要深度思考的任务上实现了显著提升。这种能力使得模型能够更好地理解复杂问题,并提供更加准确的解决方案。

智能体工作流支持

模型原生支持函数调用、结构化JSON输出和系统指令,这使得开发者能够轻松构建能够对接各种工具和API的自主智能体。这种设计大大降低了构建复杂AI应用的难度,为智能体技术的发展提供了强大基础。

多模态处理能力

全系模型都支持视觉和音频处理,兼容可变分辨率输入。在OCR、图表理解等视觉任务上表现优异,而E2B和E4B模型还额外具备原生音频输入能力,支持语音识别和理解功能。

部署优化与实践应用

硬件适配性

31B和26B模型经过优化,可以在通用硬件上实现顶尖推理能力。非量化的bfloat16权重能够高效适配单张80GB的英伟达H100 GPU,而量化版本则可以在消费级GPU上运行,支持集成开发环境、编程助手等应用场景。

端侧部署创新

E2B和E4B模型在移动设备部署方面实现了重要突破。通过与谷歌Pixel团队、高通、联发科等硬件厂商的深度合作,这些模型可以在手机、树莓派、英伟达Jetson Orin Nano等设备上实现完全离线运行,达到近乎零延迟的性能表现。

开发者工具支持

安卓开发者现在可以通过AICore开发者预览版构建智能体流程,并实现与Gemini Nano 4的向前兼容。这为移动应用开发者提供了强大的AI能力集成方案。

技术架构深度解析

参数效率优化

Gemma 4系列最大的创新在于其参数效率的大幅提升。传统模型往往通过增加参数数量来提升性能,但这种方法会带来计算成本和部署难度的指数级增长。Gemma 4通过改进的模型架构和训练方法,在相对较小的参数规模下实现了卓越的性能。

混合专家架构优势

26B混合专家模型采用了先进的MoE架构,在推理过程中仅激活部分参数,这种设计既保证了模型性能,又显著降低了计算开销。对于需要快速响应的应用场景来说,这种架构提供了理想的平衡点。

长上下文处理能力

Gemma 4支持超长上下文处理,端侧模型可达128K tokens,大模型最高支持256K tokens。这意味着模型可以在单次提示中处理完整的代码库或长文档,为文档分析、代码审查等应用提供了强大支持。

行业影响与发展前景

开源生态建设

作为开源模型,Gemma 4的发布将显著推动AI技术的发展和普及。开发者可以基于这些模型构建各种创新应用,而无需担心昂贵的许可费用或计算资源限制。

边缘计算革命

随着E2B和E4B模型在端侧设备上的成功部署,边缘AI应用将迎来新的发展机遇。从智能手机到物联网设备,AI能力将更加普及,为用户带来更智能、更个性化的体验。

多语言支持意义

基于140多种语言的原生训练使Gemma 4具备了真正的全球化能力。这对于需要服务多语言用户群体的应用来说具有重要意义,有助于打破语言障碍,促进全球范围内的技术交流与合作。

实际应用场景分析

企业级解决方案

Gemma 4的高性能推理能力使其非常适合企业级应用场景。从客户服务自动化到数据分析辅助,模型的高级推理能力可以帮助企业提升运营效率和服务质量。

教育技术应用

在教育领域,Gemma 4的代码生成和逻辑推理能力可以用于构建智能编程助手和学习伙伴,为学生提供个性化的学习支持和实时反馈。

创意产业赋能

在创意产业中,模型的多模态处理能力可以支持图像生成、音频处理和文本创作等多种任务,为创作者提供强大的辅助工具。

技术挑战与应对策略

尽管Gemma 4在多个方面实现了突破,但在实际部署和应用过程中仍然面临一些挑战:

资源约束优化

如何在有限的硬件资源下最大化模型性能仍然是一个重要课题。未来需要继续优化模型压缩、量化和推理加速技术。

安全与可靠性

随着AI模型能力的提升,确保模型输出的安全性和可靠性变得愈发重要。需要建立完善的测试和验证机制来保证模型在实际应用中的稳定性。

生态整合

如何将强大的模型能力与现有的开发工具和工作流程无缝集成,是推动技术普及的关键因素。需要继续完善开发者工具和文档支持。

Gemma 4的发布不仅展示了谷歌在AI技术领域的持续创新,更重要的是为整个行业提供了新的发展方向。通过参数效率的优化和多场景适配性的提升,这些模型有望推动AI技术在各行各业的更广泛应用。