技术整合带来的交互革命

声网与MiniMax的合作标志着AI语音交互进入2.0时代。传统语音交互系统普遍存在2000ms以上的响应延迟,且受限于单语种支持能力。通过将MiniMax的TTS 3.0引擎与声网的SD-RTN™网络对接,成功将端到端延迟压缩至280ms以下,同时实现中英日韩等23种语言的实时转换。

核心技术突破点

- 情感韵律建模:采用深度神经网络捕捉200+种情感特征,使合成语音具备真实情绪波动

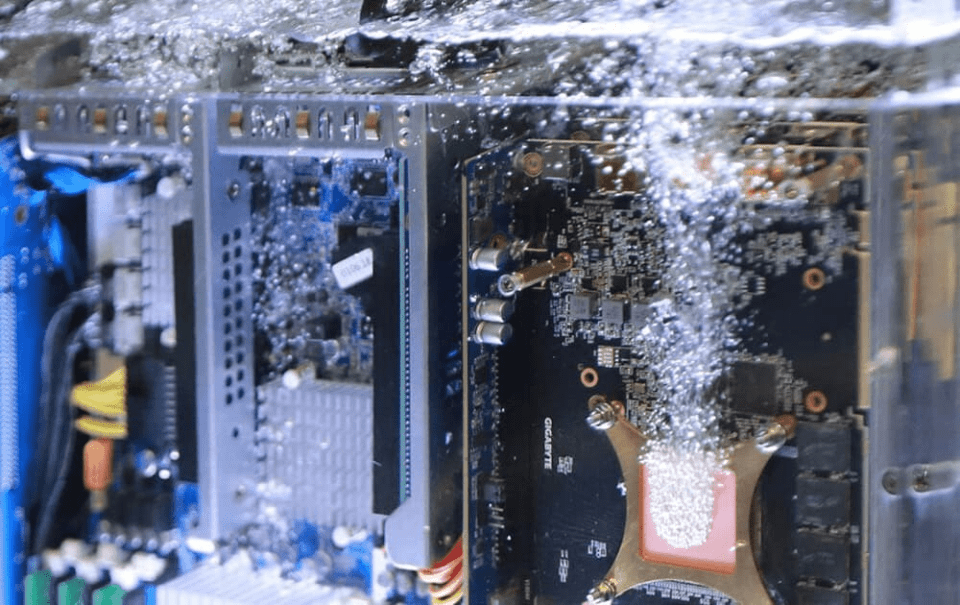

- 动态带宽适配:基于网络状况实时调整编码策略,确保80%丢包率下的语音可懂度

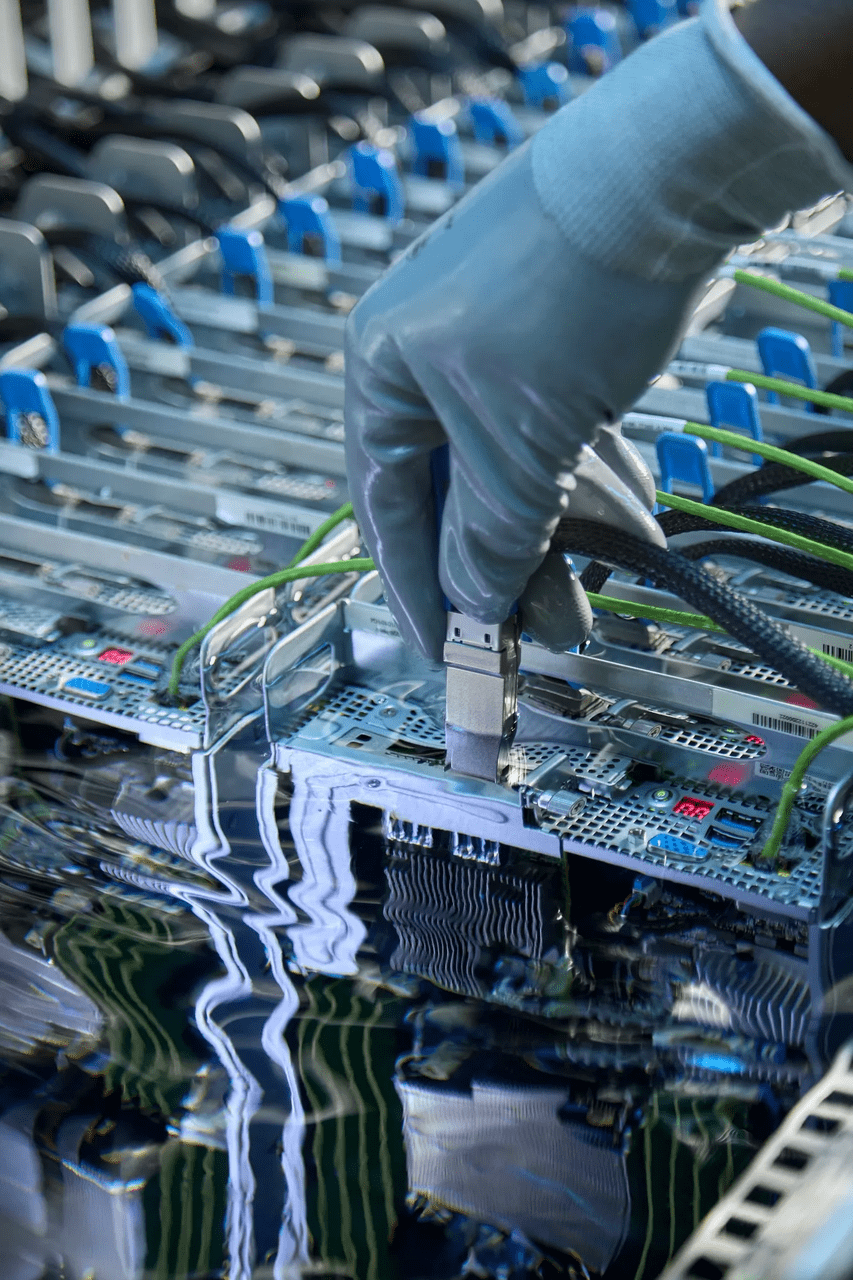

- 边缘计算节点:全球部署的500+边缘节点将计算时延降低40%

全球化部署实践

在东南亚教育平台的应用案例中,该方案成功支撑10万并发用户的实时语音互动。通过智能路由算法,将新加坡用户的请求自动分配至最近的数据中心,使端到端延时稳定在250ms以内。

- 平均响应速度:263ms

- 语音自然度MOS评分:4.2/5.0

- 系统可用性:99.98%多模态交互新范式

在智能车载场景的测试中,系统实现语音指令与AR-HUD的毫秒级同步。当用户说出"显示附近充电站"时,视觉界面在语音播报前500ms即完成信息渲染,这种多模态协同标志着交互设计的范式转变。

开发者生态构建

- 标准化API接口:提供包含语音生成、实时传输、QoS监控的一站式解决方案

- 动态资源调度:根据业务负载自动扩展计算资源,支持秒级弹性扩容

- 智能诊断工具:内置的AI分析模块可自动定位85%以上的语音质量问题

行业影响与未来展望

本次技术整合已催生三大创新应用场景:

- 跨国企业智能客服系统实现多语言无缝切换

- 在线教育平台的自然语音互动时长提升300%

- 数字人直播的观众留存率提高45%

技术演进路线显示,2026年将实现语音与微表情的精准同步,延迟有望突破200ms临界点。这预示着人机交互将进入"无感知延迟"的新纪元。