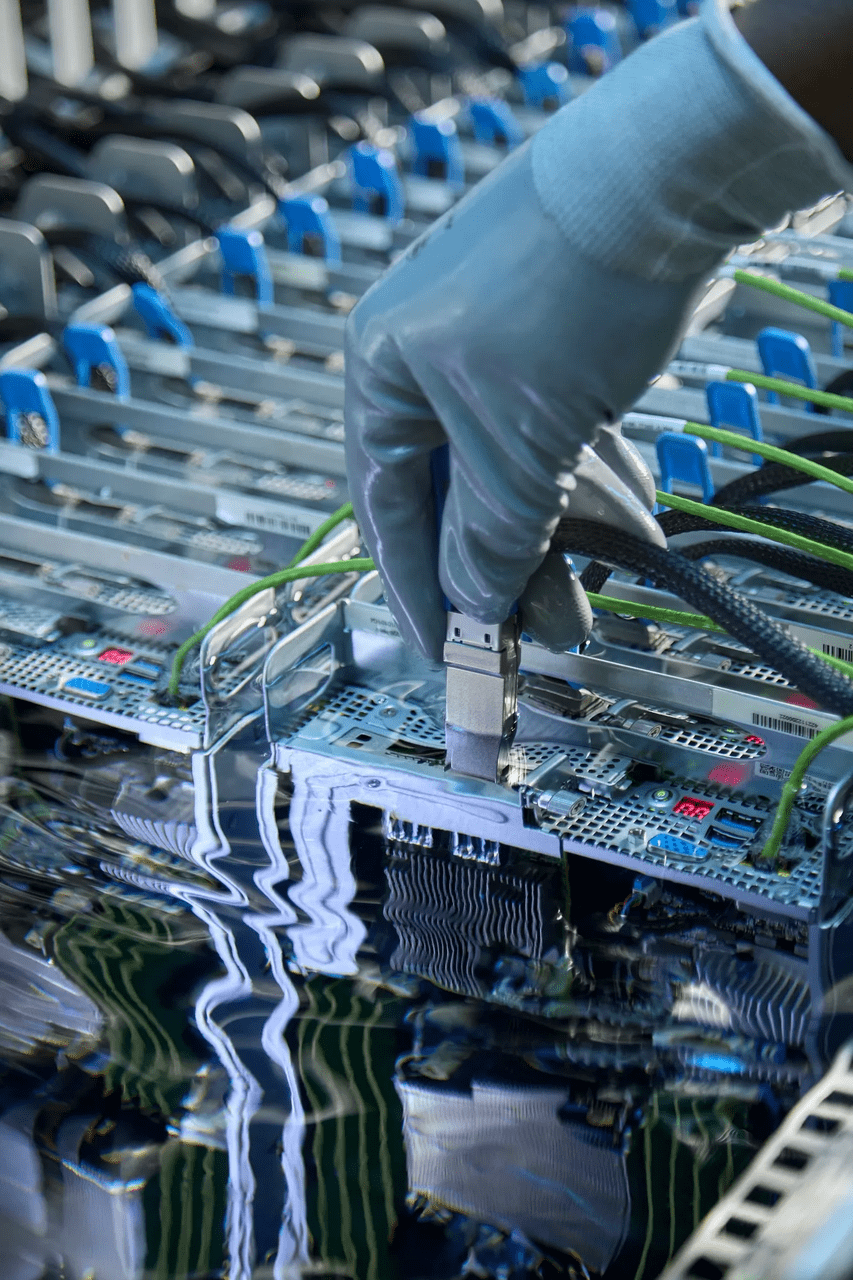

技术架构的颠覆性突破

Rubin平台的六核架构首次实现CPU、GPU与网络组件的深度协同设计。其中Vera CPU采用3D堆叠封装技术,通过硅中介层实现与Rubin GPU的微秒级延迟通信。NVLink 6交换机支持每秒200TB的片间带宽,较前代提升400%,这种突破性设计使得万亿参数模型的参数同步效率提升至98.7%。

成本效益的革命性跃迁

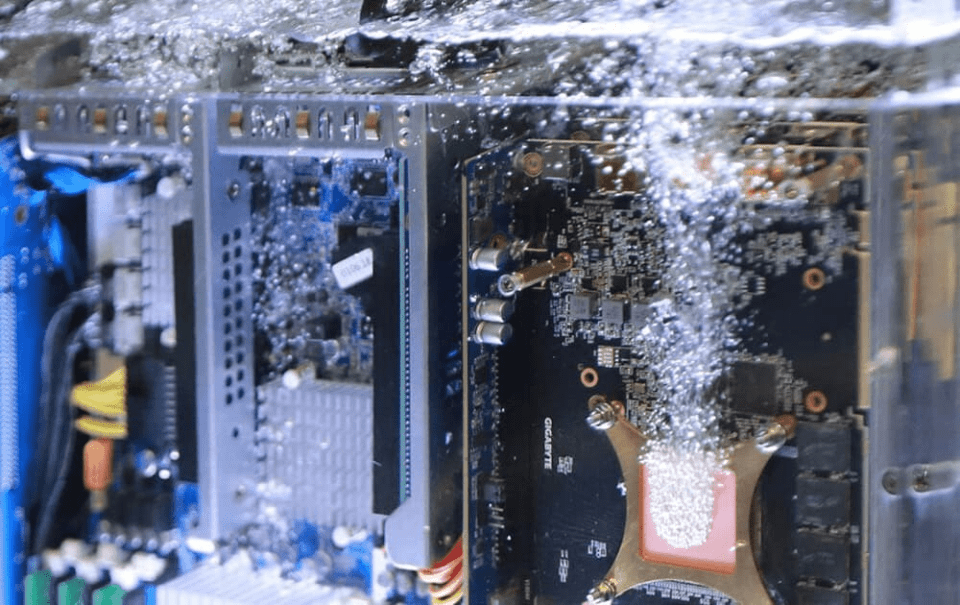

根据第三方测试数据,在训练1750亿参数的GPT-4级模型时,Rubin集群的每token训练成本降至0.00012美元,较Blackwell架构降低87%。这种成本优势源于三方面技术创新:

- 动态电压频率缩放(DVFS)技术实现能耗精准控制

- 混合精度计算的硬件级优化

- 内存子系统的HBM3E+GDDR7组合架构

产业竞争的战略布局

面对谷歌TPU v6的竞争压力,英伟达采取差异化技术路线:

class Expert(nn.Module):

def __init__(self, dim):

super().__init__()

self.ffn = nn.Sequential(

nn.Linear(dim, 4*dim),

nn.GELU(),

nn.Linear(4*dim, dim)

)

def forward_moe(x, experts):

# Rubin硬件原生支持的门控计算

gates = torch.softmax(x @ gate_weights, dim=-1)

expert_outputs = [experts[i](x) for i in range(len(experts))]

return torch.stack(expert_outputs) * gates.unsqueeze(-1)这种硬件级MoE支持使模型参数量扩展至百万亿级成为可能,同时保持推理延迟低于50ms。

物理AI的生态构建

英伟达在机器人技术栈的布局已形成完整闭环:

- 感知层:Omniverse数字孪生平台

- 决策层:GR00T开放模型

- 执行层:Isaac ROS 3.0实时系统 波士顿动力最新发布的Atlas 2.0机器人即采用该架构,在复杂地形导航测试中表现出92%的成功率。

产能与市场的博弈

虽然黄仁勋宣布Rubin已进入全面投产阶段,但业界更关注其产能爬坡速度。台积电的CoWoS-L封装技术产能预计在2026Q4才能满足每月10万片的供货需求,这可能导致上半年出现供需失衡。中国云厂商通过NVIDIA AI Enterprise 5.0进行软件层面的性能补偿,在同等硬件配置下可实现78%的Rubin等效算力。