在AI技术快速发展的今天,我们经常遇到一个令人沮丧的场景:与AI助手进行深入对话时,当对话轮次超过一定数量,AI就会突然'失忆',完全忘记之前讨论的内容。这种现象不仅影响用户体验,更制约了AI在复杂任务中的应用潜力。

记忆问题的技术根源

AI的记忆问题根源在于Transformer架构的固有局限性。传统的注意力机制要求每个token都需要与序列中的所有其他token计算注意力分数,这种全量注意力机制的计算复杂度是序列长度的平方。当上下文窗口扩展到几十万token时,计算量呈指数级增长,导致实际应用中不得不限制记忆长度。

这种技术限制使得AI在处理长对话、复杂文档分析等场景时表现不佳。就像人类需要记忆来支持持续思考一样,AI也需要可靠的记忆系统来实现真正的智能交互。

压缩式记忆管理的技术突破

压缩式记忆管理的核心思想是通过智能压缩技术,让有限的上下文窗口容纳更多有效信息。这种方法不是简单地扩大内存容量,而是通过优化信息存储方式提高空间利用率。

Claude-Mem作为这一领域的代表性产品,采用了渐进式披露的设计理念。它通过5个生命周期钩子自动捕获对话内容,然后使用AI本身来压缩这些信息。这种设计模仿了人类记忆的工作方式——我们不会一次性记住所有细节,而是根据需要逐步回忆相关信息。

类似的工具如LongLLMLingua通过提示词压缩实现了高达20倍的压缩率,特别适合那些只能通过API调用的黑盒模型。Acon则在自然语言空间进行压缩优化,在基准测试中将内存使用降低了26%到54%。

这些技术的共同特点是都在追求用更少的token传递更多的信息,但压缩技术终究存在理论极限。当压缩率达到一定程度后,必须保留的基本信息量决定了进一步压缩的空间有限。

外挂式记忆系统的架构创新

当压缩技术达到极限时,外挂式记忆系统提供了另一种解决方案。这类系统不再试图把所有信息塞进模型的上下文窗口,而是在模型外部建立独立的记忆仓库。

Mem0采用动态提取、整合和检索的架构,将对话中的关键信息存储到外部数据库。当需要相关信息时,通过语义相似度检索相关记忆。实验数据显示,Mem0在LOCOMO基准测试中比OpenAI的记忆系统提升了26%,同时响应时间降低91%,token使用量减少90%以上。

LOCOMO基准测试包含单跳问题、时序问题、多跳问题和开放域问题四大类,全面评估AI的记忆能力。Mem0在多跳问题上的优异表现表明,它不仅能记住零散事实,还能将这些事实有机串联起来。

MemGPT(现改名为Letta)则采用了更为创新的思路——将LLM视为操作系统,实现类似计算机虚拟内存的分层管理。这种设计让AI能够自主决定哪些信息需要立即访问,哪些可以暂时存储到外部空间。

软提示编码的技术原理

软提示编码代表了记忆技术的另一个发展方向。这种方法不直接存储文本内容,而是将提示词编码成连续的可训练嵌入或键值对。500xCompressor等架构通过这种技术实现了高达480倍的压缩率。

软提示编码的本质是建立一套AI专用的'暗号'系统。就像人类之间通过特定词汇触发共同记忆一样,这些特殊token能够让模型回想起大段相关内容。虽然这些token在人类看来毫无意义,但对训练过的模型来说,它们是高度浓缩的信息载体。

这种方法的优势在于极高的压缩率,但也存在明显局限。编码后的'暗号'只对特定模型有效,缺乏通用性。而且编码过程需要额外的训练成本,不像其他方法那样即插即用。因此,软提示编码更适合长期使用同一模型、对压缩率要求极高的特定场景。

架构层面的根本性变革

前述的外挂式解决方案虽然有效,但都属于'打补丁'式的改进。真正的突破需要从模型架构层面进行根本性变革。

DeepSeek Sparse Attention(DSA)代表了这一方向的重要进展。DSA采用两阶段设计:先用轻量级'索引器'快速评估哪些token最相关,然后只对这些精选token进行完整的注意力计算。这种稀疏化是动态的、基于内容的,不同于传统的固定窗口或随机采样方法。

DSA的工作原理类似于人类阅读时的信息处理方式——我们先快速浏览内容找出重点,然后只对关键部分进行深入分析。这种设计在大幅降低计算量的同时,几乎不损失模型性能。

混合注意力架构是另一个重要创新方向。阿里的Qwen3-Next采用Gated DeltaNet加Gated Attention的混合机制,以3:1的比例分配线性注意力和全量注意力层。这种设计既保证了性能,又显著降低了计算开销。

月之暗面的Kimi Linear采用类似的混合架构,在100万token场景下,KV缓存最多减少75%,解码吞吐最高提升6倍。这些创新表明,AI并不需要时刻动用全部计算资源,只需要在关键决策点进行全局审视。

硬件与算法的协同优化

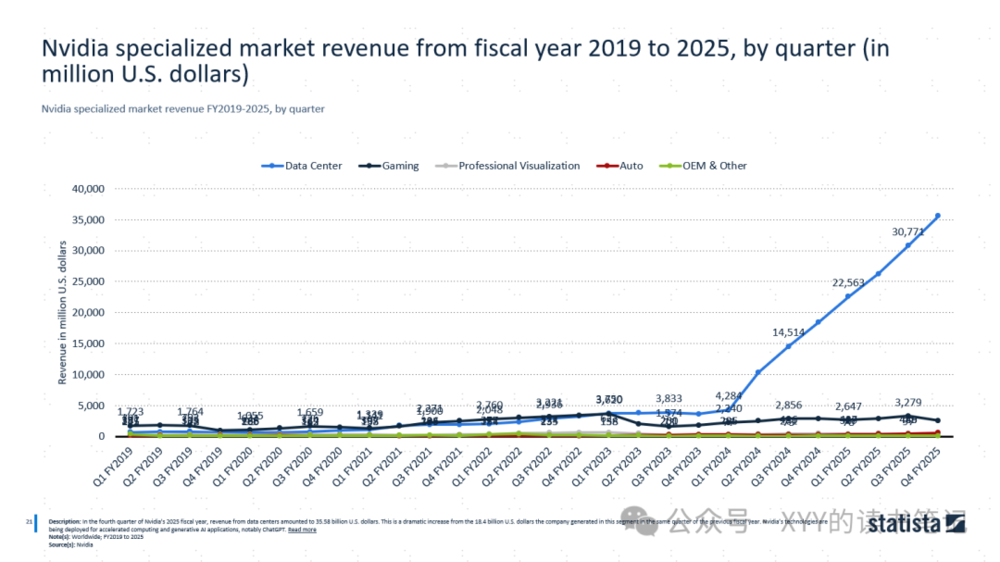

再先进的算法也需要硬件支持才能发挥最大效能。英伟达的BlueField-4 CMX平台是硬件协同优化的典范,专门为'百万级token上下文'时代设计。

该平台采用分层存储架构,将热数据放在GPU显存,温数据放在扩展内存,冷数据放在系统内存或SSD。通过智能调度实现大容量支持,就像在工作台旁边增加置物架,扩展可用空间的同时保持访问效率。

这种硬件创新与算法优化相辅相成,共同推动AI记忆能力的提升。亚马逊的Trainium芯片、谷歌的TPU等专用AI芯片都在与大模型厂商深度合作,实现芯片与算法的专业对口。

记忆技术的未来发展方向

当前的AI记忆系统仍处于相对初级的阶段,缺乏人类记忆的许多关键特征。人类记忆具有智能的遗忘机制、巩固过程和学习能力,这些特性使得记忆系统更加高效和智能。

未来AI记忆技术的发展可能会朝着以下几个方向演进:

多层次记忆架构:模仿人类大脑的海马体、前额叶皮层等不同记忆区域的分工合作,建立工作记忆、短期记忆和长期记忆的多层次系统。

智能遗忘机制:开发能够区分信息重要性的算法,实现有选择的遗忘和记忆强化,避免记忆仓库变成杂乱无章的存储空间。

情感记忆标签:为记忆添加情感权重和重要性标签,让AI能够像人类一样根据情感强度来优先处理某些记忆。

主动记忆巩固:设计定期回顾和强化重要记忆的机制,防止关键信息随时间衰减。

跨会话学习能力:使AI能够从多次交互中提取模式和经验,实现真正的持续学习。

这些发展方向不仅需要技术创新,还需要深入理解人类记忆的运作机制。认知科学的研究成果将为AI记忆系统的设计提供重要启示。

技术挑战与伦理考量

随着AI记忆能力的增强,也带来了新的技术挑战和伦理问题。记忆隐私保护、记忆篡改防范、记忆所有权界定等问题都需要认真对待。

记忆安全性:如何防止恶意攻击者篡改AI的记忆内容,确保记忆的准确性和可靠性。

隐私保护:在增强记忆能力的同时,如何保护用户隐私,避免敏感信息被不当存储或使用。

记忆一致性:当AI系统需要更新或升级时,如何保持记忆的连续性和一致性。

责任归属:当基于记忆的决策产生问题时,如何界定责任归属。

这些问题的解决需要技术方案、法律规范和社会共识的协同推进。

产业应用前景

增强的AI记忆能力将在多个领域产生深远影响:

客户服务:实现真正的个性化服务,AI能够记住每个客户的偏好和历史交互,提供连贯的服务体验。

教育领域:AI导师能够跟踪学生的学习进度和困难点,提供针对性的辅导建议。

医疗健康:AI助手能够持续跟踪患者的健康状况和治疗反应,为医生提供更全面的决策支持。

创意工作:AI协作工具能够记住创作过程中的各种尝试和反馈,支持更复杂的创意项目。

科学研究:AI研究助手能够整合大量文献和实验数据,帮助科学家发现新的研究思路。

这些应用场景的实现,将显著提升AI系统的实用价值和智能化水平。

记忆能力的突破是通向通用人工智能的重要里程碑。当前的'赛博脑白金'技术正在为AI补上记忆这块关键短板,但真正的智能记忆系统还需要更多的技术创新和理论突破。未来,我们可能会看到更加接近人类记忆机制的AI系统,它们不仅能够记住更多信息,还能够智能地选择记住什么、忘记什么,以及如何利用记忆来支持更好的决策和创造。