技术背景与商业动因

Anthropic此次政策调整的核心动因在于算力成本与商业模式的失衡。OpenClaw作为基于Claude Code构建的Agent框架,其架构设计实现了极高的效率优化。该工具允许用户在WhatsApp、Discord、Telegram等平台上发送指令,AI即可在后台7×24小时自主执行文件读写、浏览器操控、代码执行等复杂任务。单个账号可同时运行10个Agent且持续不停机,这种使用模式对算力资源的消耗远超常规应用场景。

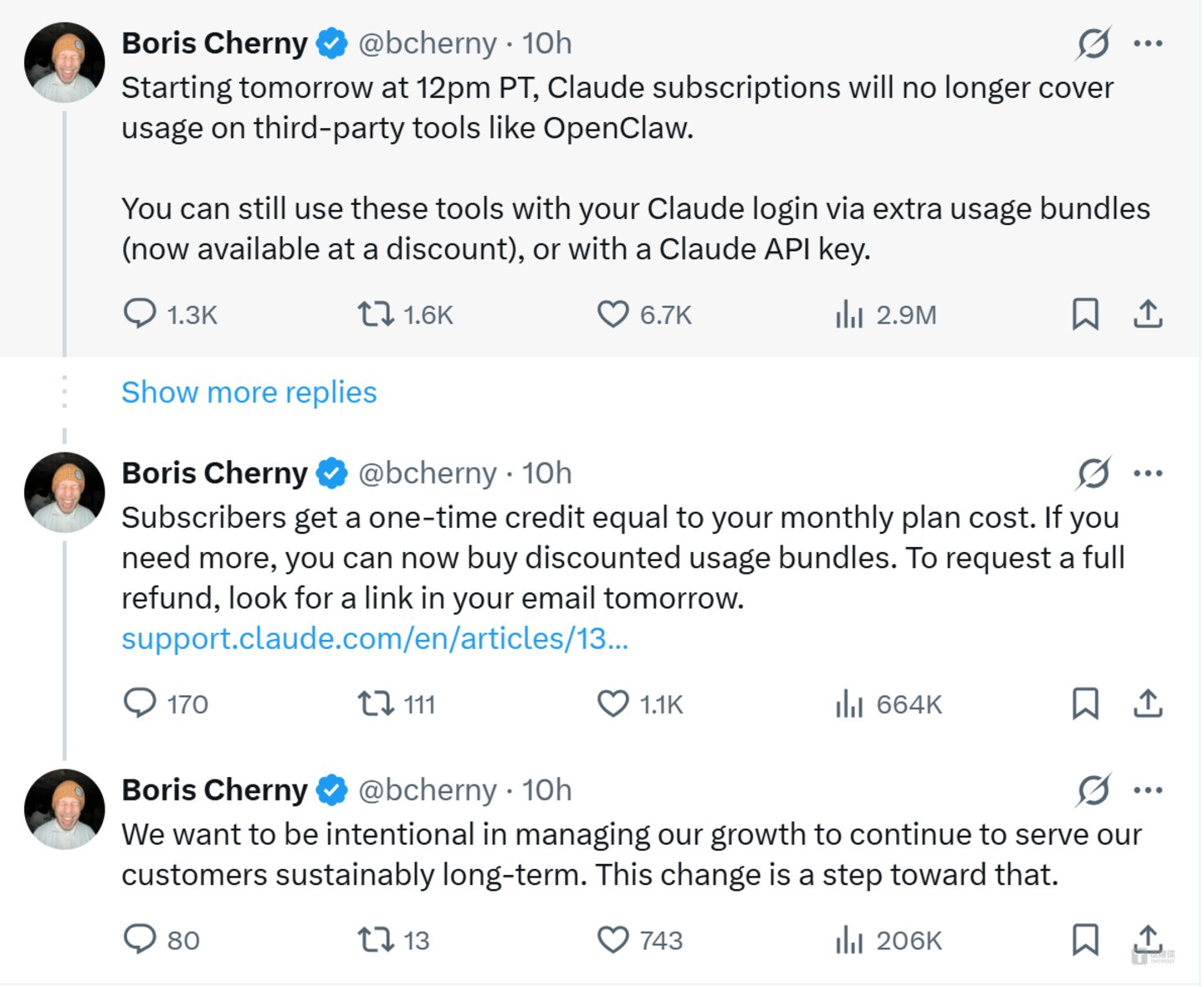

业界分析显示,同样每月200美元的Max订阅,OpenClaw用户实际消耗的算力价值约为5000美元。这种"结构性亏损"对于正在大规模扩张算力基础设施的Anthropic来说难以持续。该公司在发给用户的邮件中明确表示:"容量是我们需要精心管理的资源,必须优先保障使用核心产品的用户体验。"

技术演进与策略部署

Anthropic对OpenClaw的限制并非突然决策,而是一场持续数月的系统性收网。从时间线来看:

- 2025年11月,OpenClaw初版发布后即遭遇商标侵权警告

- 2025年9月开始服务端封锁部分OAuth Token的外部调用

- 2026年1月全面执行Token限制,第三方工具API调用返回401报错

- 2026年2月至3月,Anthropic密集发布Dispatch、Claude Code Channels等功能,精准对标OpenClaw的核心能力

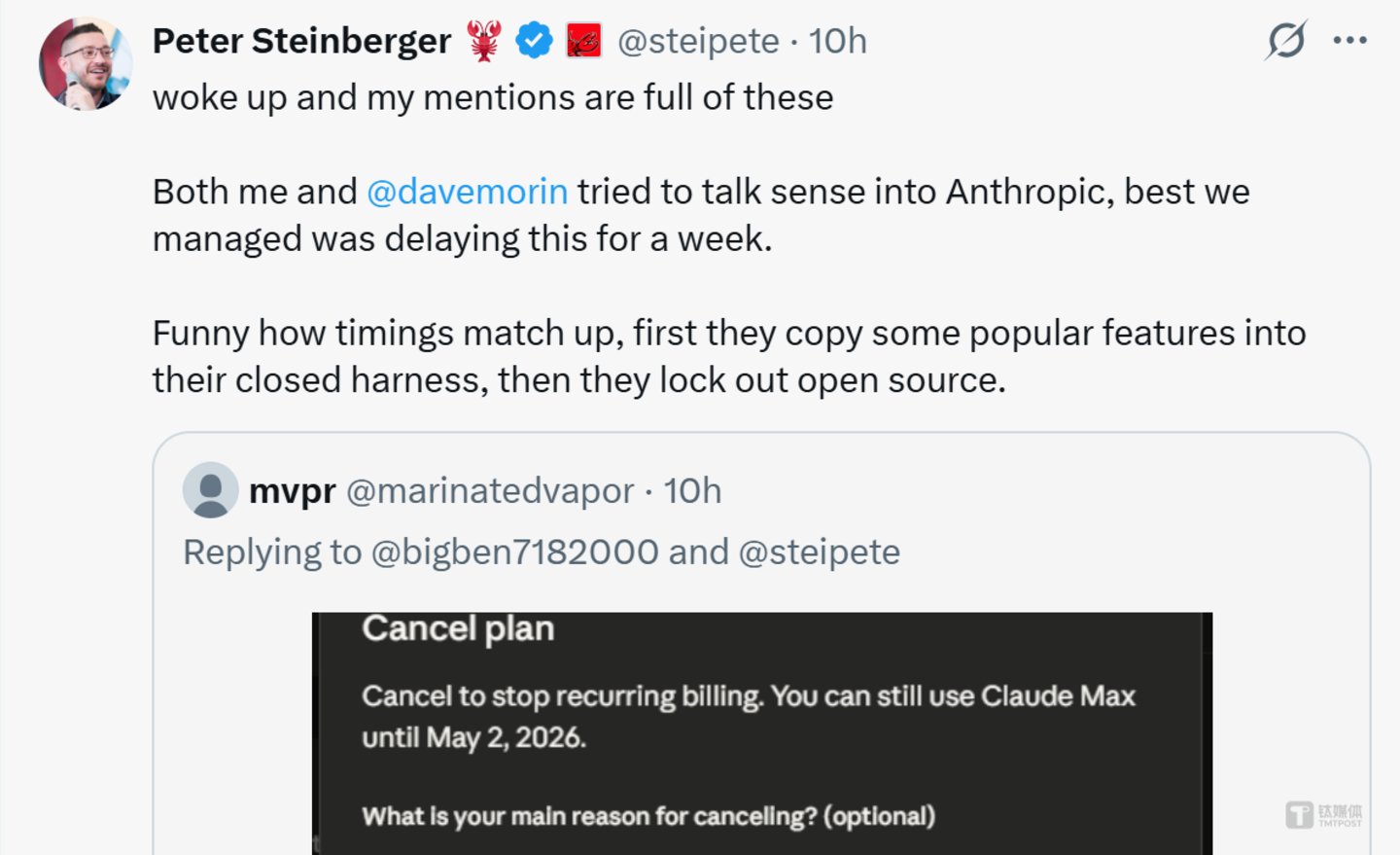

这种"功能复制+技术封堵"的组合策略,体现了Anthropic在生态控制上的系统性思考。公司一方面通过自有产品提供类似功能,另一方面逐步收紧第三方工具的访问权限。

行业生态影响分析

OpenClaw案例反映了AI产业发展的深层矛盾。从技术理想角度看,AI模型应该作为公共基础设施,编排层保持开放和跨模型兼容。但商业现实是,大模型厂商投入巨额资金训练基础模型,不可能甘心只做被调用的"管道"。

这种矛盾在多个层面显现:

- 成本结构失衡:固定价格订阅制与可变算力成本之间的 mismatch

- 生态控制权:平台方与第三方开发者之间的权力博弈

- 技术创新与商业回报:开源理想与盈利需求的冲突

开发者社区需要认识到,过度依赖单一AI平台的订阅额度构建产品存在显著风险。Anthropic的决策虽然短期内影响了部分用户,但从商业角度看具有合理性。

技术架构深度解析

OpenClaw的成功很大程度上归功于其独特的技术架构。该工具完全由Claude代劳生成代码,创始人Peter Steinberger公开表示"一行代码都没有亲自写过"。这种"AI构建AI"的模式展现了当前AI技术的成熟度,但也暴露了平台方对衍生工具控制力的局限性。

从技术实现角度看,OpenClaw的优化体现在多个维度:

- 请求效率:每次对话向Anthropic发送的请求数量极少

- 无遥测事件:减少了不必要的监控数据上传

- 持久化运行:支持7×24小时不间断任务执行

- 多Agent并发:单个账号可同时运行10个Agent实例

这种高度优化的使用模式虽然提升了用户体验,但也导致了算力资源的过度消耗。

行业趋势与未来展望

Anthropic此次决策可能预示着AI行业的发展方向:

- 平台主权强化:大模型厂商将加强对生态的控制权

- 定价模式创新:纯订阅制可能向混合计费模式转变

- 跨平台兼容性:开发者需要更多考虑多模型支持策略

- 开源替代方案:社区可能推动更独立于商业平台的开源方案

从长远看,AI行业需要在开放生态与商业可持续性之间找到平衡点。当前按量计费的模式虽然解决了成本问题,但可能抑制创新活力。理想的解决方案可能是建立更加细粒度的计费机制,既能反映实际资源消耗,又不给开发者造成过重负担。

开发者应对策略

面对平台政策变化,开发者社区需要调整策略:

- 多元化技术栈:避免过度依赖单一AI平台

- 成本优化设计:在应用架构层面考虑算力效率

- 商业模式创新:探索与平台方共赢的合作模式

- 社区协作:加强开发者之间的经验分享和资源整合

具体而言,开发者可以考虑以下技术方向:

- 采用多模型路由策略,根据任务需求选择最合适的AI模型

- 优化提示工程和缓存机制,减少不必要的API调用

- 探索边缘计算与AI结合的可能性,降低云端算力依赖

- 参与开源AI项目,推动更加开放的生态建设

产业影响深度分析

Anthropic此次决策的影响将超越单个案例,对整个AI产业产生深远影响:

对创业公司的影响:依赖大模型API的初创公司需要重新评估商业模式。单纯基于"薅羊毛"式的成本优势难以持续,必须建立真正的技术壁垒和商业价值。

对投资方向的影响:风险投资可能更倾向于支持具有自主技术能力的AI公司,而非单纯的应用层创新。底层技术、算力优化、多模型管理等方向可能获得更多关注。

对技术发展的影响:这一事件可能加速AI技术在以下几个方向的发展:模型压缩、推理优化、边缘AI、联邦学习等降低算力依赖的技术。

对标准制定的影响:行业可能需要建立更加规范的API使用标准和计费模式,避免类似的"公地悲剧"问题重复发生。

伦理与治理考量

这一事件也引发了关于AI治理的思考:

- 平台责任边界:AI平台在生态治理中应该承担何种责任

- 开发者权益:如何保障第三方开发者的创新空间

- 用户利益平衡:在平台利益与用户权益之间如何取得平衡

- 行业自律:是否需要建立行业性的使用规范和伦理准则

这些问题的讨论将有助于形成更加健康、可持续的AI生态系统。

技术解决方案探讨

针对当前困境,技术社区可能推动以下解决方案:

分布式计算架构:通过分布式节点分担算力压力,降低对中心化平台的依赖。

模型资源共享:建立模型资源共享机制,提高算力利用效率。

自适应计费模式:开发更加智能的计费系统,根据使用模式和价值创造动态调整费率。

开源模型生态:推动开源模型的发展和应用,减少对商业平台的依赖。

这些技术方向的探索将有助于构建更加 resilient 的AI应用生态。

国际比较视角

从全球视角看,不同地区的AI平台采取了不同的生态策略:

- 美国平台:倾向于建立相对封闭但功能完善的生态系统

- 中国平台:更多采用开放合作模式,但同样面临算力成本压力

- 欧洲平台:强调合规性和数据隐私,生态建设相对谨慎

- 开源社区:推动完全开放的替代方案,但商业化能力有限

这种多样性反映了不同市场环境和技术文化下的策略选择,也为开发者提供了更多元的选择空间。

未来展望

AI行业仍处于快速发展阶段,当前的生态矛盾是成长过程中的必然现象。随着技术进步和商业模式创新,我们有望看到更加平衡的解决方案出现。

关键的发展方向包括:

- 算力效率提升:通过硬件创新和算法优化持续降低计算成本

- 商业模式演进:探索更加符合AI技术特点的收费模式

- 生态治理完善:建立更加透明和公平的平台治理机制

- 跨平台标准:推动行业标准的制定和实施

这些发展将共同推动AI技术更好地服务于人类社会,同时保障各参与方的合法权益。