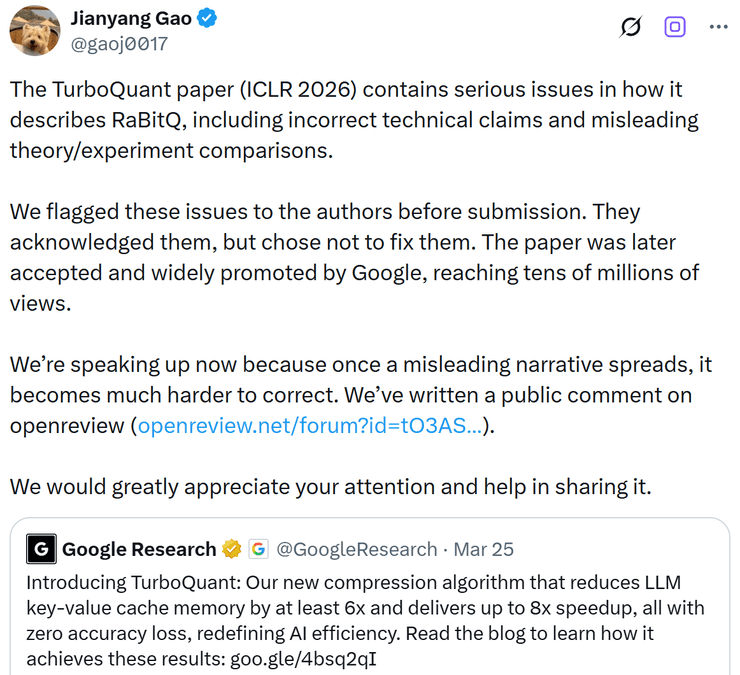

近期AI学术圈因TurboQuant论文争议而掀起波澜。谷歌研究团队高调宣称这项技术能显著降低大模型推理成本,并将其定位为ICLR 2026的突破性工作。然而,先行工作RaBitQ的作者高健阳在社区平台公开质疑,指出该论文在方法描述、理论比较和实验披露方面存在严重问题。

争议焦点的技术层面分析

从技术角度看,TurboQuant争议主要集中在三个核心问题:

方法关联性的模糊处理 TurboQuant是否刻意弱化了与RaBitQ的关键方法关系?这是争议的核心。在AI量化压缩领域,方法的演进往往建立在前期工作的基础上,但如何恰当引用和承认先行工作的重要性,直接关系到学术诚信。

理论表述的公正性问题 论文将RaBitQ的理论描述为"suboptimal",这一判断是否基于充分的实验证据和理论分析?学术论文中的比较性表述需要严谨的数据支撑,否则容易引发对研究客观性的质疑。

实验设置的公平性考量 实验比较设置是否存在对自身有利而对先行工作不利的安排?这涉及到研究设计的透明度问题。在AI领域,实验设置的不同可能显著影响结果的可比性。

大厂学术影响力的结构性优势

TurboQuant争议之所以引发广泛关注,是因为它揭示了一个更深层次的问题:在今天的AI学术生态中,大厂拥有定义"突破"的优先权。

发布渠道的优势 谷歌通过官方博客、顶会标签和品牌影响力,能够率先将研究成果包装成"突破性"进展。这种先发优势使得市场和学界最先接触到的往往是大厂版本的故事叙述。

品牌信用的放大效应 大厂的品牌信用为其研究成果提供了额外的可信度加成。即使存在争议,这种品牌效应也能在一定程度上缓冲质疑声音的影响。

资源分配的不均衡 小团队和独立研究者往往缺乏相应的资源来对抗这种结构性优势。他们需要在评论区、社交平台等非正式渠道进行漫长的举证和解释过程。

历史案例的警示意义

TurboQuant争议并非孤立事件,而是谷歌历史上类似争议的延续。

Timnit Gebru事件 2020年,谷歌伦理AI研究员Timnit Gebru因质疑公司对大模型风险论文的审查而被迫离开。这一事件引发了150多名员工的联署抗议,要求谷歌解释其学术自由政策。

内部审查机制的曝光 路透社报道披露,谷歌对"敏感主题"研究增加了额外审查层,要求研究者在某些议题上先与法务、政策和公关团队沟通。这种将公司利益置于研究独立性之上的做法,引发了学术界的广泛担忧。

AlphaChip争议的启示 2022年,谷歌在Nature发表的芯片布局论文宣称AI优于人类专家,但内部流出的反驳稿却显示基础方法在某些标准下表现更优。这一事件表明,大厂可能存在压制不利于自身叙事的研究发现的现象。

学术生态的结构性变迁

当前AI学术生态正在经历深刻的结构性变化,这些变化进一步强化了大厂的学术影响力。

资金投入的差距扩大 根据Science 2023年的研究,2021年全球产业界AI投入超过3400亿美元,远高于公共部门。这种资金差距直接影响了研究资源的分配和研究方向的选择。

人才流动的集中化趋势 Nature 2025年的数据显示,谷歌成为学者转向私营研究岗位时的首选目的地。2020-2024年间接近2500次的人才流动进一步强化了大厂在学术领域的影响力。

论文作者的产业背景增强 带有产业共同作者的论文在顶级AI会议中的占比从2000年的22%上升到2020年的38%。这种趋势反映了学术界与产业界界限的模糊化。

同行评审系统的挑战

当前AI领域的同行评审系统面临着前所未有的压力,这进一步加剧了小团队面临的不利处境。

评审质量的下降 ICML 2025的获奖立场论文指出,主要AI会议的投稿量已超过每个venue一万篇,审稿质量和评审责任问题都在恶化。这种数量压力可能导致评审深度的不足。

纠错机制的弱化 当大厂率先通过官方渠道发布研究成果时,小团队在正式学术流程中获得及时、公正纠偏的机会正在减少。评审系统可能无法有效应对这种先发优势带来的影响。

举证成本的不均衡分配 小团队需要承担更高昂的举证成本来证明自身工作的原创性和重要性。这种不对称的负担进一步加剧了学术生态的不平等。

学术权力的新型运作机制

大厂学术霸权的运作不再依赖于传统的学术造假,而是通过更加成熟和隐蔽的方式进行。

叙事框架的先发控制 大厂能够率先定义研究的重要性和突破性,通过精心设计的叙事框架影响学界和公众的认知。这种先发优势往往难以在事后被完全纠正。

研究议程的隐性引导 通过资助关系和品牌吸引力,大厂能够间接影响整个学界的研究方向选择。这种影响虽然不明显,但却能深刻塑造学术发展的轨迹。

审查机制的内嵌化 将公司利益考量嵌入研究流程的做法,使得学术研究的独立性面临挑战。这种内嵌化的审查机制往往难以从外部察觉和纠正。

建立更公平学术生态的路径

面对大厂学术霸权的问题,需要从多个层面推动学术生态的公平化改革。

强化学术透明度要求

- 建立更严格的方法关联性披露标准

- 要求论文明确说明与相关工作的技术关系

- 加强实验设置和比较基准的透明度

完善同行评审机制

- 建立针对大厂论文的特殊评审流程

- 加强评审过程中的利益冲突审查

- 提升小团队研究成果的可见度

促进学术资源的均衡分配

- 增加公共部门对AI研究的投入

- 建立支持独立研究者的资助机制

- 推动学术资源的开放共享

学术共同体责任的重构

学术共同体需要在新的环境下重新定义自身的责任和角色。

评审责任的强化 审稿人需要更加警惕大厂论文可能存在的叙事偏差和方法关联性模糊问题。加强对论文技术细节和引用关系的审查。

学术标准的坚守 学术界需要坚守客观公正的学术标准,不因作者背景而降低评审要求。同时要勇于指出大厂论文中可能存在的问题。

社区监督机制的建立 发展更加有效的社区监督机制,通过开放讨论和同行评议来制衡大厂的学术影响力。

技术发展与学术伦理的平衡

在AI技术快速发展的背景下,如何平衡技术创新与学术伦理成为一个重要课题。

创新认可与学术规范的协调 既要鼓励技术创新,又要维护学术规范。需要在两者之间找到适当的平衡点,避免因追求突破而牺牲学术诚信。

商业利益与学术独立的界限 明确商业利益与学术独立之间的界限,建立有效的防火墙机制。确保学术研究不受不当的商业考量影响。

长期价值与短期利益的权衡 学术界需要关注研究的长期价值,而非仅仅追求短期的技术突破和商业回报。这种长远视角对于健康的学术生态至关重要。

TurboQuant争议为我们提供了一个重要的反思机会。它不仅仅是一个技术争议,更是对整个AI学术生态健康状况的检验。面对大厂学术霸权的问题,需要学术界、产业界和监管机构的共同努力,才能建立更加公平、透明和健康的学术环境。

这种改革不仅关乎学术公平,更关系到AI技术发展的长期健康。只有在公平竞争的环境中,真正有价值的技术创新才能获得应有的认可和发展空间。