深度学习环境搭建的重要性

在当前人工智能技术快速发展的背景下,掌握深度学习环境搭建技能已成为AI从业者的基本要求。一个稳定高效的开发环境不仅能提升模型训练效率,还能避免因环境问题导致的项目延误。本文将从硬件选型开始,逐步讲解完整的深度学习环境搭建流程。

硬件配置深度解析

处理器选择标准

CPU在深度学习工作流中主要承担数据预处理、模型加载和系统调度等任务。对于个人学习和小型项目,建议选择多核心、高主频的处理器:

- Intel平台:Core i7/i9系列(如i7-12700K以上)

- AMD平台:Ryzen 7/9系列(如Ryzen 7 5800X以上)

这些处理器在核心数量、主频和性价比之间取得了良好平衡,能够满足大多数入门及中级需求。虽然理论上CPU可以运行简单的深度学习示例,但在实际项目中强烈建议使用GPU进行加速。

内存配置建议

内存容量直接影响数据处理和模型训练的流畅度:

- 最低要求:8GB(仅适用于小型数据集和简单模型)

- 推荐配置:16GB(满足大多数学习需求)

- 理想配置:32GB或64GB(支持大规模数据集和复杂模型)

特别是生成式AI应用,对内存容量要求较高,充足的内存可以避免频繁的数据交换,显著提升训练效率。

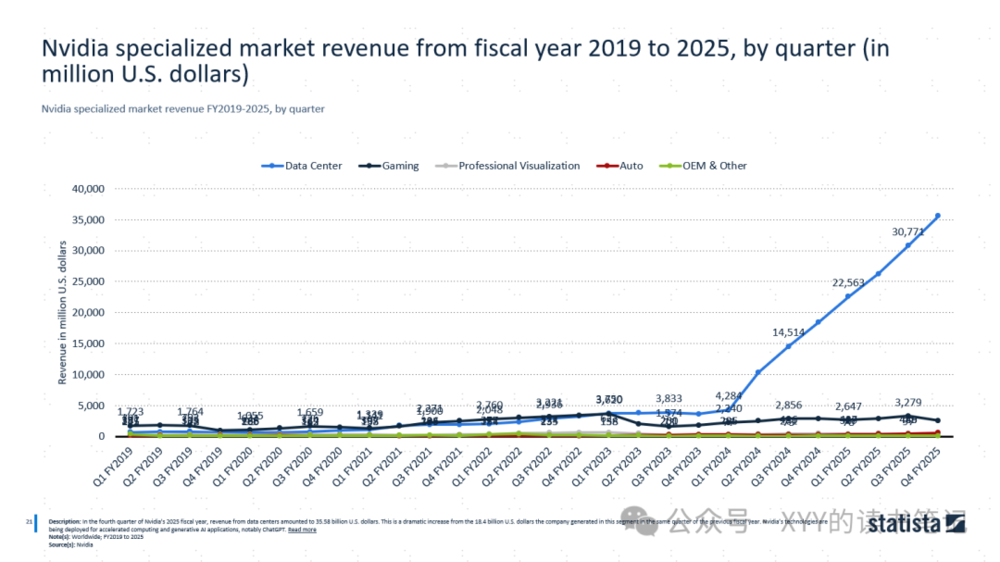

显卡选型关键

GPU是深度学习的算力核心,NVIDIA显卡因其完善的CUDA生态成为首选:

- 入门级:NVIDIA GeForce RTX 3060(8GB/12GB显存)

- 进阶选择:RTX 4070/4080或TITAN系列

- 专业级:NVIDIA A100/H100等数据中心显卡

操作系统选择与配置

Windows系统优化

Windows 10/11是目前最流行的深度学习开发平台,配置相对简单:

- 确保系统为64位版本

- 更新至最新系统版本

- 启用开发者模式

- 配置合适的电源管理模式

Linux系统优势

对于追求极致性能的用户,Linux系统具有明显优势:

- 更好的资源管理效率

- 更稳定的长时间运行

- 更灵活的配置选项

- 原生支持大多数深度学习工具

macOS适用场景

苹果系统适合移动端模型开发和轻量级实验:

- 统一的开发体验

- 优秀的稳定性

- 强大的终端工具

- 但对GPU加速支持有限

开发工具链完整配置

Anaconda环境管理

Anaconda是Python开发环境管理的首选工具,提供了完整的包管理和虚拟环境功能。

基础环境操作

创建和管理虚拟环境是深度学习项目的基础:

conda create --name dl_env python=3.10

conda activate dl_env

conda install numpy pandas matplotlib jupyter镜像源配置

国内用户建议配置镜像源加速下载:

conda config --add channels https://mirrors.tuna.tsinghua.edu.cn/anaconda/pkgs/main

conda config --add channels https://mirrors.tuna.tsinghua.edu.cn/anaconda/pkgs/free

conda config --set show_channel_urls yesPyCharm开发环境

PyCharm提供了强大的代码编辑和项目管理功能:

- 智能代码补全:基于深度学习的代码建议

- 集成终端:直接在IDE中运行命令

- 版本控制:Git集成支持

- 远程开发:连接服务器进行开发

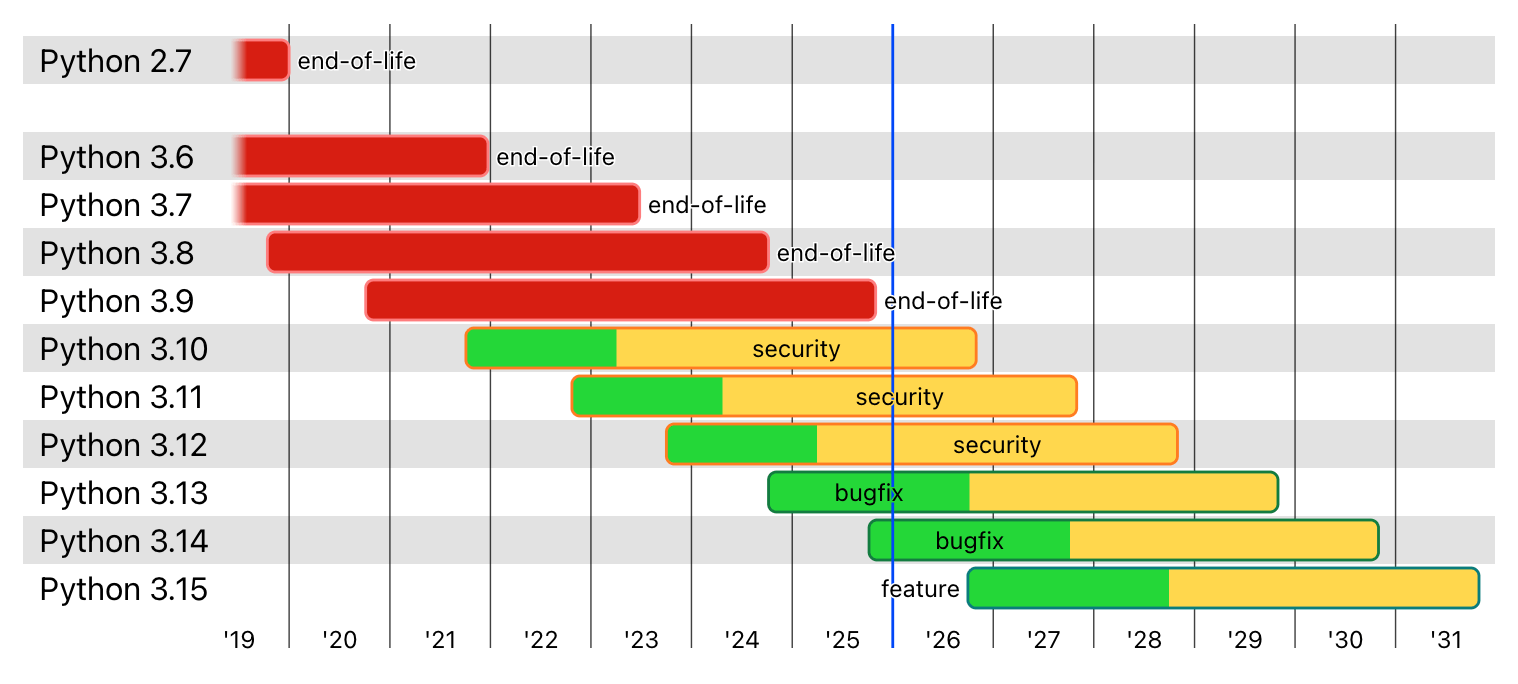

Python版本选择

建议使用Python 3.8-3.10版本,这些版本在稳定性和新特性之间取得了良好平衡。避免使用过于陈旧的Python 2.x系列或最新的测试版本。

PyTorch框架深度配置

PyTorch安装方法

根据硬件配置选择合适的安装命令:

pip install torch torchvision torchaudio

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118

conda install pytorch torchvision torchaudio pytorch-cuda=11.8 -c pytorch -c nvidia验证安装结果

安装完成后需要进行验证:

import torch

print(f"PyTorch版本: {torch.__version__}")

print(f"CUDA可用: {torch.cuda.is_available()}")

print(f"GPU数量: {torch.cuda.device_count()}")

print(f"当前GPU: {torch.cuda.current_device()}")

print(f"GPU名称: {torch.cuda.get_device_name(0)}")CUDA和cuDNN配置

检查CUDA版本

nvcc --version下载对应版本cuDNN

从NVIDIA开发者网站下载与CUDA版本匹配的cuDNN库,解压后复制到CUDA安装目录。

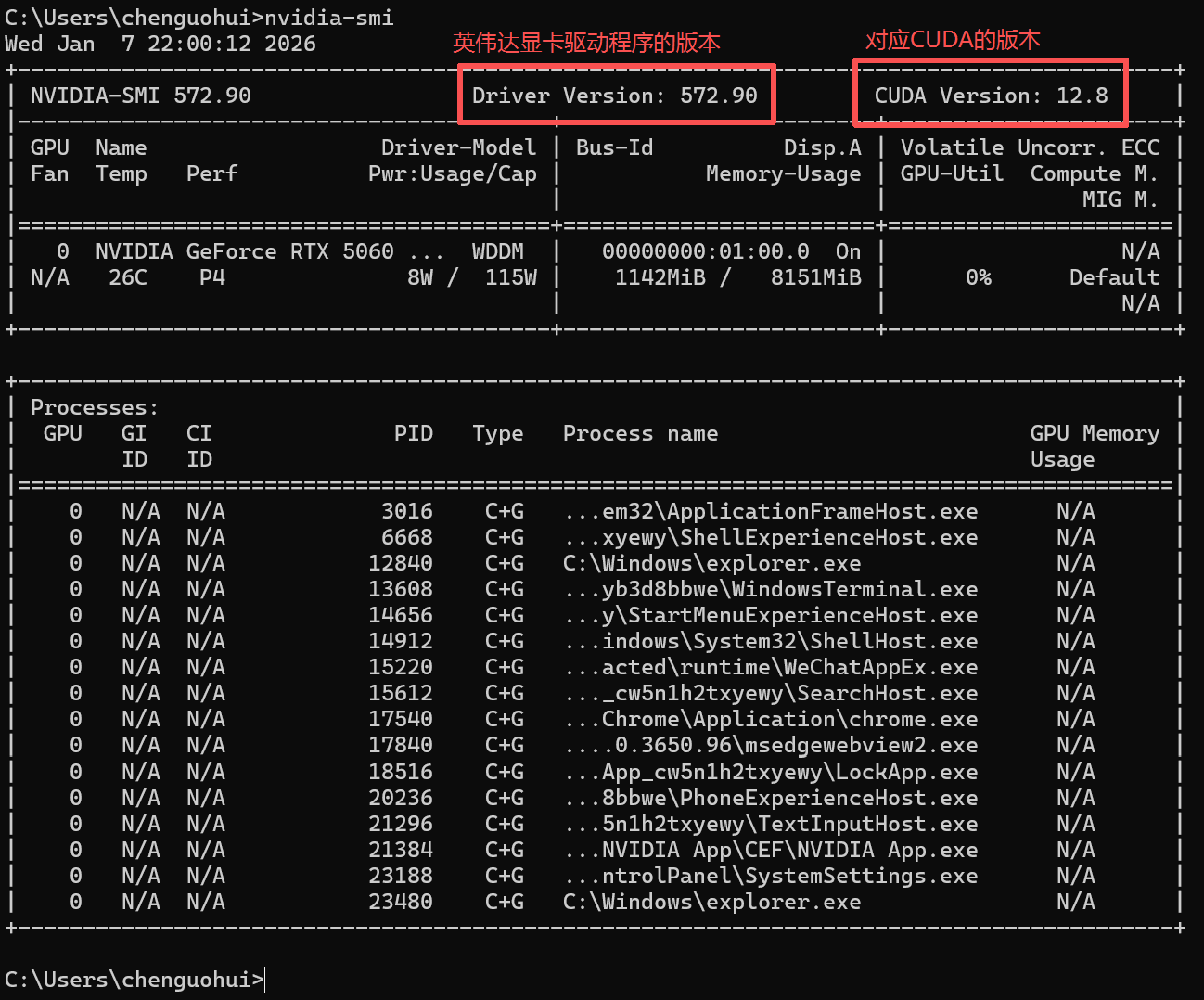

NVIDIA驱动完整配置流程

驱动程序检查

通过设备管理器确认显卡型号和当前驱动版本:

- 右键点击"此电脑"选择"管理"

- 进入"设备管理器"→"显示适配器"

- 查看NVIDIA显卡型号

驱动下载安装

- 访问NVIDIA官方网站驱动程序下载页面

- 根据显卡型号和操作系统选择合适版本

- 下载Studio驱动或Game Ready驱动

- 运行安装程序,选择"自定义安装"

- 勾选"执行清洁安装"选项

驱动验证

安装完成后通过命令行验证:

nvidia-smi该命令应显示GPU信息、驱动版本和运行状态。

常见问题与解决方案

环境冲突问题

不同项目可能依赖不同版本的库,建议为每个项目创建独立的虚拟环境:

conda create --name project_name python=3.9

conda activate project_name

conda env export > environment.yml

conda env create -f environment.ymlGPU内存不足

当遇到GPU内存不足时可以考虑以下解决方案:

- 减小批次大小(batch size)

- 使用梯度累积

- 启用混合精度训练

- 使用内存优化器

- 考虑模型剪枝或量化

性能优化技巧

数据加载优化

使用DataLoader的多进程加载:

from torch.utils.data import DataLoader

dataloader = DataLoader(

dataset,

batch_size=32,

shuffle=True,

num_workers=4, # 根据CPU核心数调整

pin_memory=True # 加速GPU数据传输

)训练过程优化

torch.backends.cudnn.benchmark = True

from torch.cuda.amp import autocast, GradScaler

scaler = GradScaler()

with autocast():

output = model(input)

loss = criterion(output, target)进阶配置与最佳实践

多GPU训练配置

对于拥有多张GPU的用户,可以配置分布式训练:

import torch.nn as nn

import torch.distributed as dist

dist.init_process_group(backend='nccl')

model = nn.parallel.DistributedDataParallel(model)环境自动化脚本

创建自动化配置脚本简化环境搭建:

#!/bin/bash

conda create -y -n dl_env python=3.9

conda activate dl_env

pip install torch torchvision torchaudio

pip install jupyter matplotlib pandas scikit-learn

pip install -r requirements.txt

echo "环境配置完成"性能监控工具

配置性能监控确保资源合理利用:

- GPU监控:nvidia-smi、gpustat

- 系统监控:htop、nmon

- 训练可视化:TensorBoard、WandB

实际项目部署案例

图像分类项目环境

以图像分类为例的完整环境配置:

conda create -n image_classification python=3.9

conda activate image_classification

pip install torch==1.13.1 torchvision==0.14.1 torchaudio==0.13.1

pip install opencv-python pillow albumentations

pip install tensorboard jupyterlab自然语言处理项目

NLP项目的特定环境配置:

conda create -n nlp_project python=3.8

conda activate nlp_project

pip install transformers datasets

pip install torch accelerate

pip install nltk spacy gensim持续学习与资源推荐

官方文档资源

- PyTorch官方文档:https://pytorch.org/docs/stable/index.html

- TensorFlow官方指南:https://www.tensorflow.org/guide

- NVIDIA开发者中心:https://developer.nvidia.com/

社区学习平台

- Kaggle:实战项目和竞赛平台

- GitHub:开源项目和学习资源

- Papers with Code:最新论文和代码实现

进阶学习路径

- 基础掌握:环境配置、基本模型训练

- 项目实践:参与实际项目积累经验

- 性能优化:学习模型压缩、加速技术

- 领域深入:选择计算机视觉、NLP等方向深耕

通过系统性的环境搭建和持续学习,开发者能够建立起坚实的深度学习开发基础,为后续的AI项目开发奠定良好基础。