Token消耗的现实困境

近期AI领域的Token讨论呈现出一种矛盾现象:一方面技术厂商大力推广Token使用,另一方面用户群体对高昂成本望而却步。这种矛盾背后反映的是AI技术商业化过程中的深层次问题。

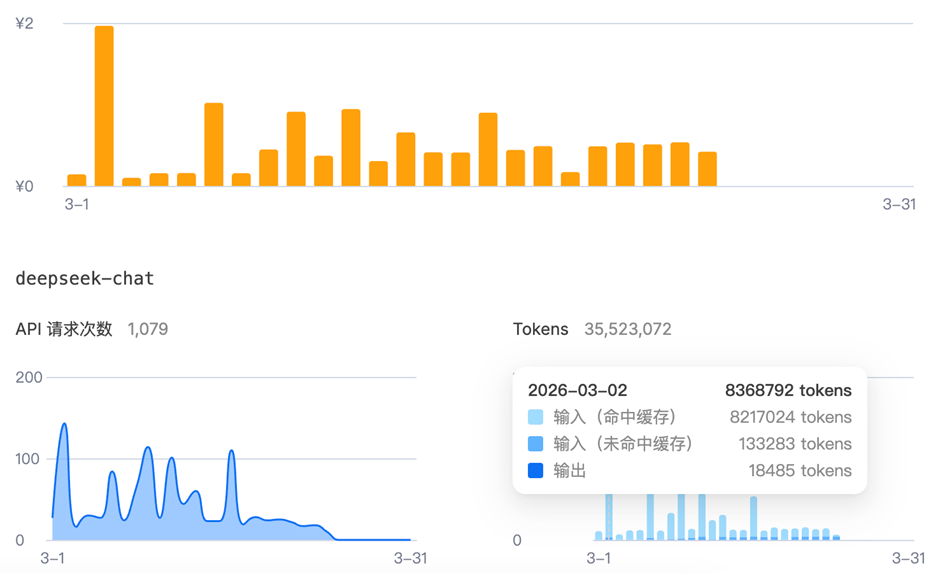

从实际使用场景来看,简单的日常对话确实成本可控,但一旦涉及复杂任务,Token消耗量就会呈指数级增长。生成视频、创作短剧等应用场景的单次消耗可达千万级Token,这种量级的费用对于普通用户而言难以承受。

存储成本的结构性挑战

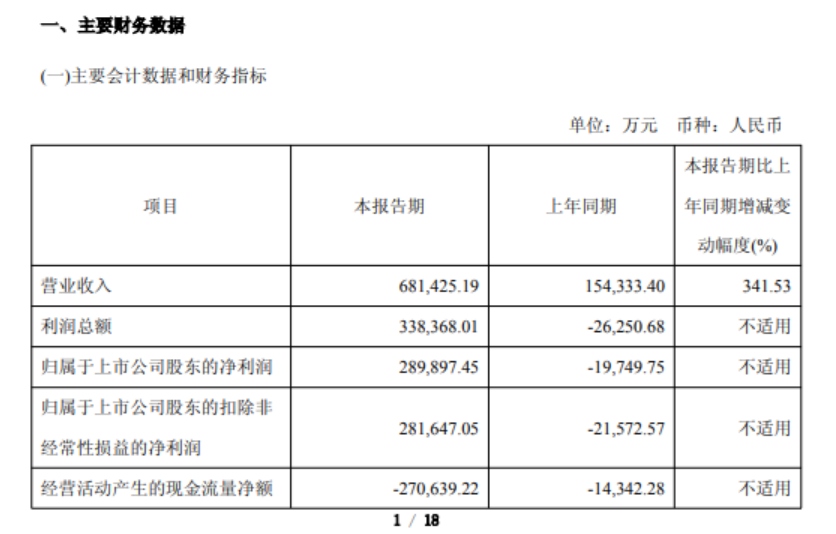

当前AI发展面临的一个关键瓶颈是存储成本的大幅上涨。HBM内存作为大模型训练和推理的核心组件,其价格在2026年第一季度环比涨幅超过50%,NAND价格最高涨幅达到150%。这种上涨趋势直接传导至Token定价环节。

存储原厂与头部客户的战略长约已签至5年,这意味着短期内价格回落的可能性极低。云厂商在成本压力下不得不考虑涨价,这与用户期望的成本下降形成鲜明对比。

技术优化的成本空间

模型能力的提升为成本优化提供了技术基础。研究表明,小模型性能正在快速逼近全量大模型,这为成本控制创造了条件。面壁智能与清华团队提出的Densing Law表明,大模型能力密度每3.5个月翻一倍,同等性能所需参数量相应减半。

MFU(模型浮点运算利用率)的提升是另一个重要方向。目前主流大模型的推理MFU均值仅为30%左右,通过算子和调度策略优化,可提升至50%以上,这意味着潜在的成本节约空间达到50%。但技术优化能否转化为实际的价格优势,还取决于厂商的商业策略。

价格战的历史与现状

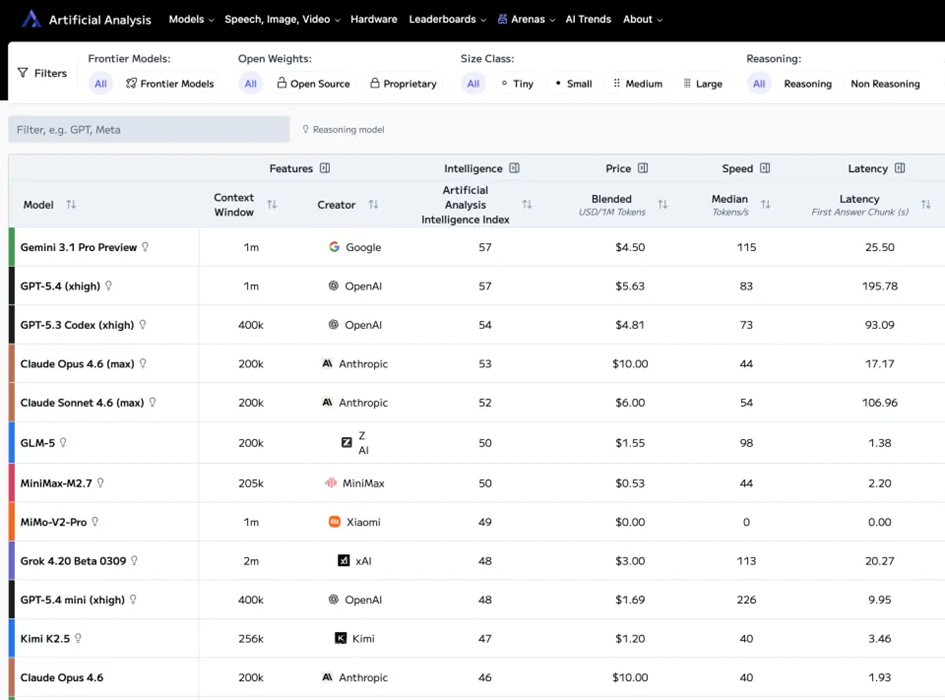

回顾2024年的价格战,DeepSeek-V2以每百万Token输入1元、输出2元的价格引发行业震动,相当于当时GPT-4-Turbo价格的百分之一。这场价格战的特点是直接面向生产力供给的B端市场。

然而当前的市场环境已发生显著变化。Token消耗量的大幅增长使得价格战的风险更高,厂商更倾向于保持现有定价策略。Artificial Analysis的数据显示,虽然国产模型API单价已有明显优势,但对于Agent应用的巨量消耗而言,仍显不足。

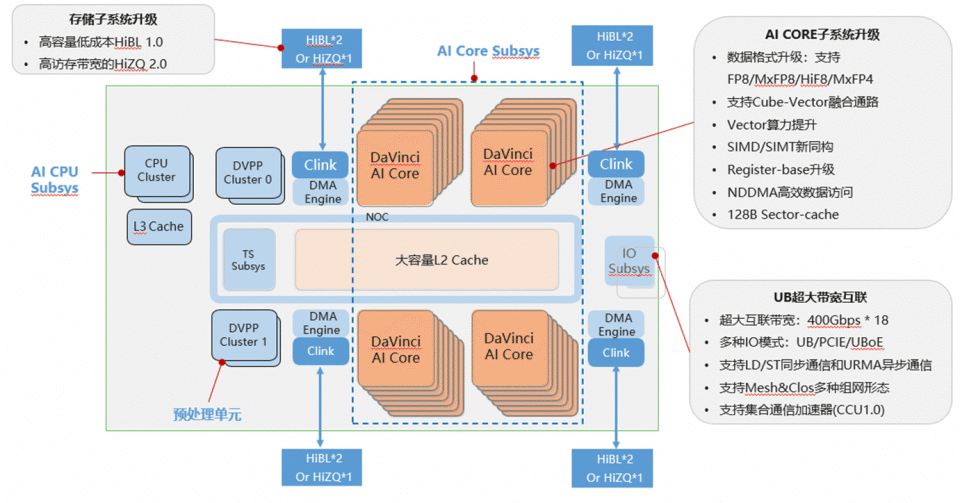

硬件创新的突破尝试

面对成本压力,硬件层面出现了多种创新方案。本地部署模型虽然能避免持续的API费用,但前期投入门槛较高。EdgeClaw等边缘AI硬件试图在成本和安全之间寻找平衡点。

Taalas团队推出的HC1芯片采用将模型权重硬编码固化在硅片上的设计,实现了计算与存储的物理融合。这种专芯专用方案虽然性能突出,但模型灵活性的牺牲也限制了其应用范围。

成本效益的理性评估

在实际应用场景中,Token消耗的经济性需要客观评估。以生成gif为例,如果单张成本达到几元,与传统手工制作相比并不具备经济优势。这种对比凸显了当前AI应用在成本控制方面的不足。

行业需要建立更科学的投入产出评估体系,避免盲目追求Token消耗量。技术推广应当以实际价值创造为导向,而非单纯强调使用量。

行业生态的协同发展

解决Token成本问题需要整个行业生态的协同努力。技术厂商需要在追求商业利益的同时,考虑技术的普及性;用户群体需要建立理性的使用预期;监管层面则需要为技术创新提供适当的政策支持。

未来AI技术的发展方向应当是效率提升与成本控制的平衡。只有在经济可行性的基础上,AI技术才能真正实现大规模普及和应用。

技术演进的市场影响

随着模型优化技术的不断进步,Token成本有望逐步下降。但这一过程需要时间,且受到硬件成本、能源价格等多重因素影响。行业参与者需要做好长期准备,在技术演进和市场变化中寻找最佳平衡点。

从长远来看,AI技术的普及不仅依赖于技术本身的进步,更需要建立可持续的商业模式。只有在成本可控的前提下,AI才能真正赋能各行各业,实现技术价值的最大化。