技术驱动的诈骗工业化转型

人工智能技术正在重塑网络诈骗的运作模式。传统诈骗受限于人力成本和真实性约束,而现在的AI技术实现了诈骗的工业化生产。扩散模型的应用让虚拟形象生成变得异常简单,只需输入几个关键词,就能在几秒钟内创造出无懈可击的虚拟人物。

这种技术突破不仅体现在图像质量上,更重要的是实现了规模化生产。一个操作者可以同时管理上百个虚拟账号,每个账号都拥有独特的形象和人设背景。从金融精英到家庭主妇,从背包客到艺术从业者,各种角色应有尽有。

大语言模型的情感操控能力

当AI美女被赋予"大脑"后,诈骗进入了全新阶段。大语言模型通过分析海量社交内容和心理学资料,能够生成极具说服力的对话内容。这些AI系统不仅能够模仿人类对话模式,更能通过自然语言处理技术识别受害者的情绪状态。

情感计算技术的加入使得诈骗话术更具针对性。系统能够实时分析文本中的情绪波动,针对不同心理状态生成相应的回应。当受害者表现出孤独感时,AI会提供情感安慰;当受害者显露出财富信息时,AI会设计相应的理财陷阱。

技术门槛降低与产业生态形成

暗网上的AI素材交易已经形成完整产业链。一套包含数千张同一虚拟人物不同生活场景的照片、视频以及配套的AI变声包,售价仅需几百元。这种低门槛使得诈骗技术迅速普及。

诈骗团伙建立了标准化的操作流程:

- 利用AI生成工具创建虚拟形象

- 通过大语言模型维护社交账号内容

- 使用语音克隆技术制作个性化音频

- 应用实时换脸技术进行视频通话

- 设计完整的诈骗话术剧本

社会影响与信任危机

这种工业化诈骗模式对社会信任体系造成严重冲击。当人们无法分辨屏幕另一端是真实人类还是AI程序时,线上社交的基础将被动摇。受害者不仅遭受经济损失,更承受着深刻的心理创伤。

数据显示,AI诈骗案件的涉案金额年均增长超过40%。这种增长趋势反映出技术滥用带来的严重社会问题。我们需要从技术防范、法律监管和公众教育多个层面构建防护体系。

技术防范与应对策略

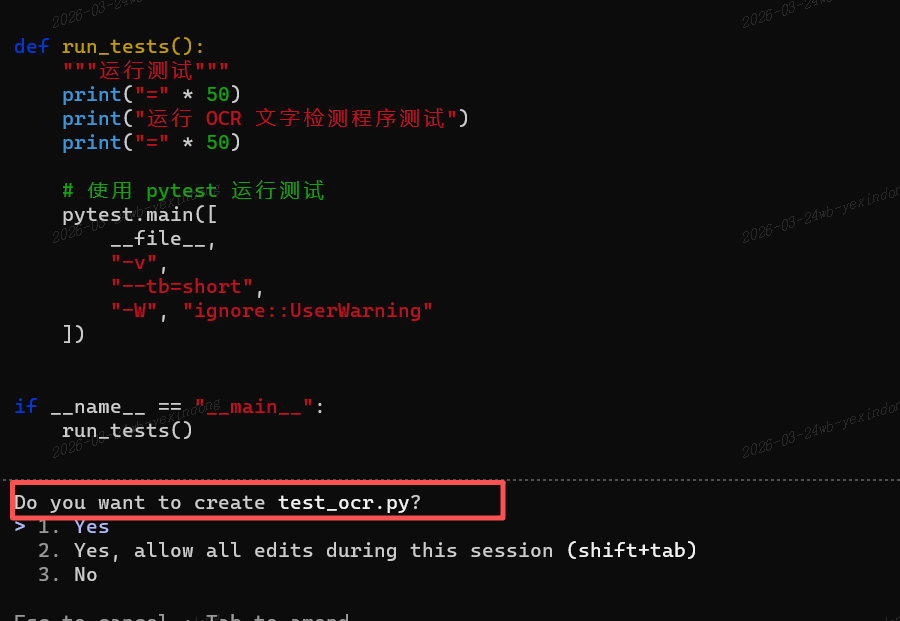

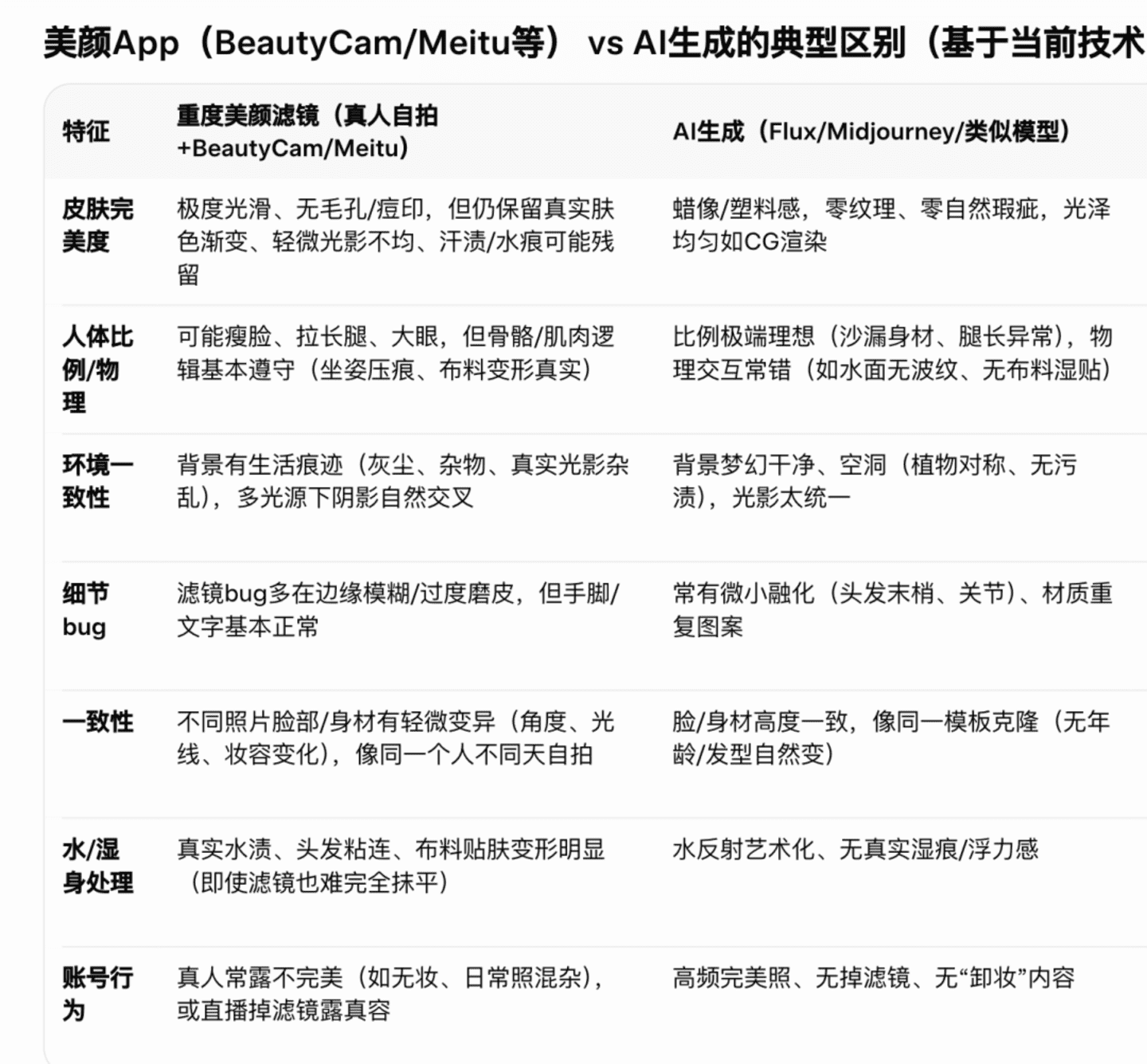

面对AI诈骗的威胁,需要采取多层次防护措施。在技术层面,开发AI内容检测工具至关重要。这些工具能够通过分析图像细节、语音特征和文本模式,识别AI生成内容。

企业平台需要加强账号验证机制,特别是针对高价值账号的认证。同时建立可疑行为监测系统,通过分析互动模式识别潜在诈骗账号。

个人用户需要提高安全意识,特别是在涉及金钱往来时保持警惕。以下防范要点值得注意:

- 谨慎对待突如其来的"艳遇"

- 核实对方身份信息的真实性

- 避免与陌生人有大额资金往来

- 注意保护个人隐私信息

法律监管与伦理规范

现有法律体系需要适应AI技术带来的新挑战。应当明确AI生成内容的标识要求,规范AI技术的应用边界。同时加强跨国执法合作,打击跨境网络诈骗活动。

技术开发者也需承担相应责任,在产品设计中加入防滥用机制。例如,在AI图像生成工具中加入数字水印,便于追踪和识别。

未来展望与技术发展

随着AI技术的持续进步,诈骗与反诈骗的博弈将不断升级。生成式AI的能力还在不断增强,这意味着我们需要持续更新防护手段。

未来可能出现的技术趋势包括:

- 更精准的AI内容检测算法

- 区块链技术在身份验证中的应用

- 生物特征识别技术的普及

- 人工智能辅助的反欺诈系统

这场技术博弈不仅关乎个人财产安全,更关系到数字时代的信任基础。只有在技术创新与规范监管之间找到平衡,才能构建安全的数字环境。

技术的进步不应该成为破坏社会信任的工具,而应该服务于人类福祉。我们需要建立多方协作的治理机制,确保AI技术在合规的轨道上发展。这需要技术开发者、监管机构、企业和公众的共同参与。

在数字化程度不断加深的今天,维护网络空间的安全与信任已经成为重要课题。只有通过持续的技术创新和制度完善,才能有效应对AI技术滥用带来的挑战。