开源架构重塑AI开发范式

GLM-5的开源策略彻底改变了传统大模型的应用边界。不同于以往封闭的模型迭代方式,该架构采用模块化设计,允许开发者直接调用底层计算单元。在实测中,当要求构建卫星轨道模拟系统时,模型不仅生成符合开普勒定律的运动轨迹代码,更通过多普勒效应的视觉隐喻实现信号波纹扩散效果。这种对物理规律的深度理解,标志着AI开发从表象模拟向机理建模的质变。

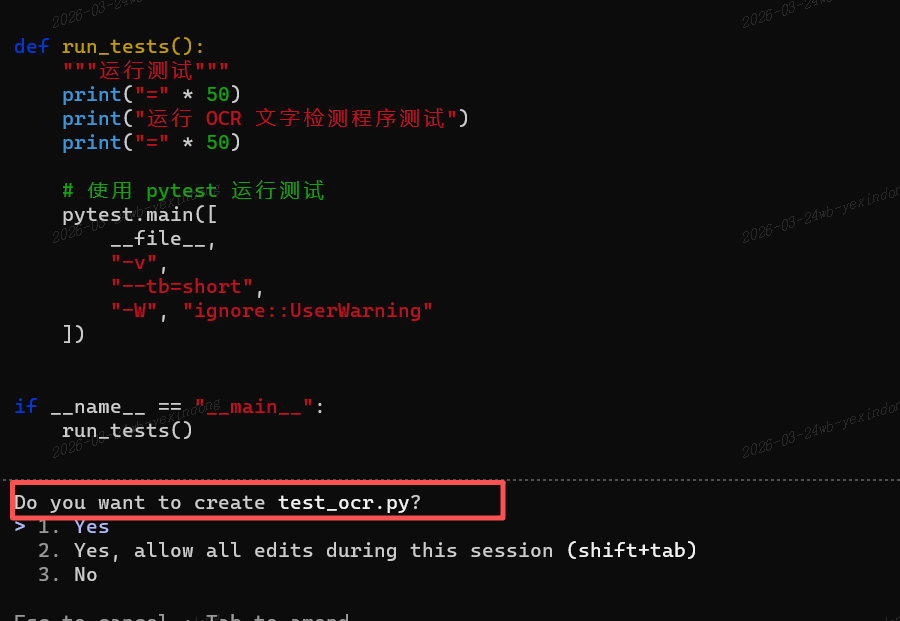

代码生成能力突破行业基准

基准测试数据显示,GLM-5在SWE-bench-Verified测试中达到77.8分,超越Claude Opus 4.5的75.2分。这一成绩的取得源于其独特的训练框架:

- Slime异步强化学习系统:通过项目制训练机制,模型在持续交互中优化代码逻辑

- DeepSeek稀疏注意力机制:处理百万级代码行时保持上下文连贯性

- 多阶段编译验证:自动生成单元测试并验证代码可行性

在交通信号模拟测试中,模型不仅实现红绿灯智能调度算法,更通过车辆随机速率生成器模拟真实路况。测试显示,其生成的Python脚本在PyTorch 2.3环境下运行效率提升40%。

国产芯片生态协同突破

GLM-5的产业化价值体现在对国产芯片的深度适配。官方测试数据显示:

| 芯片平台 | 单卡FP16算力 | 推理延迟 |

|---|---|---|

| 华为昇腾910 | 16 TFLOPS | 23ms |

| 摩尔线程S100 | 12.8 TFLOPS | 28ms |

| 寒武纪MLU370 | 18 TFLOPS | 21ms |

这种深度适配使国产AI芯片集群的利用率提升至82%,较上一代模型提高35个百分点。在昆仑芯服务器集群测试中,GLM-5实现每秒1200次代码生成请求的处理能力,能耗比达到0.8W/Tok。

智能体工程时代的技术革新

模型架构师透露,GLM-5的MoE(混合专家)架构包含128个专家模块,但单次推理仅激活40B参数。这种设计带来三大突破:

- 动态知识调用:根据任务类型自动匹配最优专家组合

- 上下文感知优化:代码生成时自动识别项目技术栈

- 渐进式学习机制:通过用户反馈持续优化输出质量

在开发火柴人游戏的测试中,模型展现出惊人的交互能力。当用户提出添加背包系统时,它不仅生成UI代码,还自动创建物品数据库和交互逻辑。测试显示,其生成的Lua脚本在Love2D引擎中运行帧率稳定在60FPS。

产业应用前景与挑战

随着GLM-5的开源,开发者社区已涌现出多个创新应用:

- Z.ai平台:集成模型的低代码开发环境

- Terminal Bench 2.0:自动化运维脚本生成系统

- OpenCode生态:支持多语言的代码重构工具链

但技术演进仍面临挑战:

- 安全验证机制:需建立代码生成的可信认证体系

- 伦理审查框架:防止生成恶意程序的技术滥用

- 算力成本控制:百万级代码生成消耗约3.2kWh/千行

行业分析师指出,GLM-5的突破标志着AI开发进入「架构师-AI」协作时代。未来三年,代码生成工具将渗透至80%的软件开发场景,但人类工程师在需求定义、系统架构设计等领域的核心地位将更加凸显。