2025年12月24日,英伟达以200亿美元完成对推理芯片独角兽Groq的收购,创下公司史上最大单笔交易纪录。这场被硅谷称为‘收购式招聘’的交易,表面是技术授权,实则实现人才与技术的双重收割。Groq创始人、谷歌TPU初代核心开发者Jonathan Ross带领团队整体并入英伟达,其研发的LPU芯片将深度融入NVIDIA AI Factory架构。

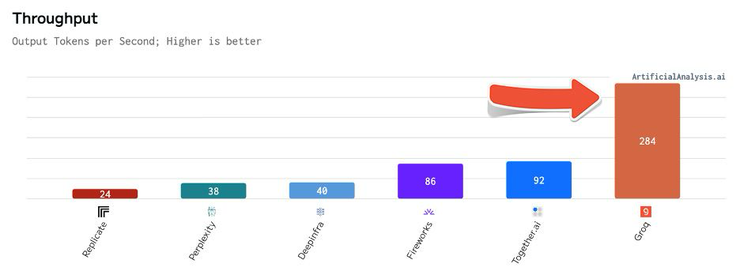

当前AI产业正经历结构性转变:训练需求增速从年均80%降至30%,而推理需求却以200%的年增速爆发。Groq的LPU架构在LLM推理场景中展现出碾压性优势——284 tokens/s的生成速度,0.22秒首token响应时间,配合1/10的能耗成本,直接击中大模型商业化的核心痛点。这种性能突破源自其颠覆性设计:采用全片上SRAM存储架构,实现80TB/s带宽(Blackwell的10倍),彻底消除数据搬运延迟。

英伟达此番出手,本质是应对三重压力:

- 技术补位:补齐专用推理芯片短板,对抗谷歌TPU和AMD MI300

- 生态防御:阻止‘去GPU化’技术路线扩散,维护CUDA生态护城河

- 供应链控制:通过提前锁定GlobalFoundries和三星代工产能,挤压独立芯片厂商生存空间

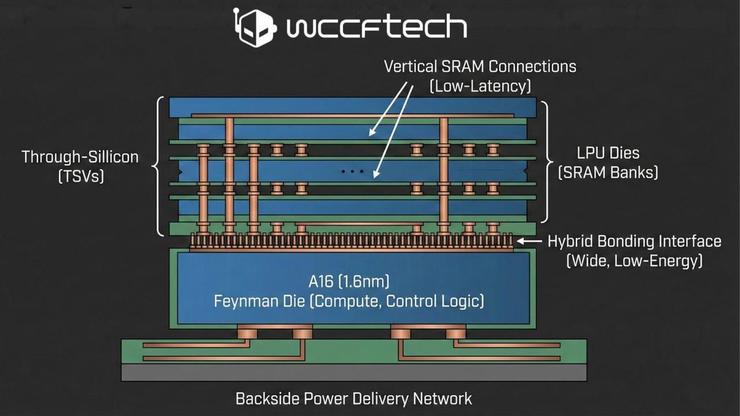

值得注意的是,交易结构设计极具战略智慧:即时支付130亿美元现金,剩余70亿与核心团队股权激励挂钩。这种‘人才绑定’模式确保Jonathan Ross等关键技术人才至少留任5年,为其在2028年推出的Feynman芯片集成LPU单元提供研发保障。

行业分析师指出,此次并购标志着AI芯片进入‘架构混合时代’。英伟达将采用类似AMD X3D的3D堆叠技术,通过台积电SoIC混合键合工艺,将独立LPU芯片与主计算单元集成。这种设计虽面临CUDA生态适配、SRAM扩展性等工程挑战,但一旦突破,将实现训练推理一体化解决方案,重塑价值万亿美元的数据中心市场格局。

面对Meta、谷歌等大客户推动的算力多元化趋势,英伟达正通过‘并购+技术整合’构建新护城河。而这场200亿美元交易的真正考验,在于如何将LPU的‘线性延迟优化’理念,转化为可扩展、可持续的商业竞争力。