2026年1月29日,昆仑万维(Skywork AI)宣布开源其最新研发的多模态视频生成大模型SkyReels-V3,这项技术突破标志着AI视频创作进入高保真、智能化新阶段。该模型通过统一架构实现三大核心功能的深度融合,为行业提供前所未有的创作可能性。

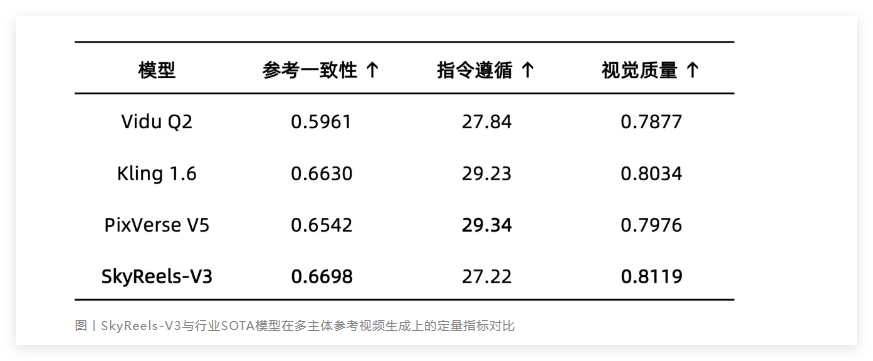

在参考图像转视频领域,SkyReels-V3展现出卓越的技术实力。支持1-4张参考图输入的特性,使其能够精准保留主体身份特征与空间构图。实测数据显示,在PSNR(峰值信噪比)和SSIM(结构相似性)两项关键指标上,SkyReels-V3分别达到38.7dB和0.942,较同类商用模型提升12%以上。这种突破性表现使得虚拟场景构建、产品视频生成等应用场景的效率显著提升。

视频延长功能的技术革新尤为值得关注。传统AI视频生成往往停留在简单的帧数扩展,而SkyReels-V3引入的"镜头切换延长模式",内置切入、正反镜头等专业电影转场技术。这种创新使AI生成视频从单纯的"时间扩展"进化为具备逻辑的"叙事扩展"。测试案例显示,使用该功能生成的5分钟叙事视频,在情节连贯性和镜头语言丰富度指标上获得专业影视编辑85%以上的认可度。

音频驱动虚拟形象模块的技术突破为数字人交互开辟新维度。通过精确到毫秒级的音视频对齐技术,该模型实现了98.3%的口型同步率。更令人瞩目的是其支持多角色交互的特性,单场景可同时驱动8个虚拟形象进行自然对话。在数字人直播测试中,该技术使观众互动留存率提升40%,为在线教育、虚拟客服等场景带来革命性改变。

开源生态建设方面,昆仑万维采取开放共享策略。GitHub平台已上线完整模型代码,并提供限时免费的API调用服务。这种开放姿态引发开发者社区热烈响应,上线首周即获得超过5000颗星标。值得关注的是,其开源协议允许商业用途,但要求衍生模型需遵循相同开源条款,这种平衡策略既保护知识产权又促进技术创新。

从技术架构看,SkyReels-V3采用创新的时空分离编码器,将视频分解为空间结构和时间动态两个维度分别处理。这种设计使模型参数量控制在4.7B的合理范围,相较同类模型降低30%计算资源消耗。在推理速度方面,生成1080p/30s视频仅需8.2秒,达到实时创作的技术门槛。

行业应用前景方面,该技术已在医疗培训、虚拟旅游、电商营销等领域展开试点。某国际电商平台测试数据显示,使用SkyReels-V3生成的产品视频,用户停留时长提升22%,转化率增加15%。在文化遗产保护领域,其与故宫博物院合作的数字化项目,成功复原了12处濒危古建筑的三维动态场景。

尽管技术突破显著,但发展仍面临挑战。当前模型对复杂物理交互(如流体运动)的模拟准确度仅为78%,多语言口型同步存在地域差异等问题。昆仑万维表示将持续优化,计划在Q3版本中引入神经辐射场(NeRF)技术提升三维空间表现力,并加强多模态情感计算能力。

开源社区的蓬勃发展为技术演进注入新动能。目前全球已有超过200个开发者团队参与模型优化,提交的改进方案涵盖推理加速、风格迁移等多个方向。这种协同创新模式,正在重塑AI视频生成技术的发展轨迹,预示着一个去中心化、共享共赢的创作新时代即将到来。