AI存储架构的技术演进

存储层级的功能重构

在AI算力集群中,数据流动呈现典型的金字塔结构:

- HBM作为GPU的3D堆叠显存,带宽达到3.35TB/s

- DDR5内存构建数据中转枢纽,单条容量突破256GB

- NVMe SSD实现μs级延迟的热数据存取

- QLC NAND提供PB级冷存储解决方案

内存墙问题的工程突破

当前AI计算单元99%的闲置时间源于数据搬运延迟,三大技术路径正在重塑存储体系:

- HBM4堆叠技术:通过16-Hi垂直集成将带宽提升至32TB/s

- 3D SRAM方案:采用混合键合工艺将KV缓存嵌入计算核心

- 存算一体芯片:美光最新研究成果显示能效比提升40倍

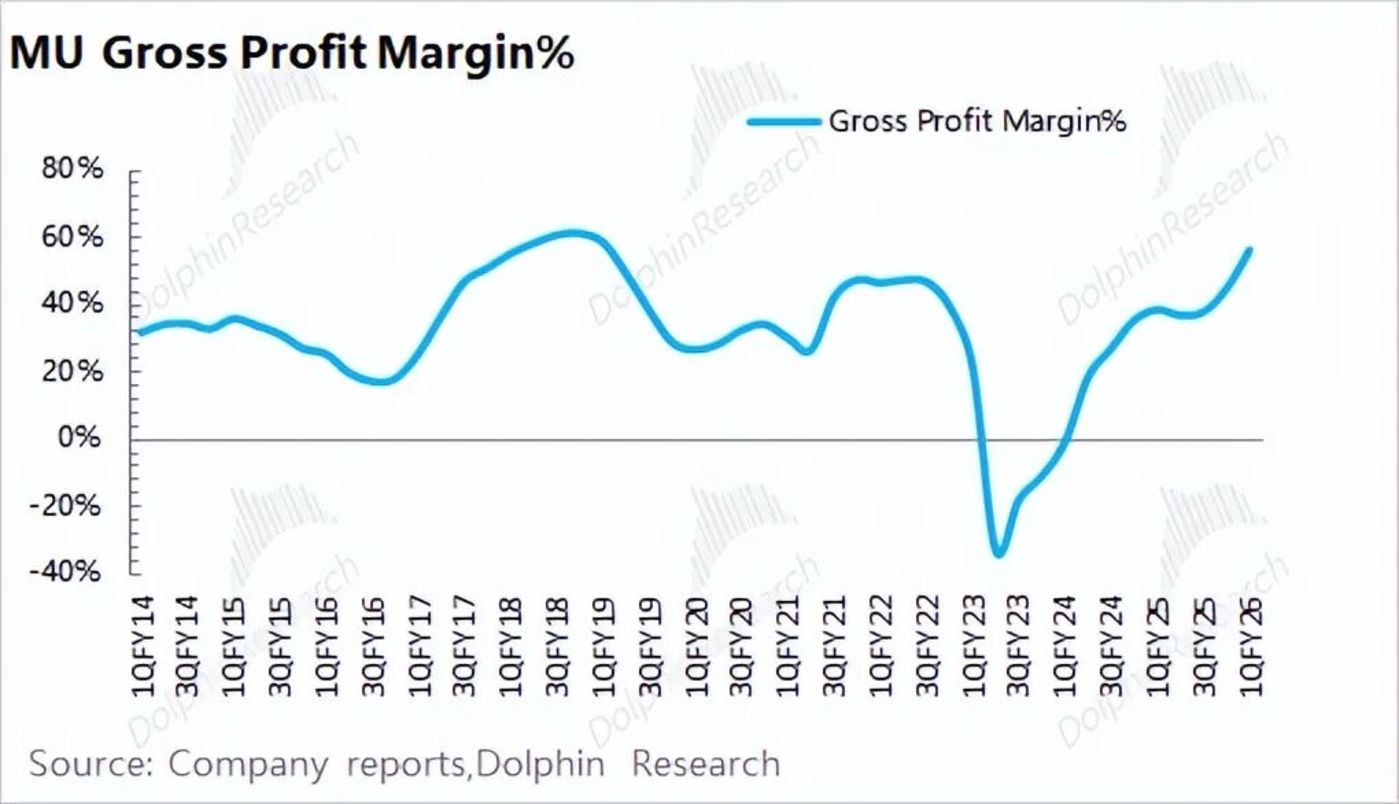

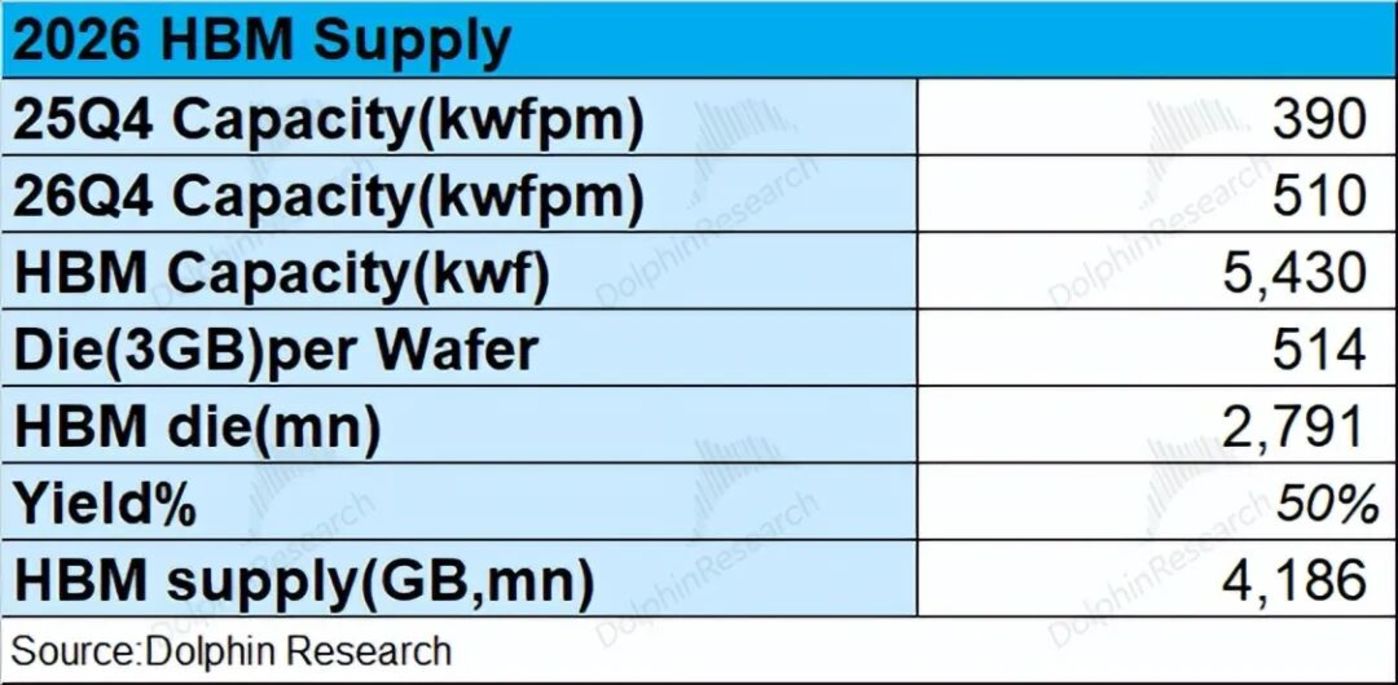

HBM市场的供需博弈

产能扩张与工艺瓶颈

| 厂商 | 2025Q4产能(万片/月) | 2026Q4产能预测 |

|---|---|---|

| 海力士 | 18.5 | 24.2 |

| 三星 | 16.8 | 20.5 |

| 美光 | 3.7 | 6.3 |

数据来源:各公司财报会议披露

CoWoS封装的关键制约

英伟达B300芯片的CoWoS-R封装需要:

- 每个HBM3E堆栈包含8颗36GB芯片

- 单晶圆产出14颗完整计算芯片

- 2026年全球CoWoS产能缺口达18%

存储技术的未来图景

推理服务器的存储变革

当AI应用进入千亿级推理场景时:

- DDR5内存需求增长300%

- PCIe 5.0 SSD渗透率突破75%

- 20TB HDD成为数据中心标配

存算一体架构的商业化进程

- 2026年:嵌入式MRAM实现小规模应用

- 2027年:3D NAND存内计算芯片量产

- 2028年:光学存储计算系统进入测试阶段

当前存储技术创新正沿着三条主线推进:带宽提升、延迟压缩和能效优化。随着HBM4量产时间节点临近,存储厂商的TSV工艺良率成为竞争焦点。在推理算力需求爆发背景下,QLC NAND与HDD的协同创新将重新定义冷数据存储的经济模型。