监管重锤落下:三大平台为何成为首批处罚典型

近期,国家互联网信息办公室(以下简称“网信办”)动作频频,对“剪映”“猫箱”App及“即梦AI”网站等头部应用进行了集中约谈与处罚。这一行动并非孤立事件,而是中国人工智能治理进入“深水区”的标志性信号。根据官方通报,这些平台的核心问题集中在“未有效落实人工智能生成合成内容标识规定要求”,直接违反了包括《网络安全法》《生成式人工智能服务管理暂行办法》以及最新的《人工智能生成合成内容标识办法》在内的多项法律法规。

处罚措施涵盖了约谈企业负责人、责令立即改正、给予警告,并对相关责任人员从严处理。这种组合拳式的监管手段,释放出强烈的信号:AI内容标识不再是“可选项”,而是悬在平台头顶的“达摩克利斯之剑”。在生成式人工智能爆发式增长的背景下,内容标识如同数字世界的“身份证”,是区分人工创作与机器生成、维护网络空间清朗、防范虚假信息泛滥的基础设施。

标识义务:从技术倡导到法律强制的跨越

过去,许多平台将内容标识视为一种技术倡导或行业自律行为,但在“剪映”等案例被查处后,这一认知已被彻底扭转。《人工智能生成合成内容标识办法》的出台,标志着中国AI治理从原则性引导转向了强制性规范。

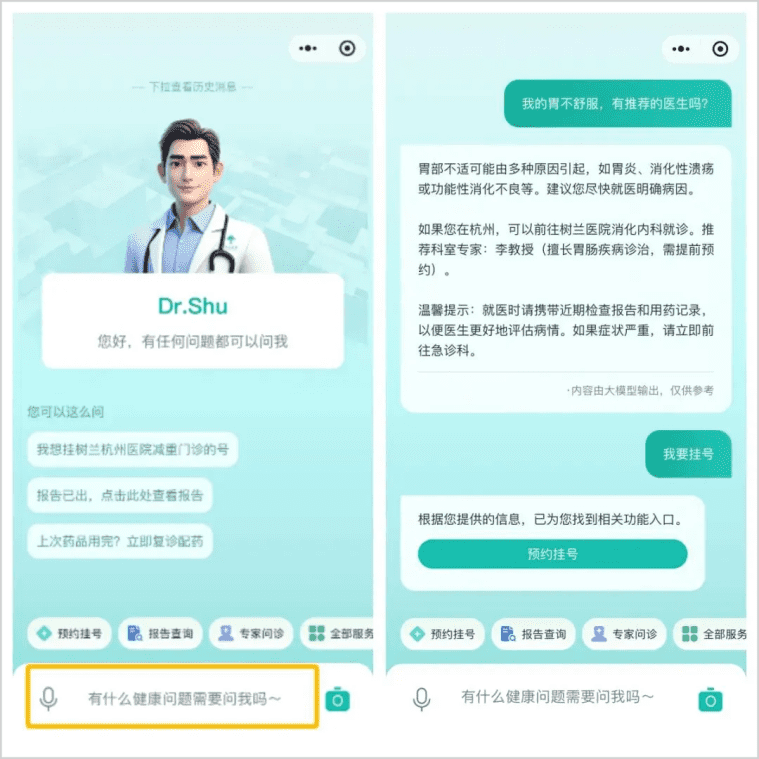

该办法明确要求,提供生成式人工智能服务的提供者,应当在生成内容中显著标识其来源及性质。这不仅是技术层面的操作指南,更是法律责任的边界。对于剪映、猫箱这类以视频编辑、AI绘画、角色对话为核心功能的平台而言,其生成的每一段视频、每一张图像、每一句对话,都可能被公众视为“真实”内容。如果缺乏有效标识,极易引发“深度伪造”(Deepfake)风险,导致谣言传播、诈骗实施甚至社会恐慌。

例如,在视频编辑场景中,用户利用AI功能替换人物面部或生成背景,若系统未自动添加不可移除的标识,公众难以辨别视频的真伪。监管部门此次处罚的核心,正是针对这种“标识缺失”或“标识易被去除”的合规漏洞。平台未能构建起强制性的标识机制,实际上是在法律红线边缘试探,一旦造成社会影响,必将面临严厉追责。

技术困境与合规挑战:标识难在何处?

许多技术团队可能会提出质疑:在AI生成内容上添加标识,技术难度究竟有多大?这并非无的放矢。在复杂的生成式场景下,实施有效标识面临着多重技术挑战。

首先是标识的隐蔽性与鲁棒性之间的平衡。如果标识过于明显(如直接在视频角落打水印),容易破坏用户体验,甚至被用户通过裁剪、覆盖等方式轻易去除。如果采用隐式水印(Invisible Watermarking)技术,虽然体验更好,但需要确保在各种格式转换、压缩、剪辑过程中,水印依然能够被精准提取和验证。剪映等视频编辑类App,其核心功能正是对视频进行二次创作,如果标识机制无法穿透这些编辑操作,那么标识就形同虚设。

其次是多模态内容的标识统一性。AI生成内容早已不仅仅是文本,还包括图像、视频、音频甚至虚拟数字人。如何在视频、音频、图像等不同模态下,建立一套统一、兼容且难以被篡改的标识标准,是平台技术架构必须面对的难题。猫箱App专注于虚拟角色对话,即梦AI专注于视频生成,它们各自的技术路径不同,但合规要求却高度一致,这对平台的底层架构灵活性提出了极高要求。

此外,实时性与计算成本的矛盾也不容忽视。在用户生成内容(UGC)的高峰期,平台需要在毫秒级内完成标识的嵌入与校验,这对算力资源提出了巨大挑战。如何在保证合规的同时,不牺牲用户的生成速度和体验,是平台需要长期平衡的难题。

责任穿透:从平台到个人,监管链条如何闭环?

此次处罚的一个显著特点是“从严处理责任人”。这不仅指向企业主体,更直接指向具体的管理人员和技术负责人。这意味着,在AI治理领域,合规责任不再仅仅停留在公司层面,而是穿透到了具体的执行者。

在《生成式人工智能服务管理暂行办法》中,已经明确了服务提供者的主体责任。而此次行动进一步强化了“谁运营、谁负责,谁主管、谁负责”的原则。平台负责人若未能建立健全的内容安全管理制度,未部署有效的标识技术,甚至存在侥幸心理放任标识缺失,都将被视为直接责任。这种责任穿透机制,极大地提高了企业合规的紧迫感。

对于平台运营者而言,这要求他们必须建立从技术研发、产品设计到内容审核的全流程合规体系。例如,在产品设计阶段,就必须将“强制标识”作为功能上线的前置条件,而非事后补救的补丁。在技术架构上,需要引入专业的数字水印团队,确保标识能够抵御常见的篡改攻击。在管理流程上,需要定期开展合规审计,确保标识机制在实际运行中始终有效。

这种高压态势,实际上是在倒逼行业从“野蛮生长”向“精细化治理”转型。过去那种“先上线、后整改”的互联网思维,在强监管时代已不再适用。合规不再是成本,而是平台生存的底线。

行业未来:合规驱动下的技术进化与生态重塑

“剪映”等平台的被约谈,并非行业发展的终点,而是新生态的起点。从长远来看,严格的标识制度将推动生成式人工智能技术向更高质量、更可信的方向发展。

首先,合规将催生新的技术赛道。能够高效、稳健地实现内容标识的技术解决方案,将成为各大云厂商和AI公司的核心竞争力。例如,基于区块链的标识上链存证、基于多模态融合的抗攻击水印算法等,将迎来爆发式增长。平台若想保持竞争优势,必须在合规技术上加大投入,将合规能力转化为产品壁垒。

其次,标识制度的完善将重建用户信任。当用户能够清晰辨别AI生成内容时,虚假信息的传播成本将大幅上升,优质内容的价值将得到更好体现。这将反过来激励创作者产出更多真实、有深度的内容,形成“良币驱逐劣币”的正向循环。对于短视频、在线教育、新闻资讯等领域,可信的内容标识将成为平台品牌的重要资产。

最后,行业标准的统一将加速。此次查处行动为全行业树立了标杆,未来不同平台之间的标识标准有望逐步趋同,形成跨平台的内容溯源体系。这将极大提升监管效率,降低社会管理成本,推动AI行业从“各自为战”走向“协同治理”。

结语与展望:在规范中寻找发展的确定性

网信部门对剪映、猫箱、即梦AI的处置,是中国AI治理史上具有里程碑意义的事件。它清晰地界定了法律底线,敲响了行业警钟,也指明了未来的发展方向。对于所有AI从业者而言,合规已不再是选择题,而是必答题。

在《人工智能生成合成内容标识办法》的框架下,平台方必须正视技术难点,加大研发投入,构建从技术到管理的全方位合规体系。同时,监管机构也将持续保持高压态势,加大监督检查力度,确保各项规定落地生根。只有在法律框架内规范发展,生成式人工智能才能真正释放其生产力,造福社会,而非成为混乱的源头。

未来,随着标识技术的不断成熟和监管机制的日益完善,我们有理由相信,中国AI行业将构建起一个更加透明、可信、有序的创新生态。在这个生态中,技术与法律不再是博弈的双方,而是共同推动行业前行的双轮。对于企业而言,拥抱合规,就是拥抱确定性,就是拥抱未来。