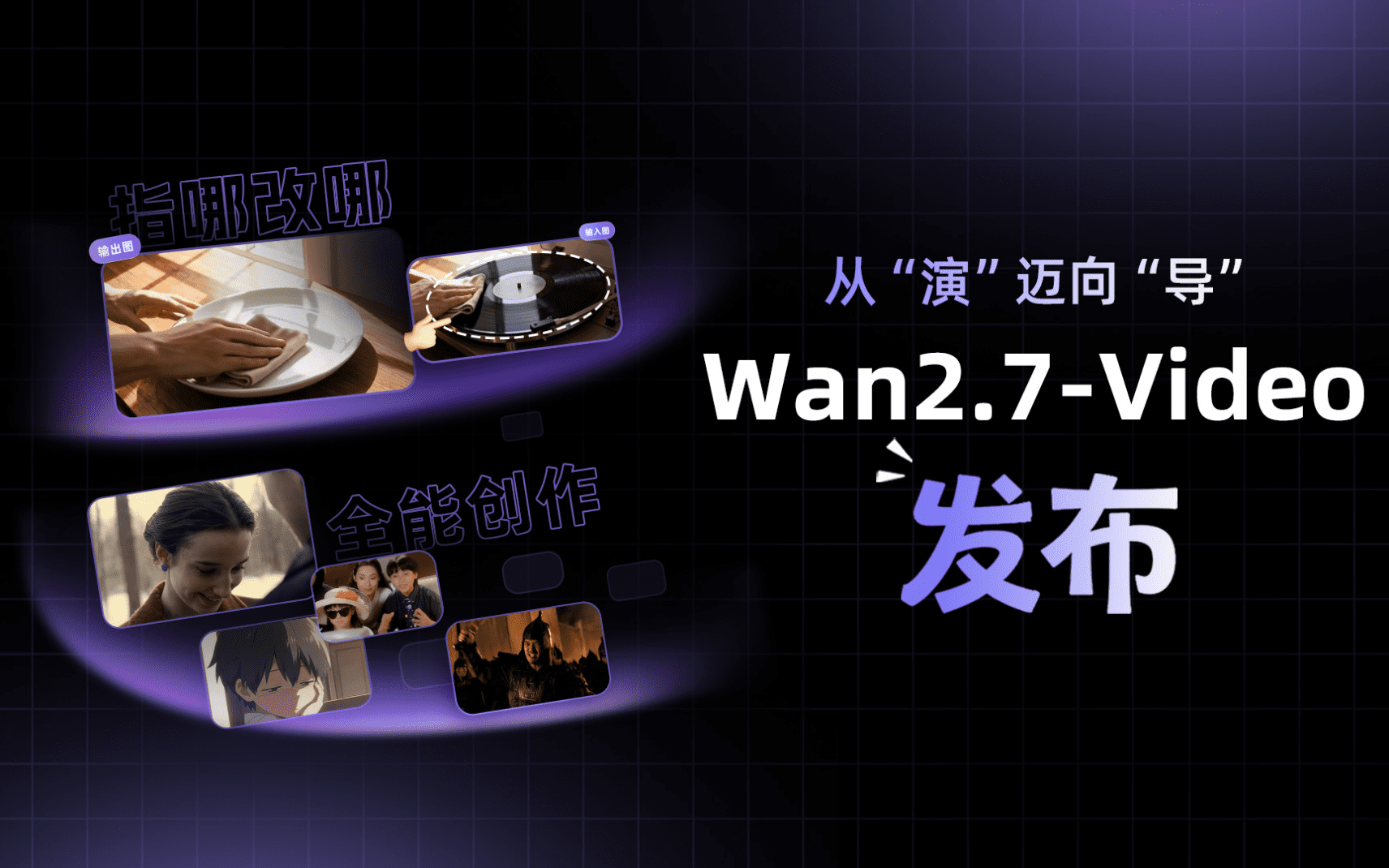

视频创作领域正在经历一场由人工智能驱动的深刻变革。最新发布的Wan2.7-Video系列模型标志着AI视频技术从辅助工具向核心创作引擎的转变。这一技术突破不仅提升了视频生成的画质标准,更重要的是解决了长期困扰行业的叙事控制和后期编辑难题。

技术架构的全面升级

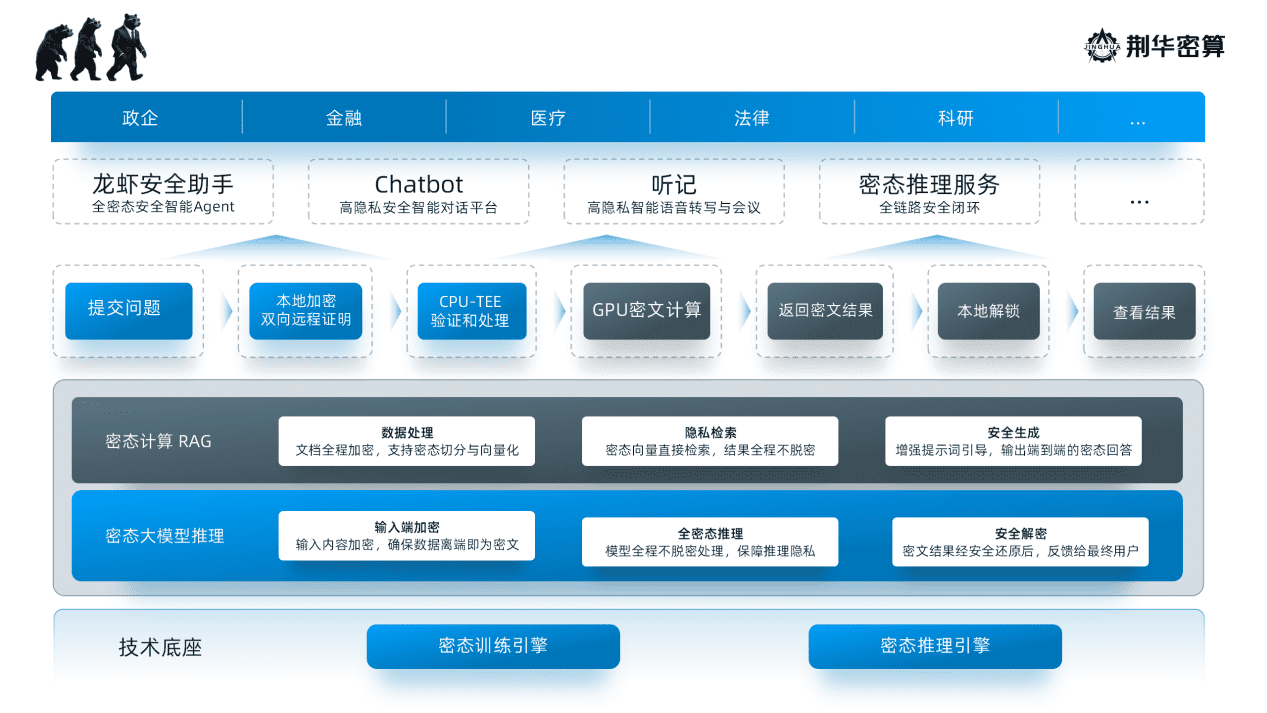

Wan2.7-Video模型体系包含四个专业模块,每个模块都针对特定的创作需求进行了优化。文生视频模块(Wan2.7-t2v)能够将简短的文字描述转化为完整的视频内容,实现了从概念到成片的直接转换。图生视频模块(Wan2.7-i2v)则专注于画面控制,允许创作者通过参考图像来精确指导视频的视觉风格。

参考生视频模块(Wan2.7-r2v)在动作复刻和特效迁移方面表现出色,支持多达5个视频主体的同步参考,这在业内尚属首次。视频编辑模块(Wan2.7-videoedit)的创新之处在于其精细的局部修改能力,真正实现了'一句话轻松改'的编辑体验。

创作控制力的质的飞跃

传统AI视频工具在叙事连贯性方面存在明显短板,而Wan2.7-Video通过引入视频续写与尾帧控制的联合机制,有效解决了这一难题。创作者可以在续写视频的同时指定结尾画面,既保证了动态的延续性,又实现了对画面结构的精准把控。

在运镜技术方面,模型支持数十种基础运镜和复杂的组合运镜方案,包括希区柯克式变焦、360度环绕等高难度镜头语言。这些功能的实现不仅依赖于先进的算法模型,还得益于对影视创作规律的深度理解。

行业应用的广泛前景

对于影视制作行业而言,Wan2.7-Video的出现意味着后期制作成本的显著降低。传统影片修改往往需要重新拍摄或复杂的后期处理,而现在只需简单的文本指令就能完成场景切换、风格转换等操作。

广告创意行业同样受益匪浅。品牌方可以快速生成不同风格的广告版本进行A/B测试,大大缩短了创意验证周期。内容创作者则能够以更低的门槛实现专业级的视频效果,推动创意表达的民主化进程。

技术突破的核心价值

Wan2.7-Video的成功不仅体现在技术参数的提升,更重要的是其对于创作流程的重塑。模型实现了文本、图像、视频、音频全模态输入的统一创作体系,这意味着创作者可以使用最自然的方式表达创意意图。

在视觉风格控制方面,模型可延展出上千种风格组合,覆盖2D卡通、3D动画、水墨、黏土等多种视觉语言。这种多样性为创意表达提供了更广阔的空间,同时也降低了专业视觉效果的实现门槛。

未来发展趋势展望

随着Wan2.7-Video等先进模型的推广应用,视频创作行业将面临深刻的变革。一方面,专业影视制作的门槛将逐步降低,更多创作者能够参与到高质量内容的生产中;另一方面,内容生产的效率将大幅提升,推动整个行业向更高效、更创新的方向发展。

技术的进步也带来了新的挑战。如何在保证创作自由度的同时维护内容质量的标准?如何平衡自动化创作与人工创意的关系?这些问题都需要行业参与者共同思考和解决。

从技术发展的角度来看,未来的AI视频模型可能会在更长视频段的连贯性、更精细的情感表达以及更复杂的多人互动场景等方面继续突破。同时,与AR/VR等新兴技术的结合也将开辟新的应用场景。

产业生态的重新构建

Wan2.7-Video的推出不仅仅是技术层面的创新,更将引发整个视频创作产业生态的重构。传统的影视制作流程可能需要重新设计,以适应AI工具带来的效率提升。新的职业角色和技能要求也将随之产生,如AI视频提示工程师、数字导演等新兴岗位可能会成为行业标配。

对于教育机构而言,需要及时调整课程体系,培养适应新技术环境的创作人才。同时,版权、伦理等法律问题也需要得到充分重视,确保技术创新在规范有序的轨道上发展。

从更宏观的视角来看,AI视频技术的进步将推动视觉内容生产的规模化、个性化发展。用户不仅能够消费内容,还能更便捷地参与内容创作,这可能会改变现有的内容分发和消费模式。

技术的商业化应用也需要考虑实际落地场景。不同行业对视频内容的需求差异很大,模型需要具备足够的灵活性来适应各种专业要求。这既是对技术能力的考验,也是对商业模式创新的挑战。

总体而言,Wan2.7-Video代表的是AI视频技术发展的一个新里程碑。它不仅展示了当前技术能达到的高度,更为未来的发展指明了方向。随着技术的不断成熟和应用场景的拓展,AI视频创作必将成为数字内容生产的重要力量。