技术本质:结构化提示词而非AI训练

‘同事.Skill’项目的核心架构暴露了其真实性质:这并非真正的AI模型训练,而是基于预定义模板的角色扮演系统。项目采用Markdown文件存储人格描述和工作规范,通过Python脚本爬取聊天记录后,使用AI模型进行信息提取和格式化。

五层人格结构的实际作用

项目设计的五层人格结构(Layer 0-4)本质上是对提示词进行优先级排序的框架:

- Layer 0设定硬性规则(如不泄露隐私)

- Layer 1定义基础身份(如前端工程师)

- Layer 2控制表达风格(如不用emoji)

- Layer 3规范决策模式(如技术选型保守)

- Layer 4指导人际行为(如不参与争论)

这种分层设计确实提升了角色扮演的一致性,但本质上仍是在给AI模型提供详细的‘表演剧本’。

技术局限性分析

项目存在三个关键技术缺陷:

- 缺乏持久化记忆:每次对话都是重新读取静态文件,无法实现真正的学习进化

- 依赖数据质量:聊天记录的质量直接决定Skill的实用性(GIGO原则)

- 人格漂移问题:长对话中初始提示词权重被稀释,导致角色偏离

法律风险:个人信息处理的边界

数据收集的合法性质疑

根据《个人信息保护法》第13条,处理个人信息需要明确的法律依据。离职员工数据的继续使用面临三重挑战:

- 缺乏新的个人授权

- 超出劳动合同履行范围

- 突破数据使用合理性预期

敏感信息处理的高风险

工作聊天记录中可能包含的健康状况、家庭情况、财务信息等敏感个人信息,根据第28条需要取得‘单独同意’。项目的一次性爬取模式完全忽视了这一法律要求。

平台协议违规风险

项目推荐的微信聊天记录解析工具涉嫌违反《腾讯微信软件许可及服务协议》,可能面临平台方的法律追责。根据《数据安全法》第45条,造成数据泄露后果的还可能承担刑事责任。

传播失真:从技术玩梗到大众神话

传播链条的技术简化

原始推文‘被毕业的同事被蒸馏成Token’本是技术社区的幽默表达,但在大众传播过程中经历了三个阶段的失真:

- 技术细节简化:Python爬虫被概括为‘数字炼化’

- 功能夸大:角色扮演系统被宣传为‘人格复制’

- 社会意义放大:玩具项目被渲染成‘职场生存危机’

认知空白与夸大叙事

大众对AI技术的基础认知缺失为夸大叙事提供了生存空间。多数人无法区分:

- 提示词工程与模型训练的本质差异

- 上下文注入与真实记忆的技术区别

- 角色扮演与人格复制的概念边界

社会影响的多维度分析

这种技术误读可能带来三个层面的负面影响:

- 个人层面:加剧AI替代焦虑,误导职业规划

- 企业层面:盲目投资‘数字员工’项目,忽视实际需求

- 社会层面:阻碍理性讨论AI伦理和数据权利问题

理性视角:技术价值与伦理平衡

项目的合理应用场景

尽管存在夸大宣传,‘同事.Skill’类项目在特定场景下仍具实用价值:

- 知识传承辅助:标准化工作流程和决策模式

- 新人培训工具:快速了解团队工作风格

- 效率提升助手:处理重复性咨询问题

技术发展的正确方向

真正有价值的AI同事系统应该具备以下特征:

- 合规数据收集:获得明确授权,限定使用范围

- 持续学习能力:基于交互反馈优化行为模式

- 透明运作机制:用户清楚了解系统局限性和工作原理

数据权利保护框架建议

建立AI时代的个人数据保护需要多方协作:

- 立法层面:明确数字人格的法律地位和数据使用权

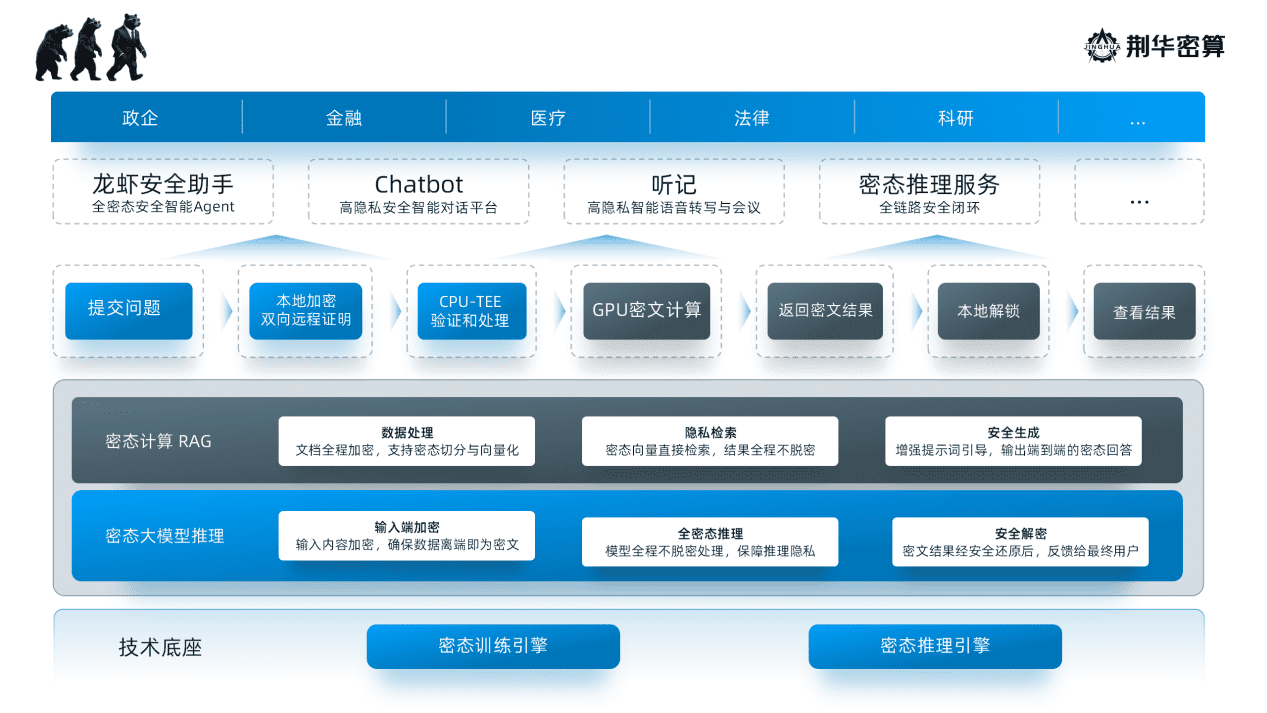

- 技术层面:开发隐私保护的计算框架(如联邦学习)

- 教育层面:提升公众的AI素养和数据权利意识

结论:技术理性与人文关怀的平衡

‘同事.Skill’现象反映了AI技术普及过程中的典型问题:技术创新与公众认知之间存在巨大鸿沟。真正的挑战不是如何‘炼化’同事,而是如何在技术发展中保持理性判断,在创新应用中守护基本伦理底线。

未来AI与人类协作的模式应该是互补而非替代,是增强而非复制。只有建立在这种认知基础上的技术发展,才能真正服务于人类社会的进步。