谷歌最新开源的Gemma 4模型正在掀起手机端AI应用的新浪潮。这款采用与Gemini 3同源技术架构的模型,不仅支持原生全模态处理,更在移动设备上展现出令人惊艳的性能表现。

手机端AI性能突破

在最新的实测中,Gemma 4在iPhone 17 Pro上的推理速度突破了40token/秒的里程碑。这一成绩得益于苹果MLX机器学习框架的深度优化,专门为苹果芯片进行了针对性适配。

值得注意的是,这种高性能并非苹果设备专属。在三星Galaxy等安卓设备上,用户同样获得了接近的运行速度,甚至在开启思考模式后仍能保持流畅体验。这表明移动端AI硬件优化已经达到了新的高度。

技术架构优势分析

Gemma 4提供了多个型号选择,其中E2B(有效参数2.3B)和E4B(有效参数4.5B)特别适合移动端部署。这些小型模型虽然参数规模相对较小,但128K的上下文窗口使其在处理复杂任务时具备显著优势。

从技术角度看,Gemma 4的全模态支持能力使其能够同时处理图像、音频等多种输入形式。这种能力在医疗诊断、实时翻译等场景中具有重要价值,特别是在数据隐私敏感的领域,本地运行避免了云端传输的安全风险。

用户体验革新

谷歌发布的官方应用Google AI Edge Gallery极大地降低了使用门槛。用户只需下载应用并选择相应模型版本,即可在手机上体验先进的AI能力。这种便捷性预示着AI技术正从专业领域走向大众普及。

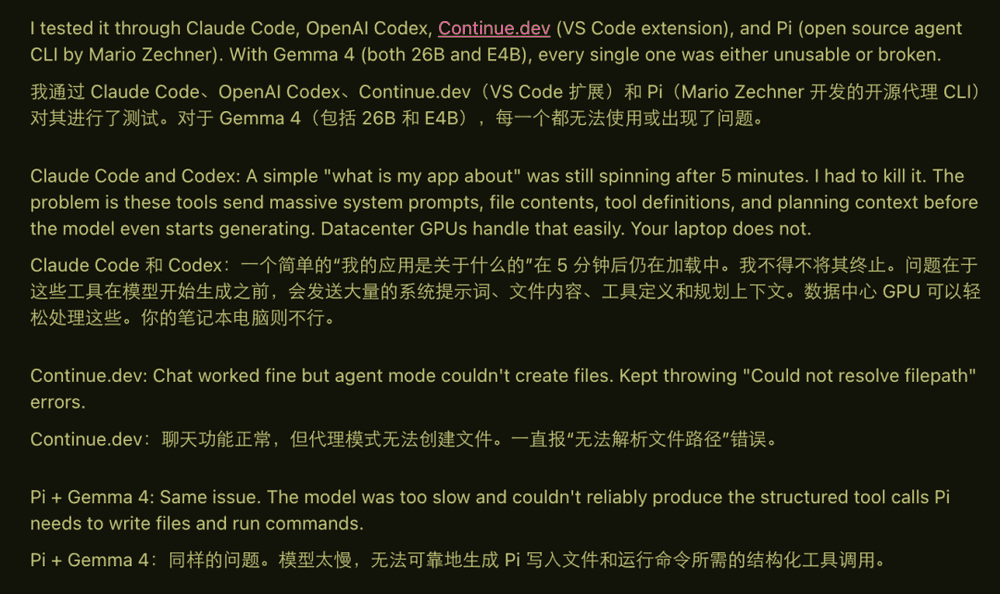

在实际使用中,Gemma 4展现出了出色的响应速度。文本生成、代码解释等基础任务处理流畅,但在更复杂的agent任务中仍存在挑战。有开发者在M5 Pro版MacBook Pro上测试Gemma 4 Mixture-of-Experts 26B时发现,模型在工具调用和结构化输出方面还有优化空间。

技术局限与挑战

尽管Gemma 4在基础任务上表现优异,但在需要大上下文窗口和稳定工具调用的复杂场景中,模型仍会遇到卡顿和输出错误的问题。与专门优化的qwen3-coder等模型相比,Gemma 4在编码代理任务上的表现还有差距。

智力水平方面,Gemma 4目前处于中等水平,能够胜任日常查询和简单推理任务,但在需要深度思考的复杂问题上仍有提升空间。这反映了当前端侧AI模型在性能与资源消耗之间的平衡挑战。

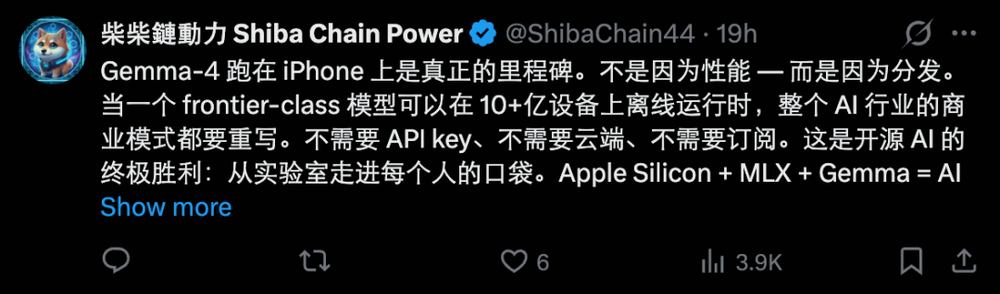

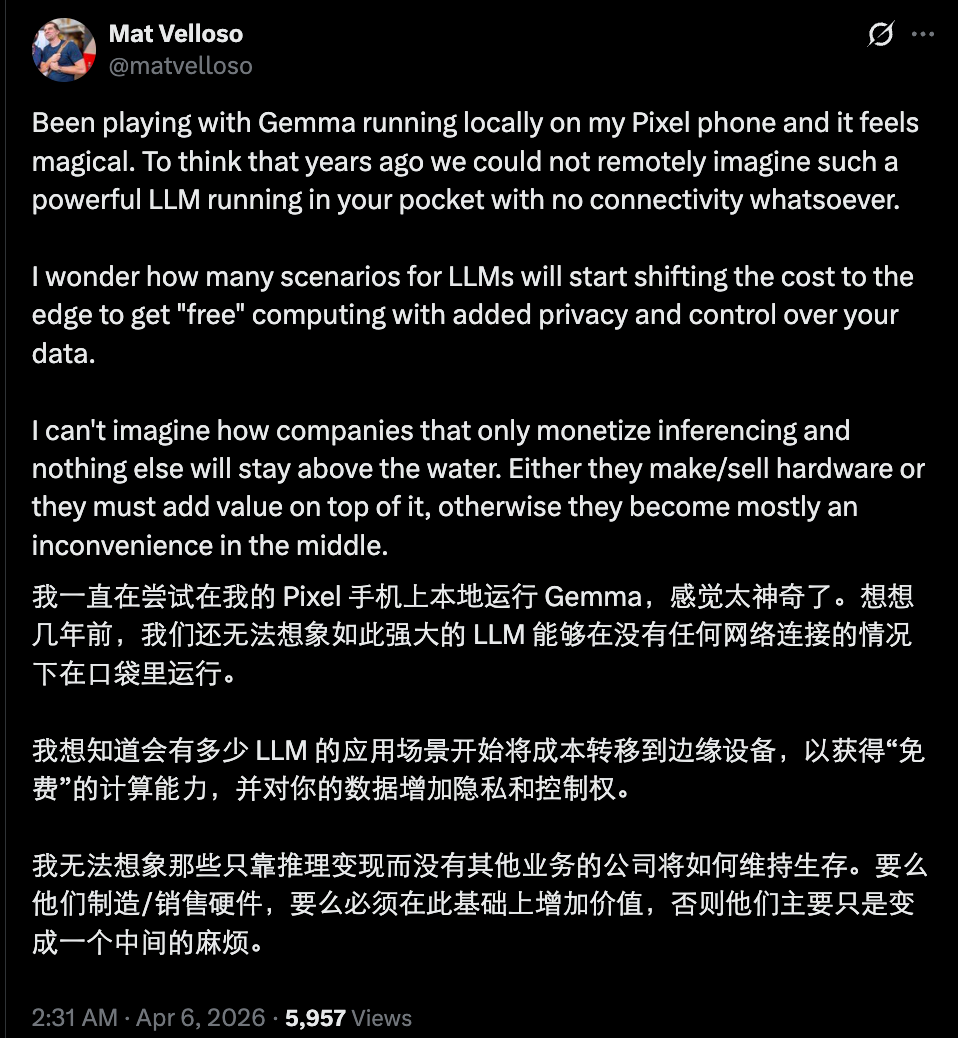

行业影响与商业模式变革

Gemma 4的成功部署标志着端侧AI技术的重要突破。如果日常的查询、聊天、简单推理等高频任务都能在本地完成,传统依靠API调用收费的商业模式将面临重大挑战。

当前,顶尖闭源模型在复杂推理和多代理协作方面仍保持领先,但这种优势正在逐渐缩小。硬件进步和量化技术的持续优化,使得端侧模型能够处理的任务范围不断扩大。

未来发展趋势

从技术演进路径来看,端侧AI的发展将呈现以下趋势:首先,模型压缩和量化技术将继续突破,使更大规模的模型能够在移动设备上运行;其次,专用硬件的普及将进一步提升端侧AI的性能表现;最后,隐私保护需求的增长将推动更多敏感场景采用本地AI方案。

对于AI服务提供商而言,未来的竞争焦点将转向超强Agent能力、超长可靠上下文处理以及需要海量实时数据的专有功能。单纯依靠API调用的商业模式需要向更高价值的方向转型。

应用场景拓展

医疗领域是端侧AI最具潜力的应用场景之一。本地运行的AI模型可以处理患者数据而无需上传云端,既保证了隐私安全,又实现了实时响应。类似地,在金融、法律等敏感行业,端侧AI也展现出独特价值。

教育领域的个性化学习、工业现场的实时检测、消费电子的人机交互等场景,都将受益于端侧AI能力的提升。随着模型性能的持续改进,这些应用将变得更加普及和实用。

技术生态建设

Gemma 4的成功离不开完善的技术生态支持。苹果的MLX框架、谷歌的Edge Gallery应用以及开源社区的持续贡献,共同推动了端侧AI技术的发展。这种生态建设的重要性在未来将更加凸显。

开发者工具的完善、模型部署标准的建立、性能优化指南的制定,都是推动端侧AI普及的关键因素。随着生态系统的成熟,更多创新应用将应运而生。

挑战与机遇并存

尽管前景广阔,端侧AI仍面临诸多挑战。硬件资源的限制、能耗控制的难题、模型精度的保证等问题都需要持续攻关。同时,如何平衡模型性能与设备续航,如何确保不同设备间的兼容性,都是需要解决的实际问题。

然而,这些挑战也带来了新的创新机遇。更高效的神经网络架构、更智能的资源调度算法、更精准的模型量化技术,都将在解决这些问题的过程中获得发展。

Gemma 4的出现只是端侧AI革命的序章。当本地运行与云端服务的体验差距消失时,整个AI产业将迎来真正的洗牌。这一天或许比我们想象的来得更早。