在人工智能技术快速发展的今天,多模态AI模型正成为行业关注的焦点。海螺AI作为上海稀宇科技有限公司(MiniMax)推出的前沿AI工具,凭借其创新的技术架构和强大的功能组合,在业界引起了广泛关注。与此同时,蓝耘MaaS平台作为专业的企业级AI服务基础设施,为海螺AI的规模化应用提供了重要支撑。

海螺AI的多模态技术体系

海螺AI的技术核心在于其完整的多模态架构设计。该系统基于自研的万亿参数混合专家模型ABAB6.5,采用了创新的动态路由机制。这种设计使得模型能够根据输入内容智能激活8-12个专业子模型,包括代码专家、多语言专家、逻辑推理专家等,实现了专业能力的精准分配和协同工作。

基础模型的技术创新

ABAB6.5模型的总参数量达到1.2万亿,但通过巧妙的设计,每个查询的活跃参数量控制在2000亿,有效平衡了模型容量与推理成本。在训练优化方面,模型采用了128路模型并行结合ZeRO-3显存优化技术,配合Task-MoE联合训练方式,既保证了任务性能,又实现了专家负载的均衡。

语音合成技术的突破

speech-01语音模型作为海螺AI的重要组成部分,采用了HiFi-GAN声码器与FastSpeech2韵律控制技术的融合方案。其核心创新在于音色解耦编码技术,通过Vector-Quantized VAEs实现音色与语义特征的分离,同时支持8种语言的音色无缝切换。在声音克隆方面,仅需10秒样本即可实现Zero-shot克隆,内置30多种音色选择,为高质量语音交互提供了坚实基础。

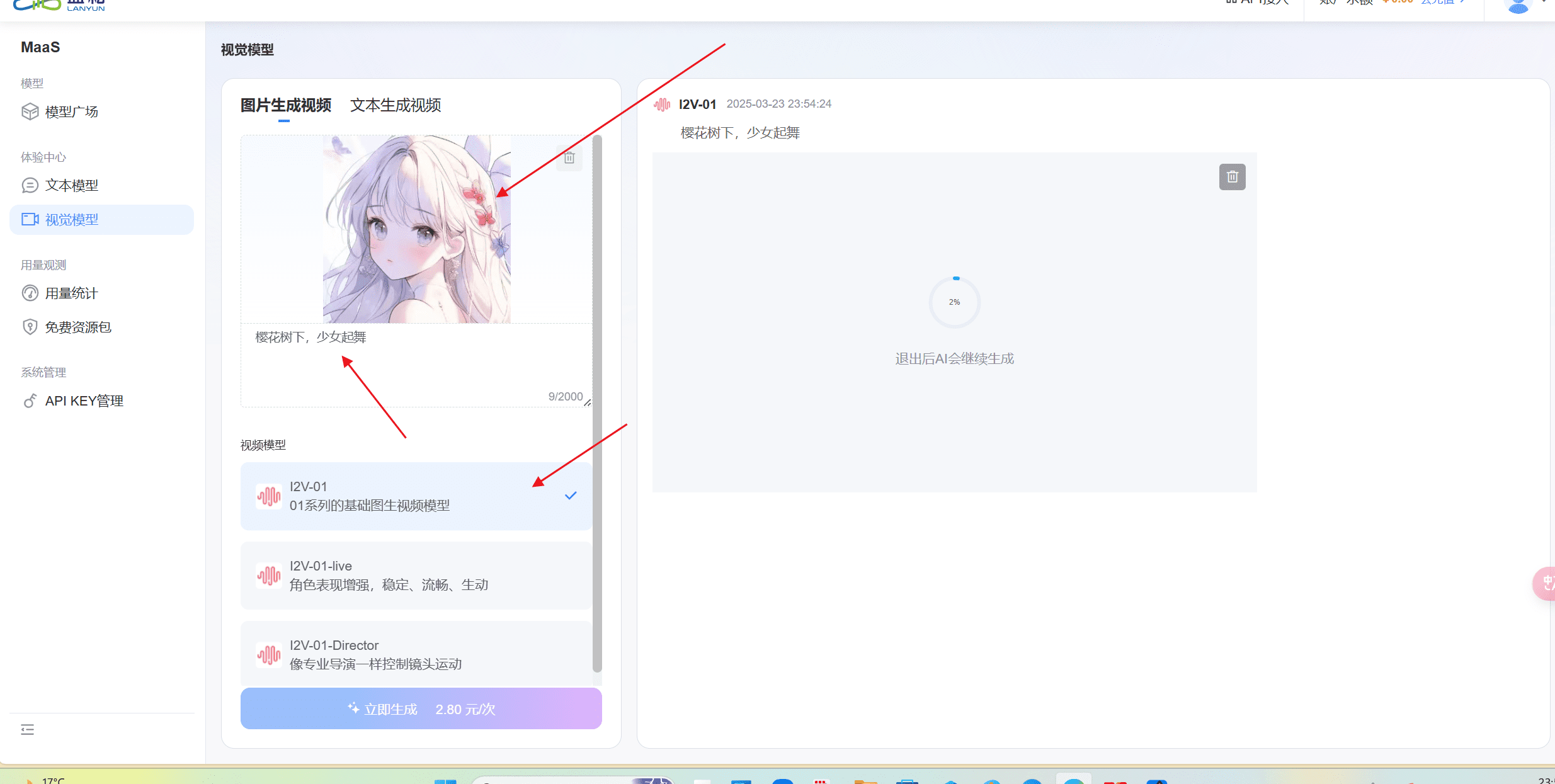

视频生成的技术实现

海螺AI的视频生成能力建立在三阶段流程之上。图像理解层基于GLIPv2进行开放域对象检测与关系提取,物理引擎层集成NVIDIA PhysX实现运动模拟,渲染层则运用Stable Video Diffusion-XL生成基础帧,并借助NeRF动态光照和GAN细节增强技术完成特效合成。这种分层设计确保了视频生成的质量和效率。

长文本处理引擎

海螺AI的长文本处理引擎支持128K tokens的连贯处理,采用Hierarchical Attention分层压缩历史上下文,结合FlashAttention-2技术,实现了3.2倍于常规Transformer的吞吐量。基于CodeLlama技术,能够实现文本到Markdown、LaTeX、JSON的自动转换,为结构化输出提供了便利。

智能搜索系统优化

智能搜索系统采用混合检索架构,集成ColBERT稠密检索与BM25稀疏检索,同时基于ROG实现知识图谱扩展与多跳推理。这种设计显著提升了搜索的精准度和深度,为用户提供了更加智能的信息检索体验。

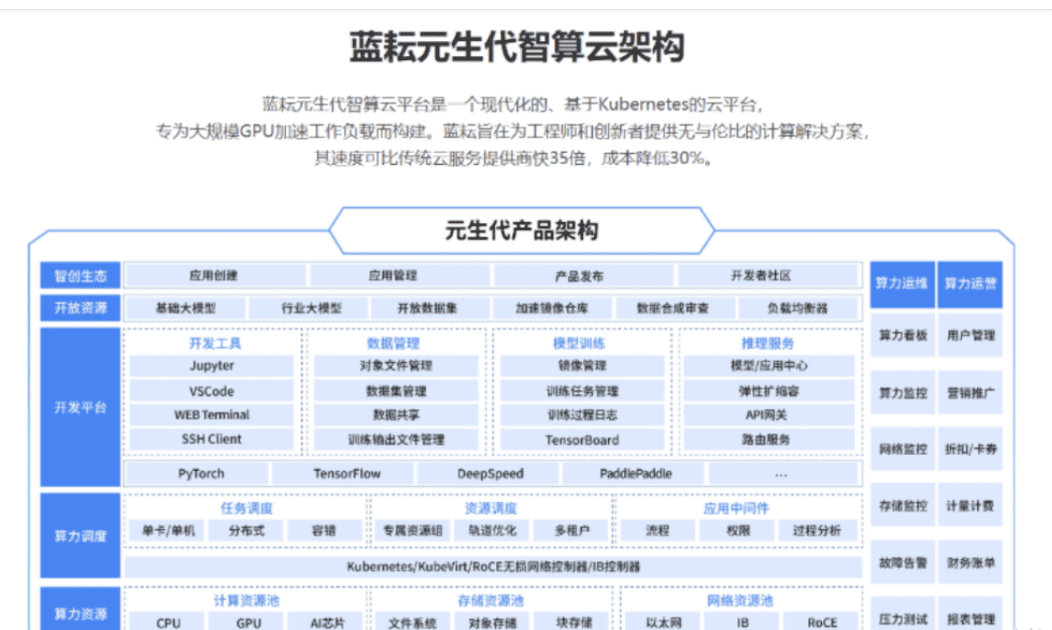

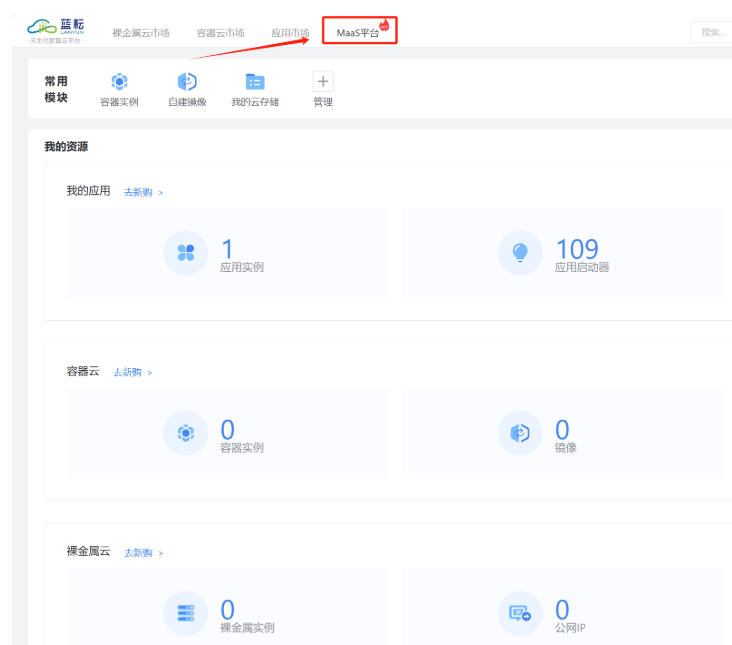

蓝耘MaaS平台的技术优势

蓝耘MaaS平台作为企业级AI服务基础设施,采用云原生架构设计,基于Kubernetes实现弹性资源调度,支持混合云和私有云部署。平台集成GPU/NPU算力池,优化推理效率,并提供联邦学习、隐私计算选项,确保数据隐私合规。

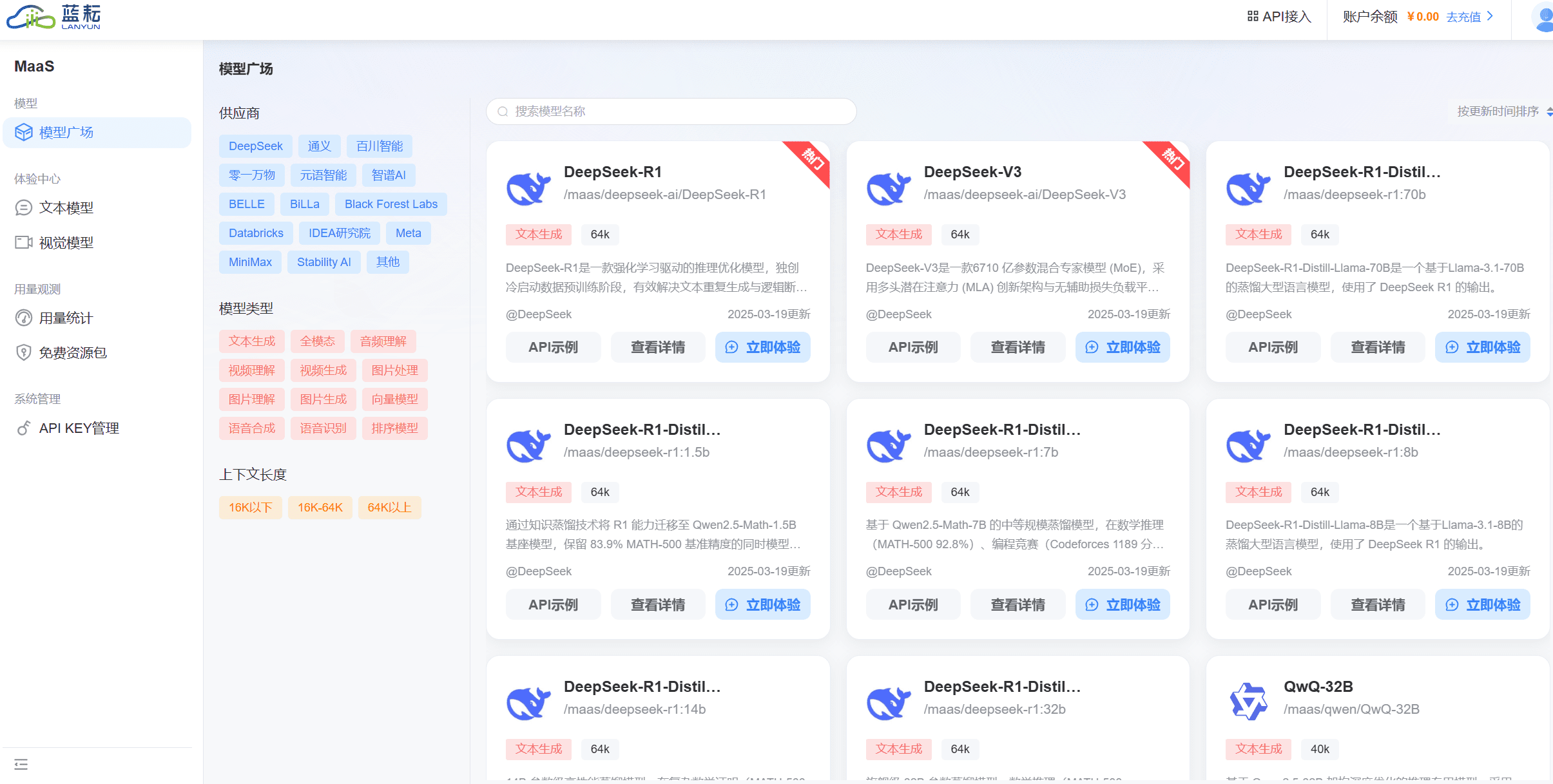

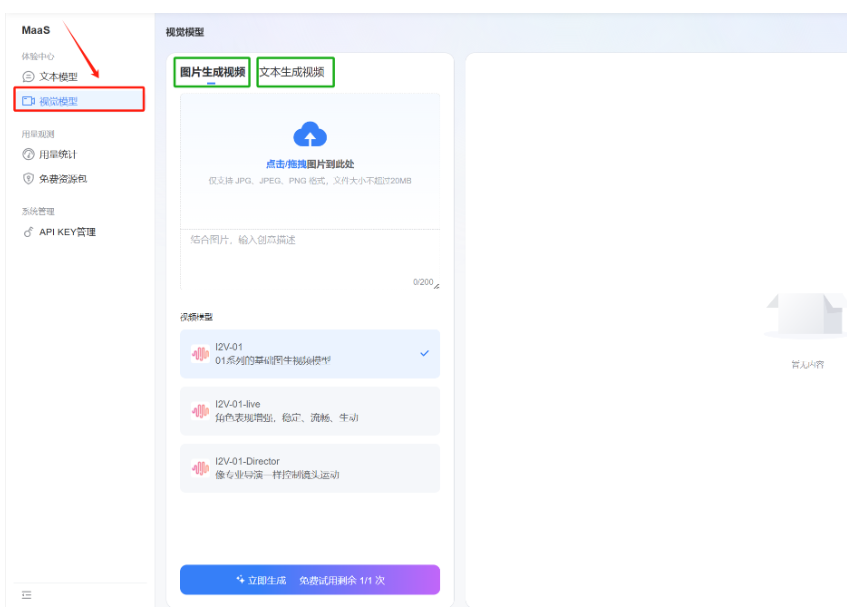

平台支持的模型生态

蓝耘平台支持丰富的大模型生态,涵盖文本、视觉、多模态、科学等多个领域。在文本模型方面,提供DeepSeek系列、QwQ-32B等模型,各具特色。平台还计划纳管Llama、ChatGLM、零一万物、Stable Diffusion等主流第三方大模型,构建完整的模型服务体系。

技术适配性优势

在多模态支持方面,蓝耘平台深度优化了海螺AI的图生视频和语音克隆能力,提供低代码适配工具,如工业质检视频模板,显著提升开发效率。相比通用云平台需要用户自行开发适配层,蓝耘的方案可节省3-6个月的研发周期。

在长文本处理方面,借助蓝耘的128K上下文扩展技术,海螺AI在文档解析效率上实现40%的提升,尤其在金融合同场景中表现突出。边缘部署方面,蓝耘提供ARM/X86异构编译工具链,支持海螺AI模型在工厂摄像头、医疗设备等边缘端运行,时延控制在50ms以内。

实际应用案例分析

工业质检场景应用

在工业质检领域,海螺AI与蓝耘平台的结合展现了显著优势。通过图生视频能力,系统能够实时分析生产线视频流,检测产品缺陷。蓝耘平台提供的低代码模板使得非技术背景的用户也能快速部署应用,大大降低了AI技术的应用门槛。

金融文档处理

在金融行业,海螺AI的长文本处理能力结合蓝耘平台的扩展技术,能够高效处理复杂的合同文档。系统可以自动提取关键条款、识别潜在风险,并为法律审查提供结构化支持。相比传统的人工审核,效率提升显著。

医疗影像分析

在医疗领域,海螺AI的多模态能力支持医学影像的智能分析。结合蓝耘平台的边缘计算能力,系统可以在医疗设备端实现实时分析,为医生诊断提供辅助支持,同时确保患者数据的隐私安全。

技术发展趋势展望

随着AI技术的不断发展,海螺AI与蓝耘平台的协同创新模式展现出广阔的应用前景。未来,这种模式可能在以下方向实现突破:

模型能力的持续优化

随着算法技术的进步,海螺AI的基础模型将进一步提升参数效率和推理性能。蓝耘平台也将持续优化资源调度算法,为更大规模的模型部署提供支持。

行业适配的深化

针对不同行业的特定需求,海螺AI将开发更多专业化的子模型,蓝耘平台也将提供更加细分的行业解决方案。这种深度定制将进一步提升AI技术在各行各业的应用价值。

边缘计算的普及

随着5G和物联网技术的发展,边缘计算需求将持续增长。海螺AI与蓝耘平台在边缘部署方面的技术积累,将为智能设备的大规模应用提供重要支撑。

开发实践指南

环境配置与接入

开发者可以通过Python环境快速接入海螺AI服务。首先需要获取相应的鉴权信息,包括group_id和api_key。建议使用requests库进行API调用,确保网络连接的稳定性。

参数调优建议

在实际使用中,开发者可以根据具体需求调整tokens_to_generate参数,控制生成内容的长度。bot_setting参数可以用于定制AI助手的角色设定,reply_constraints参数则用于控制回复的风格和格式。

错误处理机制

建议开发者实现完善的错误处理机制,包括网络异常、API限流、参数错误等情况的处理。同时,建议添加重试机制,确保服务的稳定性。

性能优化策略

推理效率提升

对于需要高频调用的场景,建议使用模型缓存机制,减少重复计算。同时,可以通过批处理方式提高吞吐量,降低单位成本。

资源管理优化

蓝耘平台提供了丰富的资源监控和管理工具,开发者可以通过这些工具实时了解资源使用情况,及时调整配置,确保服务的高可用性。

成本控制方案

建议开发者根据业务需求选择合适的计费方案,对于非实时性要求不高的任务,可以考虑使用异步处理方式,降低资源消耗。

行业应用前景

海螺AI与蓝耘平台的协同创新模式,为各行业的数字化转型提供了强大支持。在教育领域,可以用于智能教学辅助系统的开发;在文创产业,可以支持内容创作的智能化升级;在智能制造领域,可以为工业自动化提供AI驱动。

这种技术组合的优势在于既保持了AI模型的先进性能,又通过平台化服务降低了使用门槛。随着技术的不断成熟和应用的深入,预计将在更多领域产生重要影响。

技术挑战与应对

尽管海螺AI与蓝耘平台的组合展现出强大优势,但在实际应用中仍面临一些技术挑战。模型精度与推理速度的平衡、多模态数据的协同处理、边缘环境下的稳定性保障等问题都需要持续优化。

应对这些挑战需要技术创新与工程实践的结合。一方面需要持续改进算法模型,提升基础能力;另一方面需要优化系统架构,确保在实际环境中的稳定运行。

未来,随着硬件技术的进步和软件算法的优化,这些挑战将逐步得到解决,为更广泛的应用场景打开大门。技术的持续演进将推动AI应用向更深层次、更广范围发展。