随着AI应用场景的不断扩展,一个突出的矛盾日益凸显:功能强大的大模型往往伴随着高昂的使用成本。当AI需要处理复杂多步骤任务时,这种成本问题变得尤为明显。OpenAI最近推出的GPT-5.4 mini与nano两款小型模型,正是针对这一痛点提出的解决方案。

轻量化模型的成本优势

在AI任务处理过程中,传统的做法是使用单一大型模型完成所有工作。然而,当任务需要拆分成多个步骤时,这种方式的效率问题就暴露无遗。以客户邮件处理为例,整个过程可能需要理解意图、检索信息、生成草稿、校对润色等多个环节,如果每个环节都调用顶级大模型,总成本将会相当可观。

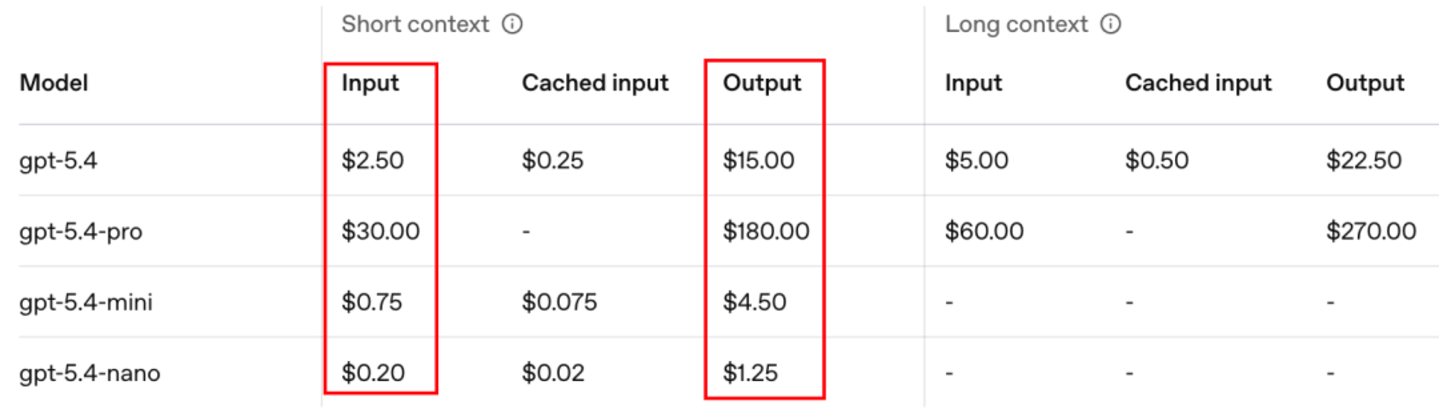

GPT-5.4 mini和nano的出现改变了这一局面。这两款模型均支持400k tokens的上下文窗口,在保持较强能力的同时大幅降低了使用成本。具体来看,nano模型的输入成本仅为旗舰版的8%,输出成本更是降至1.25美元/百万token,相当于旗舰模型的1/12。

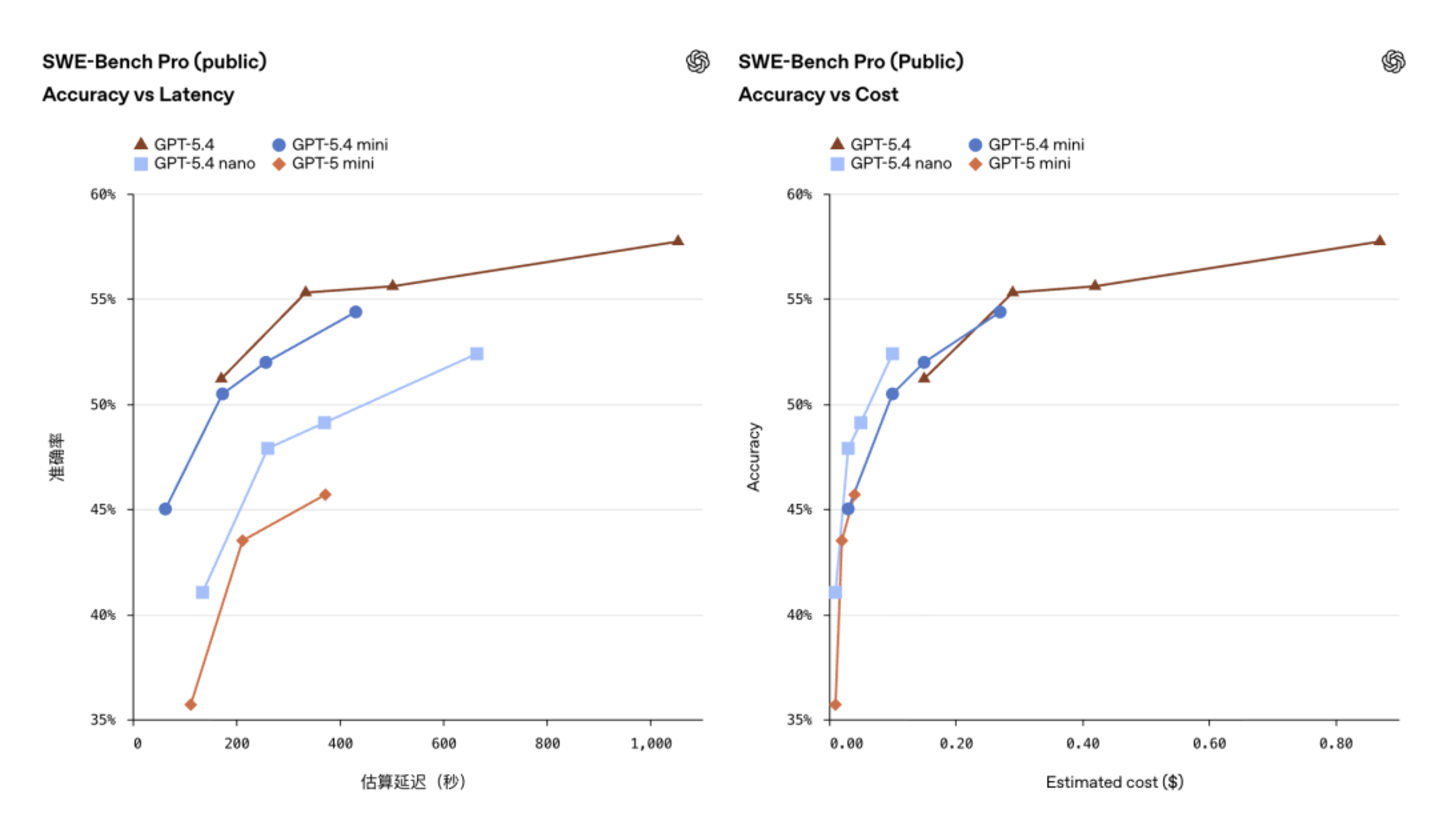

这种成本优势并非以性能的大幅牺牲为代价。在SWE-bench Pro测试中,GPT-5.4 mini的准确率达到54.4%,与旗舰版的57.7%相差无几。这意味着在大多数应用场景下,用户可以用更低的成本获得相近的性能表现。

行业使用趋势的转变

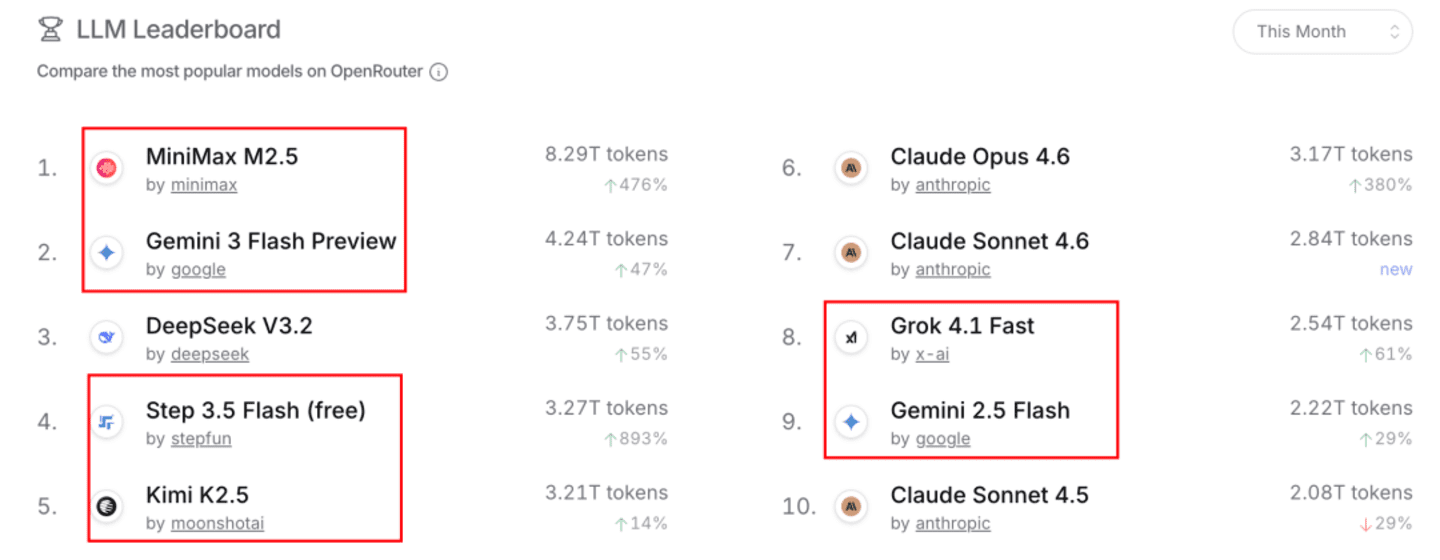

轻量化模型的兴起反映了整个AI行业使用模式的深刻变化。OpenRouter的最新数据显示,在最受欢迎的LLM排行榜中,轻量化模型占据了前十名中的六个席位。排名第一的MiniMax M2.5月度调用量达到8.29T tokens,月度涨幅高达476%,这充分说明了市场对轻量化模型的旺盛需求。

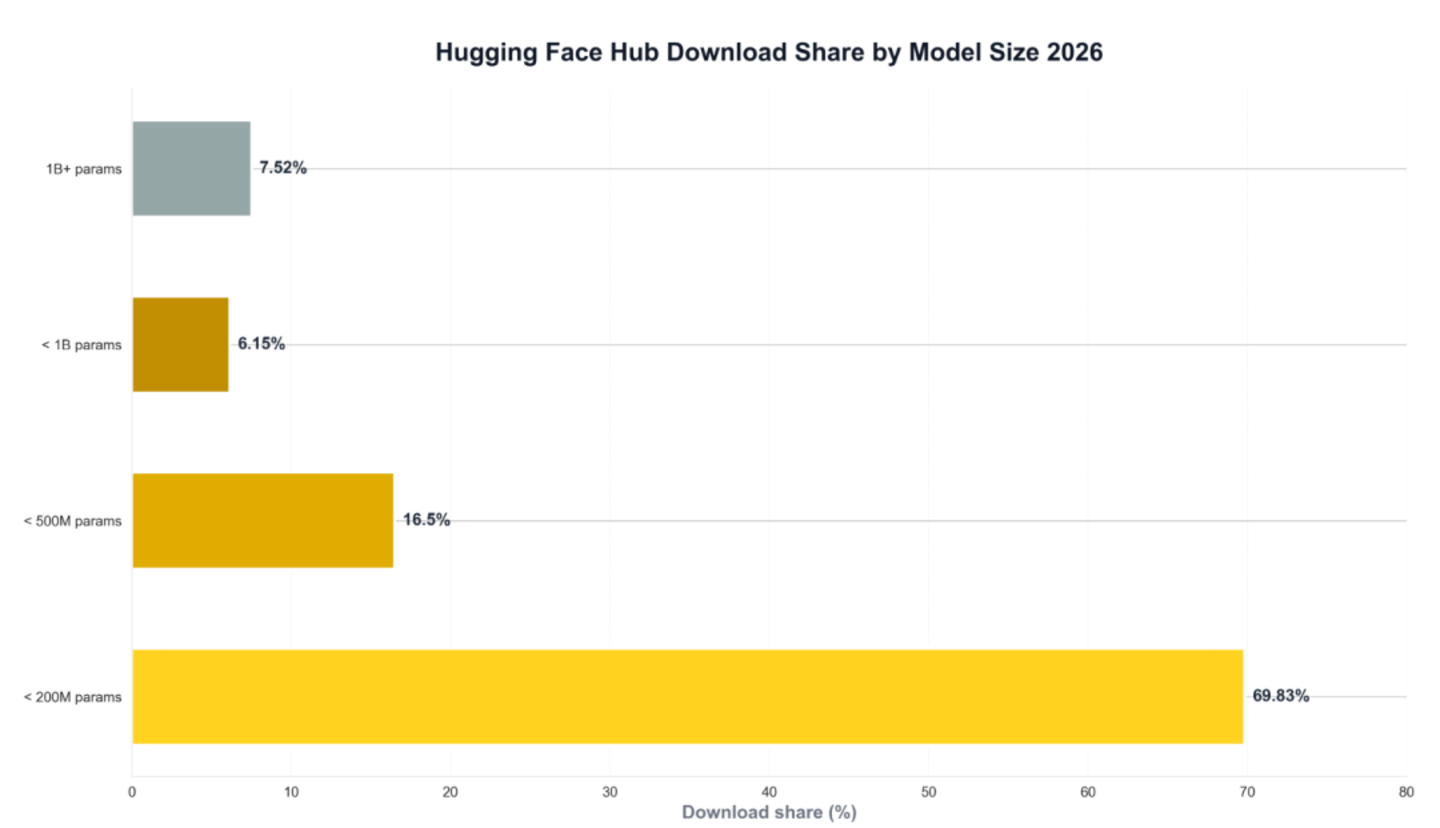

Hugging Face的统计结果同样印证了这一趋势:92.48%的模型下载量来自参数少于10亿的模型,其中86.33%的模型参数在5亿以下。这表明,尽管大型模型在媒体和学术界获得更多关注,但实际落地应用中,轻量化模型才是真正的主力军。

这种趋势的出现有多重原因。首先,大多数C端用户的核心需求是日常对话、文案润色、信息检索等相对简单的任务,这些任务并不需要顶级大模型的全部能力。其次,轻量化模型提供的毫秒级响应速度和无排队等待体验,更好地满足了用户对即时性的需求。

技术架构的创新

OpenAI此次推出的轻量化模型不仅仅是在原有模型基础上的简单压缩,而是基于全新的技术架构思路。这种架构的核心思想是"大模型决策+小模型执行"的混合模式。在这种模式下,大型模型负责理解复杂任务意图并进行步骤拆解,而小型模型则专门负责具体步骤的执行。

这种架构的优势在于能够充分发挥不同规模模型的优势。大型模型在复杂推理和战略规划方面表现出色,而小型模型在执行具体任务时具有成本和速度优势。两者结合,既保证了任务处理的质量,又控制了整体成本。

OpenAI自家的Codex系统已经验证了这种架构的有效性。在该系统中,主模型负责任务理解和步骤规划,然后调度mini/nano级别的子agent执行具体的代码修改、测试运行等任务。每个子任务只消耗极低的成本,而整体任务完成质量却得到保障。

实际应用表现

在OSWorld-Verified测试中,GPT-5.4 mini达到了72.1%的准确率,几乎追平旗舰版的75%。这项测试要求AI像人类一样操作真实电脑环境,包括使用各种软件应用。mini模型的高分表现说明它在界面识别和操作精度方面具有很强能力,这对于自动化任务处理具有重要意义。

然而,轻量化模型并非万能。nano模型在OSWorld-Verified测试中的得分仅为39.0%,说明在需要精细界面操作的复杂任务上,它的能力还有待提升。同样,对于需要深度推理和长链条逻辑的高难度任务,旗舰版大模型仍然具有不可替代的优势。

这种性能差异正好说明了混合架构的价值所在。不同的任务需要不同能力的模型,关键在于如何合理配置和调度。轻量化模型的价值不在于取代大模型,而在于与大模型形成互补,共同构建更高效、更经济的AI应用体系。

对行业生态的影响

OpenAI推出轻量化模型的战略意义远不止于技术层面。从商业角度看,这是一种典型的"薄利多销"策略。通过降低单次使用成本,OpenAI希望能够激发更大的使用量,从而提升总体收入。这种策略在数字经济领域屡见不鲜,但在AI模型服务领域还属于创新尝试。

对开发者而言,轻量化模型的推出意味着AI应用开发门槛的降低。过去因成本问题而难以落地的创意,现在有了实现的可能。特别是对于需要高频调用的应用场景,成本的大幅降低将直接推动创新步伐的加快。

从行业竞争角度看,轻量化模型的推出也在重新定义竞争格局。过去,"便宜"曾是某些国产模型的竞争优势,但现在这个优势正在被削弱。随着国际大厂也开始在成本控制上发力,整个行业的竞争重点可能会转向服务品质、生态建设和创新能力等方面。

未来展望

轻量化模型的发展代表着AI技术普及化的重要一步。当AI使用的成本障碍被逐步消除,我们有理由相信AI技术将在更多领域得到应用,真正成为各行各业的基础设施。

未来的AI应用架构可能会更加注重模型之间的协同工作。大型模型作为"大脑"负责复杂决策,中型模型作为"四肢"处理常规任务,小型模型作为"末梢"执行高频简单操作。这种分级协作的架构不仅能够优化成本效益,还能提高整体系统的稳定性和可靠性。

同时,我们也应该看到,模型轻量化只是AI技术发展的一个方面。在追求成本和效率的同时,如何保证AI系统的安全性、可靠性和道德合规性,仍然是需要持续关注的重要课题。

随着技术的不断进步和市场的日益成熟,AI正在从高高在上的尖端技术转变为普惠大众的工具。这种转变不仅将改变技术本身的发展方向,更将深刻影响社会经济生活的各个方面。