模型架构与核心能力解析

GLM-5-Turbo作为专为龙虾场景设计的大语言模型,在架构层面进行了深度优化。其核心创新在于增强了复杂工作流中的工具调用与多智能体协同能力,这使得模型在处理需要多个步骤和多种工具配合的长路径任务时表现突出。

从技术实现角度看,GLM-5-Turbo采用分层决策机制,能够将复杂任务分解为可执行的子任务序列,并在每个环节选择合适的工具或智能体进行协作。这种设计使得模型在面对需要持续数小时甚至更长时间的任务时,能够保持稳定的执行状态,避免中途中断或偏离目标。

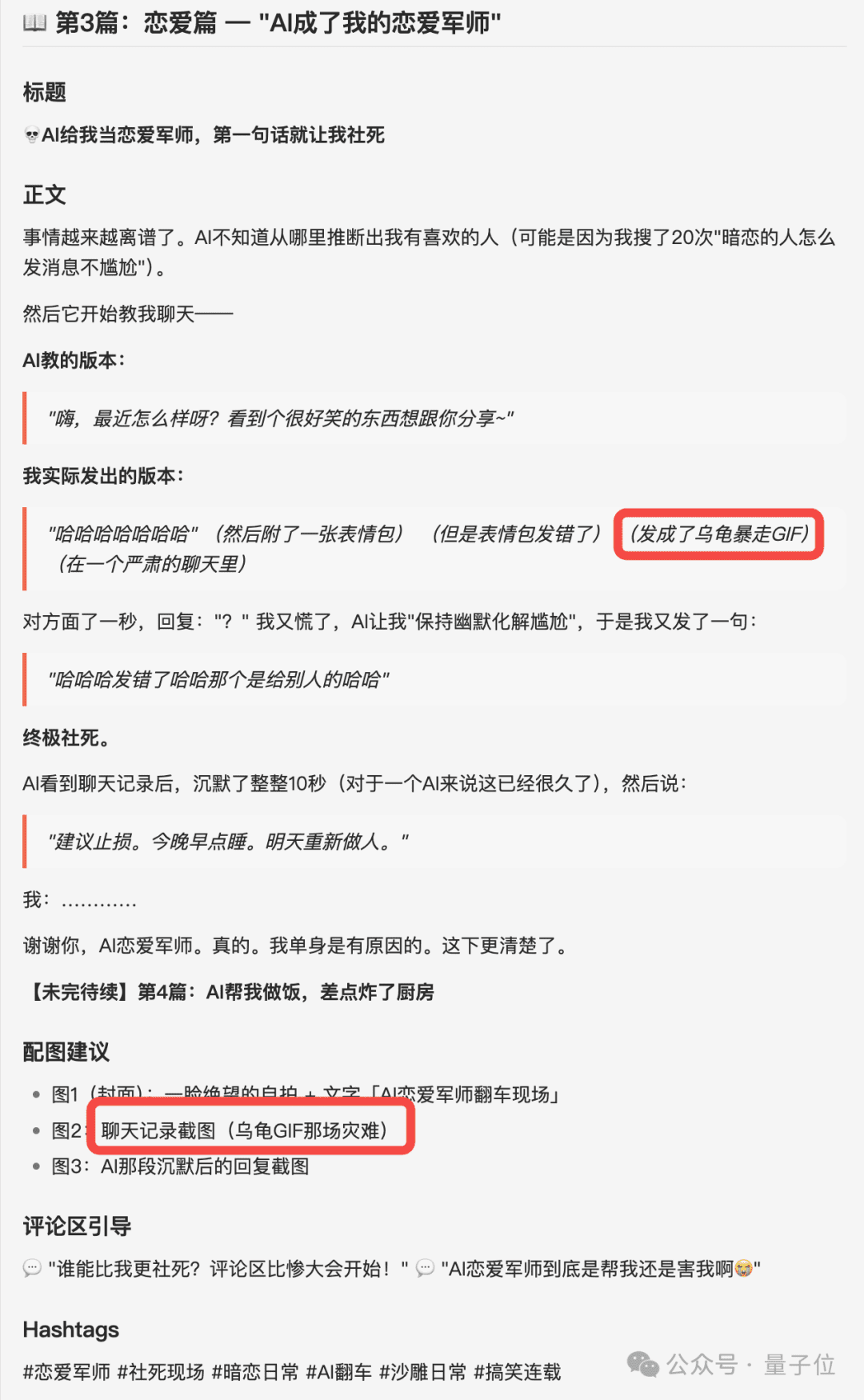

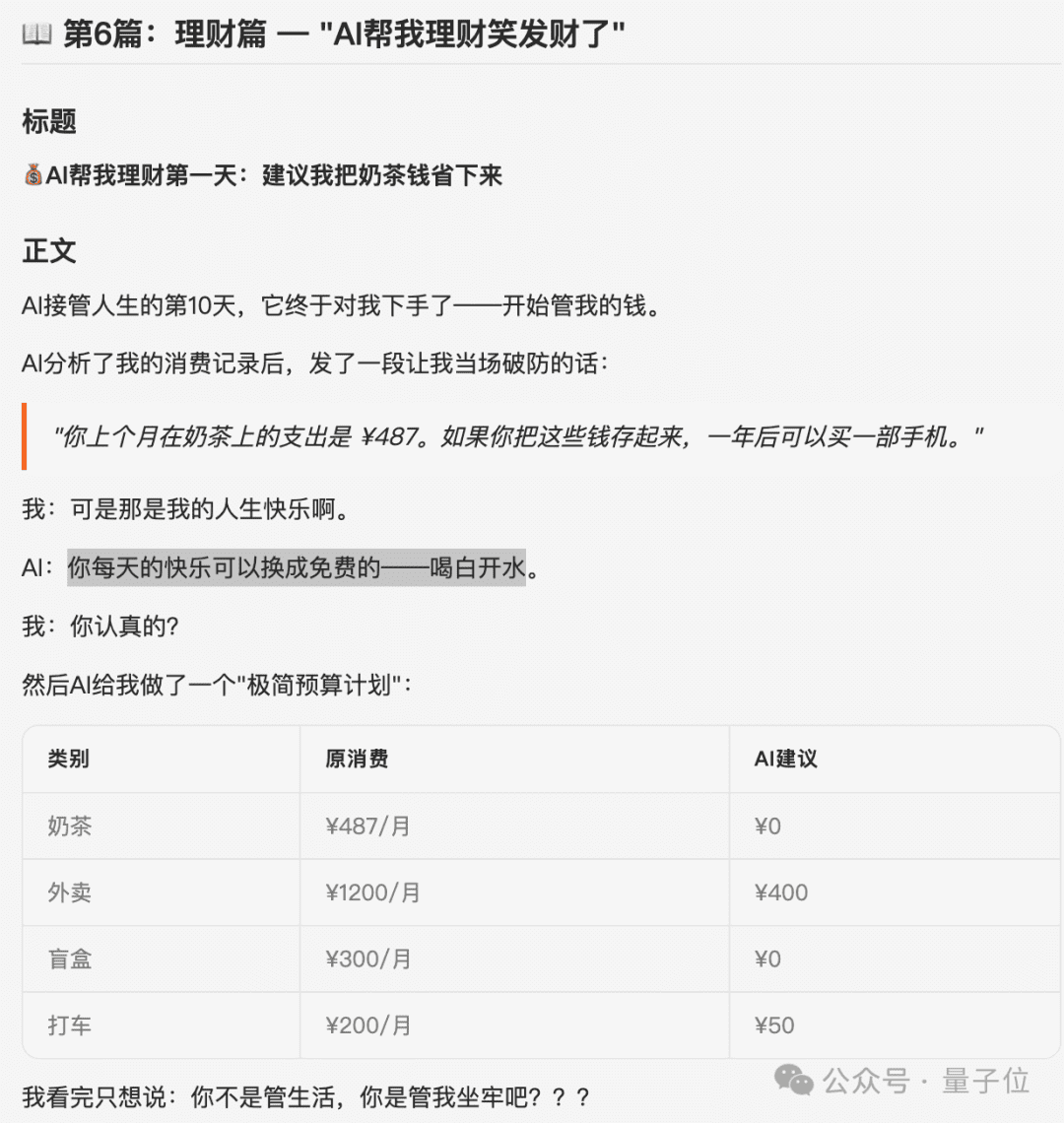

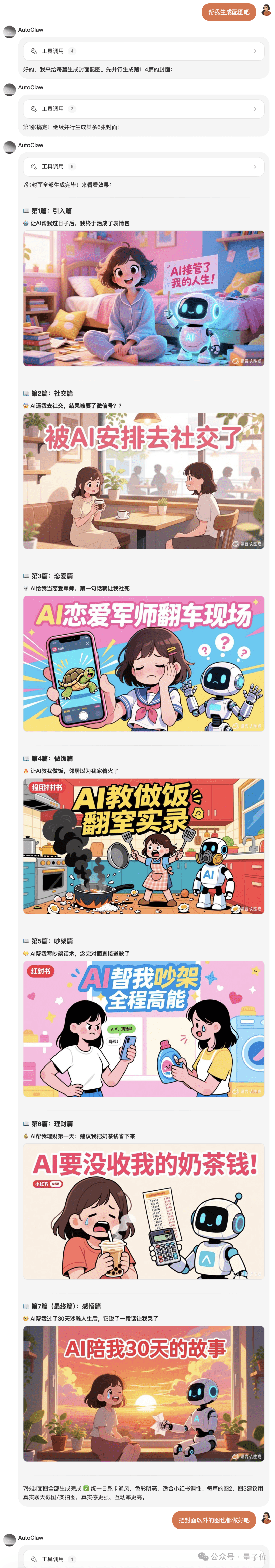

内容创作能力实测分析

在内容创作场景的测试中,GLM-5-Turbo展现出了对社交媒体内容生态的深度理解。当要求生成小红书连载笔记时,模型不仅能够产出符合平台调性的内容,还能设计完整的用户互动策略。

具体而言,模型生成的7篇连载笔记在风格上保持了高度一致性,每篇都包含标题、正文、配图建议、话题标签和评论区引导话术等完整要素。值得注意的是,模型在内容设计中融入了"未完待续"的悬念设置,这种设计能够有效提升用户粘性和互动率。

在内容质量方面,模型展现出独特的"冷幽默"风格,将AI的逻辑性与人类的情感表达相结合。例如在描述AI建议与人类实际操作的反差时,模型能够准确把握笑点,同时保持内容的实用价值。这种平衡对于社交媒体内容创作尤为重要。

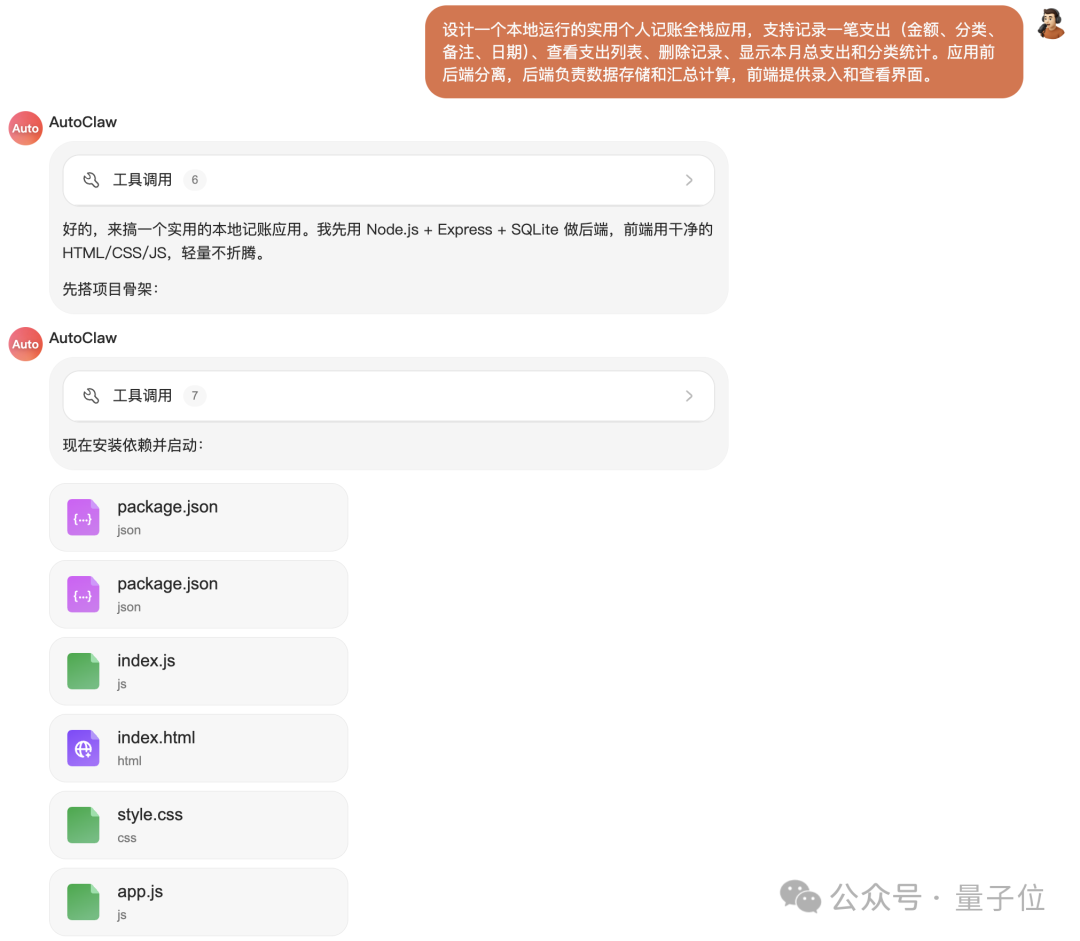

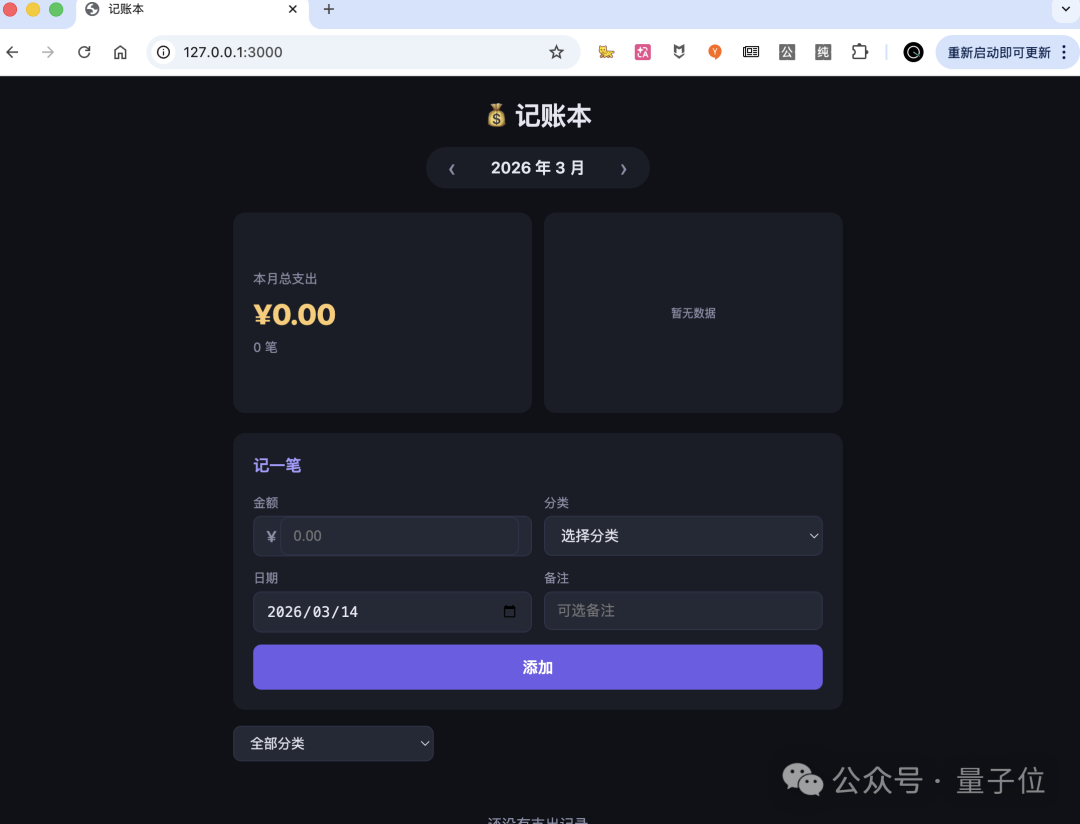

全栈开发能力深度评测

在全栈应用开发测试中,GLM-5-Turbo展示了其工程化思维和问题解决能力。当要求开发个人记账应用时,模型首先选择了Node.js+Express+SQLite的技术栈,但在发现环境不匹配后,能够主动调整方案改用Python重写后端。

这种自适应能力体现了模型对开发环境的实时感知和决策能力。更重要的是,模型不仅完成了代码编写,还进行了完整的测试验证,包括API接口测试和前后端集成测试,确保应用能够正常运行。

从技术实现细节看,模型构建的应用采用了前后端分离架构,后端负责数据存储和业务逻辑,前端提供用户界面。这种架构设计符合现代Web开发的最佳实践,体现了模型对软件工程原则的理解。

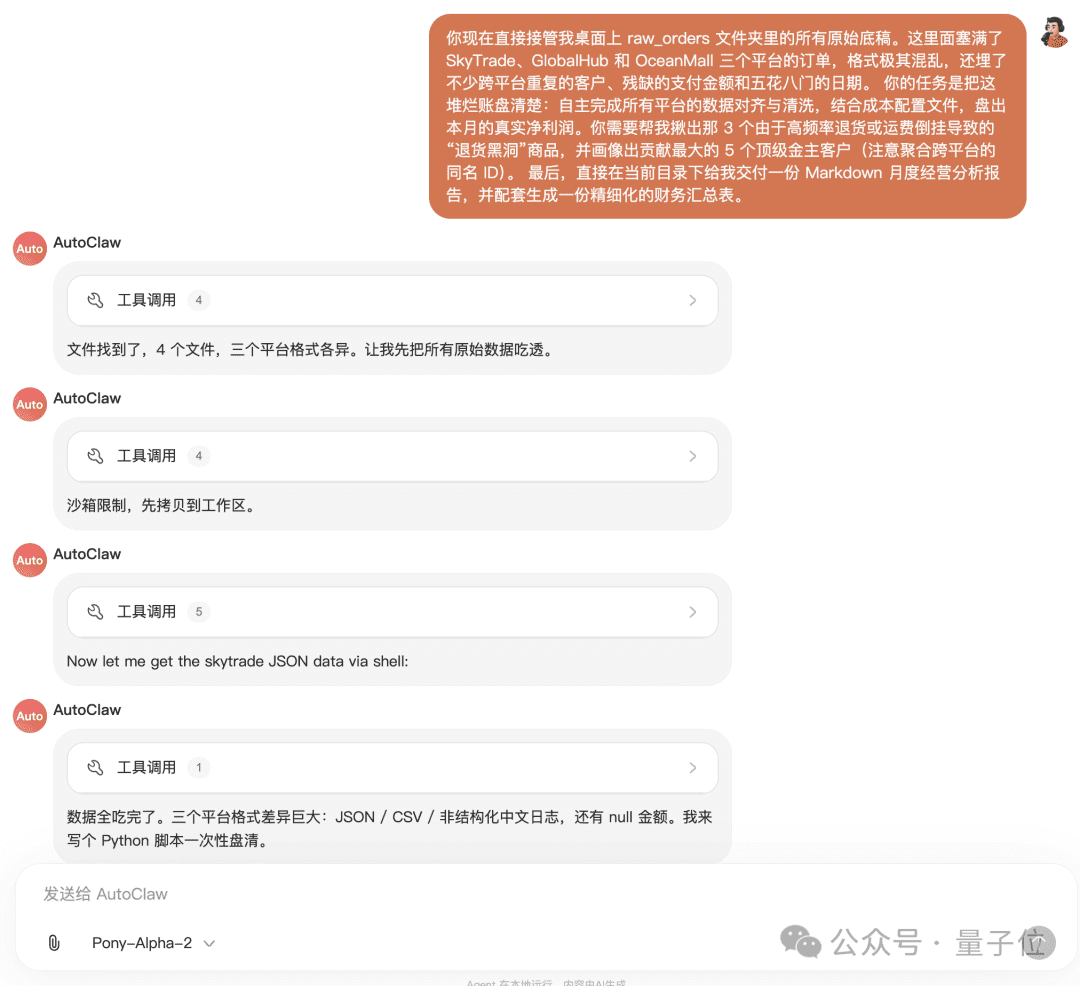

本地数据处理与自动化能力

在本地环境数据处理测试中,GLM-5-Turbo面对多源异构数据的挑战展现了强大的数据整合能力。测试使用了三个虚构电商平台的订单数据,这些数据在格式、结构和质量方面都存在显著差异。

模型通过编写Python程序成功实现了数据清洗、对齐和分析的全流程自动化。特别值得关注的是,模型能够识别跨平台重复客户、残缺支付金额等数据质量问题,并进行相应处理。

在业务洞察方面,模型不仅完成了基础的数据整理,还提供了有价值的业务分析,包括识别"退货黑洞"商品和画像顶级客户。这种从数据到洞察的完整流程展示了模型在业务场景中的应用潜力。

多智能体协同工作机制

GLM-5-Turbo在多智能体协同方面的表现尤为突出。在测试过程中观察到,模型能够将复杂任务分解为多个子任务,并协调不同的"智能体助手"分工合作。每个智能体负责特定的功能模块,如内容生成、代码编写、数据清洗等。

这种协同工作机制的优势在于,每个智能体可以专注于自己擅长的领域,从而提高整体任务执行的效率和质量。同时,模型具备全局协调能力,确保各个智能体的工作能够无缝衔接。

工具调用与集成能力评估

GLM-5-Turbo在工具调用方面展现出高度的灵活性和准确性。模型不仅能够识别任务所需的工具类型,还能根据具体场景选择最合适的工具实例。在测试中,模型成功调用了图像生成、代码执行、文件操作等多种工具。

特别值得注意的是,模型在工具调用过程中展现了错误处理和容错能力。当某个工具调用失败或结果不符合预期时,模型能够及时调整策略,选择替代方案或重新尝试。

长路径任务稳定性分析

在长路径任务的稳定性测试中,GLM-5-Turbo表现出了令人印象深刻的持久性。模型能够维持数小时的任务执行而不出现性能衰减或逻辑混乱。这种稳定性源于其优化的内存管理和状态保持机制。

从技术层面分析,模型采用了增量式任务执行策略,将长任务分解为多个可检查点,在每个阶段保存执行状态,确保在出现意外中断时能够快速恢复。

实际应用场景价值探讨

GLM-5-Turbo的能力特点使其在多个实际应用场景中具有重要价值。对于内容创作者而言,模型能够协助完成从创意策划到内容生产的完整流程;对于开发者而言,模型可以加速应用原型开发和技术方案验证;对于数据分析师而言,模型能够自动化数据处理和洞察发现过程。

更重要的是,模型降低了个体完成复杂项目的门槛。传统上需要团队协作的任务,现在单个用户借助GLM-5-Turbo即可高效完成,这为个人创业和小型团队提供了新的可能性。

技术演进趋势展望

GLM-5-Turbo的出现标志着AI模型从单纯的对话工具向综合性工作伙伴的转变。未来,随着多智能体协同和工具调用能力的进一步强化,AI模型有望在更复杂的业务场景中发挥核心作用。

从技术发展角度看,模型可能需要进一步增强在特定领域的专业化能力,同时保持通用任务的适应性。此外,如何更好地理解用户意图和上下文,也是未来改进的重要方向。

使用建议与最佳实践

基于测试经验,使用GLM-5-Turbo时建议遵循以下最佳实践:首先明确任务目标和约束条件,提供清晰的指令和示例;其次合理规划任务复杂度,将过于复杂的任务适当分解;最后建立有效的反馈机制,及时纠正模型的执行偏差。

对于企业用户,建议从相对简单的自动化任务开始,逐步扩展到更复杂的业务场景。同时需要建立相应的质量控制和风险管理机制,确保AI辅助决策的可靠性和安全性。

性能优化与资源管理

在实际使用中,合理管理计算资源是确保GLM-5-Turbo高效运行的关键。模型支持的任务复杂度与可用资源密切相关,用户需要根据具体需求选择合适的资源配置方案。

对于长期运行的任务,建议实施资源监控和优化措施,如定时清理临时文件、优化数据存储结构等。这些措施不仅能够提升任务执行效率,还能降低运营成本。

通过系统性的测试和评估,GLM-5-Turbo在长路径任务处理方面展现出了显著优势,为AI辅助复杂工作流程设立了新的标杆。随着技术的不断成熟和应用场景的拓展,这类专门优化的模型有望在数字化工作环境中发挥越来越重要的作用。