运筹优化领域的新挑战

在大语言模型逐步从通用推理工具向专业领域应用拓展的过程中,运筹优化成为一个极具吸引力同时也充满挑战的方向。运筹优化问题天然具备清晰的数学结构和可验证的求解结果,看似非常适合由模型自动完成建模与求解。然而,真实运筹建模高度依赖变量定义、约束设计与目标函数之间的整体一致性,其推理过程呈现出强步骤依赖和强耦合特征。

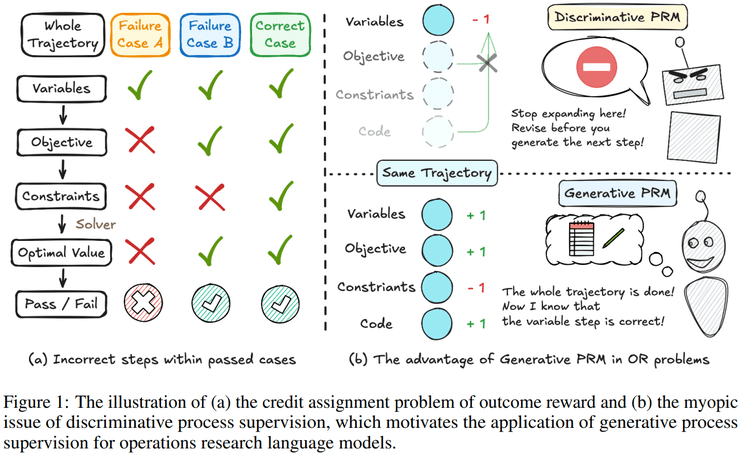

当前运筹建模大模型研究面临的核心困境是:模型在求解器层面得到正确结果,并不意味着其完成了正确的建模。现有训练范式难以准确刻画运筹建模这种长链条推理任务的真实质量,导致建模错误可能被掩盖甚至被反复强化。

StepORLM的创新方法

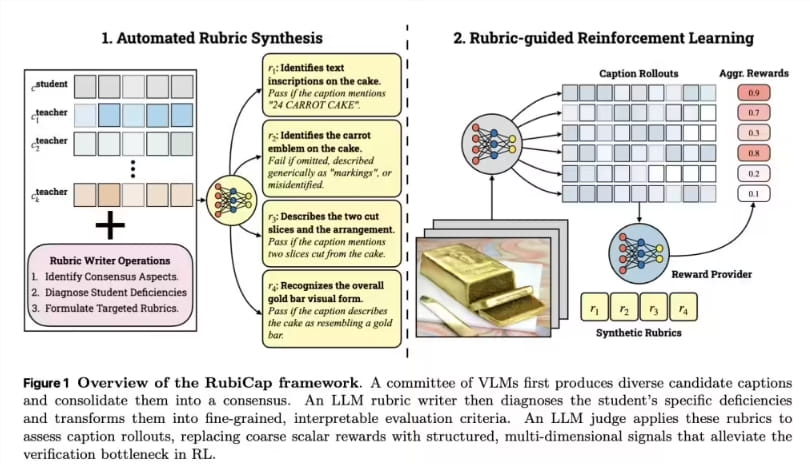

上海交通大学智能计算研究院提出的StepORLM框架,从训练范式本身出发,系统性反思了结果奖励与传统过程监督的根本局限。该框架采用策略模型与生成式过程奖励模型协同进化的自进化训练机制,将最终求解结果与对完整推理过程的回顾式、全局评估相结合。

两阶段训练设计

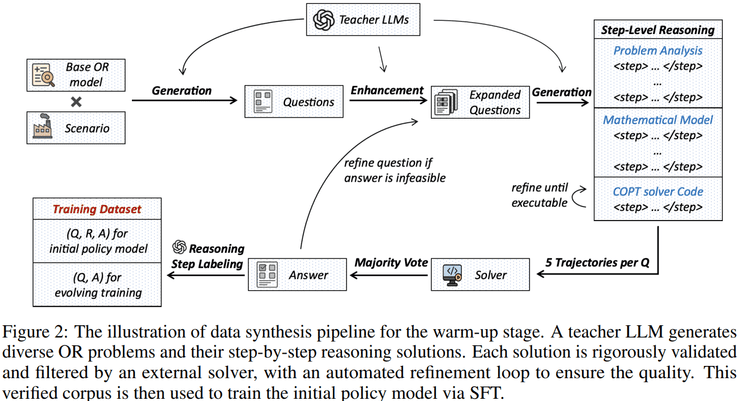

StepORLM的训练过程分为两个关键阶段。在第一阶段的warm-up过程中,研究团队构建高质量的初始策略模型,使其具备基本的运筹优化建模能力。通过教师模型自动生成运筹优化问题并增强问题多样性,每个问题都配备完整的推理轨迹,涵盖问题分析、变量定义、目标函数构建等关键步骤。

第二阶段是策略模型与生成式过程奖励模型协同进化的核心创新阶段。系统同时维护两个模型:策略模型负责生成完整的解题轨迹,而GenPRM则从全局视角对整条推理过程进行回顾式评估。与传统方法不同,GenPRM具备推理与综合判断能力,能够捕捉步骤之间的依赖关系。

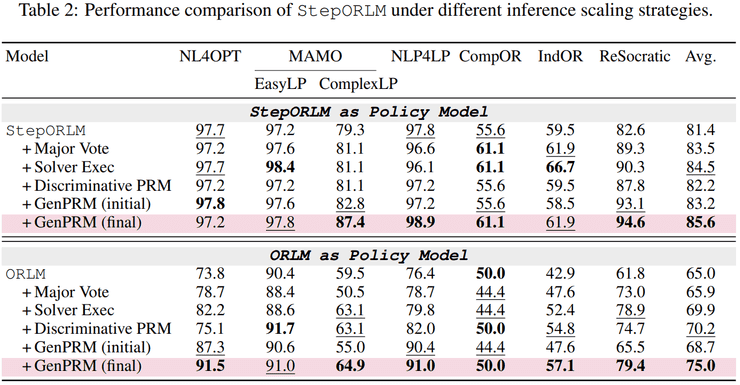

实验验证与性能表现

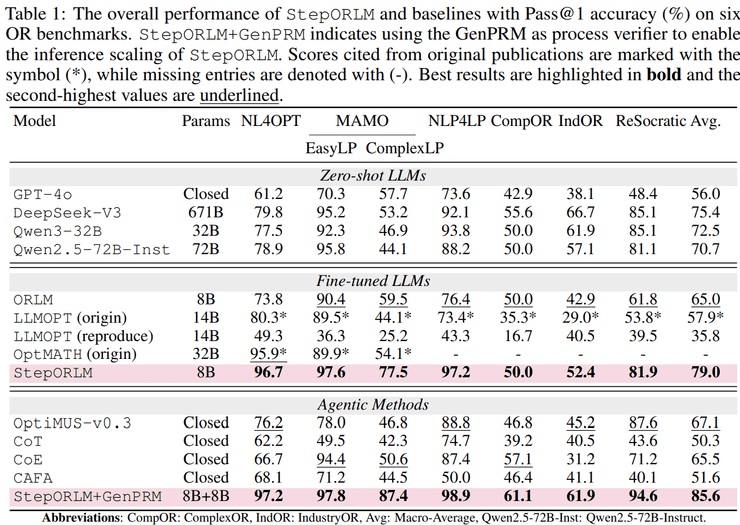

在6个具有代表性的运筹优化基准数据集上的系统测试显示,StepORLM展现出显著优势。这些数据集涵盖了从简单线性规划问题到高复杂度工业级混合整数规划问题,采用严格的Pass@1准确率作为评价指标。

超越大模型的性能

令人印象深刻的是,仅有8B参数规模的StepORLM在平均准确率上明显超过了DeepSeek-V3(671B)和Qwen2.5-72B等超大模型,并全面优于GPT-4o的零样本表现。这一结果表明,在运筹优化建模任务中,训练范式与监督信号设计比模型参数规模更为关键。

与专门针对OR任务微调的模型相比,StepORLM在所有基准数据集上均取得更优结果,在高度依赖多步骤推理正确性的任务中提升尤为明显。与多种agentic推理方法相比,StepORLM仅通过单次生成就能取得更稳定的表现,这得益于其在训练阶段引入过程级监督,从根源上减少错误推理路径被强化的可能性。

生成式过程奖励模型的关键作用

GenPRM在StepORLM框架中扮演着至关重要的角色。实验结果显示,当StepORLM与GenPRM结合使用时,平均Pass@1准确率可进一步提升至85.6%,在最具挑战性的数据集上分别取得约9.9%和9.5%的显著增益。

更重要的是,GenPRM学到的是一种模型无关的运筹推理判据,当其与其他运筹优化模型结合使用时,同样能够带来接近10%的性能提升。这表明GenPRM捕捉到的是运筹推理的本质规律,而非针对特定模型的启发式规则。

技术创新的深层意义

解决监督信号失真问题

StepORLM针对运筹建模任务中存在的两类根本性缺陷提出了有效解决方案。首先是结果导向奖励的信用分配问题,即仅依据外部求解器是否成功对模型进行奖励,可能导致中间推理过程的错误被掩盖。其次是传统判别式过程监督的短视性,这类方法难以理解步骤之间的依赖关系。

自进化训练机制

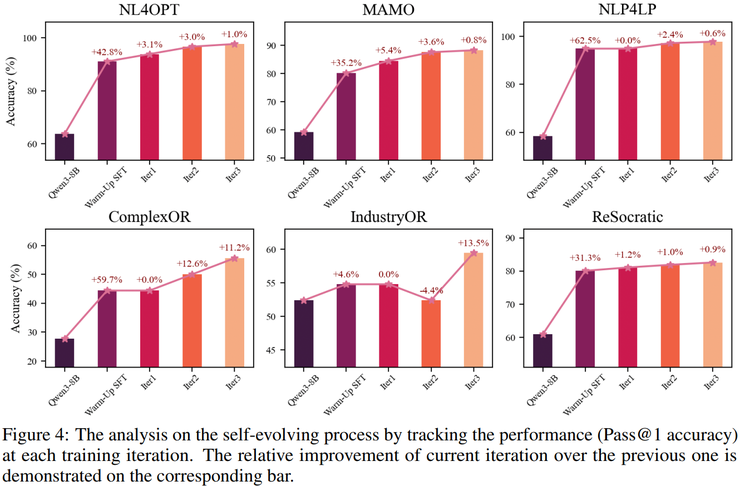

StepORLM的自进化训练机制创造了策略模型与GenPRM之间的正反馈闭环。随着训练迭代推进,策略模型生成的轨迹质量不断提升,为GenPRM提供更高质量的训练样本,而不断进化的GenPRM又能够为策略模型提供更精确的过程反馈。

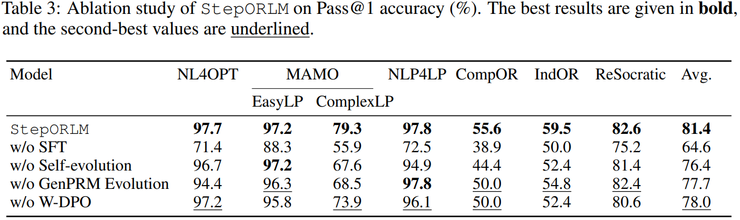

消融实验验证了各个关键组件的必要性:移除warm-up阶段的监督微调会导致性能大幅下降,取消自进化训练会使模型性能迅速停滞,冻结GenPRM不再进化或用普通DPO替代加权DPO均会削弱学习效果。

方法论启示与应用前景

可迁移的训练范式

StepORLM提出的训练范式对其他复杂推理任务具有重要启发意义。其强调的整体化、回顾式过程监督思想,可推广至数学证明、代码生成、科学建模以及其他长链条决策任务,为解决强依赖推理场景中监督信号失真的问题提供了普适性思路。

工业应用价值

在运筹优化与大语言模型结合的研究领域,StepORLM显著提升了模型在建模正确性、约束完整性以及实际应用可靠性等方面的表现。通过引入过程级监督与自进化训练机制,推动大语言模型从"会写线性规划"向"会进行运筹建模"转变,为工业级应用奠定了坚实基础。

未来发展方向

StepORLM的成功为运筹优化领域的大模型应用开辟了新的可能性。未来研究可进一步探索以下方向:将类似训练范式应用于更广泛的优化问题类别,研究不同领域特定知识的融入方式,以及开发更加高效的自进化训练算法。

同时,该方法论也为理解大模型在专业领域的推理机制提供了新的视角,有助于揭示复杂推理任务中的本质规律,推动人工智能在专业领域的深入应用。

从技术层面看,StepORLM不仅解决了当前运筹建模中的具体问题,更重要的是提供了一种思考AI系统可靠性的新框架。这种从"偶然正确"到"系统可靠"的转变,代表了AI系统从工具性向专业性进化的重要里程碑。