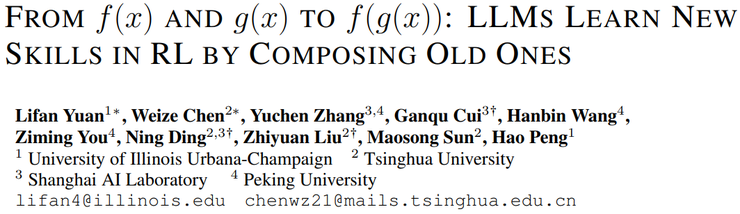

随着大语言模型规模的不断扩大和预训练强度的持续提升,强化学习在后训练阶段的作用正引发深入讨论。当前存在一个关键争议:强化学习究竟是在拓展模型的能力边界,还是仅仅在重排模型已有的解法?

实验设计的创新之处

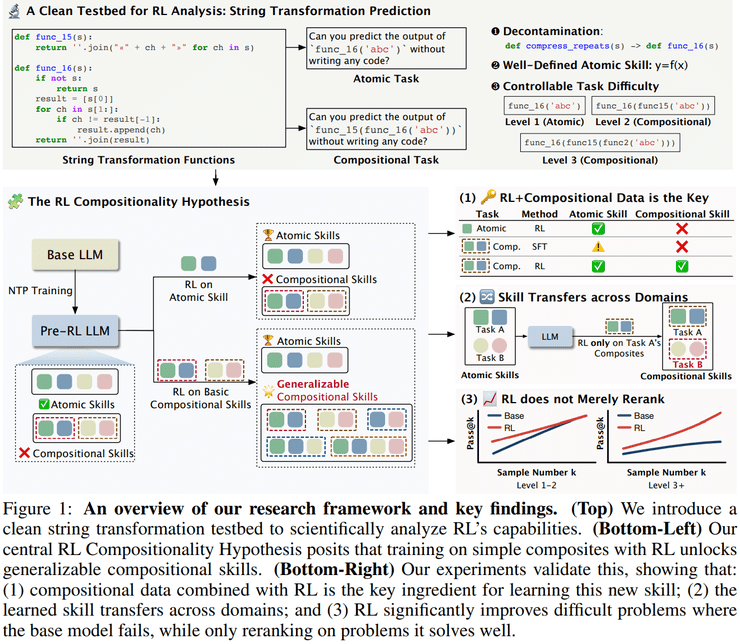

为了回答这一根本问题,研究团队选择退回到一个高度可控的实验环境。他们没有继续在复杂的自然语言任务中进行争论,而是设计了20余个随机命名的字符串操作函数任务。这种设计具有多重优势:函数行为完全确定、复杂度可严格控制、能够排除预训练语料的潜在污染。

实验核心在于对比两种能力:原子能力和组合能力。原子能力指模型在不依赖提示中函数定义的情况下准确预测单一函数输出的能力;组合能力则指模型预测多层复合函数执行结果的能力。由于所有函数都采用随机命名,模型在预训练阶段不可能具备这些任务的原子能力。

训练流程的精心设计

研究采用了两阶段训练流程,刻意将"掌握单个技能"和"学会组合技能"分离。第一阶段通过监督学习训练模型掌握每个字符串变换函数的具体行为,建立稳定的原子技能基础。第二阶段完全隐藏函数定义,仅向模型提供函数名称和输入字符串,迫使模型真正理解并组合已掌握的原子技能。

在第二阶段,研究人员系统比较了监督学习和强化学习两种训练方式。强化学习只提供基于最终结果正确与否的奖励信号,这种设计使得模型必须通过探索和策略更新来学习组合策略。

关键发现与证据链

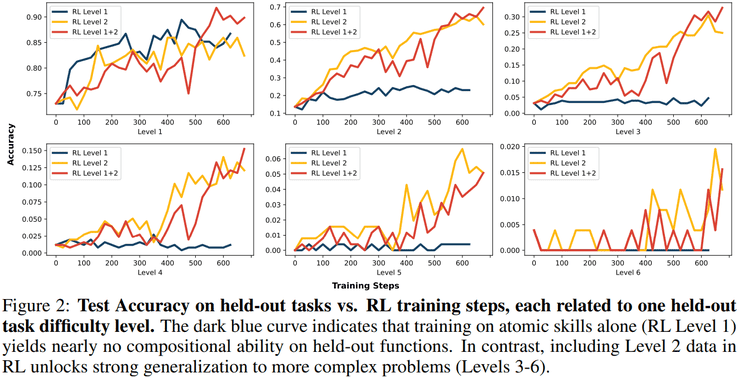

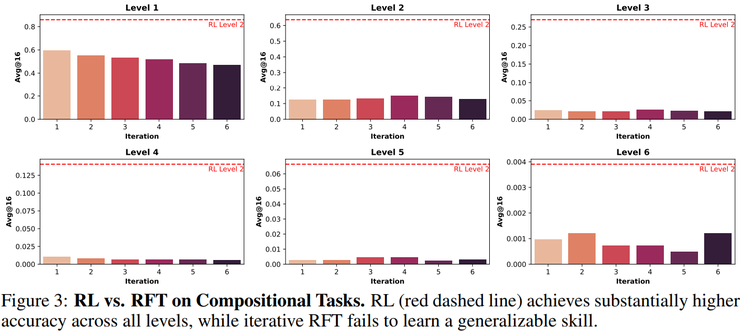

实验结果显示,仅在单函数上进行强化学习的模型,在更深层次的组合任务上表现几乎为零。然而,一旦训练数据中包含基础的二层嵌套函数,模型在三层组合任务上的准确率可提升至约30%,在四层组合上仍保持约15%,并在更高层级上持续显著优于随机水平。

进一步的对照实验表明,仅提供组合训练数据并不足以产生这种能力。当研究团队在完全相同的二层组合数据上用监督学习替代强化学习进行训练时,模型在更深层组合任务上的表现始终处于极低水平。这说明真正起关键作用的是强化学习所引入的结果驱动、探索机制与策略更新过程。

跨任务泛化能力的验证

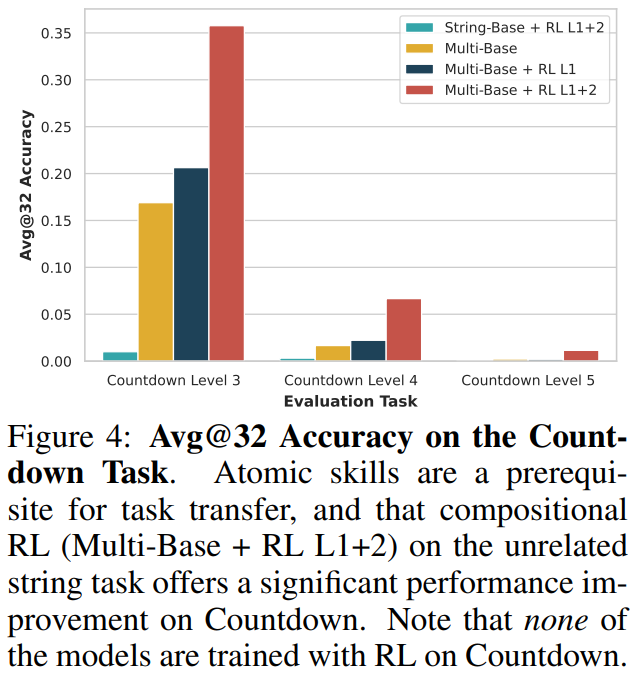

研究还通过跨任务实验验证了组合能力的通用性。如果模型在A、B任务上学习了原子能力,仅在A任务上进行组合能力强化学习,模型就能将该能力泛化至B任务。这表明强化学习获得的并非特定于某一任务的技巧,而是一种能够组织和调度已有原子技能的通用能力。

然而,这种迁移是有条件的。在其他任务上学到的组合能力并不能泛化到模型不具备原子能力的任务上,这说明了原子技能基础的重要性。

对"强化学习只是重排"观点的回应

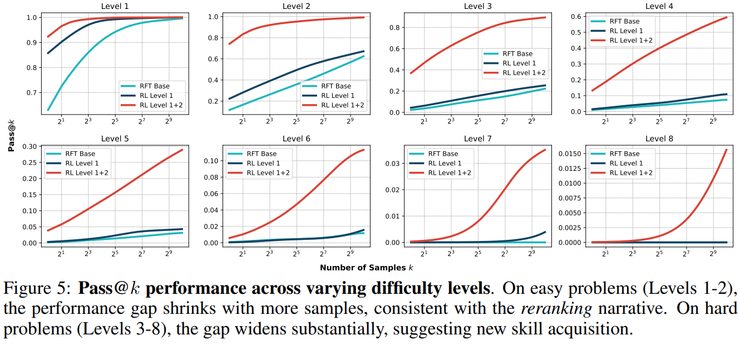

针对"强化学习只是将pass@k压缩为pass@1"的观点,研究人员分析了不同难度任务下的表现差异。在低难度任务上,基础模型本就能通过多次采样得到正确答案,强化学习的作用确实主要体现为重排。但在高难度组合任务中,基础模型即使在极大采样预算下仍表现不佳,而强化学习模型的优势却随着采样数增加而不断扩大。

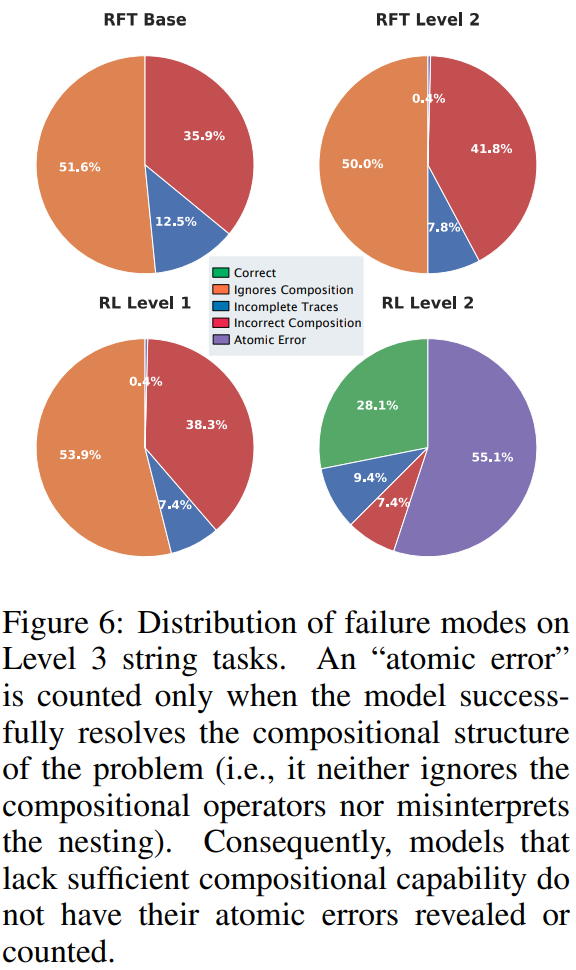

错误类型分析揭示认知变化

错误类型分析提供了更深层次的洞察。基础模型、监督学习模型以及仅进行原子强化学习训练的模型,其主要错误来源于忽略组合结构或误解嵌套关系。而经过组合任务强化学习训练的模型,其错误更多来自原子步骤的执行失误,而非对整体组合结构的误解。

这种错误模式的变化表明,强化学习首先教会模型正确理解和执行组合结构,即使失败也失败在更低层级,体现了认知层面的根本转变。

研究方法论的启示

这项研究在方法论上具有重要启示。通过选择字符串变换函数作为研究载体,研究人员成功构建了一个干净且可控的实验环境。在这种环境下,"技能"被赋予了清晰而可操作的定义:原子技能是正确预测单个函数输出的能力,组合技能是正确推断多个函数顺序作用结果的能力。技能难度由函数嵌套深度直接刻画,使得"新技能"成为可以被精确检验的研究对象。

对大模型训练范式的意义

这项研究对大语言模型的训练流程提供了新的思路。研究人员隐含提出,预训练或监督微调阶段的核心作用在于帮助模型掌握基本操作和原子能力,而强化学习更适合用于学习如何组织和调度这些已有能力,从而形成更高层次的推理和决策结构。

这种训练思路与人类技能学习理论高度一致。就像人类先学习基本的算术运算,再学习如何将这些运算组合解决复杂问题一样,大模型也可能需要类似的分阶段学习过程。

对泛化能力理解的新视角

研究还为理解模型跨任务泛化能力提供了新的分析框架。结果表明,模型在不同任务之间表现提升的根本原因并非知识层面的直接迁移,而是技能结构层面的迁移。模型学会了一种更通用的能力组织方式,从而能够在新的任务中更有效地利用已有的原子技能。

这种视角有助于解释为什么经过适当训练的大模型能够在看似不相关的任务上展现出令人惊讶的泛化能力。关键在于模型是否掌握了组织和使用已有技能的元能力。

未来研究方向

基于这项研究的发现,未来有几个值得深入探索的方向。首先是探索更复杂的技能组合模式,如条件组合、循环组合等。其次是研究如何将这种高度可控环境中的发现推广到更复杂的自然语言任务中。最后是探索如何优化强化学习训练过程,使其更有效地促进技能组合能力的学习。

这项研究为大语言模型的能力发展机制提供了新的实证基础,推动相关讨论从简单的性能指标比较转向更深入的能力结构分析。通过清晰的实验设计和系统的证据链,研究团队为理解强化学习在大模型训练中的作用提供了重要的理论支撑和实践指导。