开源AI工具的安全悖论

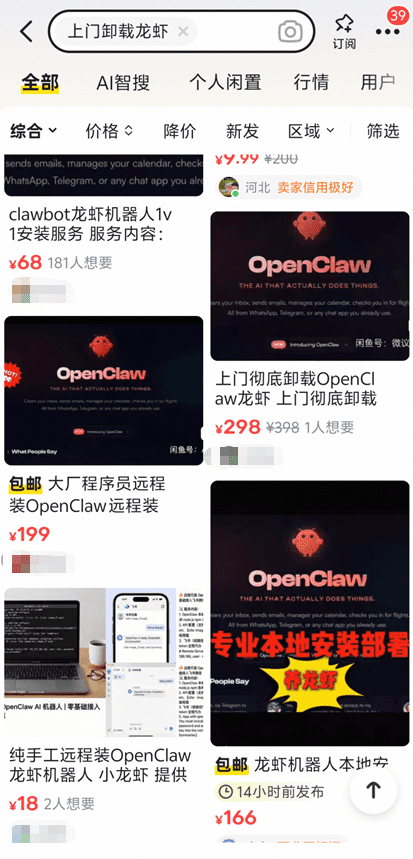

近期,开源AI智能体OpenClaw因高执行权限特性引发安全担忧,市场上甚至出现了专门的卸载服务。这种现象折射出AI技术普及过程中的安全困境:用户往往被功能吸引,却忽视了潜在风险。

OpenClaw默认通过18789端口提供控制接口,这一设计本意是方便用户远程管理,但若部署时未配置适当的防火墙或身份验证机制,就相当于为攻击者打开了后门。网络安全监测数据显示,全球已有超过27万台设备因配置不当处于暴露状态,其中国内约占7.5万台。

安全漏洞的技术解析

从技术角度分析,OpenClaw的安全风险主要源于三个方面:首先是权限设计过于宽松,智能体拥有较高的系统访问权限;其次是默认配置缺乏足够的安全防护;最后是用户安全意识不足,很多新手在部署时未能采取基本的安全措施。

攻击者通过端口扫描工具可以轻易发现这些"裸奔"设备,一旦成功连接,就能获取系统控制权。这不仅可能导致邮箱、网银信息泄露,更危险的是API密钥等敏感数据被窃取。某些情况下,黑客还会植入潜伏性病毒,即使卸载OpenClaw,这些恶意程序仍可能持续运作。

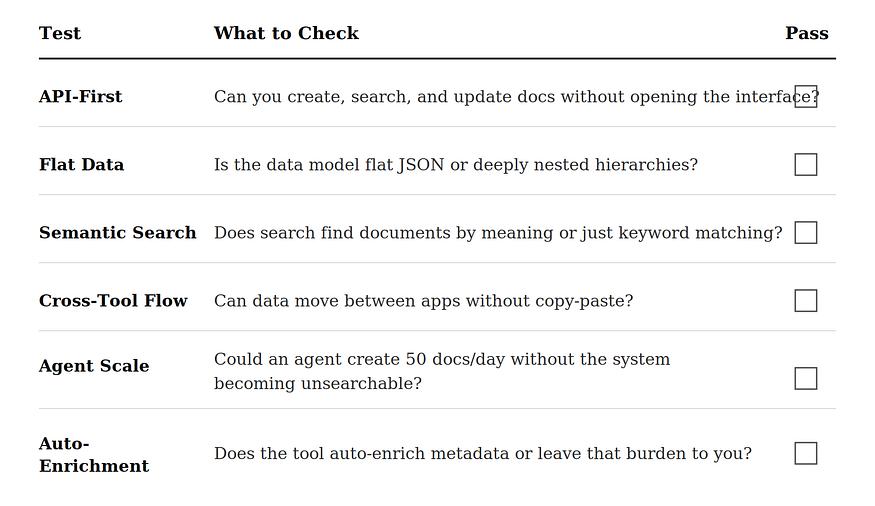

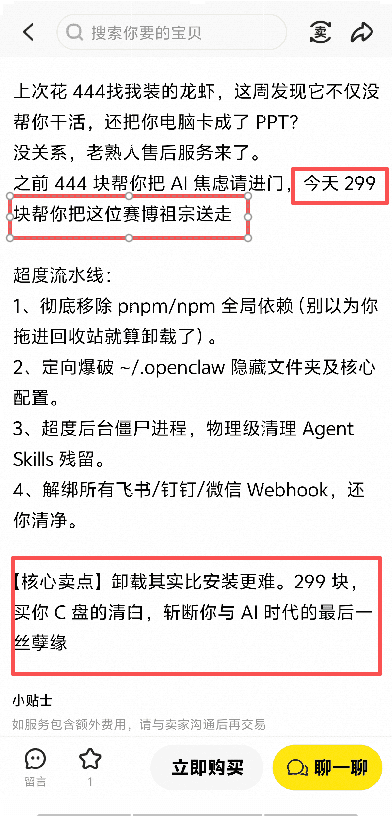

卸载服务的市场反应

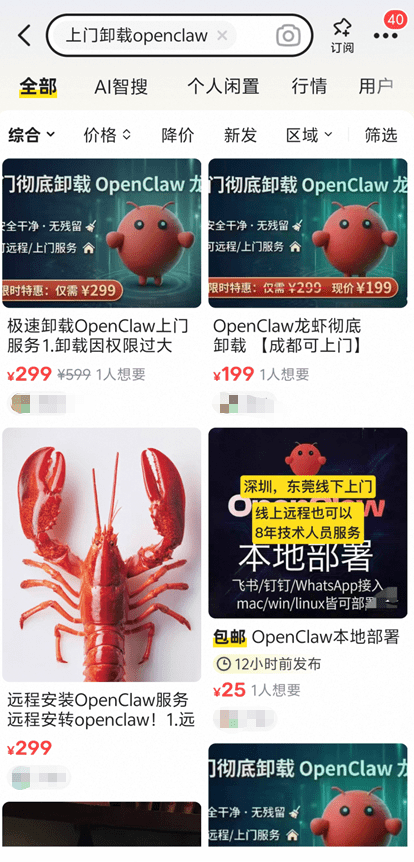

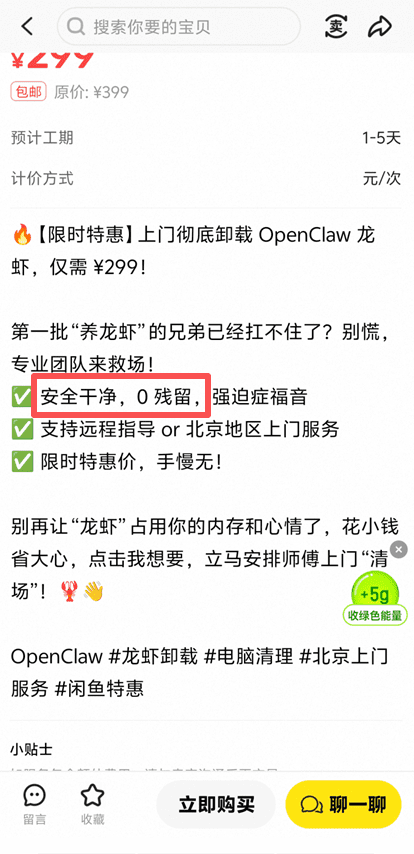

面对日益凸显的安全问题,部分用户选择付费卸载服务。电商平台上,"上门卸载OpenClaw"的服务标价299元,承诺做到"0残留"和"永绝后患"。但专业技术人员指出,这种宣传存在误导性。

虽然专业卸载可以清除OpenClaw及其相关组件,但无法挽回已经泄露的信息,也不能保证完全清除可能存在的潜伏病毒。从风险控制角度看,卸载确实能降低后续威胁,但所谓的"永绝后患"并不现实。

实际案例与用户反馈

部分早期用户反映了他们的使用体验:"最初被'AI自动赚钱'的概念吸引,但实际使用后发现算力消耗超出预期,还要时刻担心安全问题。"还有用户表示:"安装花了499元,现在卸载又要299元,感觉像是被连续收割。"

这些案例表明,用户在尝试新技术时往往缺乏足够的风险评估。许多人在部署前没有充分考虑数据安全和隐私保护问题,等到风险显现时才匆忙寻求解决方案。

专业建议与安全实践

针对这一现象,安全专家提出以下建议:首先,在部署任何AI工具前应充分了解其安全特性;其次,对于开源项目,要检查其安全记录和社区支持情况;最后,普通用户应避免在生产环境或存有重要数据的设备上测试未经验证的工具。

对于已经安装OpenClaw的用户,如果设备存有关键数据,建议寻求专业帮助进行安全卸载和系统检查。若OpenClaw安装在备用设备上,简单的格式化重装系统就能解决问题,无需支付高昂的卸载费用。

AI工具使用的安全框架

从更宏观的角度看,AI工具的使用应该建立完善的安全框架:包括权限最小化原则、定期安全审计、数据加密保护等措施。企业用户尤其需要建立AI工具使用规范,明确哪些类型的AI工具可以部署,以及相应的安全管理要求。

个人用户则应提高安全意识,将AI工具视为与陌生软件同等风险级别的应用。在享受技术便利的同时,必须认识到安全责任主体始终是用户自身。

技术发展与安全平衡

OpenClaw事件反映了AI技术快速发展与安全保障之间的不平衡。随着AI应用场景的不断扩大,类似的安全问题可能会更加频繁地出现。技术开发者、安全研究者和最终用户都需要共同努力,建立更加健全的安全生态。

对于开源项目而言,需要在易用性和安全性之间找到更好的平衡点。默认配置应该倾向于安全而非便利,同时提供清晰的安全指南帮助用户正确部署。

未来展望与预防措施

展望未来,随着AI技术的进一步普及,类似OpenClaw的安全事件可能会成为常态。预防胜于治疗,用户应当建立"安全第一"的使用理念,在尝试新技术前做好充分准备。

行业组织也应加强安全标准制定和普及工作,通过教育宣传提高用户的安全意识。只有形成技术、标准、教育三位一体的防护体系,才能最大限度地降低AI工具使用风险。