AI安全标准的根本分歧

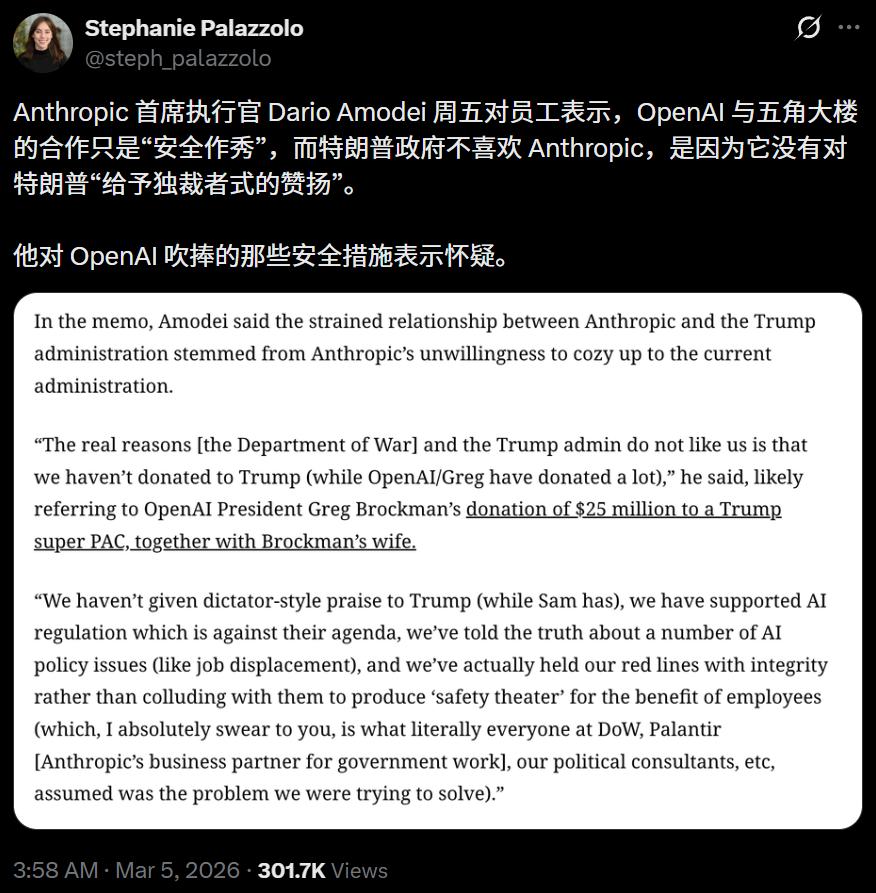

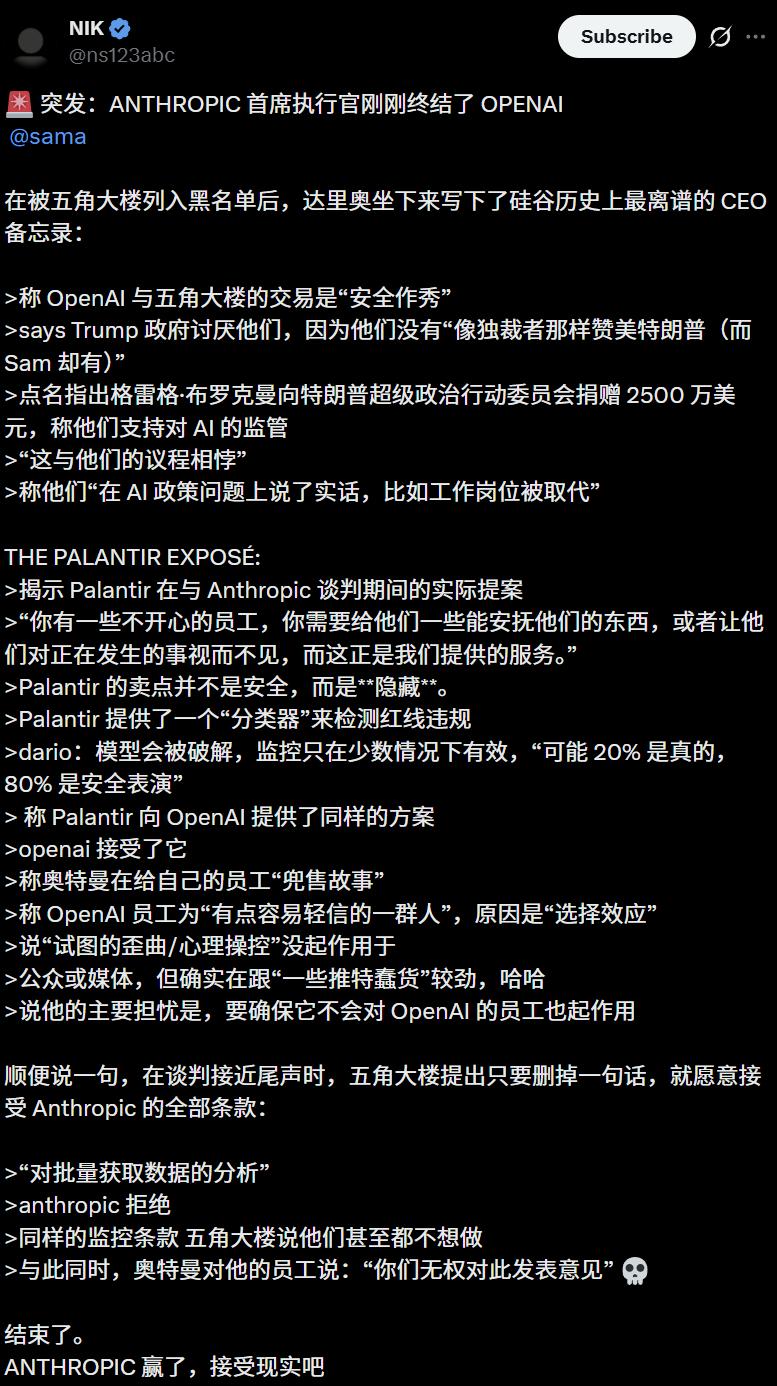

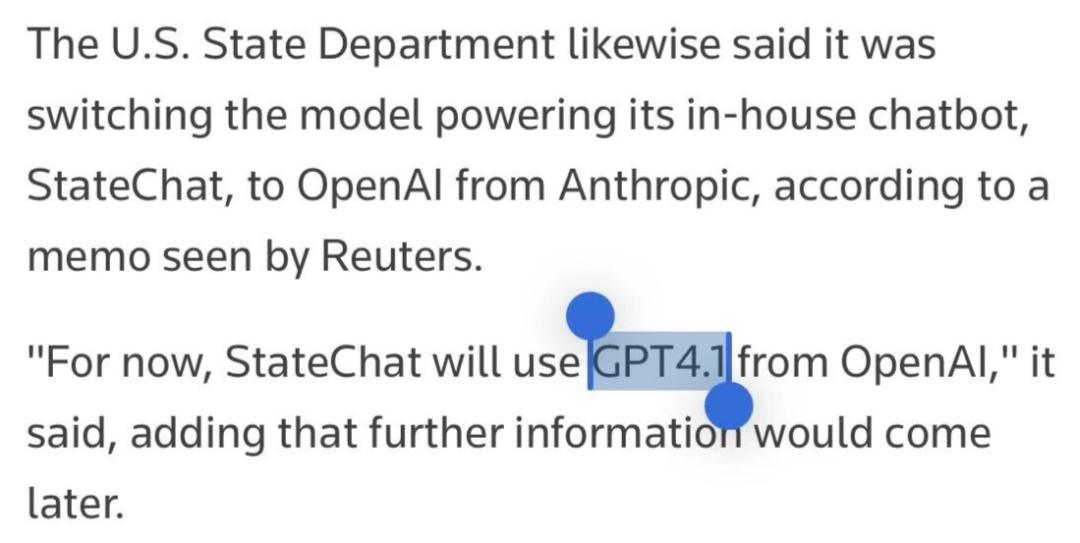

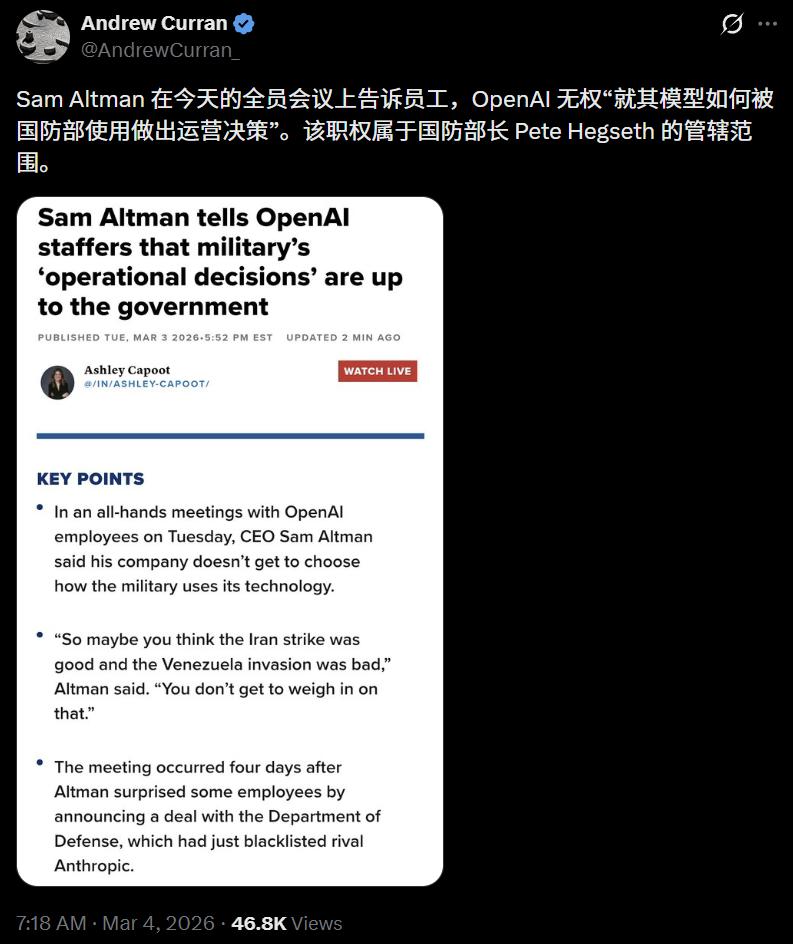

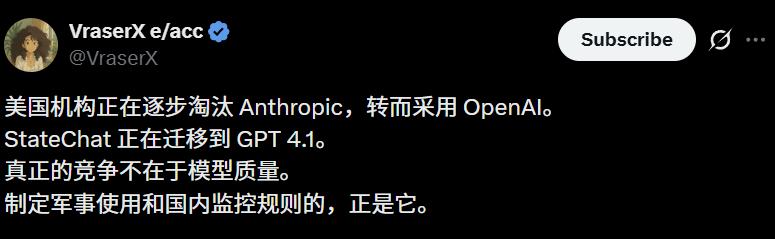

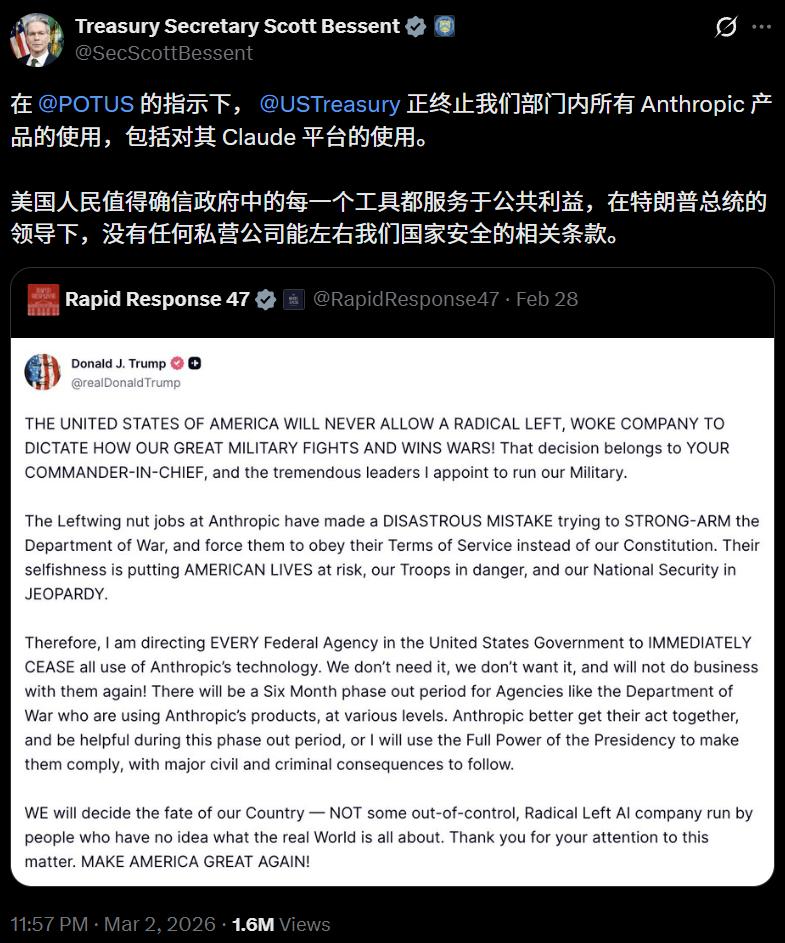

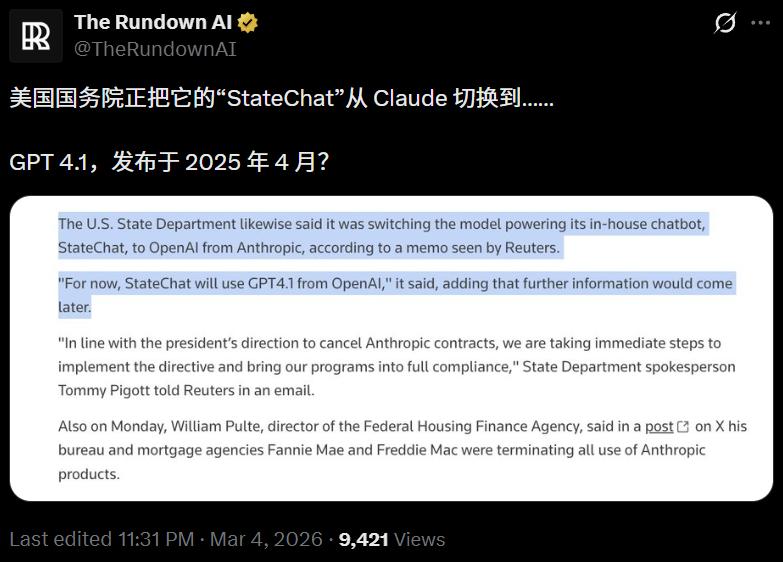

2026年3月,美国政府机构全面停用Anthropic的Claude AI产品,这一决策在硅谷引发强烈震动。事件的核心在于AI安全标准的不同理解与应用。Anthropic坚持设立明确的技术红线,而OpenAI则选择了相对灵活的合作路径。

从技术安全角度看,AI模型在军事应用中的风险控制确实存在实质性挑战。机器学习系统的可解释性和可控性仍然是业界难题。当AI系统被部署在关键任务场景时,任何潜在的安全漏洞都可能产生严重后果。

企业战略选择的深层分析

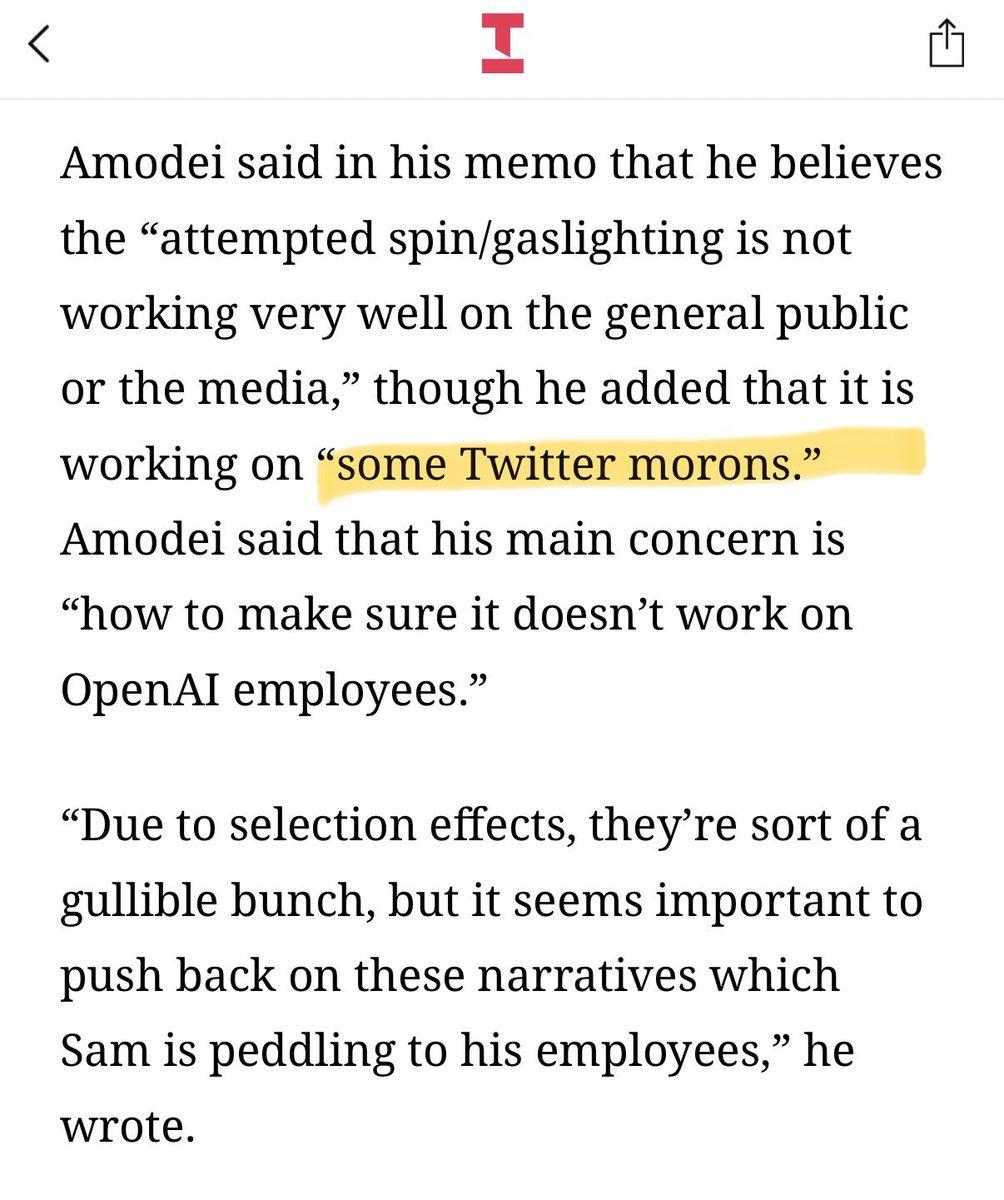

Anthropic与OpenAI在政府合作策略上的差异,反映了两种不同的企业价值观和商业模式。Anthropic倾向于建立严格的技术伦理框架,而OpenAI更注重商业机会的把握。这种差异不仅体现在政府合作中,也影响着两家公司的产品开发方向和市场定位。

从商业角度分析,政府合同往往具有稳定性和规模优势,但同时也伴随着严格的合规要求和公众监督。企业在权衡商业利益与社会责任时,需要做出战略性选择。

技术安全评估的现实挑战

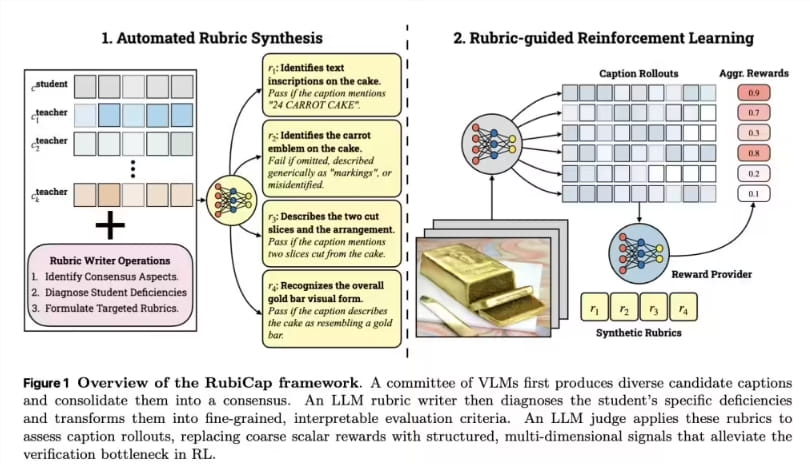

在AI军事应用的安全评估方面,现有技术确实存在局限性。Amodei提到的"分类器"系统只能提供有限的安全保障,这一观点得到了业内专家的认同。AI模型的"越狱"风险始终存在,特别是在对抗性环境中。

技术层面,AI安全需要从多个维度进行保障:模型训练的数据质量、算法的鲁棒性、部署环境的安全性等。单纯依靠事后监控难以完全消除风险,需要在系统设计阶段就融入安全考量。

政府采购决策的影响因素

美国政府转向GPT-4.1的决策,不仅基于技术考量,还涉及政治、经济等多重因素。政府AI采购往往需要平衡技术创新、成本效益、国家安全和公众信任等多个目标。

从供应链安全角度,政府倾向于选择具有稳定技术支持和可靠服务保障的供应商。Anthropic被贴上"供应链风险"标签,反映出政府在AI采购中对供应商稳定性的高度关注。

产业生态的重构趋势

这一事件预示着AI产业生态可能面临重大调整。国防科技公司纷纷与Anthropic切割,反映出行业对政府政策变化的敏感度。在高度监管的领域,企业需要具备快速适应政策环境变化的能力。

从投资角度看,这一事件可能影响风险资本对AI安全初创公司的投资决策。投资者会更加关注企业的政府关系管理能力和合规风险控制能力。

技术路线的长期影响

两家公司不同的技术路线选择,可能对AI行业的发展方向产生深远影响。Anthropic坚持的安全优先原则,虽然短期内可能面临商业挑战,但长期来看可能推动行业建立更完善的安全标准。

从技术创新角度,安全与性能的平衡始终是AI发展的重要课题。过度强调安全可能限制技术突破,而忽视安全则可能带来不可控的风险。如何在两者之间找到最佳平衡点,需要行业共同探索。

国际合作格局的变化

这一事件还可能影响全球AI治理格局。美国政府的决策可能被其他国家参考,形成连锁反应。不同国家在AI军事应用上的政策差异,可能导致全球AI产业出现区域化特征。

从国际竞争角度看,AI技术的军事应用已经成为大国竞争的重要领域。各国在制定相关政策时,需要综合考虑技术创新、国家安全和国际合作等多重因素。

企业治理的挑战与机遇

这一事件凸显了AI企业在治理结构上面临的独特挑战。如何在追求商业成功的同时保持技术伦理的坚守,是每个AI公司都需要面对的问题。

从组织管理角度,企业需要建立有效的内部治理机制,确保技术开发与商业决策的一致性。同时,还需要建立与政府、公众沟通的透明机制,维护企业的社会信誉。

技术评估体系的发展

当前AI安全评估体系仍处于发展阶段,需要建立更科学、更全面的评估标准。这不仅涉及技术指标,还包括伦理考量、社会影响评估等多个维度。

从标准化角度,行业需要推动建立统一的AI安全评估框架,为政府采购和企业决策提供可靠依据。这需要技术专家、政策制定者和伦理学者等多方参与。

市场反应的深层分析

资本市场对这一事件的反应值得关注。Anthropic面临的挑战可能影响投资者对AI安全领域的信心,而OpenAI的"上位"可能强化其在行业内的领先地位。

从市场竞争角度,这一事件可能加速行业整合进程。具备强大政府关系能力和完善合规体系的企业可能获得更大优势,而单纯依赖技术创新的小型公司面临更大压力。

技术创新的未来方向

这一事件也可能影响AI技术创新的方向。政府需求往往对技术发展具有引导作用,军事应用的特殊要求可能推动AI在可靠性、安全性方面的突破。

从研发投入角度,企业可能需要调整技术路线图,更好地对接政府需求。这不仅涉及核心技术研发,还包括标准制定、测试认证等配套能力的建设。

伦理框架的完善需求

事件反映出当前AI伦理框架仍需完善。特别是在军事应用等敏感领域,需要建立更明确的伦理准则和操作规范。

从伦理治理角度,需要建立多方参与的监督机制,确保AI技术的开发和应用符合社会价值观。这需要企业、政府、学术界和公众的共同努力。

供应链安全的战略意义

Anthropic被认定为"供应链风险",凸显出在关键技术创新中供应链安全的重要性。政府和企业都需要建立更完善的供应链风险管理体系。

从战略安全角度,确保核心技术供应链的稳定性和安全性,已经成为国家竞争力的重要组成部分。这需要从技术研发、产业政策等多个层面进行系统规划。

行业标准的制定进程

这一事件可能加速AI行业标准的制定进程。特别是在安全性和可靠性方面,需要建立更详细的技术规范和测试标准。

从标准化工作角度,需要平衡技术创新与规范约束的关系。过于严格的标准可能抑制创新,而缺乏标准则可能导致市场混乱和安全风险。

投资环境的演变趋势

风险投资环境可能因此事件发生变化。投资者可能更加关注AI企业的政策合规能力和政府关系管理能力,而不仅仅是技术创新实力。

从投资策略角度,需要建立更全面的风险评估框架,将政策风险、合规风险等非技术因素纳入投资决策考量。这要求投资机构具备更强的行业洞察力和风险识别能力。

人才竞争的新的维度

这一事件为AI人才竞争增添了新的维度。具备政策理解能力和合规经验的人才可能更受青睐,企业需要建立更全面的人才培养体系。

从人力资源管理角度,AI企业需要培养既懂技术又懂政策的复合型人才。这要求企业在人才招聘、培训和激励等方面进行创新。

公众认知的教育需求

事件的发展过程反映出公众对AI技术认知的不足。需要加强AI技术的科普教育,帮助公众更好地理解技术发展的现状和挑战。

从科学传播角度,需要建立更有效的沟通机制,让公众了解AI技术的真实能力和局限。这有助于形成更理性的技术讨论环境。

监管框架的优化方向

这一事件为AI监管框架的优化提供了重要参考。监管政策需要在促进创新和防范风险之间找到平衡点。

从监管创新角度,可能需要建立更灵活的监管机制,能够快速适应技术发展的变化。同时,还需要加强国际监管协调,避免监管套利。

技术民主化的挑战

AI技术的民主化进程面临新的挑战。如何在确保安全的前提下促进技术的普惠应用,需要行业共同探索解决方案。

从技术普及角度,需要降低AI技术的使用门槛,同时建立有效的安全保障机制。这要求技术创新与制度建设同步推进。

创新生态的持续发展

尽管面临挑战,AI创新生态仍然充满活力。新技术的出现和新应用场景的开拓,为行业发展提供了持续动力。

从生态系统角度,需要建立更加开放和包容的创新环境,鼓励多元化技术路线的探索。这有助于保持行业创新活力,推动技术持续进步。

未来展望与发展路径

AI技术的发展正处于关键时期。安全与创新的平衡、商业价值与社会责任的统一,将成为行业持续健康发展的核心议题。

从长远发展角度,需要建立更加完善的治理体系,确保AI技术为人类社会带来积极影响。这需要各方共同努力,推动技术向善发展。