运筹优化建模的挑战与机遇

在大语言模型逐步从通用推理工具走向专业领域应用的过程中,运筹优化(OR)成为一个极具吸引力同时也极具挑战性的方向。一方面,运筹优化问题天然具备清晰的数学结构和可验证的求解结果,看似非常适合由模型自动完成建模与求解;另一方面,真实运筹建模高度依赖变量定义、约束设计与目标函数之间的整体一致性,其推理过程往往呈现出强步骤依赖和强耦合特征。

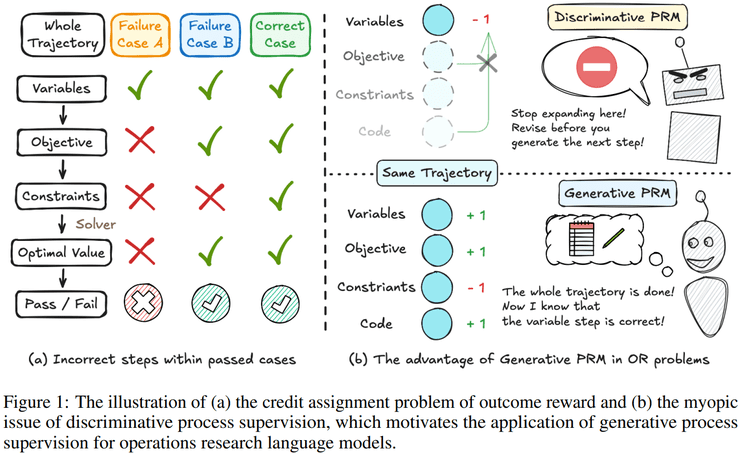

当前运筹建模大模型研究逐渐暴露出一个核心困境:模型在求解器层面得到正确结果,并不意味着其完成了正确的建模。在现有主流训练范式中,无论是仅依据最终求解结果进行奖励,还是对中间步骤进行局部、逐步的过程监督,都难以准确刻画运筹建模这种长链条推理任务的真实质量。

StepORLM框架的核心创新

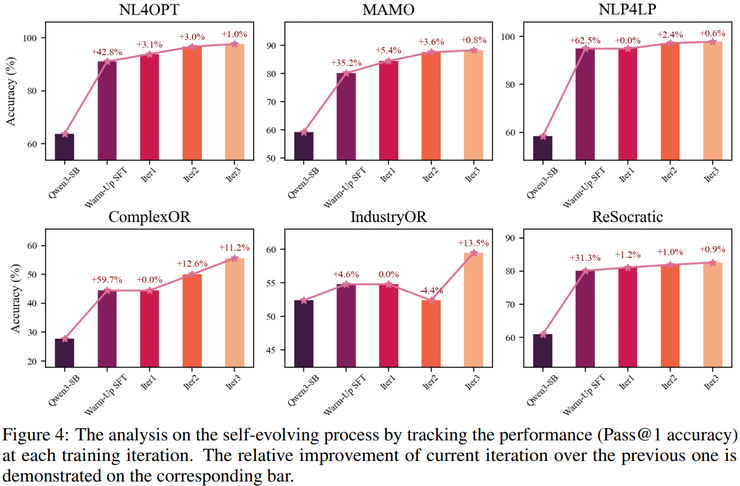

StepORLM框架采用"两阶段训练+自进化闭环"的设计思路。在第一阶段的warm-up过程中,研究团队构建了一个高质量的初始策略模型,使其具备基本的运筹优化建模能力。通过教师模型自动生成运筹优化问题并增强问题多样性,同时为每个问题生成完整的推理轨迹,覆盖问题分析、变量定义、目标函数构建等关键步骤。

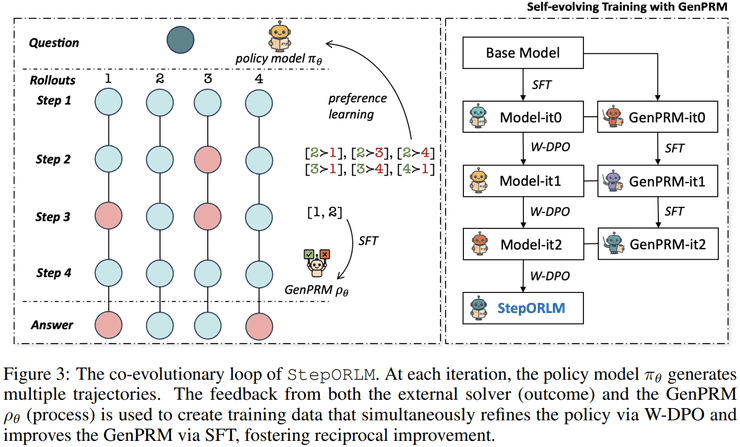

在第二阶段,策略模型与生成式过程奖励模型(GenPRM)协同进化。策略模型负责生成完整的OR解题轨迹,而GenPRM则从全局视角对整条推理过程进行回顾式评估。与传统过程奖励模型不同,GenPRM具备推理与综合判断能力,能够捕捉步骤之间的依赖关系。

实验设计与结果分析

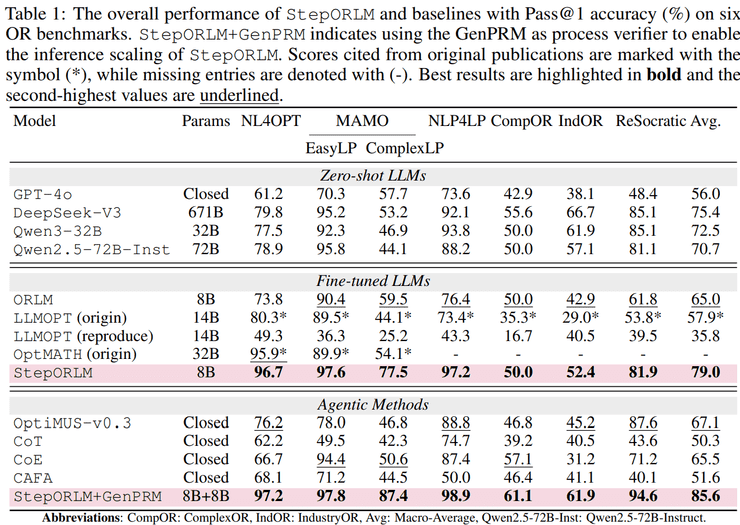

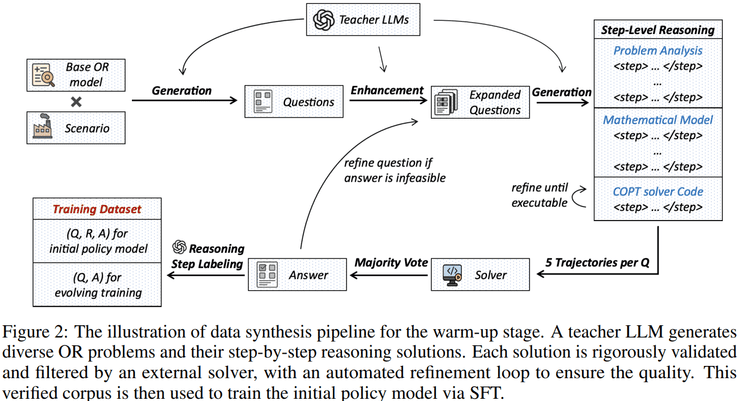

研究在6个具有代表性的运筹优化基准数据集上进行了系统测试,包括NL4Opt、MAMO、NLP4LP、ComplexOR、IndustryOR以及ReSocratic。所有实验统一采用Pass@1 accuracy作为评价指标,即模型仅生成一次完整的解题轨迹,并通过外部OR求解器进行验证。

实验结果显示出三个重要发现:首先,与零样本通用大语言模型相比,仅有8B参数规模的StepORLM在平均准确率上明显超过了DeepSeek-V3(671B)和Qwen2.5-72B等超大模型;其次,与现有专门针对OR任务进行微调的模型相比,StepORLM在所有基准数据集上均取得了更优结果;最后,与多种agentic method推理方法相比,StepORLM仅通过单次生成就能取得更稳定的表现。

生成式过程奖励模型的关键作用

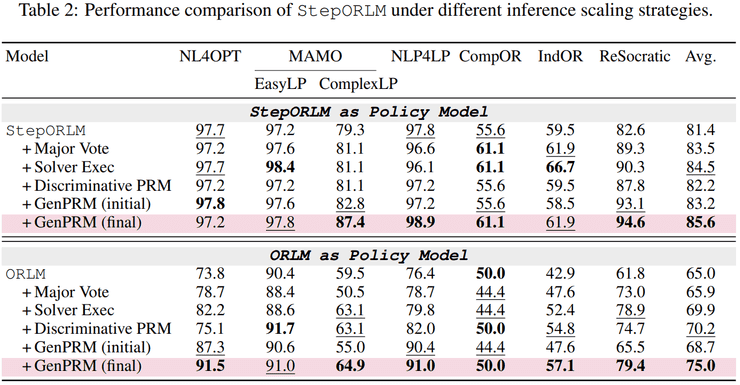

GenPRM在StepORLM框架中扮演着至关重要的角色。当StepORLM与GenPRM结合使用时,其平均Pass@1准确率可进一步提升至85.6%,并在最具挑战性的ComplexOR和IndustryOR数据集上分别取得了约9.9%和9.5%的显著增益。更重要的是,GenPRM学到的是一种模型无关的运筹推理判据,当其与其他运筹优化模型结合使用时,同样能够带来接近10%的性能提升。

自进化训练机制的分析

通过消融实验,研究验证了各个关键组件在整体框架中的必要性。移除warm-up阶段的监督微调会导致性能大幅下降,取消自进化训练会使模型性能迅速停滞,冻结GenPRM不再进化或用普通DPO替代加权DPO均会削弱学习效果。训练过程分析结果表明,模型性能的提升是随着自进化迭代逐步累积的,而非通过一次监督微调即可达到最终水平。

方法论层面的突破意义

从方法论角度来看,这项研究明确验证了一个关键认识:在运筹优化这类具有强步骤依赖特征的任务中,奖励模型本身若缺乏推理能力,将难以为策略模型提供有效监督。传统方法往往假设最终结果正确即可反映推理质量,或认为通过对中间步骤进行逐步、局部打分便能弥补结果奖励的不足。

由于运筹建模中各步骤之间高度耦合,局部正确并不等价于全局一致,只有具备整体理解能力的过程监督,才能有效缓解归因错误和短视问题。StepORLM通过引入过程级监督与自进化训练机制,使模型能够构建逻辑一致、可被求解器稳定执行的完整运筹优化模型。

对其他复杂推理任务的启示

StepORLM提出的训练范式对其他复杂推理任务具有重要的启发意义。其强调的整体化、回顾式过程监督思想,可推广至数学证明、代码生成、科学建模以及其他长链条决策任务。这种范式为解决强依赖推理场景中监督信号失真的问题提供了一种具有普适性的思路。

在数学证明任务中,模型需要确保每一步推导的逻辑严密性和前后一致性;在代码生成任务中,需要考虑变量定义、函数调用和程序结构的整体协调性;在科学建模任务中,需要保证模型假设、数学表达和实际应用场景的匹配度。这些任务都具有与运筹优化建模相似的长链条、强依赖特征。

工业应用前景分析

StepORLM的研究成果为运筹优化在工业界的实际应用提供了新的可能性。在供应链管理、物流优化、生产调度、金融风险控制等场景中,可靠的运筹建模能力至关重要。传统方法往往需要专家手动构建优化模型,过程耗时且容易出错。

通过StepORLM框架训练的大语言模型,可以自动完成从问题描述到数学模型构建的全过程,大大提高了建模效率和可靠性。特别是在需要快速响应市场变化或处理突发情况的场景中,这种自动化建模能力具有显著优势。

技术实现的挑战与对策

尽管StepORLM取得了显著成果,但在实际应用中仍面临一些挑战。首先是计算资源的消耗问题,自进化训练需要多次迭代,对计算资源要求较高。其次是模型泛化能力的保证,需要确保训练得到的模型能够适应不同类型的运筹优化问题。

针对这些挑战,可以考虑采用分布式训练框架来降低单次训练的计算负担,同时通过数据增强和迁移学习技术来提升模型的泛化能力。此外,还可以探索模型压缩和知识蒸馏技术,在保持性能的同时降低模型推理时的资源需求。

未来研究方向展望

基于StepORLM的研究基础,未来可以从多个方向继续深入探索。首先是扩展框架的应用范围,将其应用于更复杂的多目标优化、随机优化等场景。其次是提升模型的解释性,使模型不仅能够生成正确的建模结果,还能够提供清晰的推理过程解释。

另一个重要方向是探索与其他AI技术的结合,如将StepORLM与强化学习、元学习等方法相结合,进一步提升模型的学习效率和适应能力。同时,也可以研究如何将人类专家的先验知识更有效地融入训练过程,实现人机协同的优化建模。

总结与展望

StepORLM框架通过创新性地结合生成式过程监督和自进化训练机制,为大语言模型在运筹优化领域的应用提供了新的思路和方法。该研究不仅解决了传统训练范式中的关键问题,还为其他复杂推理任务提供了可借鉴的技术路线。

随着人工智能技术的不断发展,类似StepORLM这样的创新方法将推动大语言模型在专业领域的应用走向深入。从简单的文本生成到复杂的专业问题求解,大语言模型正在展现出越来越强大的能力,而训练范式的创新将是实现这一转变的关键驱动力。