随着深度神经网络在边缘计算和嵌入式系统中的广泛应用,边缘设备面临着计算资源有限和功耗约束严格的双重挑战。Rockchip RK3588作为当前最受瞩目的边缘AI芯片之一,凭借其集成的6 TOPS NPU,为本地离线AI计算、复杂视频流分析及大模型部署提供了强大的硬件基础。

RK3588硬件架构深度解析

RK3588采用8nm先进工艺,集成了四核Cortex-A76(大核,2.4GHz)和四核Cortex-A55(小核,1.8GHz)的八核CPU架构。这种大小核设计在功耗和性能之间实现了良好的平衡,特别适合边缘AI应用场景。

NPU计算核心架构

RK3588的核心AI加速能力源于自主研发的第三代NPU,其架构设计体现了现代AI加速器的先进理念:

- 三核并行架构:总算力达6 TOPS,采用三个独立的计算核心,每个核心贡献2 TOPS算力

- 多精度支持体系:原生支持INT4/INT8/INT16/FP16/BF16/TF32混合计算,特别针对INT8操作进行了深度优化

- 高效内存子系统:采用三核共享内存架构,支持4通道LPDDR4X/LPDDR5外部存储接口

在实际应用中,RK3588的异构计算架构展现出显著优势。建议将矩阵乘法和卷积等计算密集型算子分配给NPU处理,而将任务调度、数据预处理及控制逻辑保留在CPU上执行。这种流水线设计不仅能提升系统吞吐量,还能实现高达12倍的加速效果。

Android NNAPI系统级深度解析

对于系统架构师而言,理解NPU如何集成到Android生态是性能调优的前提。Android Neural Networks API (NNAPI)是专为硬件加速而设计的系统级C API,其架构设计体现了模块化和可扩展性的现代软件工程理念。

NNAPI运行时架构分析

NNAPI的核心逻辑分布在AOSP的特定目录中:

- 运行时路径:

platform/frameworks/ml/nn/runtime/负责模型图解析、执行调度及CPU回退逻辑 - 模块化设计:自Android 11起,NNAPI Runtime被封装为APEX模块

com.android.neuralnetworks,以libneuralnetworks.so形式独立更新

硬件抽象层接口规范

HAL是框架与供应商NPU驱动之间的正式契约,其设计遵循以下原则:

- 源码路径:

hardware/interfaces/neuralnetworks/ - 接口规范:使用AIDL(Android 12+)或HIDL定义,确保通信独立于编程语言

- 供应商集成入口:驱动通常以

libvendor-nn-hal.so形式存在,核心入口符号为特定服务获取函数

在IDE中进行源码分析时,建议重点关注以下关键符号:

- 性能追踪机制:搜索Tracing.h中的NNTRACE相关宏,用于测量模型图调度延迟

- 模型调试工具:GraphDump.h中的graphDump函数可将计算图输出为Graphviz格式

- 设备发现逻辑:ANeuralNetworks_getDeviceCount等函数用于设备能力探测

RKNN SDK工具链全面解析

要实现极致性能,开发者必须掌握Rockchip专有的RKNN工具链。该工具链包含多个协同工作的组件,每个组件都有特定的职责和优化目标。

工具链组件分工

RKNN-Toolkit2作为PC端核心工具,承担模型转换的关键任务:

- 支持Caffe、TensorFlow、ONNX、PyTorch等多种框架模型转换

- 提供INT8量化、精度分析及PC端仿真推理功能

- 配置参数丰富,支持target_platform='rk3588'等针对性优化

RKNN Runtime作为设备端运行环境,提供C/C++ API和Python API两种接口:

librknn_api.so提供底层加速接口- RKNN-Toolkit-Lite2简化部署流程

- 支持动态库加载和环境变量配置

RKLLM作为大语言模型专用工具链,针对Transformer架构进行深度优化:

- 支持W8A8量化方案

- 提供专门的校准工具generate_data_quant.py

- 优化KV缓存机制,提升推理效率

典型开发工作流

模型开发需要遵循系统化的流程:

- 训练与导出阶段:在工作站完成模型训练,导出为ONNX标准格式

- 模型转换阶段:使用RKNN-Toolkit2进行格式转换和量化优化

- 交叉编译阶段:采用AArch64工具链编译设备端应用程序

- 部署运行阶段:配置运行时环境并执行推理任务

模型优化策略与技术实践

模型优化不仅是降低位宽的技术操作,更是对计算流的系统性重构。现代AI模型优化涉及多个层面的技术考量。

量化技术深度分析

量化通过降低参数精度来减小模型尺寸并加速推理,具体技术包括:

动态范围量化仅静态量化权重,无需校准集即可实现约4倍尺寸减小和2-3倍速度提升。这种方法适合对精度要求不高的应用场景。

**全整数量化(INT8)**将权重和激活函数均量化为8位,是实现RK3588峰值算力的必要条件。该技术需要精确的校准过程,但能带来显著的性能提升。

W8A8量化方案专为Transformer结构优化,在RKLLM工具链中得到了深度支持。这种方案在精度和硬件加速效率之间实现了良好平衡。

结构性优化策略

结构性优化涉及模型架构的深层调整:

算子融合技术将卷积层、ReLU激活函数和池化层融合成复合算子,有效减少中间数据在内存间的移动。这种优化能显著降低内存带宽需求。

剪枝与聚类技术通过移除冗余参数或共享权重值来压缩模型。剪枝技术可将模型尺寸减小9-13倍,甚至支持将模型完全装入片上SRAM缓存。

异构流水线设计原则

在处理视频识别等复杂任务时,合理的流水线设计至关重要:

- 预处理阶段:由MCU/CPU负责图像采集、解码及归一化等操作

- 特征提取阶段:NPU处理计算密集型子任务

- 后处理阶段:CPU负责结果处理和输出显示

这种分工充分利用了各处理单元的特长,实现了系统效率的最大化。

大语言模型部署实战

RK3588在低功耗生成式AI方面表现卓越,TinyLlama 1.1B模型可实现10-15 tokens/s的推理速度,远超人类正常阅读速度。

RKLLM模型转换关键技术

在进行大模型转换时,必须严格遵守硬件对齐要求:

- 最大上下文长度约束:必须是32的倍数,且不能超过16,384

- 量化校准要求:必须通过generate_data_quant.py生成校准文件data_quant.json

- 内存布局优化:针对Transformer架构的特殊内存访问模式进行优化

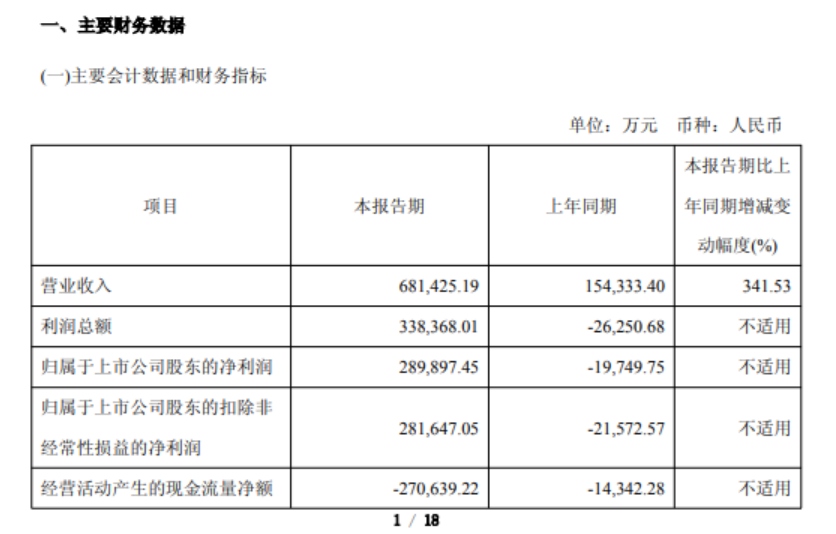

性能基准测试数据

通过系统测试,我们获得了不同模型在RK3588上的性能表现:

| 模型名称 | 参数量 | 推理速度(tokens/s) |

|---|---|---|

| TinyLlama | 1.1B | ~15.0 |

| Qwen2.5 | 1.5B | ~15.4 |

| Phi3 | 3.8B | ~6.4 |

| ChatGLM3 | 6B | ~3.6 |

这些数据表明,RK3588在处理10亿参数以下的模型时具有优秀的性能表现,完全满足边缘设备的实时推理需求。

底层系统优化技术

真正的专家必须深入RKNPU内核驱动层,理解系统底层的运行机制。

内核驱动深度分析

RKNPU驱动负责与硬件直接交互,其设计考虑了稳定性和性能的平衡:

- 驱动初始化状态可通过dmesg命令查看

- 版本管理机制确保兼容性

- 错误处理机制完善,支持 graceful degradation

内存管理优化策略

LLM推理对延迟极其敏感,高级优化要求深入理解RK3588的DMA机制:

专用内存区域分配将大型模型权重文件放置在系统预留的专用内存区域内,可以显著提升NPU的实际吞吐量。这种优化减少了内存竞争,提高了数据访问效率。

双缓冲技术应用在NPU处理当前数据块的同时,利用CPU/GPU预加载下一个数据块,有效隐藏了加载延迟。这种技术特别适合流式处理场景。

开发实践与进阶指南

RK3588为边缘AI提供了强大的基础,但释放其全部潜力需要系统性的技术积累:

掌握AOSP接口契约是基础,需要重点研究hardware/interfaces/neuralnetworks/下的AIDL定义,理解框架与硬件的交互协议。

深挖厂商专用工具是关键,需要精通RKNN-Toolkit2的量化调优与RKLLM的上下文约束配置,掌握各种优化参数的调节方法。

关注底层系统配置是进阶,需要理解内核驱动、内存预留以及DVFS动态电压频率调节对稳定性的影响,建立系统级的优化思维。

在实际开发中,建议参考rknn_model_zoo中的示例进行快速原型开发,同时关注Radxa、Firefly等社区的最新动态,及时获取更新的运行时库和优化方案。