在医疗人工智能的发展历程中,一个引人深思的现象正在颠覆传统的技术演进路径:参数规模达到70B的大型医疗模型,在实际问诊场景中的表现竟然不如仅有8B参数的模型。这一发现来自清华大学团队的最新研究,它揭示了医疗AI能力评估中长期被忽视的关键维度。

静态评测与动态能力的断层

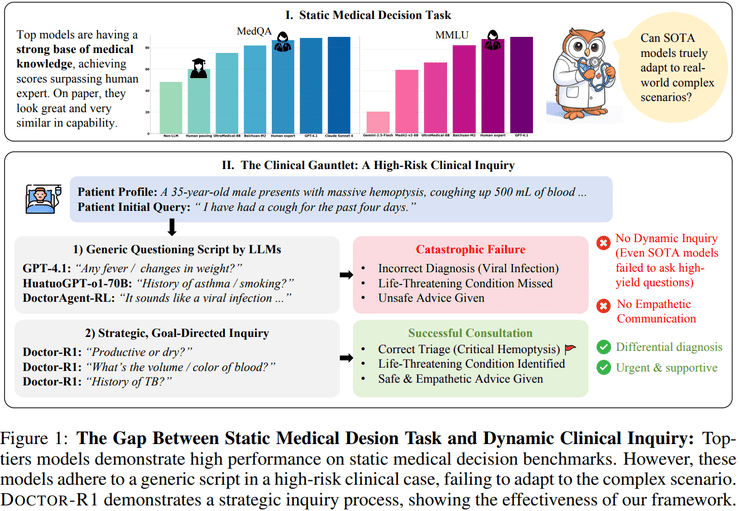

长期以来,医疗AI的能力评估主要依赖于医学考试题和临床问答数据集等静态基准。在这种评价框架下,模型只需在信息完整的封闭条件下给出正确答案,就被认为具备较高的医疗能力。随着大语言模型的兴起,这种评估方式确实取得了显著成果——多种系统在MedQA等测试中达到甚至超过人类专家水平。

然而,当这些模型被引入真实临床交互场景时,一个根本性问题开始显现:真实的医疗实践并非基于完整信息给出诊断,而是通过连续提问、风险识别和信息整合来逐步逼近决策的动态过程。模型在静态评测中展现的知识优势,并未自然转化为对真实问诊场景的可靠支持。

动态问诊中的系统性挑战

研究团队通过对照实验发现,在静态医学问答中表现优异的模型,在多轮交互的动态临床环境中会出现系统性失效。这种失效主要体现在四个关键方面:

首先,提问策略缺乏针对性。现有模型倾向于使用信息增益较低的标准化体检式问题,而不是根据患者具体情况制定个性化的询问路径。

其次,风险识别能力不足。当患者给出潜在高危信号时,模型往往难以及时调整提问策略,而是继续沿用固定模板进行询问。

第三,过早形成判断倾向。在关键信息尚未充分收集的情况下,模型容易过早形成诊断结论,甚至给出不恰当的安抚性或错误建议。

最后,沟通能力存在缺陷。模型表现出共情不足、语气过于武断或对不确定性处理不当等问题,这与真实医疗场景的要求存在明显差距。

DOCTOR-R1的创新方法论

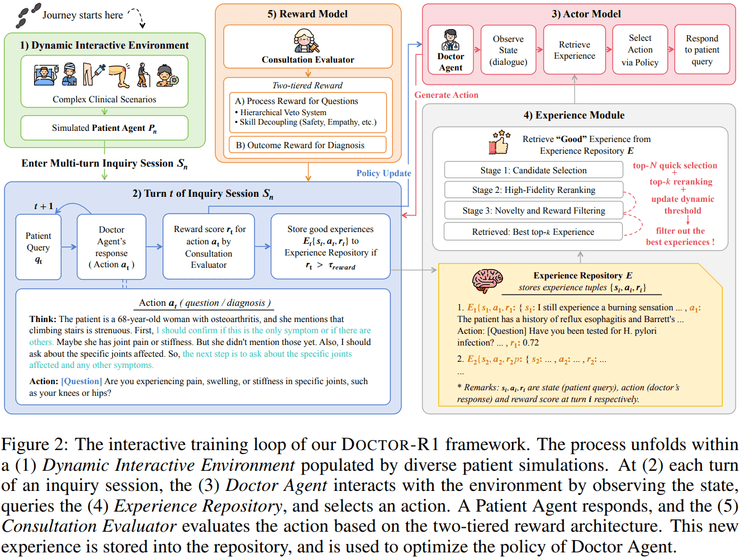

针对这些挑战,研究团队提出了DOCTOR-R1框架,其核心创新在于将临床问诊建模为部分可观测马尔可夫决策过程。这种建模方式更贴近真实医疗场景的本质特征——医生无法直接观察患者的真实病情状态,只能通过不完全的观察信息逐步推理。

与传统方法相比,POMDP建模保留了"问什么才有意义"这一核心问题。每一次提问行为都会直接影响下一步能够获得的信息内容,这使得模型必须学会在信息不完整的条件下做出最优的询问决策。

强化学习的关键作用

研究团队强调,必须采用强化学习而非单纯的微调方法,因为两者所能学习的能力本质不同。微调主要教会模型在获取完整信息后如何生成回答,而临床问诊的关键在于模型在尚不清楚答案的情况下,如何决定下一步应该询问什么信息。

这一过程属于行动会改变未来可获取信息结构的序列决策问题,因此天然更适合用强化学习来建模。研究采用了多智能体交互环境,使用大语言模型扮演患者智能体,确保即使在相同疾病背景下,患者的表述方式、回答顺序以及风险信号的暴露时机都具有高度多样性。

双层奖励机制设计

在奖励设计方面,研究提出了创新的双层奖励机制。传统方法如果仅依据最终诊断结果给予奖励,模型往往会倾向于过早猜测并提前结束对话,导致中间问诊过程不可控。

为解决这一问题,研究团队引入了分层惩罚机制,将安全性、推理合理性和医学准确性置于最高优先级。一旦触发底线错误即直接给予强负奖励,这种设计虽然约束严格,但能让模型守住临床安全的底线。

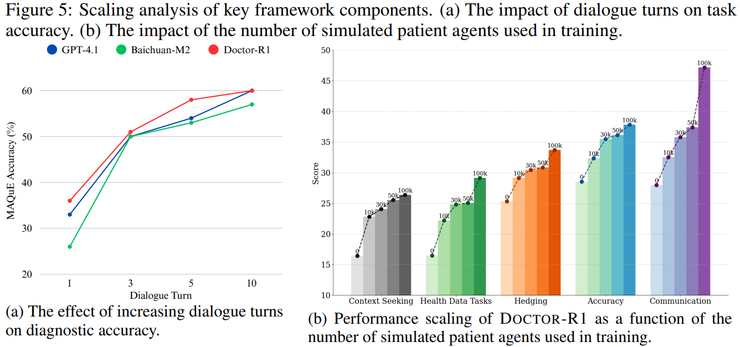

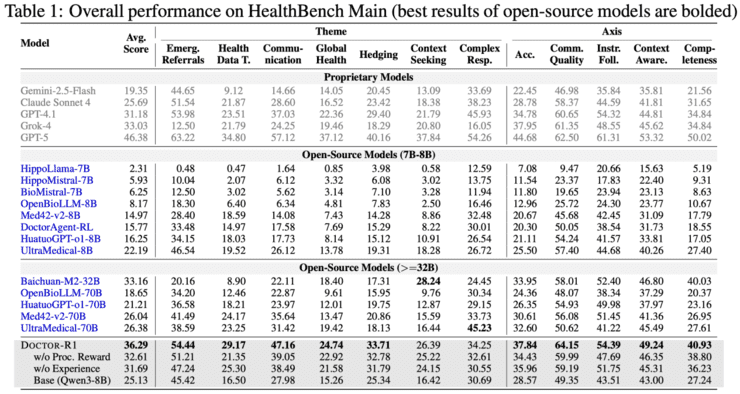

实验结果显示,在移除过程奖励、仅保留最终诊断奖励的情况下,模型的问诊过程明显退化为模板化和低风险偏好模式,在高风险场景中更容易产生安全性不足的回答。这证明了对提问过程本身进行显式奖励的必要性。

经验库机制的价值

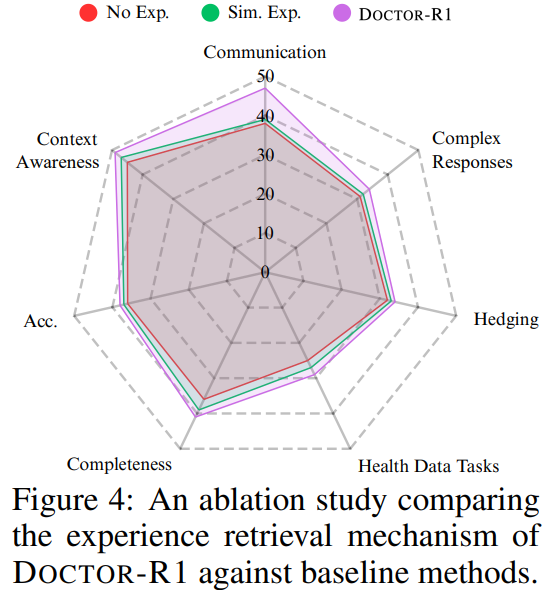

研究还引入了经验库机制,将其定位为经过筛选的"高质量医生经验"。通过仅存储高奖励轨迹、在检索时同时考虑语义相似度与历史奖励,并引入新颖性约束,模型在面对新患者时能够更接近积累了大量临床经验的医生。

当经验库机制被移除时,模型在新场景中的适应能力显著下降,在相似病例上的表现也更加不稳定,对话策略波动明显增大。这表明仅依赖on-policy强化学习不足以模拟真实医生通过长期经验积累形成的稳定问诊策略。

参数规模与能力的重新思考

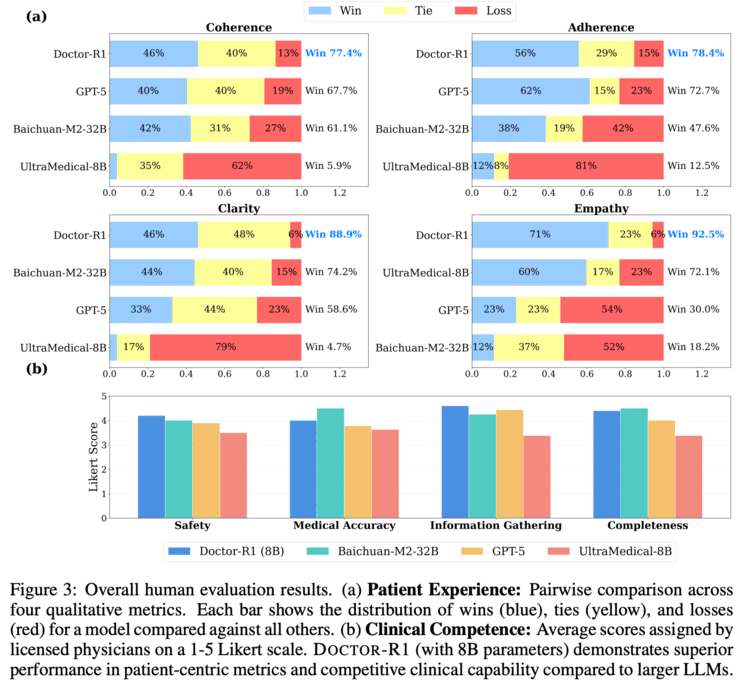

这项研究最具启示意义的发现是:在参数规模仅为8B的条件下,结合合适的强化学习训练框架,模型在多项动态问诊指标上能够超过参数规模达到70B的知识型模型。这一现象对长期以来以模型规模和知识覆盖度为中心的发展路径形成了重要纠偏。

研究结果表明,当前医疗AI的瓶颈不仅受限于模型所具备的医学知识规模,更在于是否采用了与真实临床实践相匹配的训练范式。参数规模的增长如果不能与训练方法的创新同步,就可能出现边际效益递减的现象。

软技能的可训练性验证

另一个重要突破是将以往被视为难以量化的软技能问题转化为可优化目标。通过合理的任务建模和奖励设计,共情表达、沟通质量以及对不确定性的处理等能力能够被稳定评估并持续强化。

研究发现,良好的沟通能力并非问诊过程的附带收益,而是其策略的内在组成部分。在HealthBench的沟通质量、上下文理解和回答完整性等指标上,DOCTOR-R1的提升幅度明显高于准确率本身,说明共情本身有助于提高信息获取效率。

医疗AI发展的方法论启示

从更广泛的意义来看,这项研究为医疗人工智能领域提供了重要的方法论启示。首先,它强调了评估方式对技术发展方向的决定性影响。当评估重点从静态知识测试转向动态交互能力时,整个技术演进路径都需要相应调整。

其次,研究验证了"小而精"的技术路线在特定场景下的可行性。在资源有限的情况下,通过优化训练范式而非盲目扩大模型规模,可能获得更好的效果。

最后,这项工作为真实世界智能体的构建提供了可复制的通用模板。其核心问题特征——不完全信息条件下的决策、面向长期目标的序列行为、高风险情境中的安全约束以及对经验积累机制的依赖——正是大多数真实世界智能体任务所共有的。

未来发展方向

基于这项研究的启示,医疗AI的未来发展可能呈现以下几个趋势:

训练范式将更加注重动态交互能力的培养,而不仅仅是知识记忆。评估体系需要建立更加全面的多维指标,涵盖医学准确性、沟通质量、风险感知和决策过程等多个维度。

模型架构可能会朝着更加专业化的方向发展,针对不同医疗场景开发具有特定能力的专用模型,而非追求通用性的大而全方案。

安全性将成为更加核心的考量因素,特别是在高风险医疗决策场景中,模型需要具备更强的风险识别和规避能力。

这项研究不仅为医疗AI领域提供了具体的技术方案,更重要的是启发了对整个行业发展方向的重新思考。在模型规模竞赛之外,如何让AI真正理解并适应复杂的医疗实践环境,可能是未来更需要关注的核心问题。

从技术实现到临床应用的转化过程中,还需要解决诸多挑战,包括数据隐私保护、法规合规性、与现有医疗系统的集成等。但这项研究无疑为医疗AI的发展指明了一个值得深入探索的方向——让AI不仅具备医学知识,更懂得如何像医生一样思考和行为。