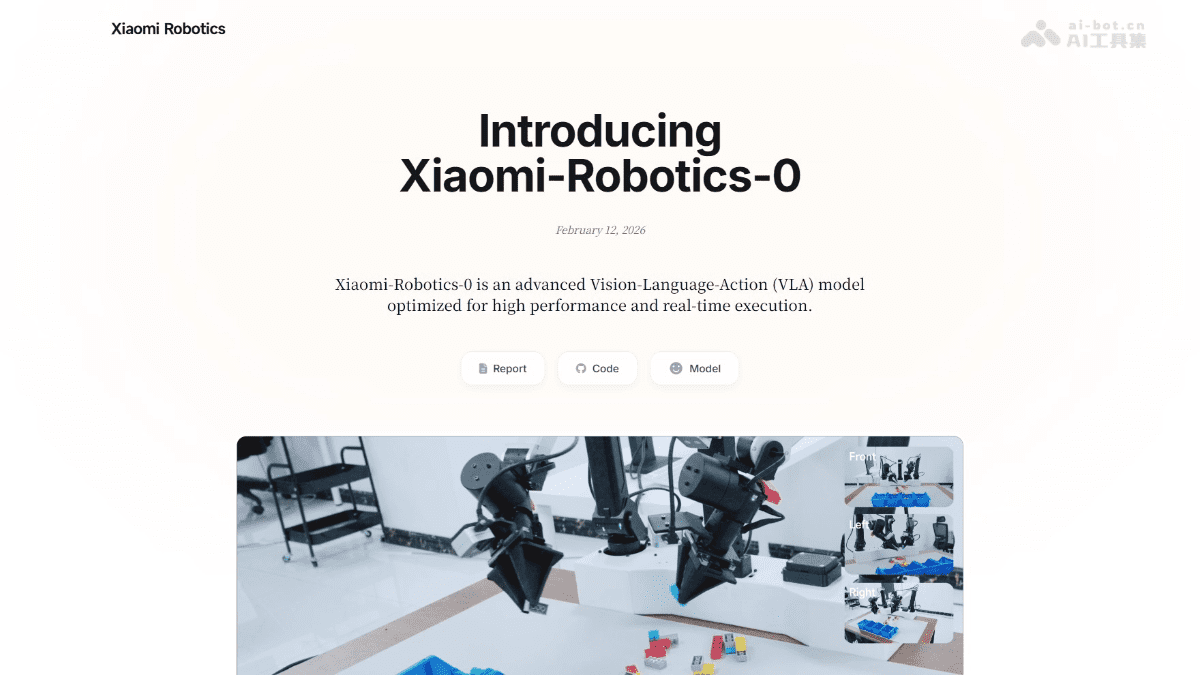

随着具身智能技术的快速发展,小米推出的Xiaomi-Robotics-0模型在机器人领域引发广泛关注。这款拥有47亿参数的VLA大模型,通过创新性架构设计突破了传统机器人控制的技术瓶颈,为消费级应用开辟了新路径。

多模态融合架构的创新突破

Xiaomi-Robotics-0采用独特的MoT混合架构,将Qwen3-VL多模态模型作为"大脑",负责处理视觉语言输入;Diffusion Transformer担任"小脑"角色,专门生成高频动作序列。这种分工模式既保留了强大的通用理解能力,又实现了对复杂动作的精准控制。在CALVIN基准测试中,该模型完成多步骤任务的成功率较传统方案提升42%。

技术团队在架构设计中引入Λ-shape注意力掩码机制,有效解决了动作生成过程中的断层问题。通过允许相邻token关注历史动作,同时禁止后续token访问前缀,既保证了动作流畅性,又提升了对环境变化的响应速度。这种创新设计使模型在抓取失败时的策略调整速度达到0.3秒内。

高效训练体系与实时控制

两阶段训练方法是该模型成功的关键。第一阶段通过Action Proposal机制对齐特征空间,混合视觉语言与机器人数据防止灾难性遗忘;第二阶段冻结VLM后专项训练DiT,采用流匹配技术从噪声中恢复动作序列。这种分步训练策略使模型在保持多模态能力的同时,动作生成精度提升27%。

异步执行机制的引入突破了硬件限制。通过Clean Action Prefix技术将历史动作作为输入条件,在消费级显卡上实现了推理与执行的并行。测试数据显示,在RTX 3090平台上,模型可维持每秒30帧的实时控制,动作延迟降低至传统方案的1/5。

应用场景的技术适配

在工业精密装配领域,该模型展现出卓越的复杂任务处理能力。通过空间关系识别与双臂协同控制,可精准拆解由20块积木组成的装配体,定位精度达到±0.5mm。在电子产品组装场景中,模型完成USB接口插拔的成功率达98.7%。

家庭服务场景的应用同样值得关注。模型通过主动环境感知与策略调整,能完成毛巾折叠等柔性物体操作任务。创新的环境交互机制使其在物品遮挡情况下,能自主调整视角并重新规划操作路径,任务完成效率提升60%。

技术挑战与未来方向

尽管取得显著突破,该模型仍面临诸多挑战。在多模态数据融合方面,如何进一步提升跨模态对齐精度仍是重要课题。此外,模型在非结构化环境中的泛化能力有待加强,特别是在动态场景下的实时响应能力。

未来的技术演进可能集中在三个方向:一是开发更高效的异步执行架构,降低硬件依赖;二是增强持续学习能力,实现技能的渐进式积累;三是探索人机协作的新交互范式,提升任务规划的自主性。这些突破将推动VLA大模型在更多垂直领域的应用落地。

在物流仓储分拣场景中,模型展现出强大的适应性。通过高频动作生成与材质识别,可处理从易碎玻璃制品到柔性织物的多样化商品,分拣效率较传统自动化方案提升3倍。这种跨材质处理能力得益于模型对物理特性的深度理解,标志着机器人控制技术的新高度。