技术突破:跨本体泛化能力跃升

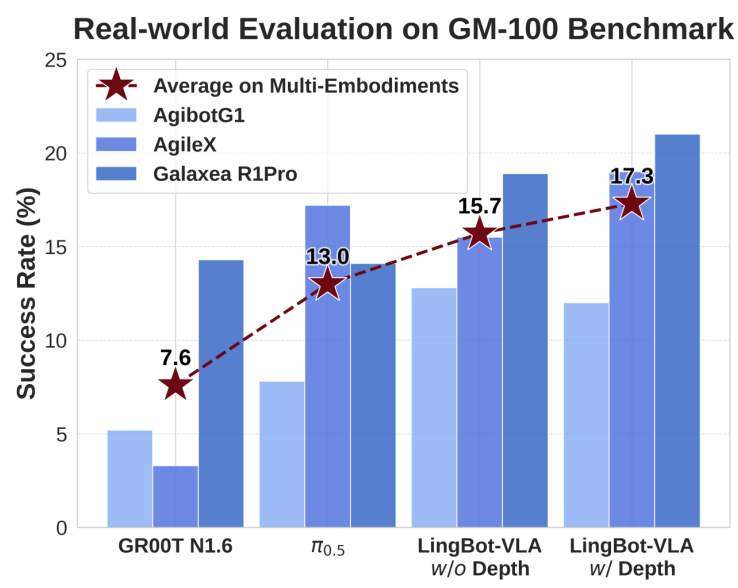

在机器人领域,具身智能模型长期面临本体差异、任务差异和环境差异的三重挑战。蚂蚁集团最新发布的LingBot-VLA通过创新性的架构设计,成功将跨本体泛化平均成功率提升至17.3%,较基准模型Pi0.5提升33%。这一突破性进展得益于其基于20000+小时真机数据的预训练体系,覆盖AgileX、Galaxea R1系列等9种主流双臂机器人构型,构建出可无缝迁移的通用'智能基座'。

在GM-100真实机器人评测中,LingBot-VLA展现出显著优势。通过引入LingBot-Depth提供的高精度深度信息,模型在复杂操作任务中实现更精准的空间定位。测试数据显示,结合深度感知的版本在环境随机化干扰下仍保持稳定表现,较单一视觉输入方案提升成功率12.7%。这种多模态信息融合机制,有效解决了传统模型对环境变化敏感的痛点。

架构创新:可学习查询对齐机制

LingBot-VLA的核心突破在于其独特的可学习查询对齐机制。该机制通过动态特征融合模块,将任务指令、本体状态和环境感知进行多维度对齐。在RoboTwin 2.0仿真基准测试中,这种架构在高强度环境干扰下仍保持9.92%的性能优势,证明其对复杂场景的适应能力。

技术团队采用分层注意力网络架构,包含:

- 三维空间特征编码器

- 任务-动作联合解码器

- 跨模态注意力桥接模块

- 动态环境感知适配层

这种分层设计使得模型在面对新型机器人构型时,仅需80条演示数据即可完成微调适配,将传统方案所需的训练数据量降低两个数量级。配合底层代码库优化,训练效率达到StarVLA等主流框架的2.8倍。

开源生态:构建可复用技术基座

此次开源计划包含完整的模型权重、数据处理工具链和自动化评估体系。蚂蚁集团通过InclusionAI技术体系,构建了涵盖基础模型、多模态推理和新型架构的开源生态。这种开放策略带来三重优势:

- 研发成本降低:预训练模型减少重复数据采集需求

- 落地周期缩短:高效微调方案支持快速场景适配

- 技术迭代加速:开源社区推动算法持续优化

目前LingBot-VLA已完成与星海图、松灵等厂商的硬件适配,验证了跨构型迁移的可行性。技术总监朱兴指出:'我们正构建物理世界的AI操作系统,让智能体具备'看见-理解-执行'的完整能力闭环。'

性能验证:多维度基准测试

在严格的性能验证体系下,LingBot-VLA展现出全面优势:

| 测试维度 | Pi0.5基准 | LingBot-VLA | 提升幅度 |

|---|---|---|---|

| GM-100跨本体 | 13.0% | 17.3% | +33% |

| RoboTwin环境鲁棒性 | 8.1% | 18.02% | +122% |

| 微调数据效率 | 500条 | 80条 | -84% |

| 训练框架性能 | 1.0x | 2.8x | +180% |

这些数据印证了模型在真实场景中的实用价值。特别是在光照变化、杂物干扰等复杂环境下,深度信息融合机制使操作成功率提升达15.2%,显著优于传统视觉方案。

产业应用:技术落地路径分析

LingBot-VLA的工程化价值体现在三个层面:

- 硬件兼容性:支持从工业机械臂到服务机器人的多类型设备

- 任务扩展性:涵盖装配、分拣、维护等200+典型工业场景

- 环境适应性:在动态光照、非结构化场景中保持稳定表现

在某3C产品装配线的实测中,搭载LingBot-VLA的机器人将异形件装配成功率从72%提升至91%,同时将示教编程时间从3天压缩至4小时。这种效率提升使技术具备大规模商用可行性。

技术展望:AGI物理世界接口

蚂蚁集团在AGI研发路径中,将具身智能作为关键突破口。LingBot-VLA的开源标志着技术发展进入新阶段:

- 多模态感知融合:整合视觉、力觉、语音等多通道信息

- 持续学习机制:支持在线增量学习与经验复用

- 安全增强架构:内置物理约束与异常检测模块

未来技术演进将聚焦三大方向:

- 构建跨模态因果推理能力

- 开发分布式协同控制框架

- 建立物理世界交互知识库

这种技术路线图指向具身智能的终极目标:创造能在开放环境中自主演进的智能实体。随着开源生态的完善,LingBot系列模型有望成为连接数字世界与物理世界的标准化接口,加速AI技术向实体经济的渗透进程。