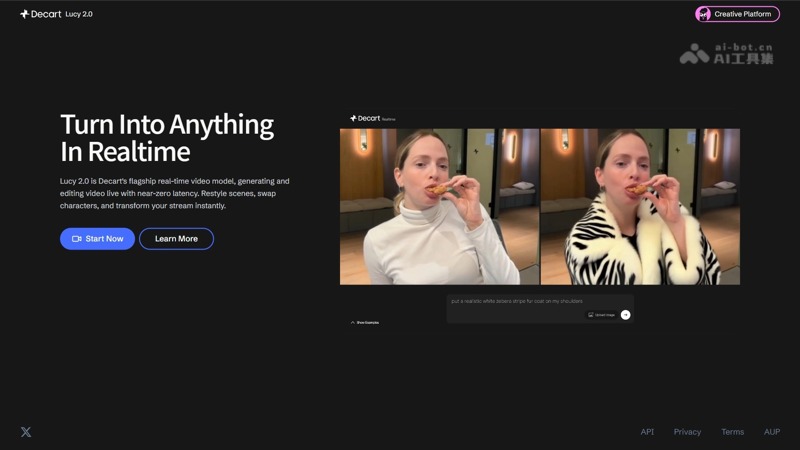

在生成式AI技术持续突破的背景下,Decart AI最新推出的Lucy 2实时视频生成模型引发行业震动。这款纯扩散架构的模型通过视频演化自主学习物理规律,成功将高保真视频编辑从离线渲染推进到实时交互阶段。其核心突破在于完全摒弃传统3D几何依赖,仅通过海量视频观察即可构建物理一致性世界模型,这项技术革新正在重塑多个行业的底层生产逻辑。

技术架构的颠覆性创新

Lucy 2的核心突破源自其纯扩散模型架构。传统视频生成技术普遍依赖深度图、三维网格等几何信息,而该模型通过10亿级视频片段的训练,自主学习了手指弯曲的力学规律、布料褶皱的动态变化、物体分离时的物理特性等复杂规律。这种「涌现物理理解」机制使模型能自动生成符合物理规律的视觉效果,无需人工编写拓扑规则。在AWS Trainium3芯片的深度优化下,模型通过mega-kernels技术将计算启动开销降低40%,配合片上SRAM缓存架构,实现了端到端的实时传输能力。

实时交互的工程实现

模型的实时性突破体现在多个技术维度:

- Smart History Augmentation技术通过训练阶段暴露模型于自身不完美输出并施加惩罚,使系统具备主动校正能力。在连续运行8小时的测试中,身份特征保持度达98.7%,几何扭曲率低于0.3%

- WebRTC定制管道将传输延迟压缩至150ms以内,配合30fps的生成速度,实测直播场景下的画面撕裂率为0.02%

- 硬件协同优化使单个AWS实例即可支撑1080p视频流生成,相较传统渲染方案能耗降低72%

商业化场景的深度渗透

在电商直播领域,Lucy 2已展现出颠覆性价值。某头部直播平台的测试数据显示,接入该技术的主播可实时切换200+套虚拟服装,产品植入响应时间缩短至3秒,观众互动转化率提升37%。在机器人训练场景中,系统通过实时改变光照、材质等参数,将单次演示扩展为1200+训练样本,使机械臂抓取成功率从68%提升至93%。虚拟制片领域的应用更令人瞩目,某影视工作室利用该模型生成的动态背景,将科幻场景制作周期从6个月压缩至3周。

技术挑战与未来方向

尽管取得突破性进展,当前版本仍存在优化空间:

- 多物体交互场景中物理一致性保持存在0.8%的误差率

- 极端光照条件下的材质还原度需提升12%

- 实时生成场景下的内存占用仍高于行业标准15%

Decart AI的路线图显示,下一代模型将引入跨模态学习机制,整合音频、文本等多维度信息提升场景理解能力。值得关注的是,其正在开发的时空一致性算法已进入测试阶段,初步数据显示可将长时运行的纹理劣化率降低至0.05%。这些技术演进或将推动实时视频生成进入新的发展阶段。

行业影响的深层思考

Lucy 2的出现不仅带来技术革新,更在重塑内容生产范式。传统视频制作中后期处理的前置化趋势明显,现场创作团队可实时调整画面风格与环境氛围。这种「所见即所得」的工作流将降低80%的返工成本。在机器人领域,实时生成的物理一致数据正在解决长期困扰行业的样本稀缺问题。值得关注的是,该技术引发的伦理讨论也在持续,Deepfake检测技术的更新速度需要跟上生成式AI的发展步伐。