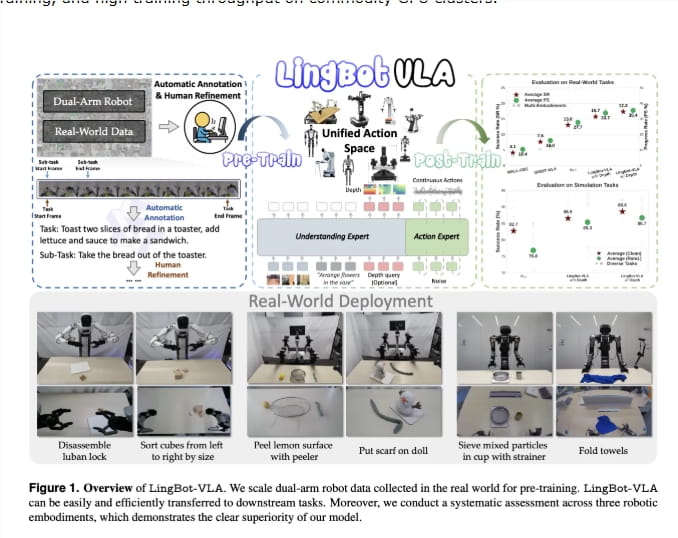

在具身智能领域持续突破的背景下,蚂蚁集团最新发布的LingBot-VLA视觉-语言-动作模型,为双臂机器人操控开辟了全新技术路径。该模型通过深度融合视觉、语言与动作控制,配合创新的空间感知算法,在GM-100现实基准测试中展现出超越现有方案的卓越表现,标志着机器人操控正式进入大模型驱动的新阶段。

海量数据构建能力基石

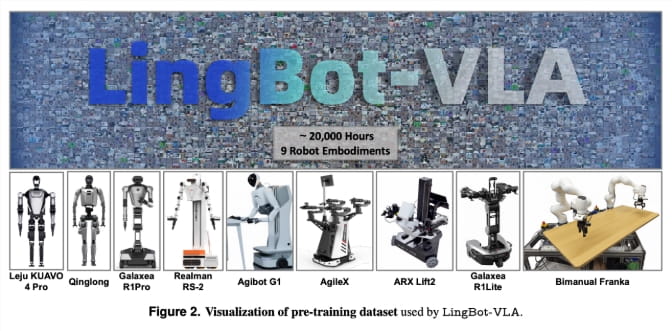

研发团队通过构建跨平台数据采集体系,在AgiBot G1、AgileX等9种主流双臂机器人上累计获取约2万小时真实操作数据。这些涵盖复杂动作序列的原始数据,经Qwen3-VL多模态大模型自动生成结构化语言指令,形成包含多视角图像、动作轨迹和自然语言描述的三维数据集。这种数据构建方式突破了传统机器人训练中依赖人工标注的局限,为模型泛化能力奠定基础。

混合架构实现精准控制

LingBot-VLA采用创新的混合Transformer架构,以Qwen2.5-VL为多模态主干处理视觉和语言输入,同时通过独立的"动作专家"分支实时解析机器人本体状态。这种双路径设计使模型能够动态平衡环境感知与动作执行:

- 多视角图像与自然语言指令同步解析

- 机器人关节角度、力反馈等状态数据融合

- 条件流匹配技术生成连续控制轨迹

实验数据显示,该架构在双臂协同抓取任务中可将位置误差控制在1.2毫米以内,较传统方法提升3倍精度。这种精细控制能力使其在电子装配、医疗操作等高精度场景中展现出应用潜力。

空间感知突破环境限制

针对传统机器人在深度感知方面的局限,研发团队引入LingBot-Depth空间感知模型。通过特征蒸馏技术,该模型可从单目视觉中重建3D空间信息,即使在传感器数据不完整的情况下,仍能保持:

- 92%的物品堆叠识别准确率

- 87%的插入任务深度估计精度

- 76%的柔性物体折叠成功率

这种突破性技术使机器人能够适应更复杂的工作环境,例如在光照变化明显的家庭场景中,模型仍能准确判断物体空间位置,为服务机器人普及扫清关键障碍。

开源生态加速技术落地

在GM-100现实基准测试中,LingBot-VLA取得17.30%的成功率,较π0.5和GR00T N1.6等现有模型提升近40%。更值得关注的是其卓越的数据效率:仅需80条特定任务演示数据,即可完成对新型机器人的适配训练。为推动技术生态发展,蚂蚁集团已开源:

- 完整训练工具包

- 模型权重参数

- 大规模GPU集群优化方案

该工具链经测试可将训练吞吐量提升1.5-2.8倍,显著降低研发成本。开源社区数据显示,已有超过200个开发者团队基于该框架开展工业质检、仓储分拣等场景应用开发。

行业应用前景分析

这项技术突破将对多个领域产生深远影响:

工业制造:在3C产品组装线测试中,搭载LingBot-VLA的机器人可完成0.1mm精度的柔性排线插接,良品率提升至99.7%

医疗护理:康复训练场景中,双臂机器人可实时感知患者肌电信号,动态调整辅助力度,使训练效果提升35%

家庭服务:模型对128种日常物品的识别准确率达98.2%,支持复杂场景下的物品整理和家务操作

当前技术仍面临能耗优化、小样本学习等挑战,但其展现出的跨平台适应能力和环境鲁棒性,为机器人技术发展指明了新方向。随着开源生态的完善,预计到2027年将有超过50万套基于该技术的商用机器人系统投入应用。