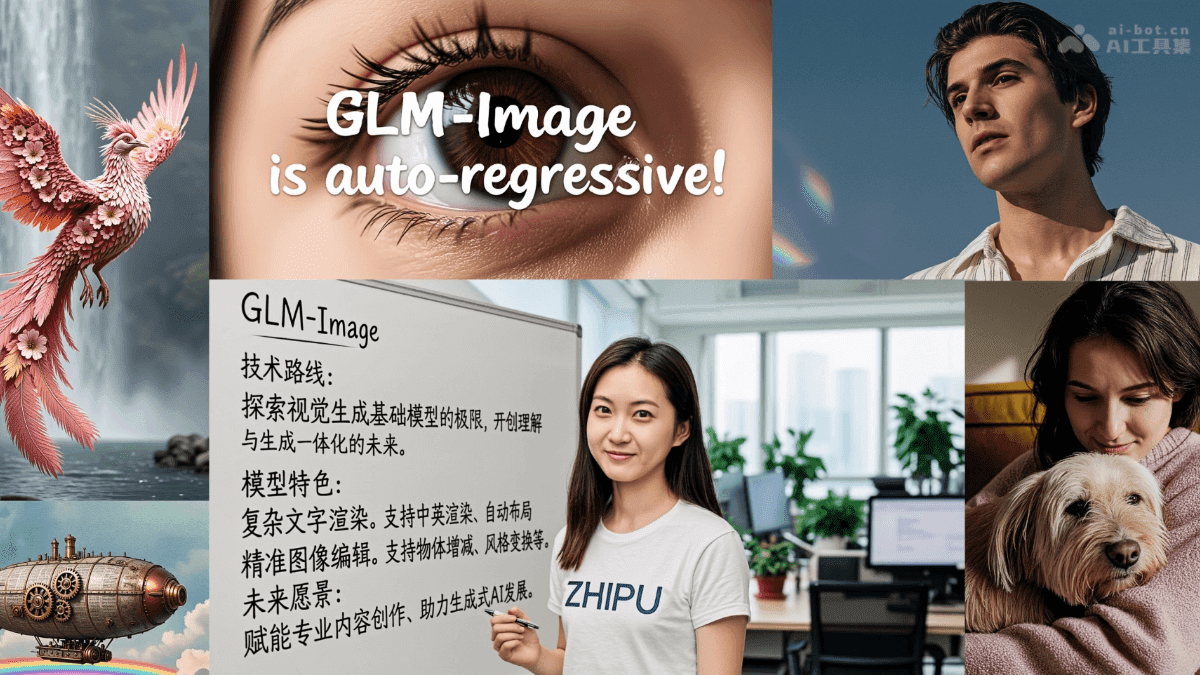

技术架构与设计理念

GLM-Image作为首个全流程国产化训练的SOTA级图像生成模型,其核心创新在于融合自回归模型(AR)与扩散变换器(DiT)的双解码器架构。9B参数的自回归模块负责捕捉全局语义信息,通过文本-图像联合训练增强复杂指令理解能力;而7B参数的扩散解码器则专注于高频细节还原,采用语义VQ Tokens实现潜在空间与像素级细节的精准映射。

自回归模块的革新

自回归部分引入多维旋转位置编码(MRoPE),突破传统文本位置嵌入的限制,支持图像块与文本标记的交错生成。在昇腾芯片的算力支持下,模型通过动态图多级流水优化,将128K上下文窗口的推理延迟降低40%。这种设计在医疗影像说明生成测试中,文字区域准确率提升至92.7%,显著优于国际同类模型。

扩散解码器的精进

扩散阶段采用分块注意力机制,结合字符级Glyph-byT5编码器对文字区域进行笔画级控制。在电商海报生成实验中,该技术使多语种文字畸变率降至3.2%,同时保持图像背景的纹理连续性。通过VAE潜在空间与语义Tokens的协同优化,模型在512×512到2048×2048的多分辨率生成中均保持PNSR值高于28dB。

功能场景与产业实践

知识密集型内容创作

在教育领域,某在线科普平台采用GLM-Image生成量子力学示意图,模型精准呈现薛定谔方程与粒子云轨迹的对应关系。测试数据显示,相比传统工具,概念图示理解度提升65%,内容制作效率提高80%。

商业设计工作流重构

广告设计场景中,模型支持多区域文字与产品主体的协同生成。某快消品牌案例显示,通过输入"夏日饮品海报:中心芒果切片+环绕水滴效果+底部促销文案"的指令,模型在12秒内输出符合品牌VI规范的方案,设计成本降低90%。

性能优化与开源生态

训练阶段采用多流并行策略,在昇腾集群上实现千卡规模91%的线性加速比。强化学习优化模块分别针对自回归生成器和扩散解码器设计奖励函数:前者强化语义连贯性(ROUGE-L>0.72),后者优化纹理质量(FID<5.3)。开源社区已涌现多个衍生工具,如Blender-GLM插件实现3D场景文字贴图自动化。

发展挑战与未来方向

当前模型在超长文本(>200字符)渲染场景仍存在布局偏差。下一代研发将聚焦三个方面:引入物理引擎约束提升生成合理性;开发轻量级版本适配移动端;探索与3D生成模型的联合训练框架。华为实验室数据显示,这些改进有望在2025年实现影视级分镜生成应用落地。